최근 몇 년 동안 LLM (Large Language Models)의 성능은 많은 관심을 끌었습니다. 이 기사는 흥미 진진한 연구를 소개합니다.이 연구는 검색 전략을 영리하게 사용하여 소규모 LLM의 성능을 크게 향상시킵니다. 이 연구는 전통적인 "더 큰 모델과 더 나은"의 개념에 도전하고, LLM의 미래 개발을위한 새로운 아이디어와 방향을 제공하며, 자원이 제한된 연구원과 개발자에게 더 많은 가능성을 제공합니다. 모델 추론 기능을 향상시키고 컴퓨팅 리소스와 모델 매개 변수 간의 관계에 대해 약간의 생각을 트리거하는 데있어 검색 전략의 큰 잠재력을 보여줍니다.

최근에 새로운 연구는 흥미로 웠으며 큰 언어 모델 (LLM)이 검색 기능을 통해 성능을 크게 향상시킬 수 있음을 증명합니다. 특히, 매개 변수량이 8 억 개에 불과한 LLAMA3.1 모델은 100 개의 검색을 통과했으며 Python 코드의 GPT-4O와 비교할 수 없었습니다.

이 아이디어는 2019 년 Rich Sutton의 클래식 블로그 게시물 인 Rich Sutton의 클래식 블로그 게시물 인 Learne of Learner를 사람들에게 상기시키는 것으로 보입니다. 그는 컴퓨팅 능력의 개선으로 일반적인 방법의 힘을 인식해야한다고 언급했다. 특히, "검색"과 "학습"의 두 가지 방법은 계속 확장 할 수있는 훌륭한 선택 인 것 같습니다.

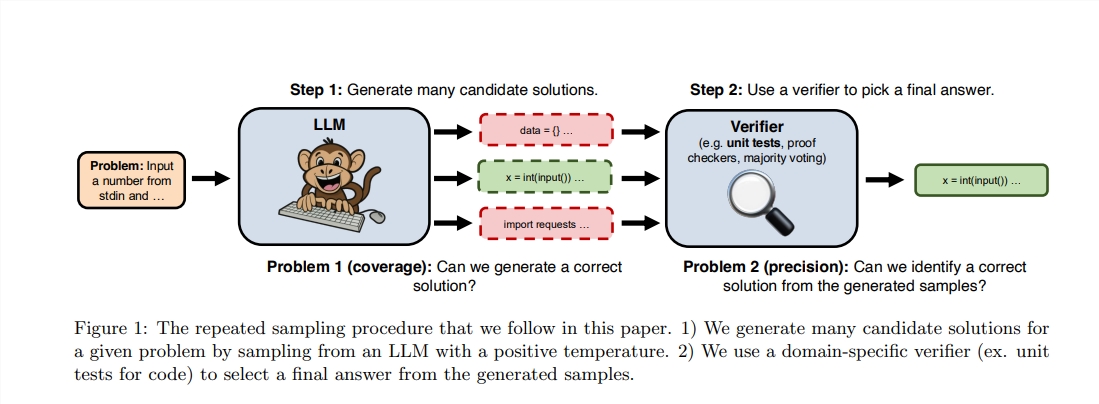

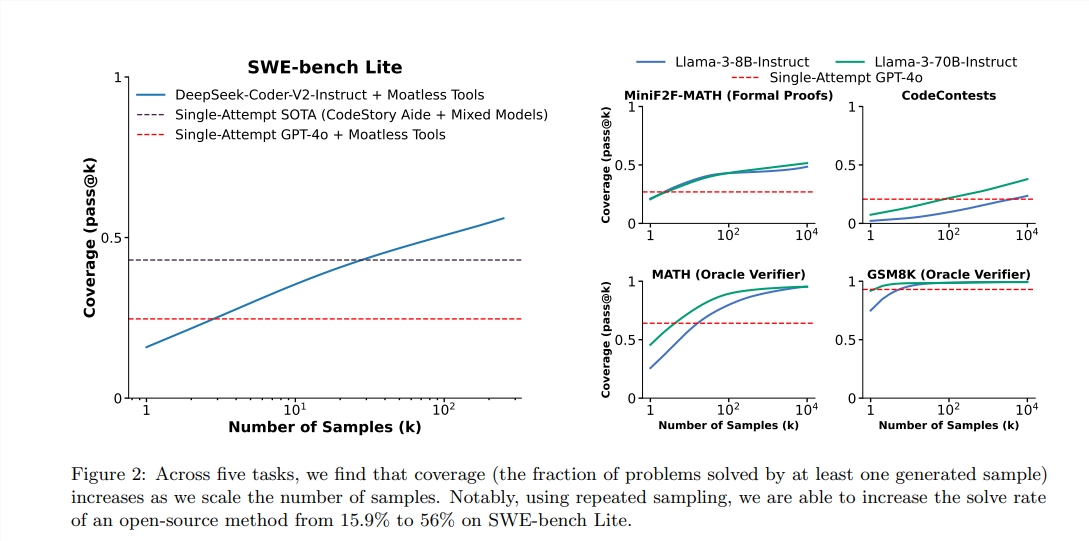

Sutton은 학습의 중요성을 강조하지만, 즉 더 큰 모델은 일반적으로 더 많은 지식을 배울 수 있지만, 우리는 종종 추론 과정에서 검색의 잠재력을 무시합니다. 최근 Stanford, Oxford 및 Deepmind의 연구원들은 추론 단계에서 반복 샘플링 시간의 수를 늘리면 수학, 추론 및 코드 생성 분야에서 모델의 성능을 크게 향상시킬 수 있음을 발견했습니다.

이 연구에서 영감을 얻은 후, 두 엔지니어는 실험을 수행하기로 결정했습니다. 그들은 검색에 100 개의 작은 라마 모델을 사용하면 파이썬 프로그래밍 작업에서 GPT-4O를 능가하고 묶을 수 있음을 발견했습니다. 그들은 생생한 은유를 사용하여 다음과 같이 설명합니다.

더 높은 성능을 달성하기 위해 VLLM 라이브러리를 사용하여 배치 추론을 수행하고 10 A100-40GB GPU에서 실행했습니다. 저자는 Humaneval의 벤치 마크 테스트를 선택했습니다. 테스트 평가를 실행하여 생성 된 코드를 실행할 수 있기 때문에 더 객관적이고 정확합니다.

보고서에 따르면, GPT-4O의 1 점은 제로 샘플 추론에서 90.2%입니다. 위의 방법을 통해 LLAMA3.18B의 PASS@K 점수도 크게 향상되었습니다. 반복 샘플링의 수가 100 인 경우, LLAMA의 점수는 90.5%에 도달했으며, 결과는 95.1%로 증가하여 GPT-4O보다 상당히 우수했습니다.

이 실험은 원래 연구를 엄격하게 재현하지는 않지만 검색 방법이 추론 단계를 향상시킬 때 더 작은 모델이 예측 가능한 범위 내에서 큰 모델의 가능성을 능가 할 수 있음을 강조합니다.

검색은 계산에서 메모리에서 계산으로 자원을 전송하여 "투명하게"확장 될 수 있기 때문에 강력합니다. 따라서 자원의 균형을 달성합니다. 최근 DeepMind는 수학 분야에서 중요한 진전을 이루어 검색의 힘을 입증했습니다.

그러나 검색의 성공은 먼저 결과에 대한 높은 품질의 평가를 수행해야합니다. Deepmind 모델은 수학적 문제를 자연 언어로 변환하여 공식적인 표현을 형성함으로써 효과적인 감독을 달성했습니다. 다른 영역에서는 "요약 이메일"과 같은 열린 NLP 작업은 효과적인 검색을 수행하기가 훨씬 어렵습니다.

이 연구는 특정 분야에서 모델 생성의 성능 향상이 평가 및 검색 기능과 관련이 있으며 향후 연구는 반복되는 디지털 환경을 통해 이러한 기능을 향상시키는 방법을 탐구 할 수 있음을 보여줍니다.

논문 주소 : https : //arxiv.org/pdf/2407.21787

대체로이 연구는 단순히 더 큰 모델 매개 변수를 추구하기보다는 전략을 검색함으로써 큰 언어 모델의 성능 향상에 대한 새로운 관점을 제공합니다. 앞으로 학습 및 검색 전략을 효과적으로 결합하는 방법은 LLM 개발의 중요한 방향이 될 것입니다. 이 연구의 링크 된 링크도 제공되었으며 관심있는 독자들은이를 더 이해할 수 있습니다.