인카나마인드는 여러 문서와 대화형 채팅이 가능하고, 정확한 정보 조회 서비스를 제공할 수 있는 혁신적인 AI 모델입니다. 기존 AI 모델의 한계를 극복하고 정보 검색 방법의 동적 조정을 실현하여 사용자에게 새로운 문서 상호 작용 경험을 제공합니다. 이 모델은 문서 내용의 복잡성과 사용자 요구에 따라 검색 창의 크기와 위치를 유연하게 조정할 수 있는 혁신적인 슬라이딩 창 차단 기술을 사용하여 포괄적인 상황 정보와 세부적인 세부 정보 획득의 균형을 효과적으로 유지합니다. 뿐만 아니라 IncarnaMind는 OpenAI의 GPT 시리즈, Anthropic의 Claude 및 Llama2 등과 같은 멀티 홉 쿼리와 다양한 대규모 언어 모델을 지원하며 강력한 호환성을 갖추고 있어 다양한 사용자의 개인화된 요구 사항을 충족합니다.

인카나마인드는 여러 문서와 상호작용해 채팅하고 정보를 정확하게 쿼리할 수 있는 AI 모델이다. 문서 내용을 이해할 수 있을 뿐만 아니라 사용자의 요구에 따라 정보 검색 방법을 동적으로 조정하여 사용자에게 완전히 새로운 문서 상호 작용 경험을 제공합니다.

IncarnaMind는 문서 내용의 복잡성과 사용자 쿼리 요구 사항에 따라 검색 창의 크기와 위치를 동적으로 조정할 수 있는 혁신적인 슬라이딩 창 차단 기술을 사용합니다. 기존의 고정 블록 크기 RAG(검색 증강 생성) 방법과 비교하여 IncarnaMind는 포괄적인 상황 정보 획득과 세부 정보 간의 관계 균형을 더 잘 맞출 수 있습니다.

IncarnaMind는 멀티홉 쿼리를 지원하고 동시에 여러 문서를 처리할 수 있어 한 번에 하나의 문서만 쿼리할 수 있었던 기존 AI 모델의 한계를 깨뜨렸습니다. 이 기능은 사용자에게 보다 포괄적이고 통합된 데이터 정보를 제공하여 정보 검색의 효율성과 정확성을 크게 향상시킵니다.

IncarnaMind는 OpenAI의 GPT 시리즈, Anthropic의 Claude 및 Llama2와 같은 오픈 소스 LLM(대형 언어 모델)을 포함하되 이에 국한되지 않는 다양한 대형 언어 모델을 지원합니다. 이러한 광범위한 호환성을 통해 IncarnaMind는 다양한 사용자의 요구를 충족하고 보다 개인화된 서비스를 제공할 수 있습니다.

주요 특징:

적응형 차단: IncarnaMind의 슬라이딩 창 차단 기술은 데이터 복잡성과 상황별 요구 사항에 따라 창 크기와 위치를 동적으로 조정하여 세분화된 데이터 액세스와 거친 데이터 액세스 간의 균형을 달성할 수 있습니다.

다중 문서 대화형 QA: IncarnaMind는 여러 문서에 대한 간단한 쿼리와 다중 홉 쿼리를 지원하므로 사용자는 문서 간 정보를 쉽게 얻을 수 있습니다.

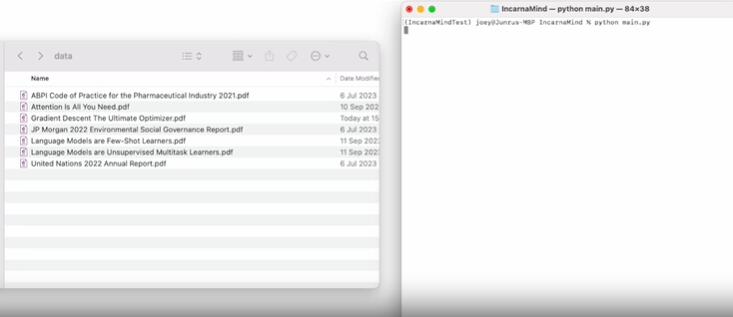

파일 호환성: IncarnaMind는 일반적인 문서 유형을 다루는 PDF 및 TXT 파일 형식을 지원합니다.

LLM 모델 호환성: IncarnaMind는 OpenAI GPT, Anthropic Claude, Llama2 등을 포함한 다양한 오픈 소스 대규모 언어 모델을 지원합니다.

IncarnaMind는 앞선 기술, 강력한 호환성, 사용자 친화적인 디자인으로 문서 처리 및 정보 검색 분야에 혁신적인 변화를 가져왔습니다. 이는 작업 효율성을 향상시킬 뿐만 아니라 사용자에게 더욱 지능적이고 개인화된 경험을 제공합니다.

프로젝트 주소: https://github.com/junruxiong/IncarnaMind

IncarnaMind는 강력한 기능과 우수한 호환성으로 사용자에게 효율적이고 편리한 문서 처리 및 정보 검색 서비스를 제공하여 업무 효율성과 사용자 경험을 크게 향상시킵니다. 또한 오픈 소스 기능은 개발자에게 더 넓은 애플리케이션 공간을 제공합니다. 자세한 내용은 GitHub 프로젝트 주소를 방문해 주셔서 감사합니다.