Meta CEO인 Mark Zuckerberg는 SIGGRAPH 컨퍼런스에서 이미지 분할 모델을 대폭 업그레이드하고 AI 기반 분할 기술을 비디오 분야로 확장하는 Segment Anything 2(SA2)를 출시했습니다. Zuckerberg가 말했듯이 SA2의 오픈 소스 전략은 기술을 중심으로 강력한 생태계를 구축하여 모델 자체와 Meta의 다른 제품의 품질을 향상시키는 것을 목표로 합니다. 이는 개방형 AI 분야에 대한 메타의 지속적인 투자와 산업 발전에 대한 기여를 반영한 것입니다.

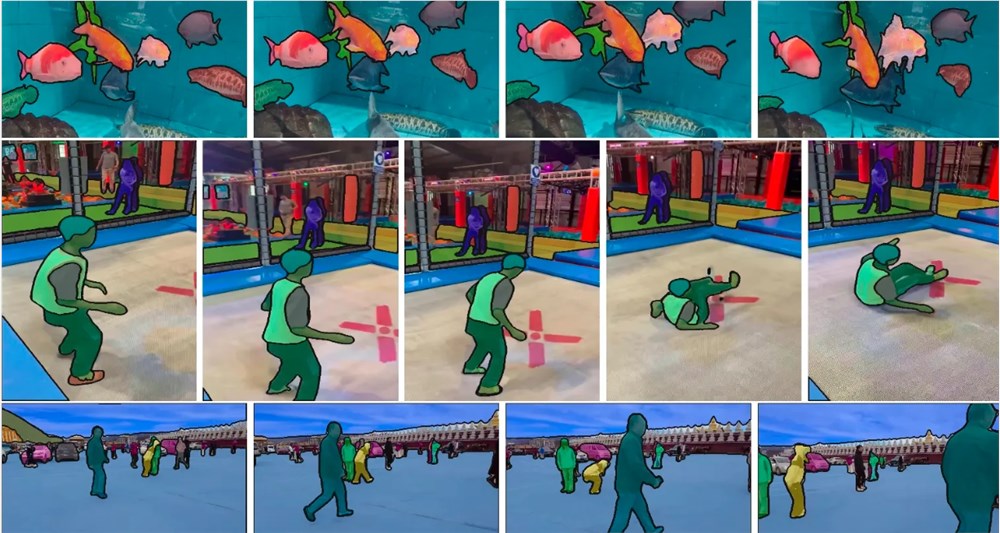

이번 주 SIGGRAPH 컨퍼런스에서 Meta CEO인 Mark Zuckerberg는 회사가 작년에 출시한 획기적인 이미지 분할 모델의 업그레이드 버전인 Segment Anything2(SA2)를 선보였습니다. 새로운 모델은 AI 기반 분할 기술을 비디오 영역으로 확장하여 지난 한 해 동안 이 기술이 이룩한 놀라운 발전을 보여줍니다.

Zuckerberg는 강연 중에 Meta가 오픈 소스 전략을 고수하는 이유를 다음과 같이 설명했습니다. 이는 단지 구축할 수 있는 소프트웨어가 아니라 주변 생태계가 필요하다는 것입니다. 우리가 소스를 공개하지 않았다면 거의 작동하지 않았을 것입니다. 그는 이 전략이 전체 생태계에 도움이 될 뿐만 아니라 Meta 자체 제품의 품질 향상에도 도움이 될 것이라고 인정했습니다.

SA2의 출시는 개방형 AI 분야에서 Meta의 리더십을 다시 한 번 보여줍니다. 개방성 정도는 여전히 논란의 여지가 있지만 LLaMa 및 Segment Anything과 같은 모델은 AI 성능에 대한 중요한 참조 표준이 되었습니다.

SA2 출시로 AI 영상 분석 기술은 과학 연구, 환경 모니터링 등 다양한 분야에서 더욱 큰 역할을 하게 될 것이다. 이러한 진전은 AI 기술의 급속한 발전을 보여줄 뿐만 아니라 미래 응용 분야에 대한 새로운 가능성을 열어줍니다.

SA2의 출시는 AI 영상 분석 기술의 새로운 이정표를 의미하며, SA2의 오픈 소스 전략은 AI 커뮤니티의 공동 발전을 위한 강력한 지원을 제공합니다. 앞으로 SA2는 더 많은 분야에서 강력한 응용 가능성을 입증하고 인공지능 기술의 지속적인 발전을 촉진할 것으로 기대됩니다.