인공 지능 생성 콘텐츠가 폭발적으로 증가함에 따라 소셜 미디어 플랫폼은 전례 없는 과제에 직면해 있습니다. 사용자가 진실 정보와 거짓 정보를 구별할 수 있도록 하려면 어떻게 해야 할까요? Instagram의 대표인 Adam Mosseri는 최근 Threads에 AI 생성 콘텐츠에 대한 우려를 표명하고 이 문제를 해결하기 위한 Instagram과 Meta의 전략을 제시하는 일련의 게시물을 게시했습니다. 그는 사용자가 더욱 경계하고 AI 생성 콘텐츠를 식별하는 방법을 배워야 한다고 강조했으며, 플랫폼이 콘텐츠 감독을 강화하고 정보의 투명성과 신뢰성을 향상할 것을 촉구했습니다.

최근 Threads 게시물 시리즈에서 Instagram의 Adam Mosseri 대표는 AI 생성 콘텐츠의 양이 증가함에 따라 소셜 미디어 사용자가 더욱 경계해야 한다고 강조했습니다.

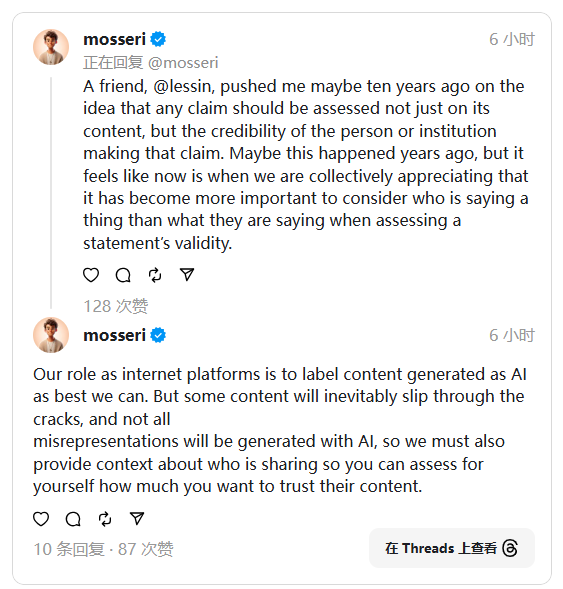

그는 AI 기술은 이미 현실과 매우 유사한 콘텐츠를 생성할 수 있기 때문에 사용자가 온라인에서 보는 이미지와 정보가 실제가 아닐 수도 있다고 지적했습니다. 사용자가 정보의 진위 여부를 더 잘 판단할 수 있도록 Mosseri는 사용자가 콘텐츠의 출처를 고려해야 하며 소셜 플랫폼도 이를 지원할 책임이 있다고 언급했습니다.

Mosseri는 소셜 미디어 플랫폼의 역할은 생성된 AI 콘텐츠에 사용자가 이를 식별할 수 있도록 최대한 라벨을 붙이는 것이라고 말했습니다. 하지만 일부 내용이 누락되어 제때 표시가 되지 않을 수도 있다는 점도 인정했습니다. 이를 위해 플랫폼 역시 공유 콘텐츠에 대한 사용자 배경 정보를 제공하여 사용자가 콘텐츠를 얼마나 신뢰할 수 있는지 더 잘 결정할 수 있어야 한다고 강조했습니다. 그의 견해는 소셜 미디어 메시지의 신뢰성에 대한 깊은 우려를 반영합니다.

현 단계에서 Meta(Instagram의 모회사)는 사용자가 콘텐츠의 진위 여부를 판단하는 데 도움이 되는 충분한 맥락 정보를 제공하지 않았습니다. 그럼에도 불구하고 회사는 최근 콘텐츠 규칙에 상당한 변화를 가져올 수 있음을 암시했습니다. 이러한 변화는 정보에 대한 사용자의 신뢰를 높이고 AI 기술로 인한 과제에 더 잘 대처하는 데 도움이 될 것으로 예상됩니다.

Mosseri는 사용자가 AI 기반 검색 엔진을 신뢰하기 전에 챗봇이 제공하는 정보가 신뢰할 수 있는지 확인해야 한다고 언급했습니다. 이는 게시 내용이나 이미지의 출처를 확인하는 것과 유사하며 평판이 좋은 계정에서 나온 정보만이 더 신뢰할 수 있습니다.

Mosseri가 설명하는 콘텐츠 조정에 대한 접근 방식은 Twitter의 커뮤니티 노트 및 YouTube의 콘텐츠 필터와 같은 사용자 중심 조정 시스템에 더 가깝습니다. Meta가 유사한 기능을 도입할지 여부는 불분명하지만 회사의 과거 다른 플랫폼에서 차용한 경험을 고려할 때 향후 콘텐츠 조정 정책을 주목할 가치가 있습니다.

전체적으로 AI 생성 콘텐츠가 가져오는 과제에 직면하여 Instagram과 Meta는 플랫폼 자체의 노력이 필요할 뿐만 아니라 사용자가 자신의 분별력을 향상하고 공동으로 유지해야 하는 솔루션을 적극적으로 모색하고 있습니다. 온라인 정보의 신뢰성과 보안. 미래의 콘텐츠 감독 모델이 어떻게 발전할지는 우리의 지속적인 관심을 받을 가치가 있습니다.