최근 몇 년 동안 LLM(Large Language Model)이 자연어 처리 분야에서 상당한 발전을 이루었지만, 토큰 수준 처리 방법은 상황 이해와 다중 언어 및 다중 모드 적용에 한계가 있습니다. Meta AI는 이를 위해 기존 LLM의 단점을 해결하기 위해 LCM(Large Concept Model)이라는 새로운 방법을 제안합니다. LCM은 고차원 임베딩 공간 SONAR에서 모델링함으로써 여러 언어와 양식을 지원하고 계층적 아키텍처를 채택하여 긴 콘텐츠의 일관성과 로컬 편집 기능을 향상시켜 모델의 효율성과 일반화 기능을 크게 향상시킵니다.

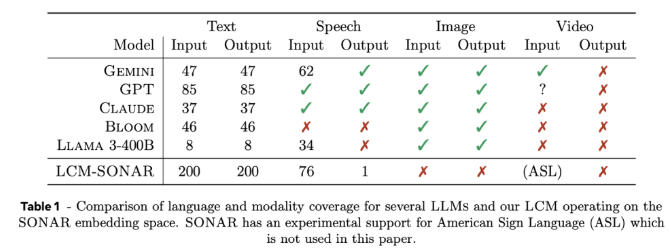

LCM(대형 개념 모델)은 기존 LLM 아키텍처에서 중요한 변화를 나타냅니다. 그들은 두 가지 주요 혁신을 소개합니다. 첫째, LCM은 개별 토큰에 의존하지 않고 고차원 임베딩 공간에서 모델을 만듭니다. SONAR라고 불리는 이 임베딩 공간은 200개 이상의 언어와 텍스트 및 음성을 포함한 다양한 양식을 지원하도록 설계되어 언어 및 양식에 독립적인 처리 기능을 제공합니다. 둘째, LCM 설계는 의미론적 수준에서 원활한 전환을 허용하여 다양한 언어와 양식에 걸쳐 강력한 제로샷 일반화 기능을 가능하게 합니다.

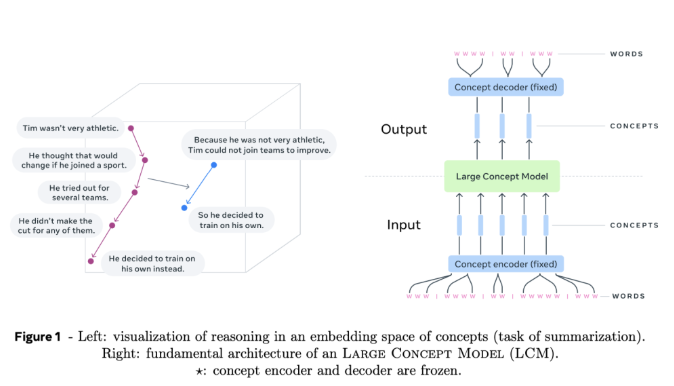

LCM의 핵심에는 입력 문장을 SONAR의 임베딩 공간에 매핑하고 임베딩을 다시 자연어 또는 기타 양식으로 디코딩하는 구성 요소인 개념 인코더와 디코더가 있습니다. 이러한 구성요소의 고정 설계는 모듈성을 보장하므로 전체 모델을 재교육하지 않고도 새로운 언어나 양식을 쉽게 확장할 수 있습니다.

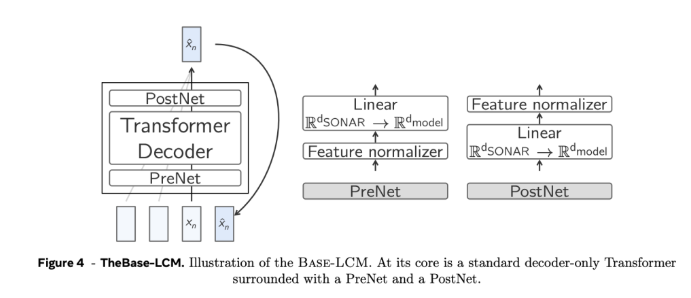

기술적 세부 사항 측면에서 LCM은 인간의 추론 프로세스를 모방하는 계층적 아키텍처를 채택하여 긴 형식 콘텐츠의 일관성을 향상시키는 동시에 전체 맥락을 방해하지 않고 로컬 편집을 가능하게 합니다. LCM은 이전 임베딩을 기반으로 다음 SONAR 임베딩을 예측하는 확산 모델을 사용하여 생성 프로세스에서 탁월합니다. 실험에서는 싱글 타워와 듀얼 타워의 두 가지 아키텍처를 사용했습니다. 듀얼 타워 아키텍처는 컨텍스트 인코딩과 잡음 제거를 별도로 처리하여 효율성을 향상시켰습니다.

실험 결과에 따르면 확산 기반 2타워 LCM은 여러 작업에서 경쟁력을 보여줍니다. 예를 들어 다국어 요약 작업에서 LCM은 제로샷 사례에서 기준 모델보다 성능이 뛰어나 적응성을 보여줍니다. 동시에, LCM은 더 짧은 시퀀스를 처리할 때 높은 효율성과 정확성을 보여주며, 이는 관련 측정 항목의 상당한 개선으로 확인됩니다.

Meta AI의 대규모 개념 모델은 전통적인 토큰 수준 언어 모델에 대한 유망한 대안을 제공하여 고차원 개념 임베딩 및 양식 독립적 처리를 통해 기존 방법의 주요 한계 중 일부를 해결합니다. 이 아키텍처에 대한 연구가 심화됨에 따라 LCM은 언어 모델의 기능을 재정의하고 AI 기반 통신에 보다 확장 가능하고 적응 가능한 접근 방식을 제공할 것으로 예상됩니다.

프로젝트 입구: https://github.com/facebookresearch/large_concept_model

전체적으로 Meta AI가 제안하는 LCM 모델은 기존 LLM의 한계를 해결하는 혁신적인 솔루션을 제공합니다. 다국어, 다중 모달 처리 및 효율적인 아키텍처 설계의 장점은 자연어 분야에서 큰 미래를 열어줍니다. 이는 엄청난 잠재력을 갖고 있으며 지속적인 관심과 심층적인 연구가 필요합니다.