LLM(대형 언어 모델)의 아키텍처 설계는 엄청난 변화를 겪고 있으며 Transformer 아키텍처의 지배력은 도전에 직면해 있습니다. 이러한 문제를 해결하기 위해 MIT에서 창업한 스타트업인 Liquid AI는 AI 모델 아키텍처를 자동으로 생성하고 최적화하는 것을 목표로 하는 STAR(Synesis of Tailored Architectures)라는 혁신적인 프레임워크를 출시했습니다. STAR 프레임워크는 진화 알고리즘과 계층적 코딩 기술을 사용하여 특정 성능 및 하드웨어 요구 사항을 기반으로 모델 아키텍처를 합성하고 최적화하여 효율성과 성능 모두에서 상당한 이점을 보여줍니다.

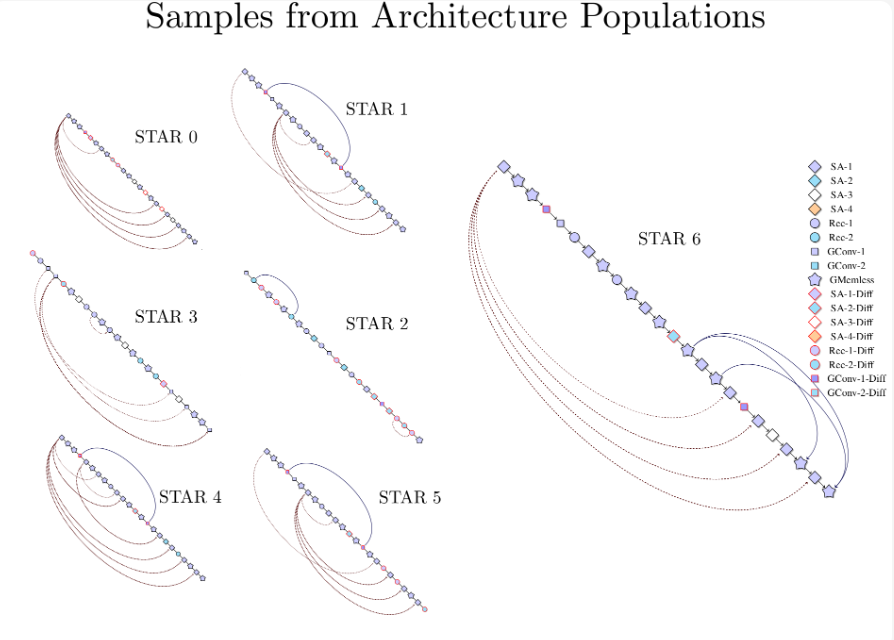

STAR 프레임워크는 진화 알고리즘과 수치 코딩 시스템을 활용하여 인공 지능 모델 아키텍처의 생성 및 최적화를 자동화합니다. Liquid AI 연구팀은 STAR의 설계 접근 방식이 잠재적 아키텍처의 광범위한 설계 공간을 탐색하기 위해 "STAR Genome"이라는 계층적 코딩 기술을 사용한다는 점에서 기존 아키텍처 설계와 다르다는 점에 주목했습니다. 게놈 조합 및 돌연변이를 통해 STAR는 특정 성능 및 하드웨어 요구 사항을 충족하는 아키텍처를 합성하고 최적화할 수 있습니다.

자동 회귀 언어 모델링을 대상으로 한 테스트에서 STAR는 기존의 최적화된 Transformer++ 및 하이브리드 모델보다 뛰어난 성능을 보여주었습니다. 최적화 품질과 캐시 크기 측면에서 STAR의 진화된 아키텍처는 하이브리드 모델에 비해 캐시 크기를 최대 37% 줄이고, 기존 Transformer에 비해 90% 감소를 달성합니다. 이러한 효율성으로 인해 모델의 예측 성능이 저하되지는 않지만 경우에 따라 경쟁사보다 뛰어난 성능을 발휘합니다.

또한 연구에 따르면 STAR의 아키텍처는 1억 2,500만 개의 매개변수에서 10억 개의 매개변수로 확장되는 STAR 진화 모델을 통해 확장성이 뛰어나며 표준 벤치마크에서 기존 Transformer++ 및 하이브리드 모델보다 더 나은 성능을 발휘하는 동시에 캐싱 요구 사항에 대한 추론을 크게 줄입니다.

Liquid AI는 STAR의 설계 개념이 동적 시스템, 신호 처리 및 수치 선형 대수학의 원리를 통합하여 유연한 컴퓨팅 장치 검색 공간을 구축한다고 말했습니다. STAR의 고유한 기능은 모듈식 설계로, 이를 통해 여러 수준에서 아키텍처를 인코딩하고 최적화할 수 있으며, 연구자에게 아키텍처 구성 요소의 효과적인 조합에 대한 통찰력을 얻을 수 있는 기회를 제공합니다.

Liquid AI는 STAR의 효율적인 아키텍처 합성 기능이 다양한 분야, 특히 품질과 컴퓨팅 효율성의 균형이 필요한 시나리오에 적용될 것이라고 믿습니다. Liquid AI는 구체적인 상용 배포 또는 가격 계획을 발표하지 않았지만 연구 결과는 자동화된 아키텍처 설계 분야에서 큰 발전을 이루었습니다. AI 분야가 계속 발전함에 따라 STAR와 같은 프레임워크는 차세대 지능형 시스템을 형성하는 데 중요한 역할을 할 수 있습니다.

공식 블로그: https://www.liquid.ai/research/automated-architecture-synesis-via-targeted-evolution

전체적으로 Liquid AI의 STAR 프레임워크는 AI 모델 아키텍처 설계를 위한 새로운 자동화 방법을 제공하며 효율성과 성능의 획기적인 발전은 매우 중요하며 미래 AI 시스템 개발을 위한 새로운 가능성을 제공합니다. 또한 프레임워크의 모듈식 설계와 확장성은 다양한 분야에서 광범위한 응용 가능성을 제공합니다.