Zhipu AI는 GLM-4V-9B 교육을 기반으로 CogAgent-9B 모델을 오픈 소스화했습니다. 이는 스크린샷을 통해 사용자 지침을 이해하고 다음 GUI 작업을 예측할 수 있는 에이전트 작업 모델입니다. 이 모델은 보편성이 강하며 개인용 컴퓨터, 휴대폰, 자동차 등 다양한 GUI 상호 작용 시나리오에 적합합니다. 이전 버전에 비해 CogAgent-9B-20241220은 여러 측면에서 크게 개선되었으며 중국어와 영어 이중 언어를 지원하고 상세한 사고 과정, 행동 설명 및 민감도 판단을 출력할 수 있습니다. 여러 데이터 세트에서 선도적인 결과를 얻었으며 GUI 포지셔닝, 단일 단계 및 다단계 작업에서 장점을 입증했습니다. 오픈 소스 CogAgent-9B는 대형 모델 기술 개발을 촉진할 뿐만 아니라 시각 장애인을 위한 새로운 가능성을 제공합니다.

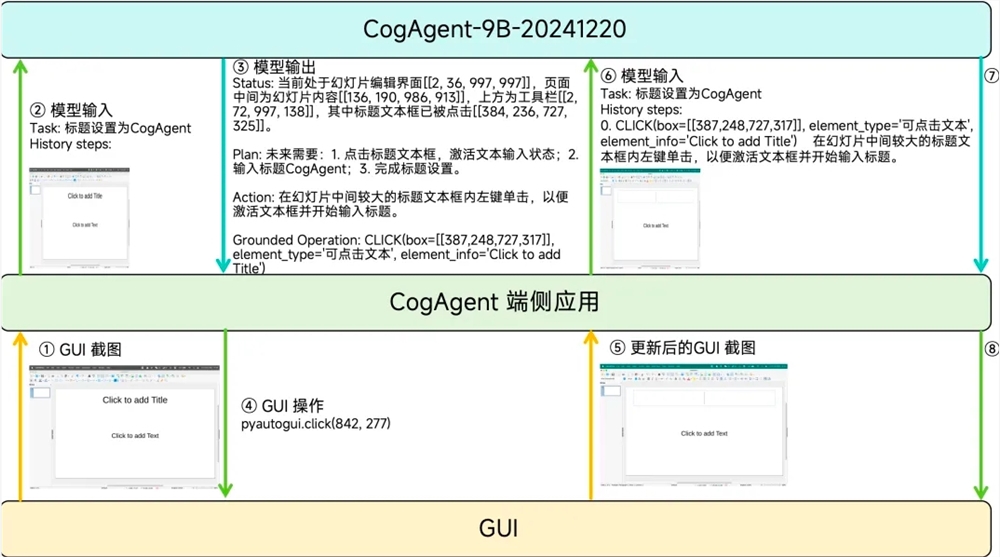

2023년 12월 오픈 소스로 공개된 CogAgent 모델의 첫 번째 버전과 비교하면 CogAgent-9B-20241220은 GUI 인식, 추론 예측 정확도, 작업 공간 완성도, 작업 보편성 및 일반화 측면에서 크게 향상되었으며 이중 언어 스크린샷 및 언어를 지원합니다. 중국어와 영어로 상호 작용. CogAgent의 입력에는 레이아웃 정보나 추가 요소 레이블 정보의 텍스트 표현 없이 사용자의 자연어 명령, 실행된 기록 작업 기록 및 GUI 스크린샷만 포함됩니다. 출력에는 사고 과정, 다음 동작에 대한 자연어 설명, 다음 동작에 대한 구조화된 설명, 다음 동작에 대한 민감도 판단이 포함됩니다.

성능 테스트에서 CogAgent-9B-20241220은 여러 데이터 세트에서 최고의 결과를 달성하여 GUI 포지셔닝, 단일 단계 작업, 중국어 단계 목록 및 다단계 작업에서 장점을 입증했습니다. Smart Spectrum Technology의 이러한 움직임은 대형 모델 기술의 개발을 촉진할 뿐만 아니라 시각 장애가 있는 IT 실무자에게 새로운 도구와 가능성을 제공합니다.

암호:

https://github.com/THUDM/CogAgent

모델:

허깅페이스: https://huggingface.co/THUDM/cogagent-9b-20241220

Cogagent 커뮤니티: https://modelscope.cn/models/ZhipuAI/cogagent-9b-20241220

CogAgent-9B의 오픈 소스는 대형 모델 에이전트 생태계에서 중요한 단계를 나타냅니다. 효율적인 GUI 상호 작용 기능과 폭넓은 적용 가능성은 지능형 상호 작용 기술의 미래 개발을 위한 새로운 방향을 제시하며, 더욱 편리하고 스마트한 미래 응용 시나리오의 도래를 예고합니다. CogAgent-9B를 기반으로 한 더욱 혁신적인 애플리케이션을 기대합니다.