북경대학교는 Kuaishou AI 팀과 협력하여 VideoTetris라는 새로운 비디오 생성 프레임워크를 개발했습니다. 이는 복잡한 비디오 생성 문제를 성공적으로 해결했으며 그 성능은 Pika 및 Gen-2와 같은 상용 모델을 능가했습니다. 이 프레임워크는 결합된 비디오 생성 작업을 혁신적으로 정의하고, 복잡한 지침에 따라 비디오를 정확하게 생성할 수 있으며, 긴 비디오 생성 및 점진적인 다중 개체 지침을 지원하여 여러 개의 정확한 위치를 찾는 등 복잡한 지침 및 세부 사항을 처리할 때 기존 모델의 단점을 효과적으로 해결합니다. 객체의 특징적인 세부 사항을 유지합니다.

6월 17일 ChinaZ.com 소식: 북경대학교와 Kuaishou AI 팀이 협력하여 복잡한 비디오 생성 문제를 성공적으로 극복했습니다. 그들은 퍼즐과 같은 다양한 세부 사항을 쉽게 결합하여 난이도가 높고 복잡한 지침이 포함된 비디오를 생성할 수 있는 VideoTetris라는 새로운 프레임워크를 제안했습니다. 이 프레임워크는 복잡한 비디오 생성 작업에서 Pika 및 Gen-2와 같은 상용 모델을 능가합니다.

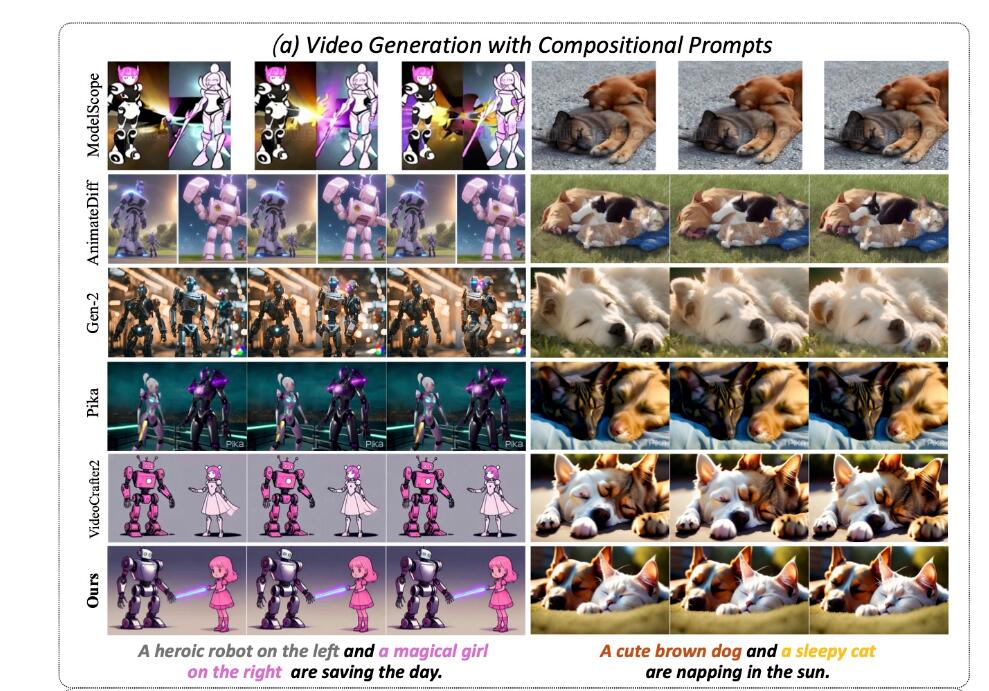

VideoTetris 프레임워크는 두 가지 하위 작업을 포함하여 처음으로 결합된 비디오 생성 작업을 정의합니다. 1) 복잡한 조합 지침에 따른 비디오 생성 2) 점진적인 결합 다중 개체 명령에 따른 긴 비디오 생성. 팀은 거의 모든 기존 오픈 소스 및 상용 모델이 올바른 비디오를 생성하지 못하는 것을 발견했습니다. 예를 들어, "왼쪽은 귀여운 갈색 개, 오른쪽은 햇빛 아래에서 낮잠을 자는 고양이"를 입력하면 결과 영상에서 두 개체에 대한 정보가 융합되어 이상하게 보이는 경우가 많습니다.

대조적으로 VideoTetris는 모든 위치 정보와 세부 기능을 성공적으로 유지합니다. 긴 영상 생성에서는 "헤이즐넛 더미 위의 귀여운 갈색 다람쥐에서 헤이즐넛 더미 위의 귀여운 갈색 다람쥐와 귀여운 흰 다람쥐로 전환"과 같은 더 복잡한 지시를 지원합니다. 생성된 영상의 순서는 입력 명령과 일치하며, 두 다람쥐는 자연스럽게 먹이를 교환할 수 있습니다.

VideoTetris 프레임워크는 시공간 결합 확산 방식을 채택합니다. 먼저 시간에 따라 텍스트 프롬프트를 분해하고 다양한 비디오 프레임에 다양한 프롬프트 정보를 할당합니다. 그런 다음 각 프레임에서 공간 차원을 분해하여 다양한 객체를 다양한 비디오 영역에 매핑합니다. 마지막으로 시공간 교차주의를 통해 효율적인 조합 명령 생성이 달성됩니다.

또한, 고품질의 장편 영상을 생성하기 위해, 연구팀은 장편 영상을 보다 역동적이고 안정적으로 생성할 수 있는 향상된 훈련 데이터 전처리 방법을 제안했습니다. 또한, 참조 프레임 주의 메커니즘을 도입하고 이전 프레임 정보를 네이티브 VAE를 사용하여 인코딩하는데, 이는 CLIP 인코딩을 사용하는 다른 모델과 달리 더 나은 콘텐츠 일관성을 달성합니다.

최적화의 결과로 긴 비디오에 더 이상 넓은 영역의 색상 경향성이 없고 복잡한 지침에 더 잘 적응할 수 있으며 생성된 비디오가 더 역동적이고 자연스러워졌습니다. 또한, 새로운 평가지표인 VBLIP-VQA와 VUnidet을 도입해 결합세대 평가 방식을 영상 차원으로 최초로 확장했다.

실험 테스트에 따르면 결합된 비디오 생성 기능 측면에서 VideoTetris 모델은 모든 오픈 소스 모델, 심지어 Gen-2 및 Pika와 같은 상용 모델보다 성능이 뛰어납니다. 코드는 완전히 오픈소스로 공개될 것으로 알려졌다.

프로젝트 주소: https://top.aibase.com/tool/videotetris

전체적으로 VideoTetris 프레임워크는 복잡한 비디오 생성 분야에서 획기적인 발전을 이루었으며, 효율적인 시공간 결합 확산 방법과 혁신적인 평가 지표는 미래 비디오 생성 기술 개발에 새로운 방향을 제시합니다. 또한 이 프로젝트의 오픈 소스는 더 많은 연구자들에게 귀중한 리소스를 제공하고 이 분야의 추가 개발을 촉진합니다. 우리는 VideoTetris가 앞으로 더 많은 응용 시나리오에서 역할을 할 수 있기를 기대합니다.