홍콩중문대학교 및 중국과학원과 같은 기관의 연구팀은 최근 MiCo라는 완전 모드 사전 훈련 패러다임을 출시했습니다. 이는 다중 모드 학습 분야에서 획기적인 발전을 이루었고 37가지 상태를 새롭게 했습니다. -SOTA(예술공연) 기록. MiCo는 모든 양식을 이해하고 보편적인 표현을 학습할 수 있는 완전 모드 지능을 구축하고, 더 많은 양식, 데이터 볼륨 및 모델 매개변수를 도입하여 인간 두뇌의 다중 모드 인지 과정을 시뮬레이션하는 것을 목표로 합니다. 핵심은 다양한 모드를 "지식 모드"와 "인터페이스 모드"로 나누고, 다중 모드 컨텍스트를 사용하여 모드 간의 상호 강화를 강화하고, 모드 간 컨텍스트 관계를 구축하는 해당 전체 모드 학습 아키텍처를 설계하는 것입니다. 이번 연구 결과는 인공지능 분야의 발전을 위한 새로운 방향과 아이디어를 제시한다.

6월 17일 ChinaZ.com의 뉴스: 홍콩 중문대학교, 중국과학원 및 기타 기관의 연구팀은 MiCo(Multimodal Context)라는 완전 모달 사전 훈련 패러다임을 제안했습니다. 이 방법은 놀라운 결과를 가져왔습니다. 다중 모드 학습 분야에서 37개의 SOTA(최첨단 성능) 기록을 세웠습니다.

핵심 기능:

전체 모드 이해: MiCo는 모든 양식을 이해하고 보편적인 표현을 학습할 수 있는 전체 모드 지능을 구축하는 것을 목표로 합니다.

대규모 사전 훈련: MiCo는 더 많은 양식, 데이터 볼륨 및 모델 매개변수를 도입하여 사전 훈련 과정에서 인간 두뇌의 다중 모드 인지 과정을 시뮬레이션합니다.

신경망 구조 설계: MiCo는 다양한 모드를 "지식 모드"와 "인터페이스 모드"로 나누고 생성 추론 방법을 통해 정렬되는 해당 전체 모드 학습 아키텍처를 설계합니다.

다중 모드 컨텍스트 및 확장 법칙: MiCo는 다중 모드 컨텍스트를 사용하여 양식 간의 상호 강화를 강화하고 교차 모드 컨텍스트 관계를 구축합니다.

실험 결과는 다음과 같습니다.

10가지 모드에 대한 단일 모드 인식 벤치마크 테스트에서 MiCo는 7개의 SOTA 결과를 달성했습니다.

검색, 질문 및 답변, 설명 등을 포함한 25개의 교차 모드 이해 작업에서 MiCo는 20개의 SOTA 결과를 달성했습니다.

18개의 다중 모드 대규모 언어 모델 벤치마크 테스트에서 MiCo는 총 10개의 SOTA 결과를 달성했습니다.

MiCo의 사전 훈련 방법:

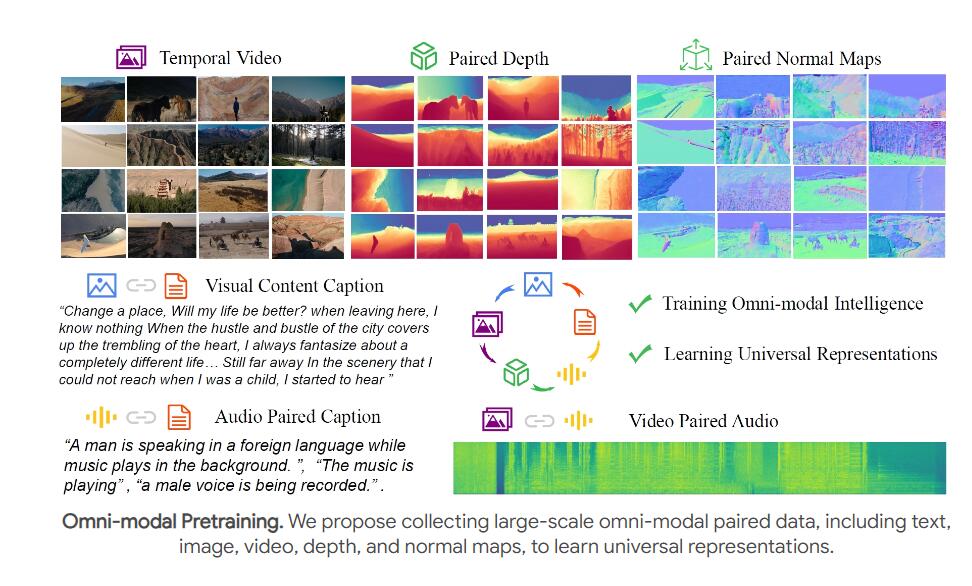

팀은 인간 두뇌의 시각, 청각 및 시공간 인식 기능을 시뮬레이션하기 위해 공동 사전 훈련을 위해 비디오와 페어링된 오디오, 텍스트 설명, 깊이 및 법선을 사용했습니다.

다중 모드 컨텍스트 관계는 모든 모드 인코더(예: ViT)를 사용하여 다중 모드 특징을 추출하고 텍스트 인코더를 사용하여 텍스트 특징을 추출하여 구성됩니다.

결론 및 향후 작업:

MiCo 프로젝트는 인간 두뇌의 다중 모드 인식을 시뮬레이션하려는 인공 지능의 중요한 시도입니다. 팀은 이것이 향후 연구에 영감을 주고 보다 강력한 전체 모드 기본 모델을 개발할 것으로 기대합니다.

향후 작업 계획에는 광학 흐름, IMU 데이터 및 이벤트 파일과 같은 더 많은 양식을 결합하여 전체 모드 공동 사전 훈련을 지속적으로 향상시키는 것이 포함됩니다.

MiCo의 뛰어난 성능은 다중 모드 학습 분야에서 새로운 기준을 세웠습니다. MiCo의 향후 개발 잠재력은 엄청나며 지속적인 관심을 받을 가치가 있습니다. 팀의 앞으로의 연구 방향도 기대해볼 만하고, 앞으로도 미코가 인공지능 기술의 발전을 도모해 나갈 것이라 믿습니다.