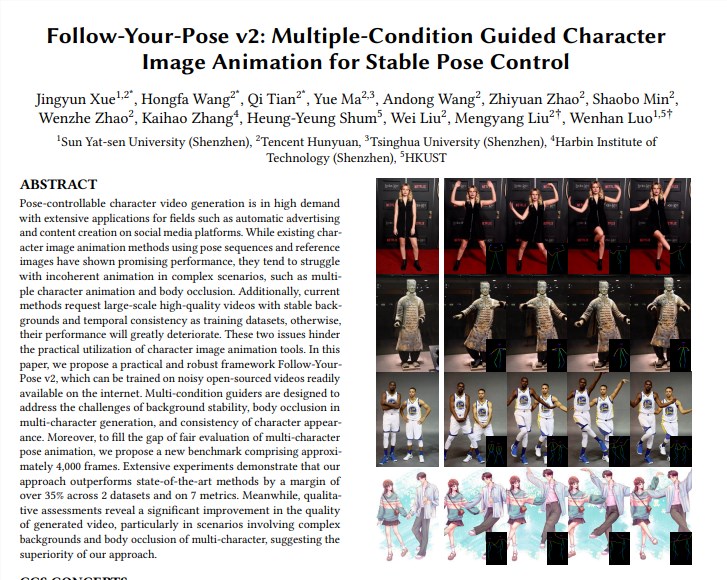

Tencent Hunyuan 팀은 Sun Yat-sen University 및 Hong Kong University of Science and Technology와 협력하여 새로운 Tusheng 비디오 모델 "Follow-Your-Pose-v2"를 출시하여 1인에서 다인에 이르기까지 비디오 생성 기술의 획기적인 발전을 이루었습니다. 이 모델은 여러 사람의 단체 사진을 처리하고 생성된 영상에서 사진 속 사람들을 동시에 움직이게 하여 영상 생성의 효율성과 품질을 크게 향상시킬 수 있습니다. 기술의 하이라이트는 다중 사용자 비디오 액션 생성을 지원하고 강력한 일반화 기능을 갖추고 있으며 일상 사진/비디오를 사용하여 훈련 및 생성이 가능하고 캐릭터 폐색과 같은 문제를 올바르게 처리할 수 있다는 것입니다. 이 모델은 여러 데이터 세트에서 기존 기술을 능가하여 강력한 성능과 광범위한 응용 가능성을 보여줍니다.

다중 사용자 비디오 액션 생성 지원: 더 적은 시간이 소요되는 추론으로 다중 사용자 비디오 액션 생성을 실현합니다.

강력한 일반화 능력: 나이, 의복, 인종, 배경의 복잡함, 동작의 복잡성에 관계없이 고품질 비디오를 생성할 수 있습니다.

일상 사진/동영상 이용 가능: 모델 훈련 및 생성 시 고화질 사진/동영상을 찾지 않고도 일상 사진(스냅샷 포함) 또는 동영상을 사용할 수 있습니다.

문자 폐색을 올바르게 처리합니다. 단일 그림에서 여러 캐릭터의 신체가 서로를 막는 문제에 직면하면 올바른 앞뒤 관계로 폐색 그림을 생성할 수 있습니다.

기술 구현:

모델은 "광학 흐름 가이드"를 사용하여 배경 광학 흐름 정보를 도입함으로써 카메라가 흔들리거나 배경이 불안정한 경우에도 안정적인 배경 애니메이션을 생성할 수 있습니다.

"추론 맵 가이드" 및 "깊이 맵 가이드"를 통해 모델은 그림 속 캐릭터의 공간 정보와 여러 캐릭터의 공간 위치 관계를 더 잘 이해할 수 있으며 다중 캐릭터 애니메이션 및 신체 폐색 문제를 효과적으로 해결할 수 있습니다. .

평가 및 비교:

연구팀은 다자 생성 효과를 평가하기 위해 약 4,000프레임의 다자 영상을 포함하는 새로운 벤치마크 Multi-Character를 제안했다.

실험 결과에 따르면 "Follow-Your-Pose-v2"는 2개의 공개 데이터 세트(TikTok 및 TED 연설)와 7개의 지표에서 최첨단 기술보다 35% 이상 뛰어난 성능을 보였습니다.

응용 전망:

이미지-비디오 생성 기술은 영화 콘텐츠 제작, 증강현실, 게임 제작, 광고 등 다양한 산업 분야에서 폭넓은 활용 가능성을 갖고 있으며, 2024년에도 많은 주목을 받을 AI 기술 중 하나이다.

추가 정보:

Tencent의 Hunyuan 팀은 또한 추론 효율성을 크게 향상시키고 그래프 생성 시간을 75% 단축하는 Vincentian 그래프의 대규모 오픈 소스 모델(Hunyuan DiT)용 가속 라이브러리를 발표했습니다.

Hunyuan DiT 모델 사용에 대한 임계값이 낮아졌습니다. 사용자는 세 줄의 코드로 Hugging Face의 공식 모델 라이브러리에서 모델을 호출할 수 있습니다.

논문 주소: https://arxiv.org/pdf/2406.03035

프로젝트 페이지: https://top.aibase.com/tool/follow-your-pose

"Follow-Your-Pose-v2" 모델의 출현은 Tusheng의 비디오 기술에 있어 획기적인 발전을 의미하며, 다양한 분야에서의 적용 가능성은 기대할만한 가치가 있습니다. 미래에는 기술의 지속적인 개발과 개선을 통해 이 모델이 더 많은 시나리오에서 중요한 역할을 하고 사람들에게 더욱 편리하고 지능적인 비디오 생성 경험을 제공할 것이라고 믿습니다.