연말에 Beijing Zhipu Huazhang Technology Co., Ltd.는 확장 강화 학습 기술을 기반으로 훈련된 최초의 추론 모델인 GLM-Zero-Preview의 첫 번째 버전인 GLM-Zero를 출시했습니다. 이 모델은 수학적 논리, 코드 작성 및 복잡한 문제 추론 분야에서 탁월한 기능을 입증했으며 여러 권위 있는 평가에서 유사한 OpenAI 모델과 비교할 수 있는 결과를 달성했습니다. GLM-Zero-Preview는 전문가 업무 능력 향상은 물론, 일반 업무에서도 우수한 성능을 유지하며 인공지능 추론 능력 향상의 새로운 기준을 제시합니다.

베이징 Zhipu Huazhang Technology Co., Ltd.는 연말에 확장 강화 학습 기술을 기반으로 훈련된 첫 번째 추론 모델인 GLM-Zero의 첫 번째 버전인 GLM-Zero-Preview를 출시했습니다. 이 모델은 특히 깊은 추론이 필요한 수학적 논리, 코드 작성, 복잡한 문제 처리 분야에서 인공지능의 추론 능력을 향상시키는 데 중점을 둡니다. 기본 모델과 비교하여 GLM-Zero-Preview는 일반 작업 기능을 유지하면서 전문가 작업 기능을 크게 향상시켰으며 AIME2024, MATH500 및 LiveCodeBench 평가의 성능은 OpenAI o1-preview와 동일합니다.

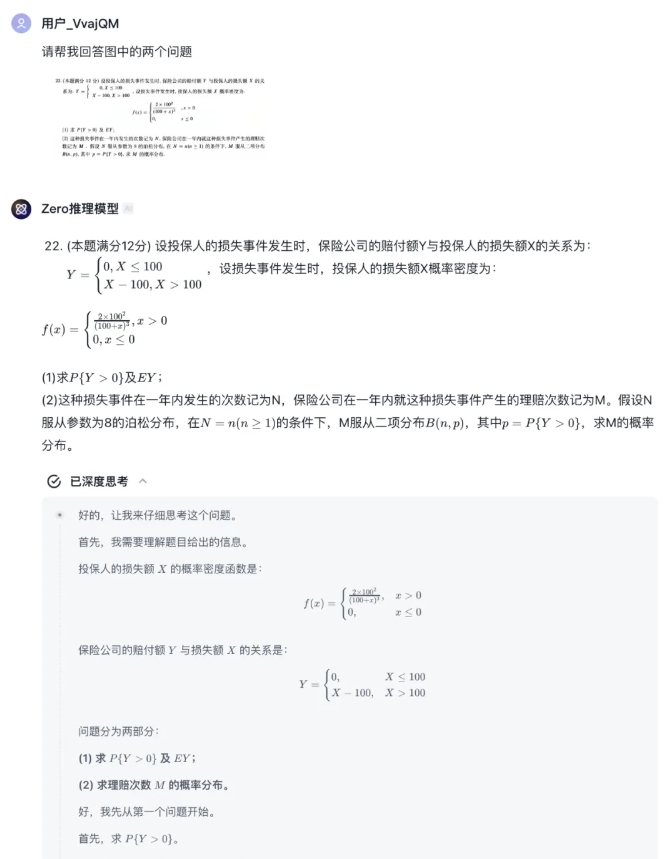

이제 사용자는 Zhipu Qingyan 플랫폼의 "Zero Inference Model" 에이전트에서 GLM-Zero-Preview를 무료로 경험할 수 있습니다. 플랫폼은 텍스트 및 이미지 업로드를 지원하며 모델은 전체 추론 프로세스를 출력합니다. 동시에 개발자는 Zhipu 개방형 플랫폼의 API를 통해 이 모델을 호출할 수도 있습니다.

GLM-Zero-Preview와 OpenAI의 o3 모델 사이에는 여전히 일정한 차이가 있지만 Zhipu Huazhang Technology Co., Ltd.는 반복 강화 학습 기술을 계속 최적화할 계획이며 곧 GLM-Zero의 공식 버전을 출시하여 기능을 확장할 예정입니다. 수학적 논리부터 좀 더 일반적인 기술 영역까지 깊이 있는 사고를 펼칩니다.

모델 성능 측면에서 GLM-Zero-Preview는 모델의 심층 추론 기능을 향상시키는 데 있어 강화 학습의 중요성을 보여줍니다. 훈련량이 증가함에 따라 심층 추론과 같은 측면에서 모델의 성능이 꾸준히 향상되었습니다. 추론 단계에서 모델의 스케일링 법칙도 검증되었습니다. 즉, 모델이 생각할 수 있는 토큰의 수가 증가하고 더 많은 계산이 필요할수록 모델이 제공하는 결과의 품질도 꾸준히 향상됩니다. GLM-Zero-Preview는 인간의 사고 및 의사 결정 과정과 유사한 추론 과정에서 자율적인 의사 결정, 문제 분해 및 문제 해결을 위한 다양한 방법을 시도할 수 있습니다.

실제 테스트 사례에서 GLM-Zero-Preview는 논리적 허점을 식별하고 논리적 추론 측면에서 여러 가정을 시뮬레이션하는 능력을 보여주었습니다. 수학 측면에서 이 모델은 강력한 귀납적 및 연역적 능력을 갖추고 복잡한 수학 연산을 신속하게 처리할 수 있으며 2025년 대학원 수학 I 시험에서 뛰어난 대학원생 수준에 도달했습니다. 프로그래밍 측면에서 GLM-Zero-Preview는 여러 프로그래밍 언어를 능숙하게 사용할 수 있으며 개발자가 코드를 빠르게 작성할 수 있도록 도와줍니다.

지혜 스펙트럼 명확한 단어:

https://chatglm.cn/main/gdetail/676411c38945bbc58a905d31?lang=zh

Zhipu 개방형 플랫폼:

https://bigmodel.cn/dev/api/normal-model/glm-zero-preview

GLM-Zero-Preview의 출시는 Zhipu Huazhang가 인공 지능 추론 분야에서 상당한 진전을 이뤘음을 의미합니다. 또한 무료 개방형 전략은 개발자와 사용자의 경험과 피드백을 촉진하여 미래 모델의 반복 최적화를 위한 귀중한 데이터를 제공합니다. 인공지능 기술의 발전을 더욱 촉진하기 위한 GLM-Zero 정식 버전의 출시를 기대합니다.