Alibaba Motor Hospital은 전자 상거래 장소를 기반으로 한 멀티 모드 대규모 언어 모델 인 Valley2를 발표했습니다 짧은 비디오의. Valley2의 데이터 세트는 OneVision 스타일 데이터, E- 컴퓨터 및 짧은 비디오 데이터 및 체인 사고 데이터를 다 여러 단계로 다루었습니다. 본질 아키텍처 설계 및 교육 전략의 최적화는 멀티 모드 및 대형 모델의 성능 향상을위한 새로운 아이디어를 제공합니다.

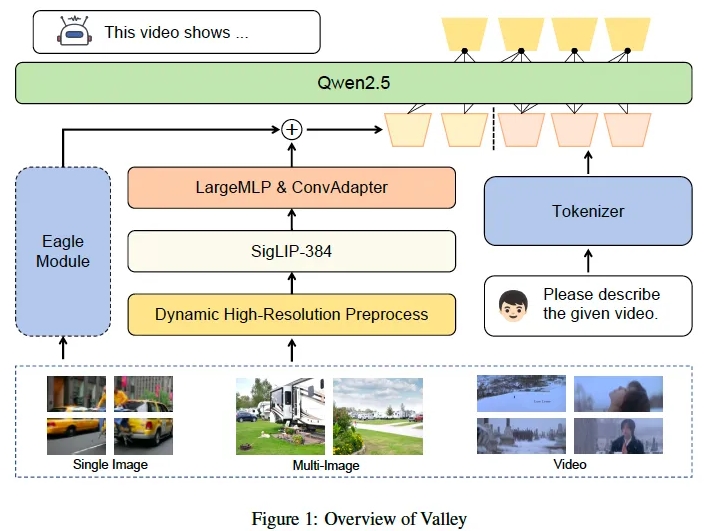

Alibaba Bardham Courtyard는 최근 Valley2라는 다중 모드 대규모 언어 모델을 시작했습니다. 언어 아키텍처. 비디오 장면의 경계. Valley2는 QWEN2.5를 LLM 트렁크로 사용하고 Siglip-384 Visual Encoder와 함께 MLP 층과 결합하여 효율적인 기능 변환을 위해 컨볼 루션을 사용합니다. 그것의 혁신은 다양한 시각적 어휘, Convadapter 및 Eagle 모듈을 도입하여 다양한 실제 -월드 입력 처리의 유연성 및 교육 및 추론 효율성을 향상 시킨다는 것입니다.

Valley2의 데이터는 OneVision 스타일 데이터, E- 컴퓨터 분야의 데이터 및 짧은 비디오 및 복잡한 문제에 대한 체인 사고 (COT) 데이터로 구성됩니다. 교육 과정은 텍스트 시각 정렬, 고품질 지식 학습, 미세 조정 지침 및 체인 사고의 네 단계로 나뉩니다. 실험에서 Valley2는 여러 공개 벤치 마크 테스트, 특히 Mubench, Mmstar, Mathvista 및 기타 벤치 마크에서 잘 수행되었으며 ECOM-VQA 벤치 마크 테스트에서 다른 동일한 규모 모델을 능가했습니다.

앞으로 Alibaba Bardham Academy는 텍스트, 이미지, 비디오 및 오디오 모듈러스를 포함한 모든 원형 모델을 출시 할 계획이며, 다운 스트림 검색 및 탐지 애플리케이션을 지원하기 위해 Valley를 기반으로 한 멀티 모더 내장 교육 방법을 도입 할 계획입니다.

Valley2의 출시는 멀티 모달 대형 스케일 언어 모델 분야에서 중요한 진보를 표시하여 구조적 개선, 데이터 세트 구성 및 교육 전략 최적화를 통해 모델 성능을 향상시킬 가능성을 보여줍니다.

모델 링크 :

https://www.modelscope.cn/models/bytedance-research/valley-eagle-7b

코드 링크 :

https://github.com/bytedance/valley

논문 링크 :

https://arxiv.org/abs/2501.05901

Valley2의 출시는 멀티 모드 및 대형 모델 분야에서 Alibaba Padamine의 고급 기술을 보여줄뿐만 아니라 미래의 E- 컴퓨터 및 짧은 비디오 필드가 AI 기반 혁신 애플리케이션을보다 강요 할 것임을 나타냅니다. Future Valley2를 기대하면 응용 프로그램 시나리오를 더욱 향상시키고 확장하여 사용자가보다 편리하고 똑똑한 서비스를 제공 할 수 있습니다.