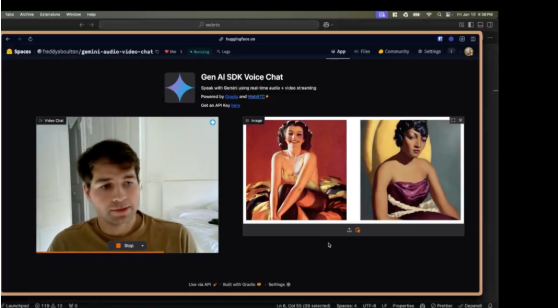

Google Gemini AI는 최근 인공지능 분야 최초로 실험용 애플리케이션인 AnyChat을 통해 여러 시각적 스트림을 동시에 처리하는 놀라운 능력을 보여주었습니다. AnyChat을 사용하면 Gemini AI가 실시간 비디오와 정적 이미지를 동시에 처리할 수 있어 기존 AI가 단일 시각적 입력만 처리할 수 있었던 한계를 깨고 여러 분야에 인공 지능을 적용할 수 있는 새로운 가능성이 열렸습니다. 이 기술은 사용자 경험을 향상시킬 수 있을 뿐만 아니라 더 중요한 것은 개발자가 더욱 강력한 시각적 AI 애플리케이션을 구축하는 데 도움이 되는 새로운 도구를 제공한다는 것입니다.

Google의 Gemini AI는 최근 여러 시각적 스트림을 동시에 처리할 수 있는 인상적인 기술적 혁신을 달성했는데, 이는 인공 지능 분야에서 전례 없는 성과입니다. 이 기능의 데뷔는 Google의 주류 플랫폼이 아니라 "AnyChat"이라는 실험적인 애플리케이션을 통해 이루어졌습니다.

Gemini AI의 이 새로운 기능을 통해 실시간으로 비디오를 볼 뿐만 아니라 정적 이미지도 동시에 분석할 수 있어 인공지능이 단일 시각적 입력만 처리할 수 있었던 이전의 한계를 깨뜨렸습니다. Gradio의 기계 학습 책임자인 Ahsen Khaliq는 인터뷰에서 "이제 AI와 대화를 나누고 라이브 비디오와 공유하고 싶은 이미지를 처리하도록 할 수 있습니다"라고 말했습니다.

AnyChat이 이러한 멀티 스트림 처리 기능을 성공적으로 달성할 수 있었던 것은 Gemini AI의 고급 신경망 아키텍처 덕분입니다. 이 기능은 이미 Gemini의 API에 존재하지만 Google의 공식 애플리케이션에서는 아직 일반 사용자에게 공개되지 않았습니다. ChatGPT를 포함한 많은 AI 플랫폼은 현재 단일 스트림의 입력만 처리할 수 있어 이미지를 업로드할 때 라이브 비디오 스트리밍을 비활성화합니다.

이 기술의 잠재적인 응용 분야는 엄청납니다. 학생들은 실시간으로 수학 문제를 제시하고 Gemini에게 단계별 안내를 위해 교과서를 보여줄 수 있습니다. 아티스트는 진행 중인 작업과 참조 이미지를 공유하여 구성과 기법에 대한 실시간 피드백을 얻을 수 있습니다.

AnyChat의 기술적 혁신은 우연이 아닙니다. 개발팀은 Gemini의 기술 아키텍처와 긴밀히 협력하여 기능을 성공적으로 확장했습니다. 이러한 특수 권한을 통해 AnyChat은 대화의 일관성에 영향을 주지 않고 여러 시각적 입력을 동시에 추적하고 분석할 수 있습니다. 개발자는 간단한 코드로 이 기능을 복제하고 비디오 스트리밍 및 이미지 업로드를 지원하는 사용자 정의 플랫폼을 만들 수 있습니다.

AnyChat은 아직 실험 단계에 있지만 멀티 스트림 AI 비전 처리의 실제 잠재력을 성공적으로 보여줍니다. 의학, 공학, 교육 등의 분야에서 Gemini의 새로운 역량은 파괴적인 변화를 가져올 것입니다.

AnyChat 프로젝트:AnyChathttps://huggingface.co/spaces/akhaliq/anychat

가장 밝은 부분:

Gemini AI는 실시간 비디오와 정지 이미지의 동시 처리를 실현하여 과거의 한계를 뛰어넘습니다.

AnyChat 플랫폼은 교육, 예술 및 기타 분야에서 AI의 광범위한 응용 가능성을 보여줍니다.

개발자는 Gemini의 기술을 쉽게 활용하여 자신만의 시각적 AI 애플리케이션을 구축할 수 있습니다.

전체적으로 Gemini AI의 멀티스트림 영상 처리 능력은 인공지능 기술의 큰 도약을 의미하며, AnyChat의 성공적인 적용은 AI 개발의 미래 방향에 대한 새로운 참고 자료를 제공합니다. 기술이 계속 성숙해짐에 따라 Gemini AI는 더 많은 분야에서 엄청난 잠재력을 발휘하고 인류 사회에 더욱 편리하고 지능적인 삶의 경험을 선사할 것으로 믿어집니다.