ViTPose는 간단하고 효율적인 구조와 뛰어난 성능으로 알려진 Visual Transformer 기반의 오픈 소스 인간 자세 추정 모델입니다. 복잡한 컨벌루션 신경망을 버리고 적층된 Transformer 레이어만 사용하여 이미지 특징을 추출하며 필요에 따라 모델 크기와 입력 해상도를 조정하여 성능과 속도 사이의 균형을 이룰 수 있습니다. 이 모델은 MS COCO 데이터 세트에서 훨씬 더 복잡한 모델을 능가하는 뛰어난 결과를 얻었으며 지식 전달을 지원하므로 작은 모델도 대형 모델의 기능을 가질 수 있습니다. 오픈 소스 코드와 모델은 연구 개발을 촉진합니다.

핵심적으로 ViTPose는 이미지의 주요 특징을 추출하기 위해 강력한 "골격"처럼 작동하는 순수한 시각적 Transformer를 사용합니다. 다른 모델처럼 복잡한 CNN(Convolutional Neural Network)의 지원이 필요하지 않습니다. 그 구조는 매우 간단합니다. 즉, 여러 개의 Transformer가 함께 계층화되어 있습니다.

ViTPose 모델은 필요에 따라 크기를 조정할 수 있습니다. 확장 가능한 눈금자와 마찬가지로 Transformer 레이어 수를 늘리거나 줄여 성능과 속도 사이의 균형을 찾는 방식으로 모델의 크기를 제어할 수 있습니다. 입력 이미지의 해상도를 조정할 수도 있으며 모델이 그에 맞게 조정됩니다. 또한 여러 데이터 세트를 동시에 처리할 수 있습니다. 즉, 다양한 자세의 데이터를 인식하는 데 사용할 수 있습니다.

단순한 구조에도 불구하고 ViTPose는 인간 자세 추정에 매우 효과적입니다. 유명한 MS COCO 데이터 세트에서 훨씬 더 복잡한 모델을 능가하는 매우 좋은 결과를 얻었습니다. 이는 단순한 모델이 매우 강력할 수 있음을 보여줍니다. ViTPose의 또 다른 특징은 대형 모델의 "지식"을 소형 모델로 전달할 수 있다는 것입니다. 경험이 풍부한 교사가 학생들에게 지식을 전달하여 작은 모델이 큰 모델의 힘을 가질 수 있는 것과 같습니다.

ViTPose의 코드와 모델은 오픈 소스이므로 누구나 무료로 사용하고 연구 개발을 수행할 수 있습니다.

ViTPose는 컴퓨터가 인간의 행동을 이해하는 데 도움이 되는 간단하지만 강력한 도구와 같습니다. 장점은 단순성, 유연성, 효율성 및 학습 용이성입니다. 이는 인간 자세 추정 분야에서 매우 유망한 기본 모델이 됩니다.

이 모델은 Transformer 레이어를 사용하여 이미지 데이터를 처리하고 경량 디코더를 사용하여 핵심 포인트를 예측합니다. 디코더는 간단한 디콘볼루션 레이어나 쌍선형 보간법을 사용하여 특징 맵을 업샘플링할 수 있습니다. ViTPose는 표준 데이터 세트에서 우수한 성능을 발휘할 뿐만 아니라 폐색 및 다양한 포즈를 처리하는 데에도 탁월한 성능을 발휘합니다. 인간 자세 추정, 동물 자세 추정, 얼굴 특징점 검출 등 다양한 작업에 적용할 수 있습니다.

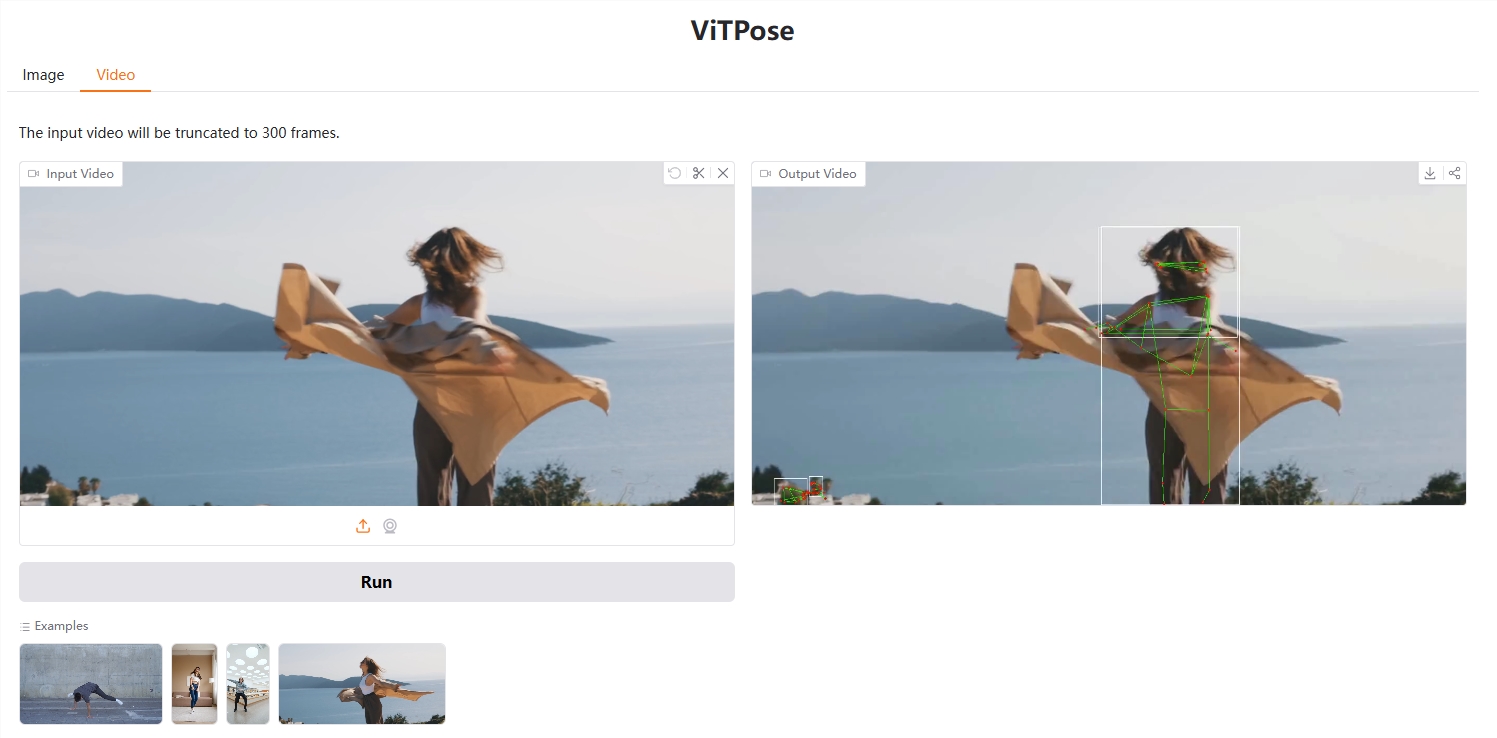

데모: https://huggingface.co/spaces/hysts/ViTPose-transformers

모델: https://huggingface.co/collections/usyd-community/vitpose-677fcfd0a0b2b5c8f79c4335

전체적으로 ViTPose는 효율적인 구조와 뛰어난 성능으로 인간 자세 추정 분야에 대한 강력한 기본 모델을 제공합니다. 또한 ViTPose의 오픈 소스 기능은 더 많은 연구자와 개발자의 참여를 촉진하고 이 분야의 발전을 촉진합니다. 단순성, 효율성 및 사용 용이성은 핵심 장점입니다.