최근에, 연구팀은 Hellomeme이라는 표현 마이그레이션 프레임 워크를 공개적으로 발표했으며, 이는 한 사람의 표현을 매우 높은 충실도로 다른 사람의 이미지로 마이그레이션 할 수 있습니다. 고유 한 네트워크 구조와 혁신적인 애니메이터 모듈을 통해 Hellomeme은 비디오 생성을위한 부드러운 매끄러운 균형과 높은 화질의 균형을 유지하고 Arkit Face Blendshapes를 지원하여 사용자에게 문자 표현을 잘 제어 할 수 있도록합니다. 또한 핫 스왑 어댑터 설계는 SD1.5 모델과의 호환성을 보장하고 생성의 가능성을 확장하며 비디오 생성 효율성을 크게 향상시킵니다. 이 기사는 핵심 기능, 기술적 기능 및 다른 Hellomeme 프레임 워크의 다른 방법과 비교를 자세히 소개합니다.

최근에 연구팀은 Hellomeme이라는 프레임 워크를 발표했는데,이 프레임 워크는 그림에서 한 사람의 표현을 다른 그림의 캐릭터 이미지로 마이그레이션 할 수 있습니다.

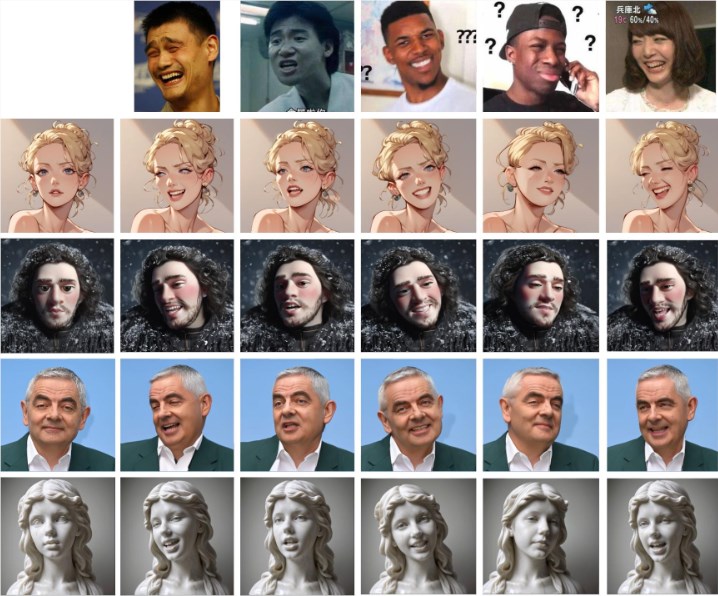

다음 그림과 같이 표현 그림 (첫 번째 줄)을 제공 한 다음 표현식 세부 사항을 다른 그림의 문자로 전송할 수 있습니다.

Hellomeme의 핵심은 고유 한 네트워크 구조입니다. 프레임은 구동 비디오에서 각 프레임의 기능을 추출하고 이러한 기능을 HMControlModule에 입력 할 수 있습니다. 이러한 처리를 통해 연구원은 부드러운 비디오 이미지를 생성 할 수 있습니다. 그러나 처음 생성 된 비디오에서는 프레임 사이의 깜박임에 문제가있어 전체 시청 경험에 영향을 미칩니다. 이 문제를 해결하기 위해 팀은 비디오 연속성을 크게 향상 시켰지만 그림의 충실도를 어느 정도 줄이는 혁신 인 애니메이터 모듈을 도입했습니다.

이러한 모순에 대한 응답으로 연구자들은 애니메이터 모듈을 더욱 최적화하고 조정하여 궁극적으로 비디오 연속성을 향상시키는 동시에 높은 이미지 품질을 달성했습니다.

또한 Hellomeme 프레임 워크는 얼굴 표현 편집을 강력하게 지원합니다. Arkit Face Blendshapes를 묶어 사용자는 생성 된 비디오에서 문자의 얼굴 표현을 쉽게 제어 할 수 있습니다. 이러한 유연성을 통해 제작자는 필요에 따라 특정 감정과 표현이있는 비디오를 생성하여 비디오 컨텐츠의 표현력을 크게 풍부하게합니다.

기술적 호환성 측면에서 Hellomeme은 SD1.5를 기반으로 한 핫 스왑 어댑터 설계를 채택합니다. 이 설계의 가장 큰 장점은 T2I (텍스트-이미지) 모델의 일반화 기능에 영향을 미치지 않으므로 SD1.5에서 개발 된 모든 양식화 된 모델이 Hellomeme과 완벽하게 통합 할 수 있다는 것입니다. 이것은 다양한 창작물에 더 많은 가능성을 제공합니다.

연구팀은 HmreferenceModule의 도입이 비디오를 생성 할 때 충실도 조건을 크게 향상 시켰으며, 이는 고품질 비디오를 생성하면서 샘플링 단계를 줄일 수 있음을 의미합니다. 이 발견은 생성 효율성을 향상시킬뿐만 아니라 실시간 비디오 생성을위한 새로운 문을 열어줍니다.

다른 방법과 비교하는 효과는 다음과 같습니다.

프로젝트 입구 : https://songkey.github.io/hellomeme/

https://github.com/hellovision/comfyui_hellomeme

핵심 사항 :

Hellomeme은 고유 한 네트워크 구조 및 애니메이터 모듈을 통해 비디오 생성 유창성 및 화질의 이중 개선을 달성합니다.

이 프레임 워크는 Arkit Face Blendshapes를 지원하므로 사용자는 문자의 얼굴 표정을 유연하게 제어하고 비디오 컨텐츠의 성능을 풍부하게 할 수 있습니다.

Hot-Swap 어댑터 설계는 SD1.5를 기반으로 다른 모델과의 호환성을 보장하여 생성에 대한 유연성을 높입니다.

효율적인 표현 마이그레이션 능력, 부드러운 비디오 생성 효과 및 강력한 호환성을 통해 Hellomeme 프레임 워크는 비디오 제작을위한 새로운 가능성을 제공하며 영화 및 텔레비전 제작, 애니메이션 특수 효과 및 기타 분야에서 중요한 역할을 할 것으로 예상됩니다. 또한 오픈 소스 기능을 통해 더 많은 개발자가 참여하고 기술의 추가 개발 및 개선을 공동으로 홍보 할 수 있습니다.