Hugging Face는 새로운 소형 언어 모델 인 Smollm2를 출시했습니다. SMOLLM2에는 리소스 제약 장치에서도 강력한 성능을 제공하는 세 가지 매개 변수 크기 버전이 있으며, 이는 Edge Computing 및 Mobile Device Applications에 매우 중요합니다. 그것은 유사한 모델을 능가하는 여러 벤치 마크에서 탁월하며 과학적 추론과 상식 과제에서 장점을 보여줍니다. Smollm2의 오픈 소스 및 Apache 2.0 라이센스는 또한 쉽게 액세스하고 적용 할 수 있도록합니다.

Hugging Face는 오늘 큰 모델보다 훨씬 적은 컴퓨팅 리소스를 요구하는 인상적인 성능을 달성하는 새로운 소형 언어 모델 인 Smollm2를 발표했습니다. 새로운 모델은 Apache 2.0 라이센스에 따라 릴리스되며 135m, 360m 및 1.7b 매개 변수의 세 가지 크기로 제공됩니다. 스마트 폰 및 프로세싱 전력 및 메모리가 제한된 기타 에지 장치에 배포하는 데 적합합니다.

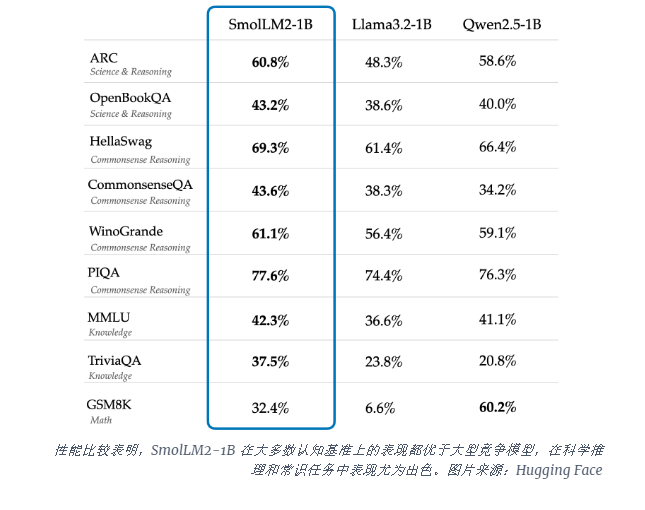

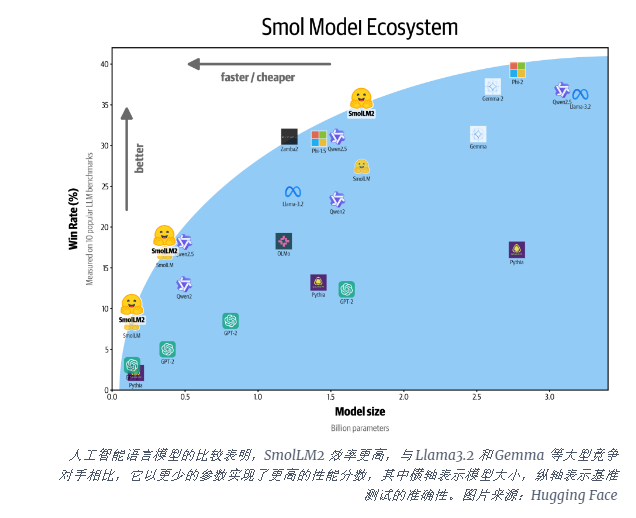

SMOLLM2-1B 모델은 여러 주요 벤치 마크, 특히 과학적 추론 및 상식 작업에서 메타 LLAMA1B 모델을 능가합니다. 이 모델은 FineWeb-Edu 및 전문화 된 수학 및 코딩 데이터 세트를 포함한 다양한 데이터 세트 조합을 사용하여 대부분의인지 벤치 마크에서 대규모 경쟁 모델을 능가합니다.

SMOLLM2의 출시는 AI 산업이 대형 언어 모델 (LLMS)을 실행하기 위해 컴퓨팅 요구에 대처하기 위해 고군분투하는 중요한 순간에 이루어집니다. OpenAi 및 Anthropic과 같은 회사는 모델 크기의 경계를 계속 추진하고 있지만 장치에서 로컬로 실행할 수있는 효율적이고 가벼운 AI의 필요성이 높아지고 있습니다.

SMOLLM2는 강력한 AI 기능을 개인 장치에 직접 가져 오는 다른 접근 방식을 제공하며, 더 많은 사용자와 회사가 거대한 데이터 센터를 가진 기술 거대 기업뿐만 아니라 고급 AI 도구를 사용할 수있는 미래를 지적합니다. 이 모델은 개인 정보 보호, 대기 시간 또는 연결 제한이 클라우드 기반 AI 솔루션을 실용적으로 만드는 시나리오에서 배포에 적합한 텍스트 재 작성, 요약 및 기능 호출을 포함한 다양한 응용 프로그램을 지원합니다.

이러한 작은 모델에는 여전히 한계가 있지만보다 효율적인 AI 모델에서 광범위한 추세의 일부를 나타냅니다. SMOLLM2의 출시는 인공 지능의 미래가 더 큰 모델뿐만 아니라 더 적은 자원으로 강력한 성능을 제공 할 수있는보다 효율적인 아키텍처에 속할 수 있음을 보여줍니다.

SMOLLM2의 출현으로 가벼운 AI 애플리케이션의 새로운 가능성이 열렸으며, 이는 AI 기술이 다양한 장치와 시나리오에서보다 널리 사용될 것이므로 사용자가보다 편리하고 효율적인 경험을 제공합니다. 오픈 소스 기능은 또한 AI 커뮤니티의 추가 개발과 혁신을 촉진했습니다. 앞으로 우리는 AI 기술의 대중화와 발전을 촉진하여보다 효율적이고 컴팩트 한 AI 모델이 떠오를 것으로 예상됩니다.