Google은 Gemini2.0 기술, 특히 개방형 및 탐색 적 문제를 대상으로하는 검색 경험을 향상시키는 것을 목표로하는 "AI Mode"라는 새로운 기능을 테스트하고 있습니다. 이 기능은 사용자에게 정보 분류 및 링크 탐색을위한 더 현명한 공간을 제공하며, 이는 2025 년에 출시 될 것으로 예상됩니다.

Google 검색은 사용자에게 더 개방적이고 탐구적인 질문을 할 수있는 "영구 공간"을 제공하는 "AI Mode"라는 새로운 기능에 대한 내부 테스트를 수행하고 있습니다. 이 새로운 경험은 Google의 Gemini2.0 기술을 기반으로하며 현재 직원들 사이에서 테스트되고 있습니다.

내부 이메일에 대한 설명에 따르면, "AI 모드"는 지능적인 검색 기능을 다음 단계로 가져 와서 사용자가 쉽게 소화하기위한 정보를 구성하고 네트워크에서 관련 컨텐츠를 탐색 할 수있는 링크를 제공 할 수 있도록 도와줍니다. 이 모델은 현재 검색 결과에서 잘 충족되지 않은 개방적이고 탐색 적 문제를 위해 특별히 설계되었습니다. 예를 들어, 사용자는 제안과 비교가 필요한 질문을하거나 시스템과 후속 대화를 할 수 있습니다.

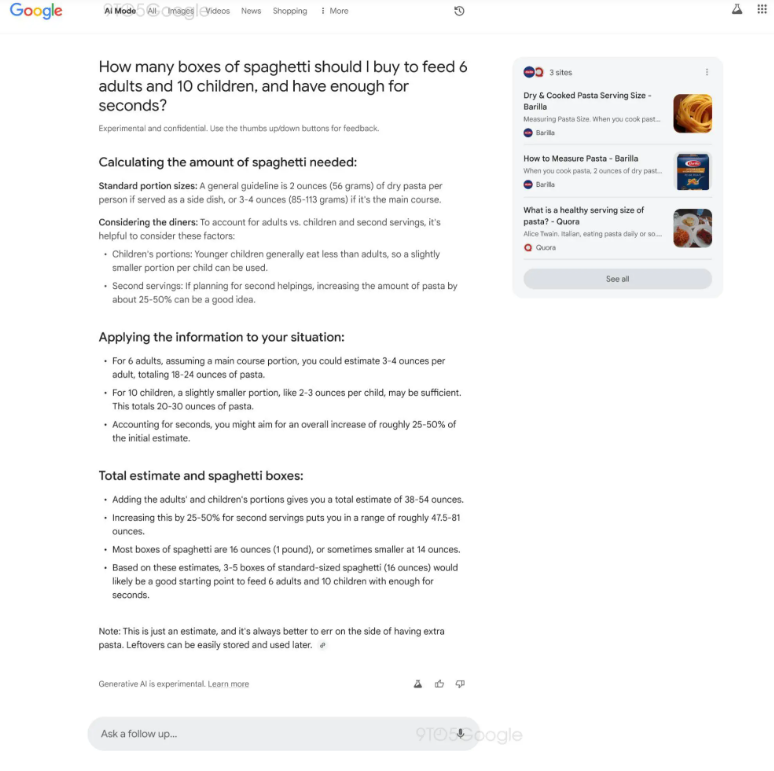

Google은 직원에게 "AI 모드"의 응용 프로그램 시나리오를 보여주는 몇 가지 예제 질문을 제공합니다. 예를 들어, 사용자는 다음과 같이 묻습니다. "성인 6 명과 어린이 10 명을 위해 충분한 파스타를 준비하기 위해 몇 개의 상자를 사야합니까?" "또한 사용자는 다음과 같은 후속 질문을 할 수 있습니다."수생 초원 조경을 시작하기 위해 어떤 자료를 준비해야합니까? "그런 다음"근처에 어떤 상점 이이 자료를 살 수 있습니까? "

"AI 모드"는 "고급 추론 및 사고 기술"을 가진 Gemini2.0의 "사용자 정의 버전"을 사용합니다. 사용자 인터페이스가 완성되지는 않았지만 직원은이 기능의 "초기 릴리스"데스크탑 경험을 이미 볼 수 있으며 모바일 터미널에도 동일하게 적용됩니다.

"AI 모드"를 사용하는 경우 사용자는 여전히 쿼리를 입력하고 이미지, 뉴스, 쇼핑 등과 같은 기존 필터링 옵션과 함께 "AI 모드"옵션도 있습니다. 클릭 한 후 사용자는 챗봇과 유사한 인터페이스를 입력합니다. 인터페이스는 사용자 검색의 내용을 표시하며 전체 화면 인터페이스 아래에 표시됩니다. 전통적인 10 개의 파란색 링크와 달리 여기에는 그러한 링크가 없지만 오른쪽에는 "웹 속의 깊이"에 대한 링크를 제공 할 수있는 카드가 있습니다. 이 인터페이스는 작년에 시작된 AI 개요 설계와 유사하며 AI 모델의 향후 버전은 더 풍부한 디자인을 가질 것입니다.

사용자가 "후속 질문을 요청"할 수있는 답변 하단에 텍스트 상자가 있으며 Android 및 iOS 용 Google Apps도 음성 입력을 지원합니다. 현재 "AI 모델"은 미국의 Google CEO와 함께 테스트를 받고 있습니다. Sundar Pichai는 2025 년이 검색 혁신의 중요한 해가 될 것이라고 말했습니다.

핵심 사항 :

Google은 개방적이고 탐색적인 문제를 다루는 것을 목표로하는 새로운 "AI 모델"을 테스트하고 있습니다.

이 모델은 Gemini2.0 기술을 사용하여 사용자에게 더 똑똑한 정보 분류 및 링크 탐색 기능을 제공합니다.

"AI 모델"은 2025 년까지 출시 될 것으로 예상되며 현재 직원 테스트를 받고 있습니다.

Google의 "AI Model"은 검색 엔진 기술의 주요 도약이며 사용자에게보다 지능적이고 편리한 검색 경험을 제공합니다.