llm agent

1.0.0

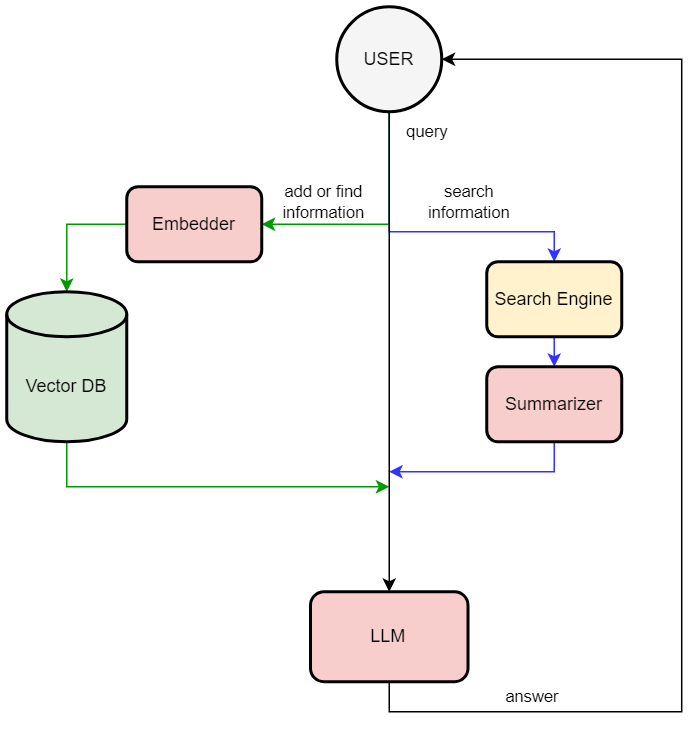

LLM baseado em RAG usando memória de longo prazo por meio de banco de dados vetorial

Este repositório permite que o modelo de linguagem grande use memória de longo prazo por meio de um banco de dados vetorial (este método é chamado RAG (Retrieval Augmented Generation) - esta é uma técnica que permite ao LLM recuperar fatos de um banco de dados externo). O aplicativo é construído com mistral-7b-instruct-v0.2.Q4_K_M.gguf (usando ligação LLAMA_cpp_python) e chromadb. O usuário pode solicitar em linguagem natural para adicionar informações ao banco de dados, encontrar informações no banco de dados ou na Internet usando orientação.

You > Hi

LOG: [Response]

Bot < Hello! How can I assist you today?

You > Please add information to db "The user name is Rustam Akimov"

LOG: [Adding to memory]

Bot < Done!

You > Can you find on the Internet who is Pavel Durov

LOG: [Extracting question]

LOG: [Searching]

LOG: [Summarizing]

Bot < According to the search results provided, Pavel Durov is a Russian entrepreneur who co-founded Telegram Messenger Inc.

You > Please find information in db who is Rustam Akimov

LOG: [Extracting question]

LOG: [Querying memory]

Bot < According to the input memories, your name is Rustam Akimov.