Implementação Pytorch do artigo "T2M-GPT: Gerando Movimento Humano a partir de Descrições Textuais com Representações Discretas"

[Página do projeto] [Papel] [Demonstração do notebook] [HuggingFace] [Demonstração do espaço] [T2M-GPT +]

Se nosso projeto for útil para sua pesquisa, considere citar:

@inproceedings{zhang2023generating,

title={T2M-GPT: Generating Human Motion from Textual Descriptions with Discrete Representations},

author={Zhang, Jianrong and Zhang, Yangsong and Cun, Xiaodong and Huang, Shaoli and Zhang, Yong and Zhao, Hongwei and Lu, Hongtao and Shen, Xi},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

year={2023},

}

| Texto: um homem dá um passo à frente e faz parada de mão. | ||||

|---|---|---|---|---|

| GT | T2M | MDM | Movimento Difuso | Nosso |

|  |  |  |  |

| Texto: Um homem se levanta do chão, anda em círculo e senta-se novamente no chão. | ||||

| GT | T2M | MDM | Movimento Difuso | Nosso |

|  |  |  |  |

Nosso modelo pode ser aprendido em uma única GPU V100-32G

conda env create -f environment.yml

conda activate T2M-GPTO código foi testado em Python 3.8 e PyTorch 1.8.1.

bash dataset/prepare/download_glove.shEstamos usando dois conjuntos de dados de linguagem de movimento humano 3D: HumanML3D e KIT-ML. Para ambos os conjuntos de dados, você pode encontrar os detalhes, bem como o link para download [aqui].

Tomemos HumanML3D como exemplo, o diretório do arquivo deve ficar assim:

./dataset/HumanML3D/

├── new_joint_vecs/

├── texts/

├── Mean.npy # same as in [HumanML3D](https://github.com/EricGuo5513/HumanML3D)

├── Std.npy # same as in [HumanML3D](https://github.com/EricGuo5513/HumanML3D)

├── train.txt

├── val.txt

├── test.txt

├── train_val.txt

└── all.txt

Usamos os mesmos extratores fornecidos por t2m para avaliar nossos movimentos gerados. Baixe os extratores.

bash dataset/prepare/download_extractor.shOs arquivos do modelo pré-treinado serão armazenados na pasta 'pré-treinado':

bash dataset/prepare/download_model.shSe quiser renderizar o movimento gerado, você precisa instalar:

sudo sh dataset/prepare/download_smpl.sh

conda install -c menpo osmesa

conda install h5py

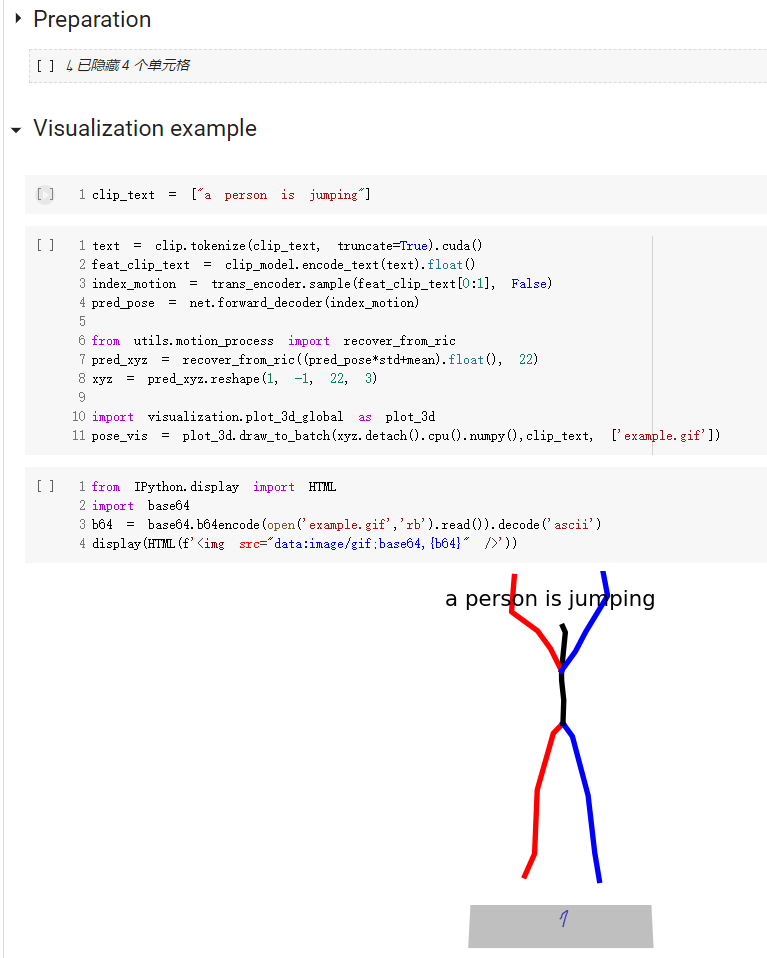

conda install -c conda-forge shapely pyrender trimesh mapbox_earcutUm guia de início rápido sobre como usar nosso código está disponível em demo.ipynb

Observe que, para o conjunto de dados do kit, basta definir '--dataname kit'.

Os resultados são salvos na pasta de saída.

python3 train_vq.py

--batch-size 256

--lr 2e-4

--total-iter 300000

--lr-scheduler 200000

--nb-code 512

--down-t 2

--depth 3

--dilation-growth-rate 3

--out-dir output

--dataname t2m

--vq-act relu

--quantizer ema_reset

--loss-vel 0.5

--recons-loss l1_smooth

--exp-name VQVAEOs resultados são salvos na pasta de saída.

python3 train_t2m_trans.py

--exp-name GPT

--batch-size 128

--num-layers 9

--embed-dim-gpt 1024

--nb-code 512

--n-head-gpt 16

--block-size 51

--ff-rate 4

--drop-out-rate 0.1

--resume-pth output/VQVAE/net_last.pth

--vq-name VQVAE

--out-dir output

--total-iter 300000

--lr-scheduler 150000

--lr 0.0001

--dataname t2m

--down-t 2

--depth 3

--quantizer ema_reset

--eval-iter 10000

--pkeep 0.5

--dilation-growth-rate 3

--vq-act relupython3 VQ_eval.py

--batch-size 256

--lr 2e-4

--total-iter 300000

--lr-scheduler 200000

--nb-code 512

--down-t 2

--depth 3

--dilation-growth-rate 3

--out-dir output

--dataname t2m

--vq-act relu

--quantizer ema_reset

--loss-vel 0.5

--recons-loss l1_smooth

--exp-name TEST_VQVAE

--resume-pth output/VQVAE/net_last.pthSeguindo a configuração de avaliação de texto para movimento, avaliamos nosso modelo 20 vezes e reportamos o resultado médio. Devido à parte de multimodalidade onde deveríamos gerar 30 moções a partir de um mesmo texto, a avaliação demora muito.

python3 GPT_eval_multi.py

--exp-name TEST_GPT

--batch-size 128

--num-layers 9

--embed-dim-gpt 1024

--nb-code 512

--n-head-gpt 16

--block-size 51

--ff-rate 4

--drop-out-rate 0.1

--resume-pth output/VQVAE/net_last.pth

--vq-name VQVAE

--out-dir output

--total-iter 300000

--lr-scheduler 150000

--lr 0.0001

--dataname t2m

--down-t 2

--depth 3

--quantizer ema_reset

--eval-iter 10000

--pkeep 0.5

--dilation-growth-rate 3

--vq-act relu

--resume-trans output/GPT/net_best_fid.pthVocê deve inserir o endereço da pasta npy e os nomes dos movimentos. Aqui está um exemplo:

python3 render_final.py --filedir output/TEST_GPT/ --motion-list 000019 005485Agradecemos ajuda de: