Inglês | 中文 | 日本語

Conjunto de dados | Referência | ? Modelos | ? Papel

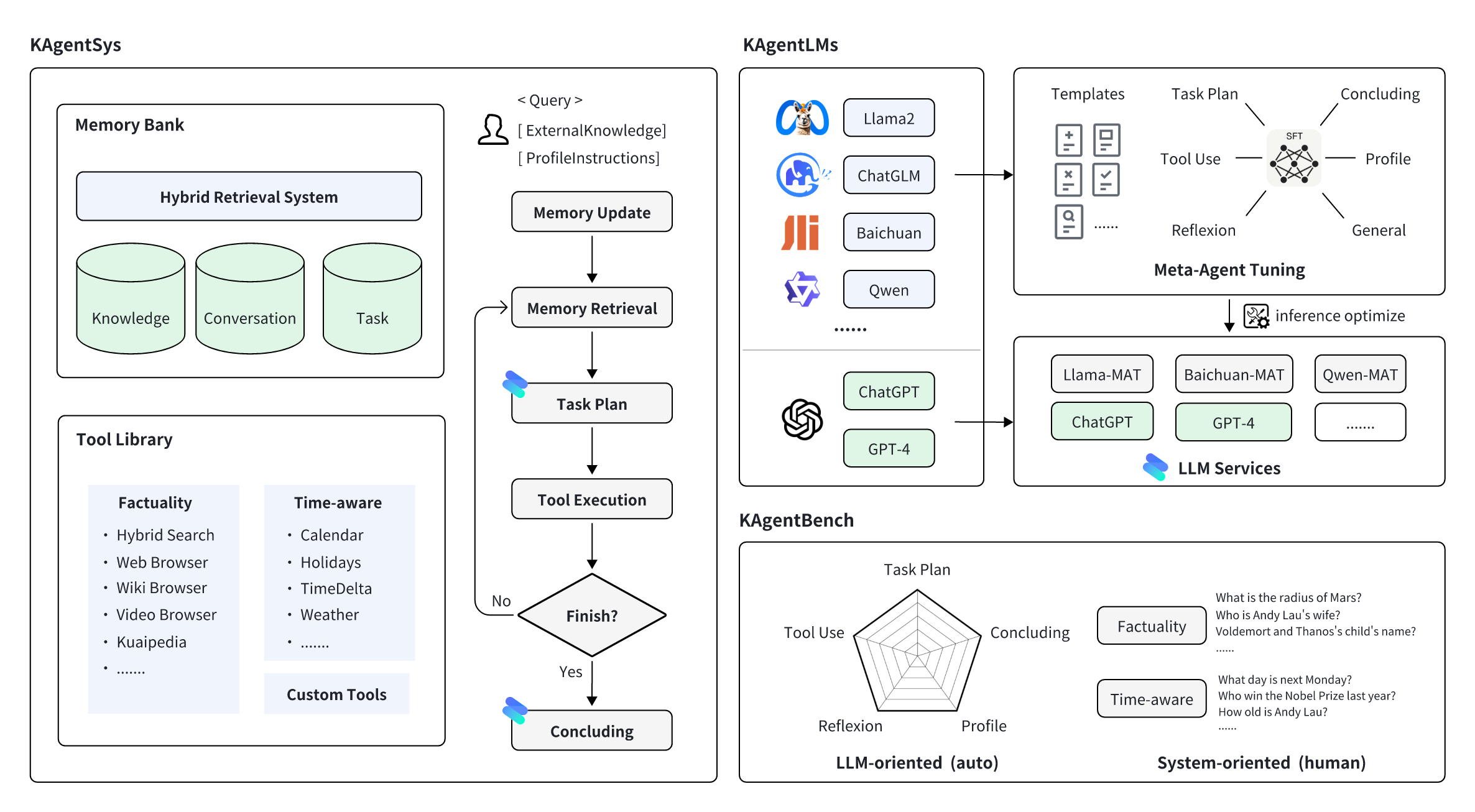

KwaiAgents é uma série de trabalhos relacionados a agentes de código aberto pelo KwaiKEG da Kuaishou Technology. O conteúdo de código aberto inclui:

| Tipo | Modelos | Dados de treinamento | Dados de referência |

| Qwen | Qwen-7B-MAT Qwen-14B-MAT Qwen-7B-MAT-cpp Qwen1.5-14B-MAT | KAgentInstruct | KAgentBench |

| Baichuan | Baichuan2-13B-MAT |

| Escala | Planejamento | Uso de ferramentas | Reflexão | Concluindo | Perfil | Pontuação geral | |

|---|---|---|---|---|---|---|---|

| GPT-3.5-turbo | - | 18h55 | 26.26 | 8.06 | 37,26 | 35,42 | 25,63 |

| Lhama2 | 13B | 0,15 | 0,44 | 0,14 | 16h60 | 17,73 | 17h30 |

| Bate-papoGLM3 | 6B | 7,87 | 11,84 | 7,52 | 30.01 | 30.14 | 15,88 |

| Qwen | 7B | 13h34 | 18h00 | 7,91 | 36,24 | 34,99 | 21.17 |

| Baichuan2 | 13B | 6,70 | 16h10 | 6,76 | 24,97 | 19.08 | 14,89 |

| ToolLlama | 7B | 0,20 | 4,83 | 1.06 | 15,62 | 10,66 | 6.04 |

| AgenteLM | 13B | 0,17 | 0,15 | 0,05 | 16h30 | 15.22 | 4,88 |

| Qwen-MAT | 7B | 31,64 | 43h30 | 33,34 | 44,85 | 44,78 | 39,85 |

| Baichuan2-MAT | 13B | 37,27 | 52,97 | 37h00 | 48.01 | 41,83 | 45,34 |

| Qwen-MAT | 14B | 43,17 | 63,78 | 32.14 | 45,47 | 45,22 | 49,94 |

| Qwen1.5-MAT | 14B | 42,42 | 64,62 | 30,58 | 46,51 | 45,95 | 50.18 |

| Escala | Sem agente | Reagir | Auto-GPT | KAgentSys | |

|---|---|---|---|---|---|

| GPT-4 | - | 57,21% (3,42) | 68,66% (3,88) | 79,60% (4,27) | 83,58% (4,47) |

| GPT-3.5-turbo | - | 47,26% (3,08) | 54,23% (3,33) | 61,74% (3,53) | 64,18% (3,69) |

| Qwen | 7B | 52,74% (3,23) | 51,74% (3,20) | 50,25% (3,11) | 54,23% (3,27) |

| Baichuan2 | 13B | 54,23% (3,31) | 55,72% (3,36) | 57,21% (3,37) | 58,71% (3,54) |

| Qwen-MAT | 7B | - | 58,71% (3,53) | 65,67% (3,77) | 67,66% (3,87) |

| Baichuan2-MAT | 13B | - | 61,19% (3,60) | 66,67% (3,86) | 74,13% (4,11) |

Instale primeiro o miniconda para o ambiente de construção. Em seguida, crie primeiro o ambiente de construção:

conda create -n kagent python=3.10

conda activate kagent

pip install -r requirements.txtRecomendamos usar vLLM e FastChat para implantar o serviço de inferência de modelo. Primeiro, você precisa instalar os pacotes correspondentes (para uso detalhado, consulte a documentação dos dois projetos):

pip install vllm

pip install " fschat[model_worker,webui] "pip install " fschat[model_worker,webui] "

pip install vllm==0.2.0

pip install transformers==4.33.2Para implantar KAgentLMs, primeiro você precisa iniciar o controlador em um terminal.

python -m fastchat.serve.controllerEm segundo lugar, você deve usar o seguinte comando em outro terminal para implantação do serviço de inferência de GPU única:

python -m fastchat.serve.vllm_worker --model-path $model_path --trust-remote-code Onde $model_path é o caminho local do modelo baixado. Se a GPU não suportar Bfloat16, você poderá adicionar --dtype half à linha de comando.

Terceiro, inicie o servidor REST API no terceiro terminal.

python -m fastchat.serve.openai_api_server --host localhost --port 8888Finalmente, você pode usar o comando curl para invocar o modelo igual ao formato de chamada OpenAI. Aqui está um exemplo:

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"model": "kagentlms_qwen_7b_mat", "messages": [{"role": "user", "content": "Who is Andy Lau"}]} ' Aqui, altere kagentlms_qwen_7b_mat para o modelo que você implantou.

llama-cpp-python oferece um servidor web que visa atuar como um substituto imediato para a API OpenAI. Isso permite que você use modelos compatíveis com llama.cpp com qualquer cliente compatível com OpenAI (bibliotecas de idiomas, serviços, etc.). O modelo convertido pode ser encontrado em kwaikeg/kagentlms_qwen_7b_mat_gguf.

Para instalar o pacote do servidor e começar:

pip install " llama-cpp-python[server] "

python3 -m llama_cpp.server --model kagentlms_qwen_7b_mat_gguf/ggml-model-q4_0.gguf --chat_format chatml --port 8888Finalmente, você pode usar o comando curl para invocar o modelo igual ao formato de chamada OpenAI. Aqui está um exemplo:

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"messages": [{"role": "user", "content": "Who is Andy Lau"}]} 'Baixe e instale os KwaiAgents, Python recomendado>=3.10

git clone [email protected]:KwaiKEG/KwaiAgents.git

cd KwaiAgents

python setup.py develop export OPENAI_API_KEY=sk-xxxxx

export WEATHER_API_KEY=xxxxxx

O WEATHER_API_KEY não é obrigatório, mas você precisa configurá-lo ao fazer perguntas relacionadas ao clima. Você pode obter a chave API neste site (o mesmo para uso do modelo local).

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " gpt-3.5-turbo " --lang= " en "Para usar um modelo local, você precisa implantar o serviço de modelo correspondente conforme descrito no capítulo anterior

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " kagentlms_qwen_7b_mat "

--use_local_llm --local_llm_host= " localhost " --local_llm_port=8888 --lang= " en "Argumentos de comando completos:

options:

-h, --help show this help message and exit

--id ID ID of this conversation

--query QUERY User query

--history HISTORY History of conversation

--llm_name LLM_NAME the name of llm

--use_local_llm Whether to use local llm

--local_llm_host LOCAL_LLM_HOST

The host of local llm service

--local_llm_port LOCAL_LLM_PORT

The port of local llm service

--tool_names TOOL_NAMES

the name of llm

--max_iter_num MAX_ITER_NUM

the number of iteration of agents

--agent_name AGENT_NAME

The agent name

--agent_bio AGENT_BIO

The agent bio, a short description

--agent_instructions AGENT_INSTRUCTIONS

The instructions of how agent thinking, acting, or talking

--external_knowledge EXTERNAL_KNOWLEDGE

The link of external knowledge

--lang {en,zh} The language of the overall system

--max_tokens_num Maximum length of model input

Observação :

browse_website , você precisará configurar o chromedriver em seu servidor.http_proxy . O uso de ferramentas personalizadas pode ser encontrado em exemplos/custom_tool_example.py

Precisamos apenas de duas linhas para avaliar as capacidades do agente como:

cd benchmark

python infer_qwen.py qwen_benchmark_res.jsonl

python benchmark_eval.py ./benchmark_eval.jsonl ./qwen_benchmark_res.jsonlO comando acima fornecerá resultados como

plan : 31.64, tooluse : 43.30, reflextion : 33.34, conclusion : 44.85, profile : 44.78, overall : 39.85

Consulte benchmark/ para obter mais detalhes.

@article{pan2023kwaiagents,

author = {Haojie Pan and

Zepeng Zhai and

Hao Yuan and

Yaojia Lv and

Ruiji Fu and

Ming Liu and

Zhongyuan Wang and

Bing Qin

},

title = {KwaiAgents: Generalized Information-seeking Agent System with Large Language Models},

journal = {CoRR},

volume = {abs/2312.04889},

year = {2023}

}