Eternal é uma plataforma experimental para fluxos de trabalho de aprendizado de máquina.

NOTA: Este aplicativo é um trabalho em andamento e não é estável. Por favor, considere este repositório para sua referência. Congratulamo-nos com colaboradores e feedback construtivo. Você também pode usá-lo como referência para seus próprios projetos.

Eternal integra vários projetos como llama.cpp , ComfyUI e codapi entre muitos outros projetos cujos desenvolvedores tiveram a gentileza de compartilhar com o mundo. Todo o crédito pertence aos respectivos contribuidores de todas as dependências das quais este repositório depende. Obrigado por compartilhar seus projetos com o mundo.

O frontend Eternal é renderizado com a lendária estrutura HTMX .

IMPORTANTE:

Configure o nível quant dos modelos em seu config.yml adequadamente para as especificações do seu sistema. Se um modelo local falhar na execução, investigue o motivo visualizando o arquivo main.log gerado. O motivo mais comum é RAM insuficiente ou modelo de prompt incorreto. Implementaremos tratamento de erros e registro mais robusto em um commit futuro.

.config.yml A documentação básica é fornecida na pasta docs deste repositório.

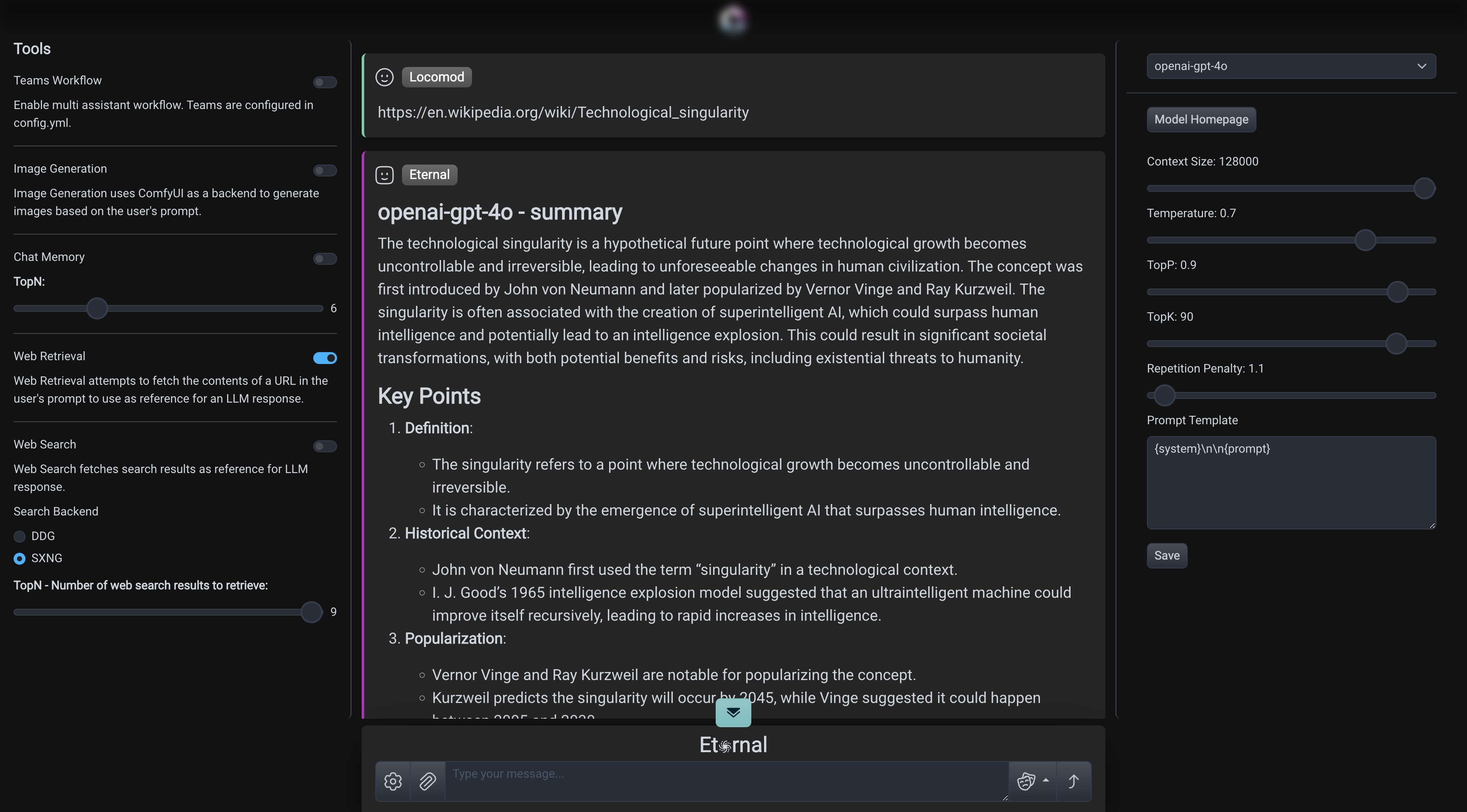

webget : tenta buscar um URL passado como parte do prompt.websearch : pesquisa na web pública páginas relacionadas ao seu prompt.Requer instalação do navegador Chrome.

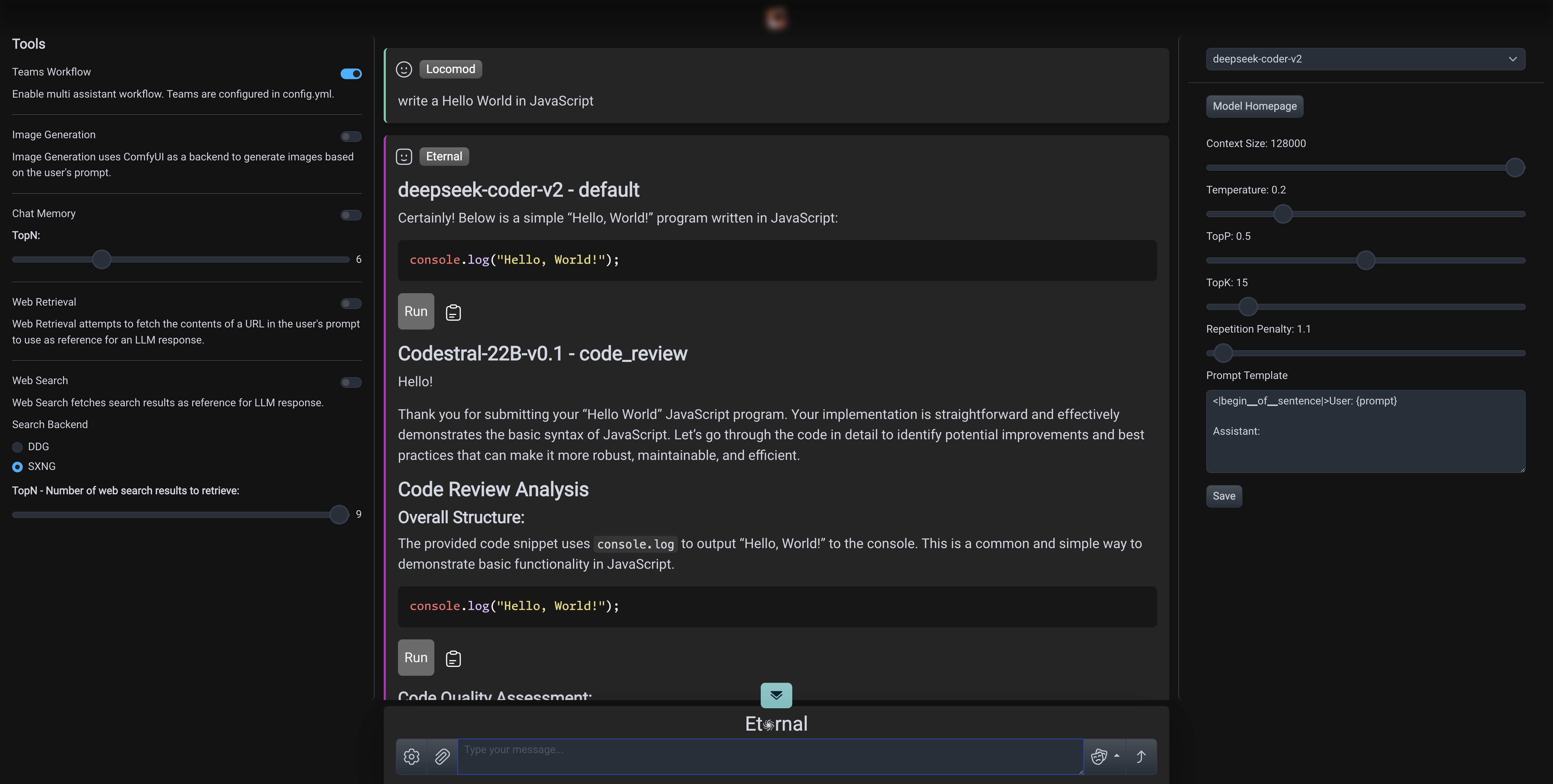

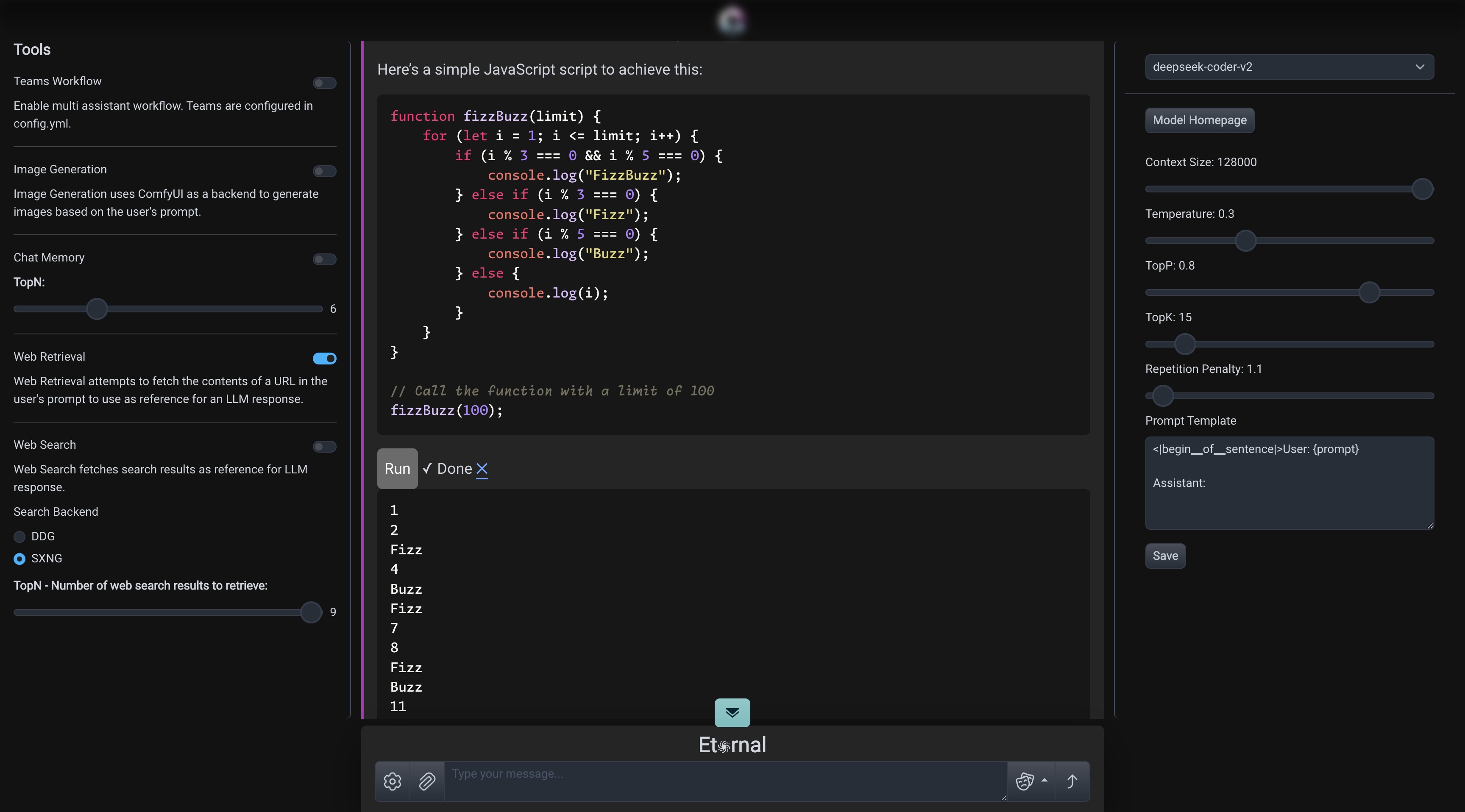

Execute e edite o código gerado pelo LLM na visualização de bate-papo em uma sandbox segura. Por enquanto, o JavaScript é implementado via WASM. Mais idiomas em breve!

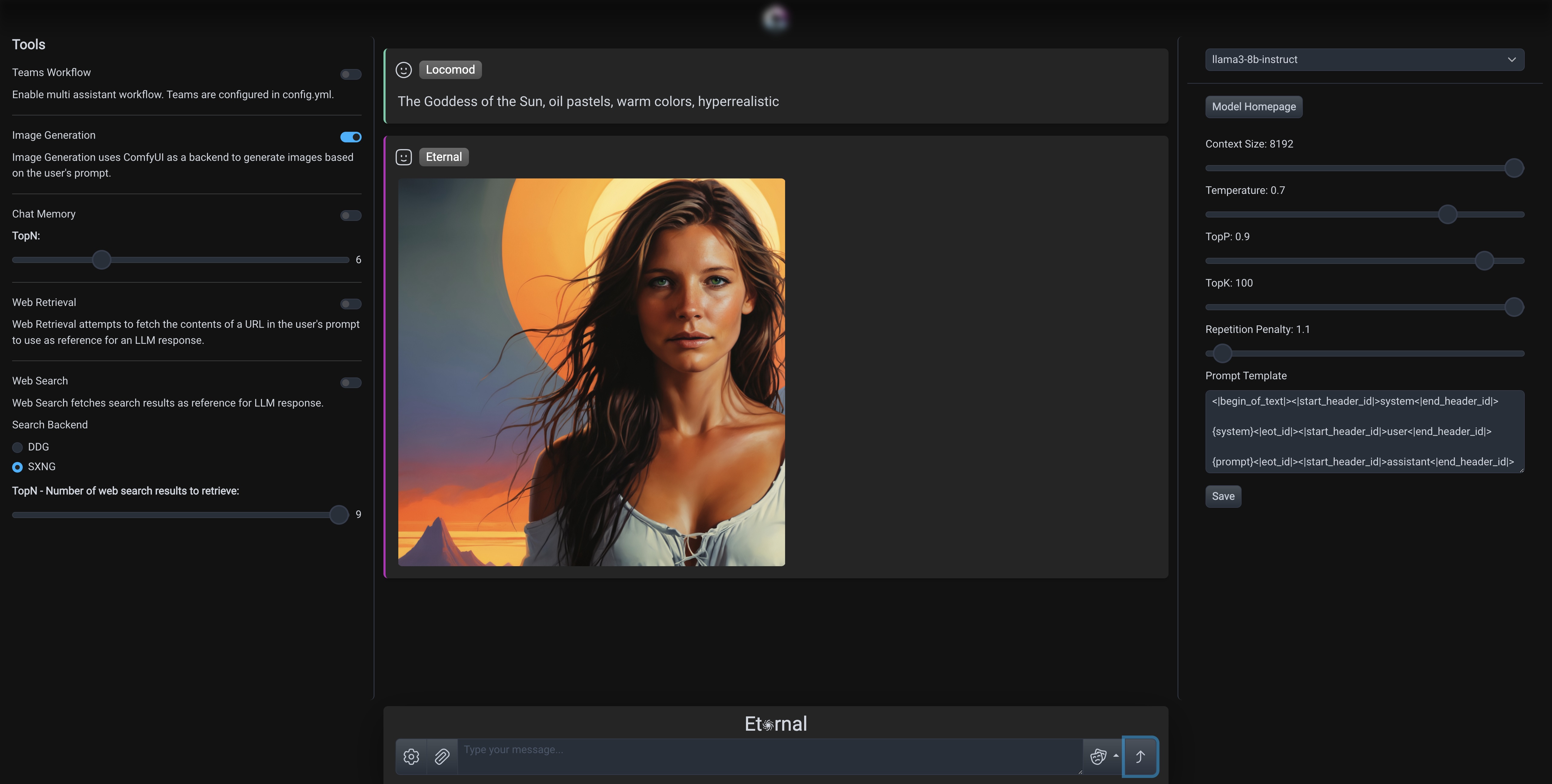

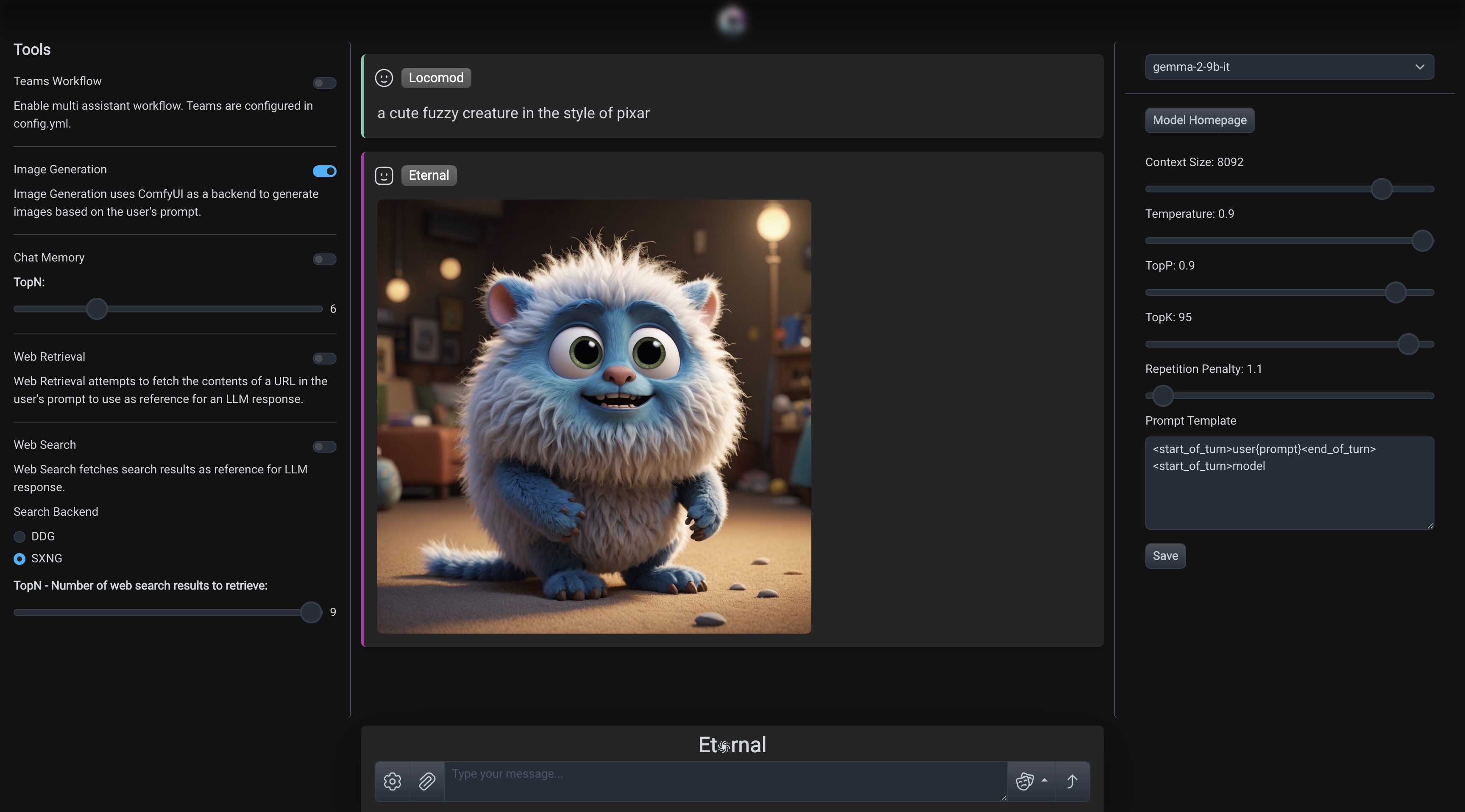

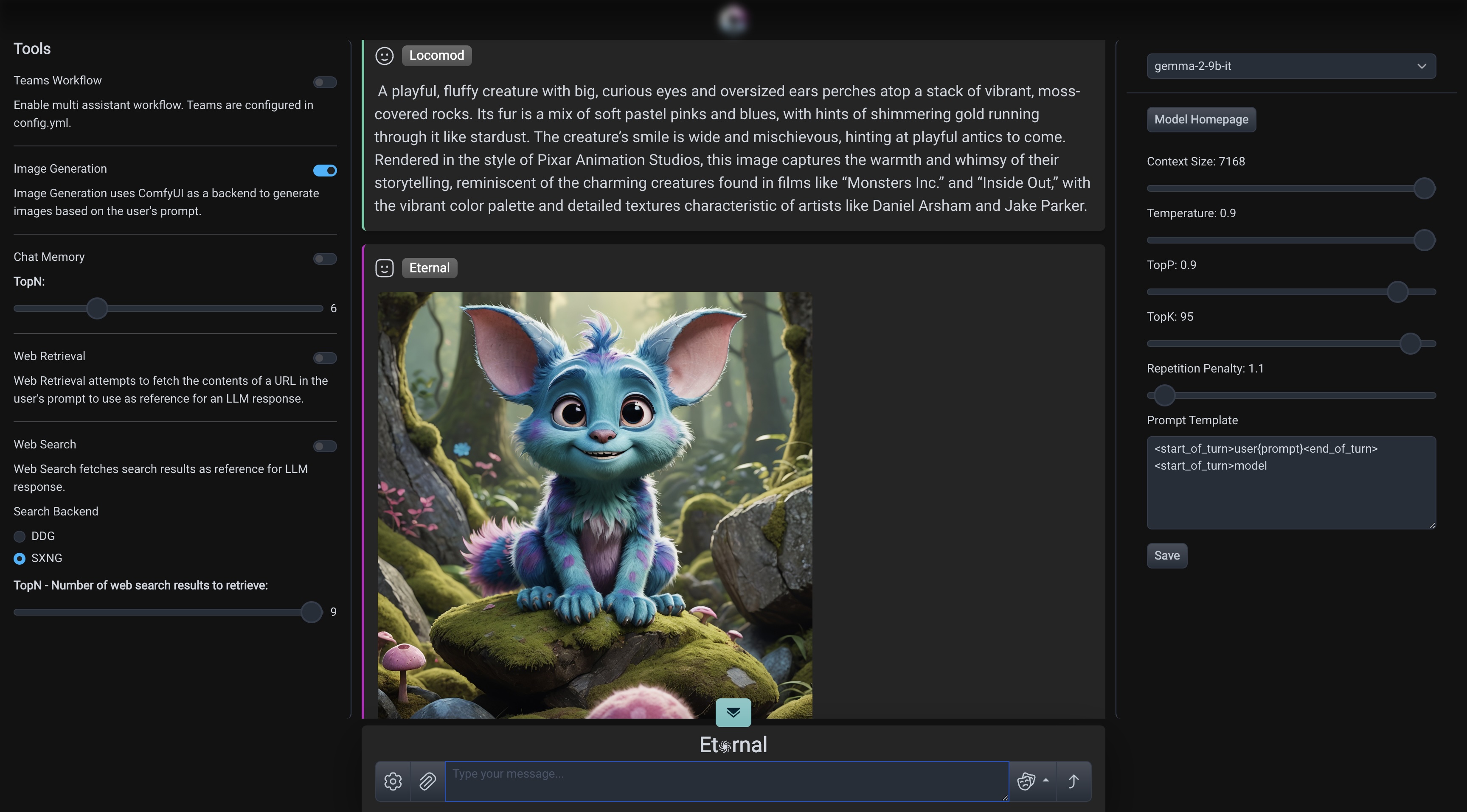

Eternal pode gerar imagens usando poderosos fluxos de trabalho ComfyUI personalizados que são gerenciados automaticamente e ajustados para saída de alta qualidade. Chega de ajustar centenas de parâmetros. Descreva e gere. Defina a função como image_bot e selecione qualquer LLM local ou público para aprimorar seus prompts.

Renomeie o arquivo .config.yml fornecido para config.yml e coloque-o no mesmo caminho do binário do aplicativo. Modifique o conteúdo para seu ambiente e caso de uso.

Eternal atualmente suporta construção em Linux ou Windows WSL usando CUDA (requer GPU nVidia) ou MacOS/Metal (requer Mac série M).

Para construir o aplicativo:

$ git clone https://github.com/intelligencedev/eternal.git

$ cd eternal

$ git submodule update --init --recursive

$ make all

Envie um problema se encontrar algum problema com o processo de construção.

Recomenda-se que um novo ambiente conda e um ambiente virtual do Python 3.10 sejam criados antes do lançamento inicial do aplicativo. Isso evitará mensagens de erro relacionadas às instalações de pacotes necessárias, como error: externally-managed-environment .

Se o Eternal falhar ao iniciar, execute os seguintes comandos para configurar um novo ambiente Conda e Python venv:

$ conda create -n eternal python=3.10

$ conda activate eternal

$ python python-m venv .

$ source bin/activate

# Apply execute permissions

$ sudo chmod +x ./eternal

# Run the Eternal binary

$ ./eternal

NOTA: Lembre-se de renomear o .config.yml incluído para config.yml , modificar as configurações do seu ambiente e salvar o arquivo no mesmo caminho do binário Eternal.

Este README é uma visão geral de alto nível do aplicativo Eternal. Instruções detalhadas de configuração e uma lista completa de recursos, dependências e configurações devem ser consultadas na própria documentação do aplicativo.