tinker chat

1.0.0

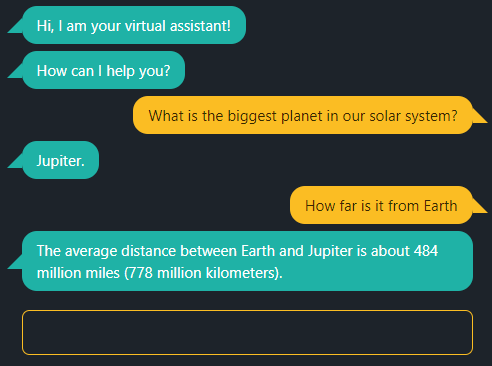

Este aplicativo de bate-papo oferece suporte a GPT da OpenAI ou ao seu próprio LLM local.

Para usar GPT do OpenAI, defina a variável de ambiente OPENAI_API_KEY como sua chave de API.

Para utilizar llama.cpp localmente com seu mecanismo de inferência, primeiro carregue um modelo quantizado como Phi-3 Mini, por exemplo:

/path/to/llama.cpp/server -m Phi-3-mini-4k-instruct-q4.gguf Antes de iniciar a demonstração, defina a variável de ambiente OPENAI_API_BASE :

export OPENAI_API_BASE=http://127.0.0.1:8080Com Node.js >= v18:

npm install

npm start

e abra localhost:5000 com um navegador da web.