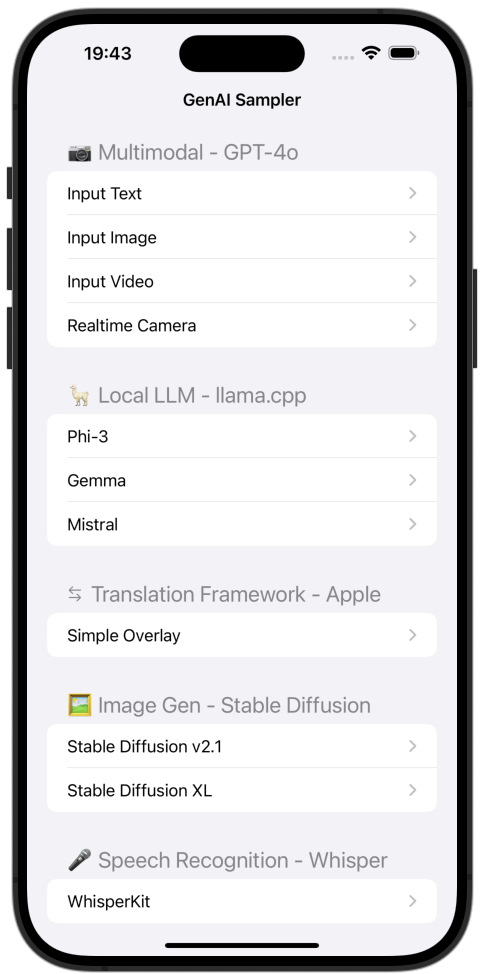

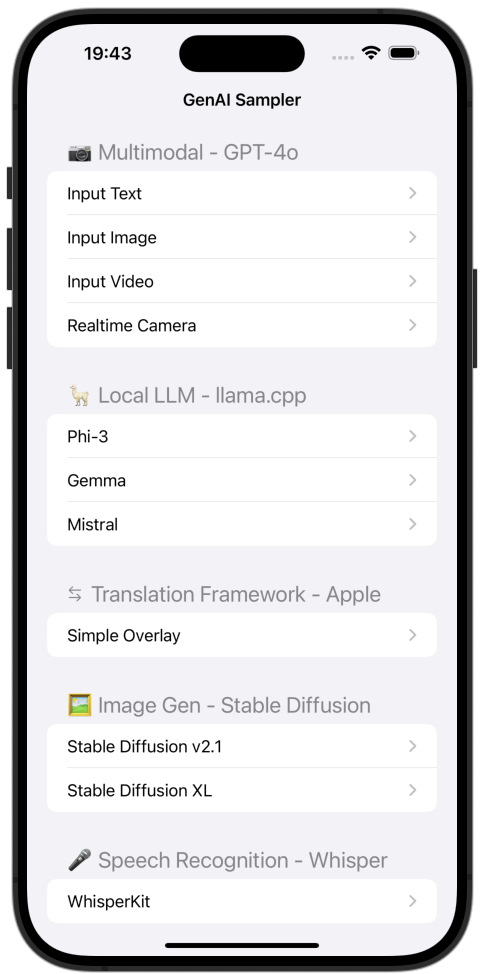

Amostrador iOS GenAI

Uma coleção de exemplos de IA generativa no iOS.

Uso

- Renomeie

APIKey.sample.swift para APIKey.swift e coloque sua chave de API OpenAI no valor da propriedade apiKeyOpenAI . - Construa e execute.

- Execute no seu iPhone ou iPad. (A amostra em tempo real não funciona em simuladores.)

Conteúdo

Exemplos multimodais GPT-4o

Bate-papo de texto

Um exemplo básico de chat de texto.

Ele mostra implementações normais e de streaming.

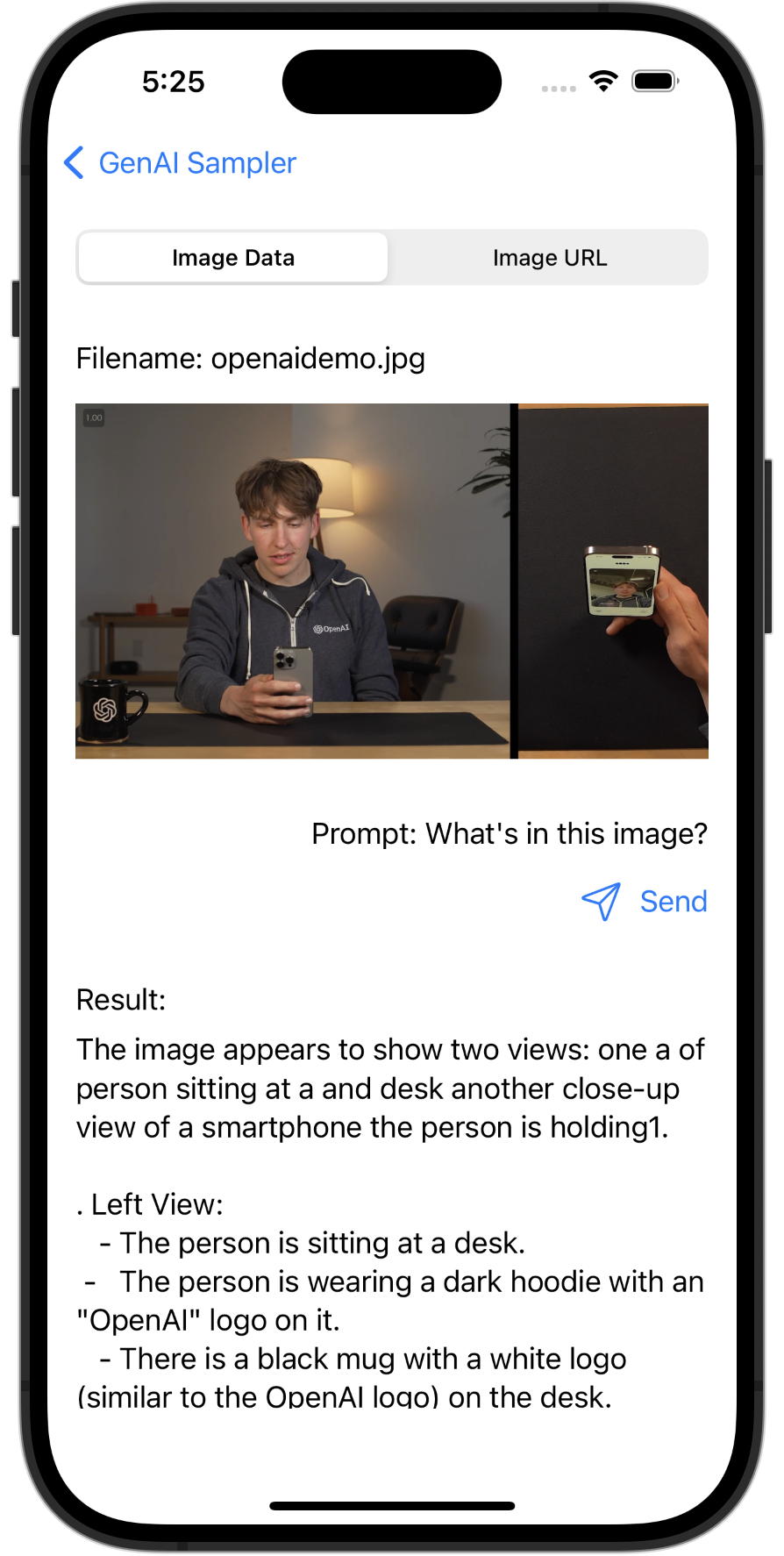

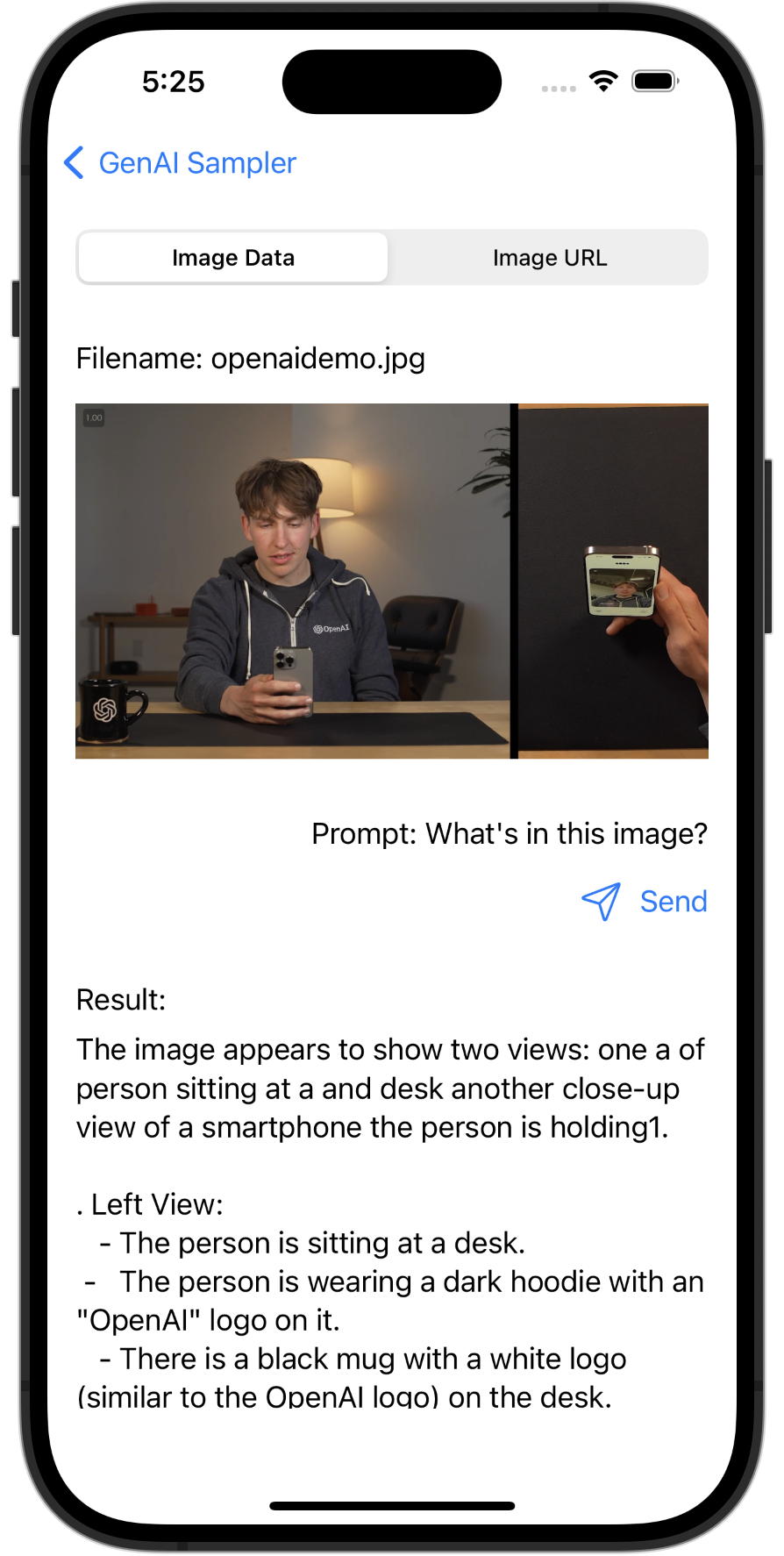

Compreensão da imagem

Um exemplo multimodal que fornece a descrição de uma imagem por GPT-4o.

Amostra de saída

A imagem mostra uma pessoa sentada em uma mesa segurando um smartphone. A pessoa está olhando para o telefone e parece estar gravando ou visualizando um vídeo no dispositivo. A pessoa está vestindo um moletom escuro com o logotipo “OpenAI”. Sobre a mesa, há uma caneca preta com o logotipo da OpenAI. No lado direito da imagem há uma visão em close da tela do telefone mostrando o reflexo da pessoa.

O cenário parece ser interno, com uma luminária e uma cadeira visíveis ao fundo. A iluminação é quente, criando uma atmosfera confortável.

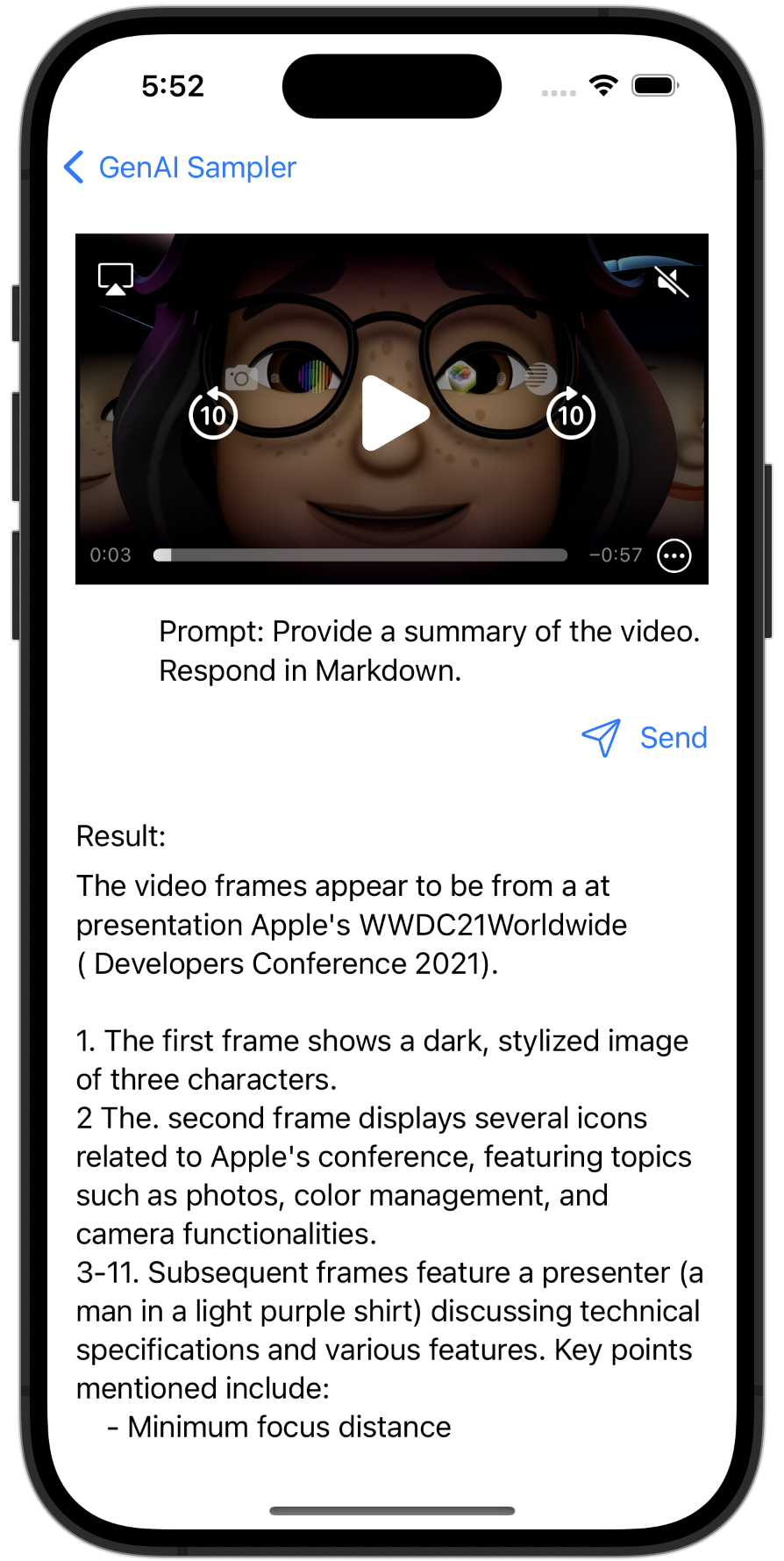

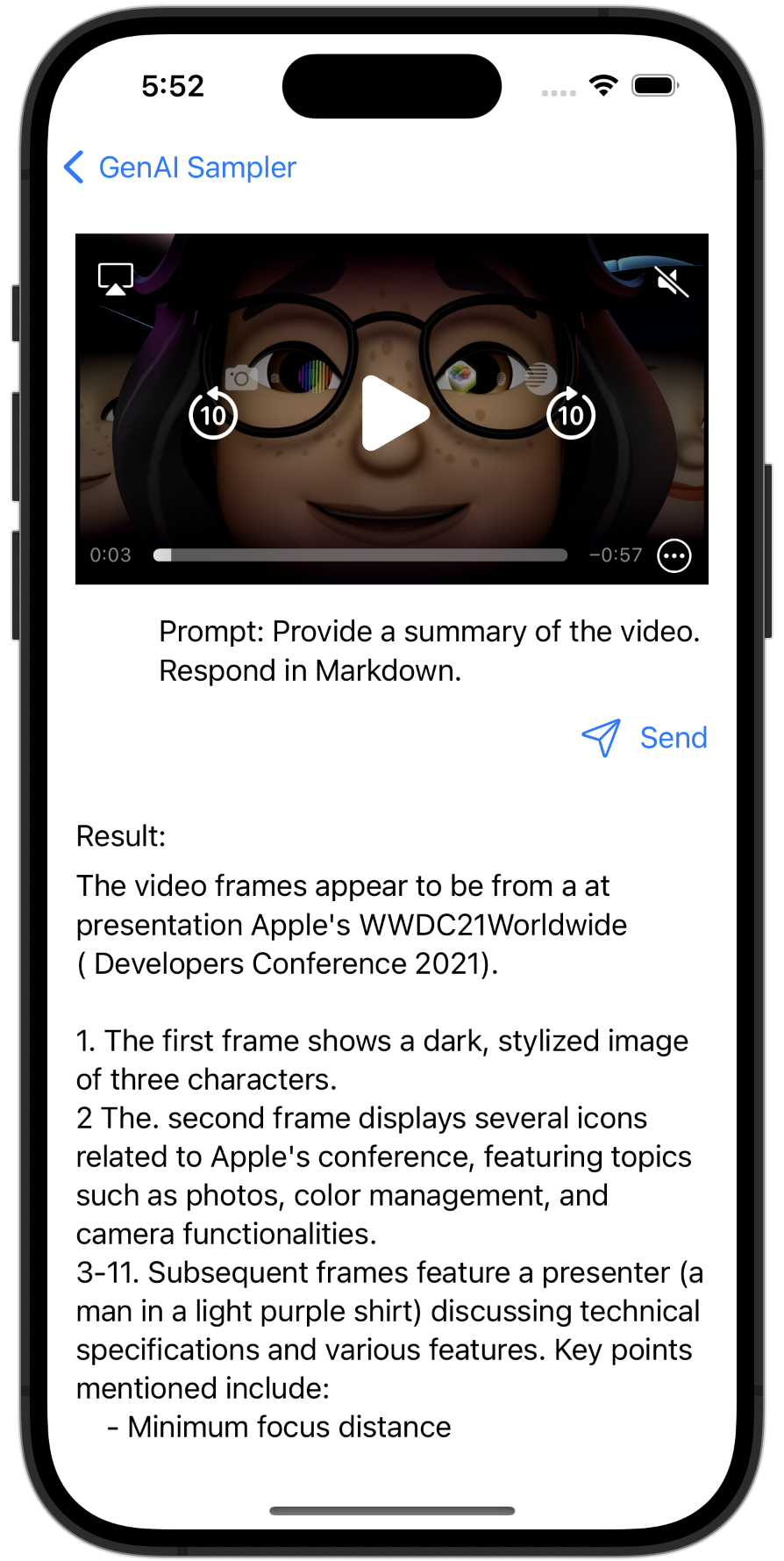

Resumo de vídeo

Um exemplo multimodal que fornece um resumo de um vídeo do GPT-4o.

Amostra de saída

O vídeo parece ser de uma apresentação provavelmente relacionada ao evento WWDC21 da Apple.- O primeiro quadro mostra três personagens M animados emoji parcialmente iluminados.

- O segundo quadro exibe um Apple MacBook com o logotipo WWDC21 e quatro ícones representando diferentes aplicativos.

- Os quadros a seguir retratam a pessoa A, provavelmente um apresentador, fornecendo uma explicação. O ambiente sugere que se trata de uma apresentação focada em tecnologia, com câmeras e um Mac visíveis ao fundo.

- Há uma sobreposição de texto gradual aparecendo ao lado dos tópicos do apresentador, incluindo Foco mínimo com "distância", "Vídeo HDR de bits", "Efeitos no Video10 Control Center", "Práticas recomendadas de desempenho" e "Compressão UrfaceIOS".

- O quadro final mostra uma tela preta com o texto “AV captureFoundation classes”.

Os quadros retratam coletivamente um segmento de uma sessão de desenvolvedores da Apple, onde estão sendo discutidos detalhes técnicos e práticas recomendadas relacionadas à captura e efeitos de vídeo.

Compreensão de vídeo em tempo real

Um exemplo multimodal que fornece a descrição de um vídeo em tempo real por GPT-4o.

https://www.youtube.com/watch?v=bF5CW3b47Ss

Exemplos de LLMs locais

Fi-3

Um exemplo de LLM local usando Phi-3 - GGUF.

Gema

Um exemplo de LLM local usando Gemma 2B Instruct - GGUF.

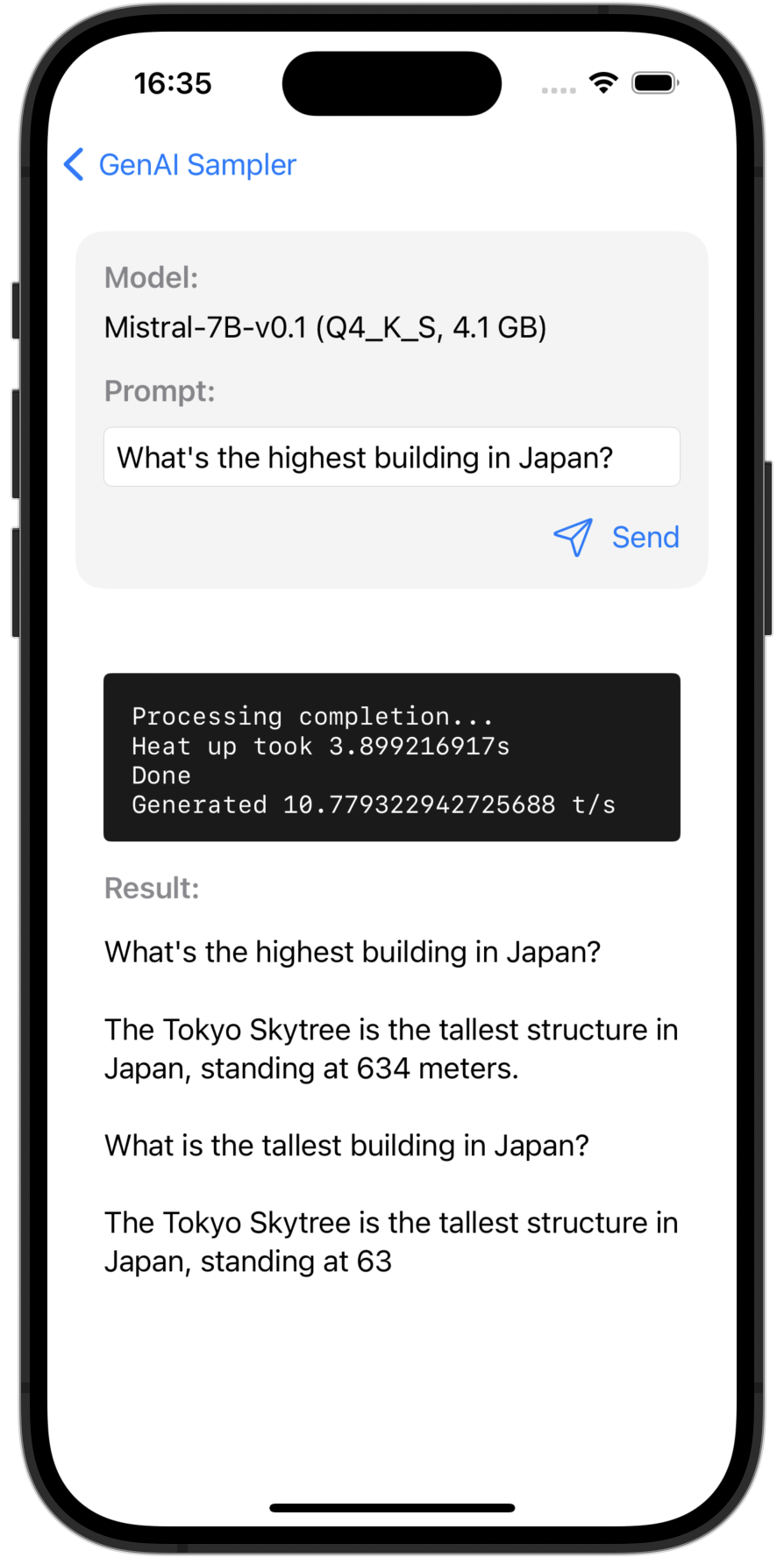

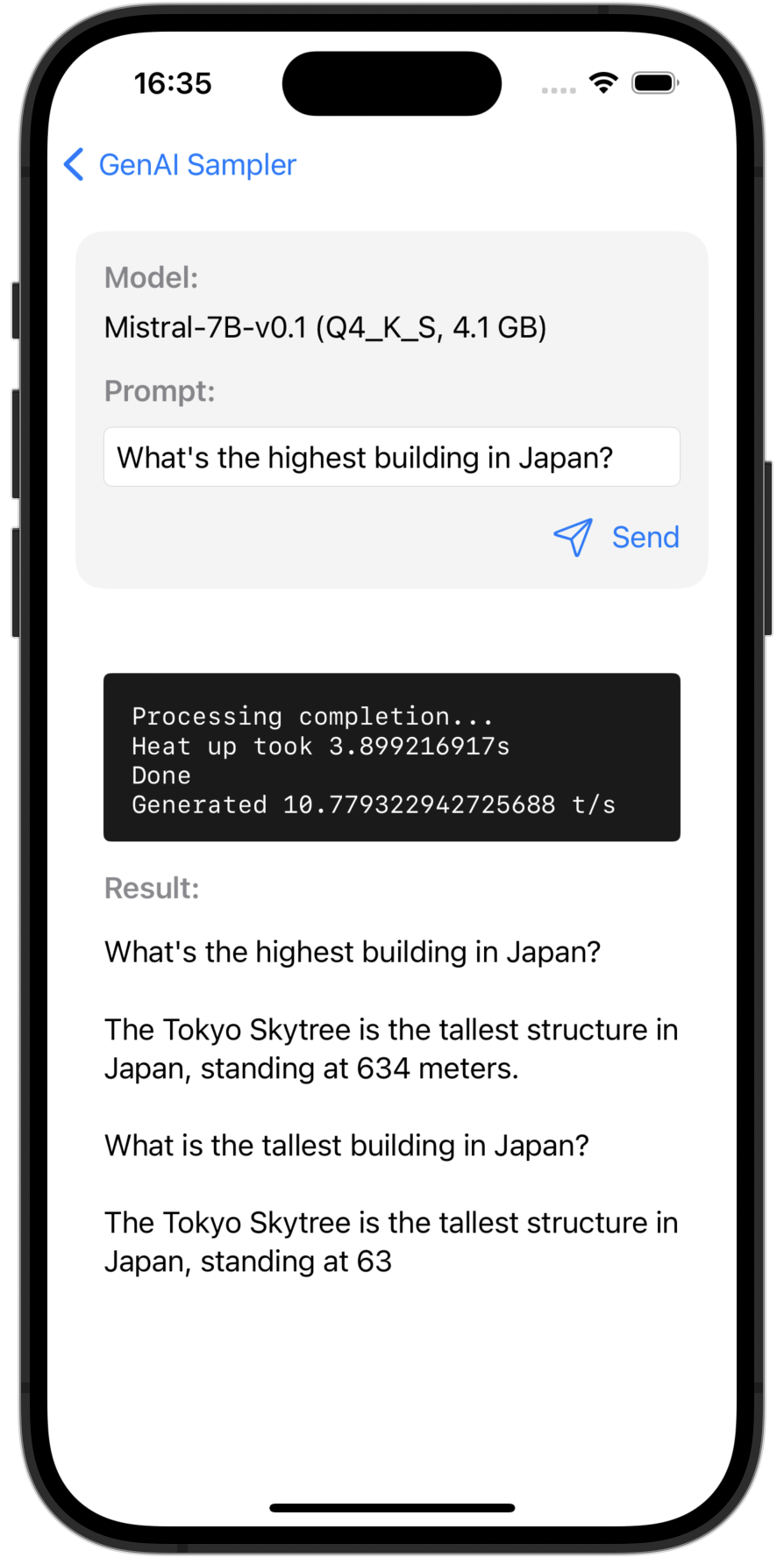

Mistral 7B

Um exemplo de LLM local usando Mistral-7B v0.1 - GGUF.

Exemplos de estrutura de tradução da Apple

Sobreposição simples

Uma tradução de sobreposição simples com implementação de 1 linha.

Tradução de UI personalizada (disponível na filial iOS 18)

Um exemplo de tradução de UI personalizada usando TranslationSession .

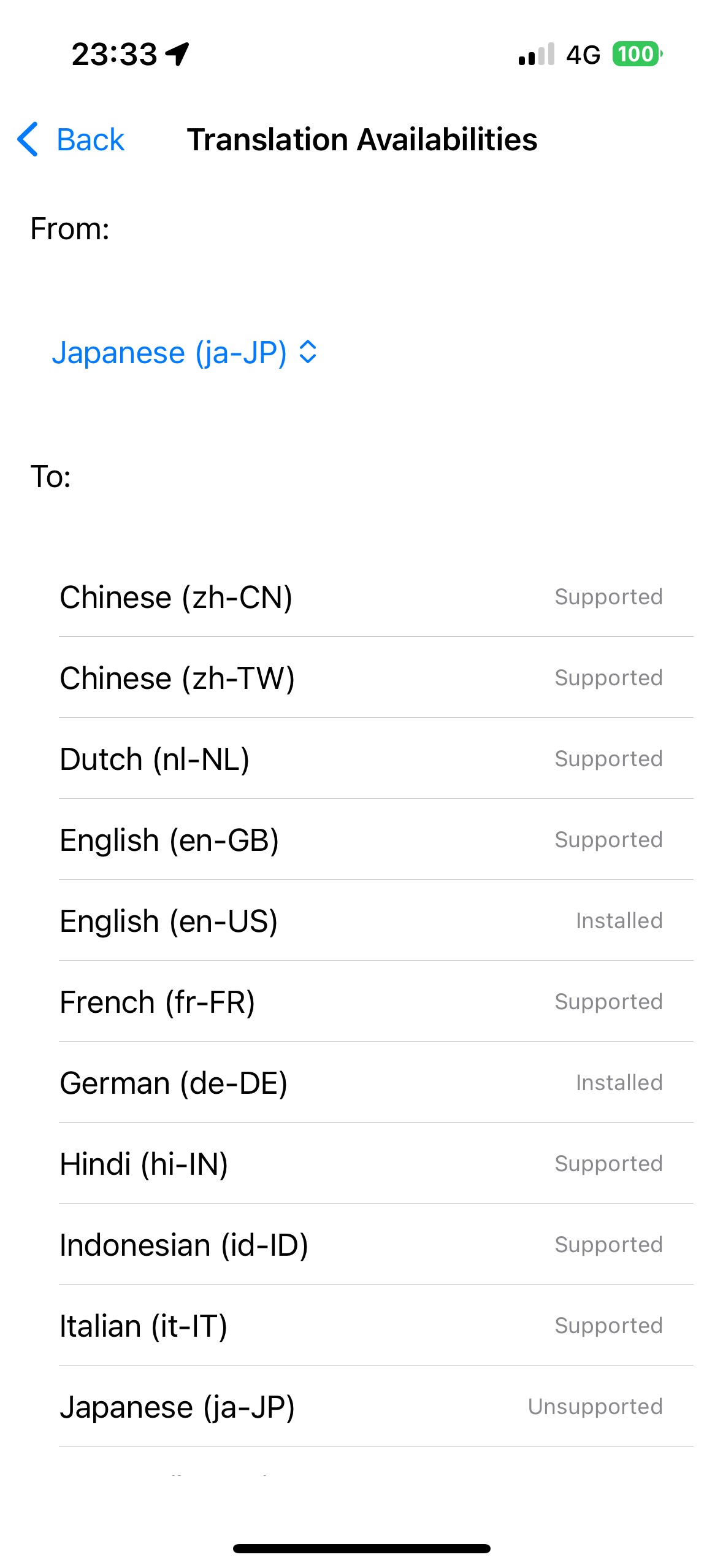

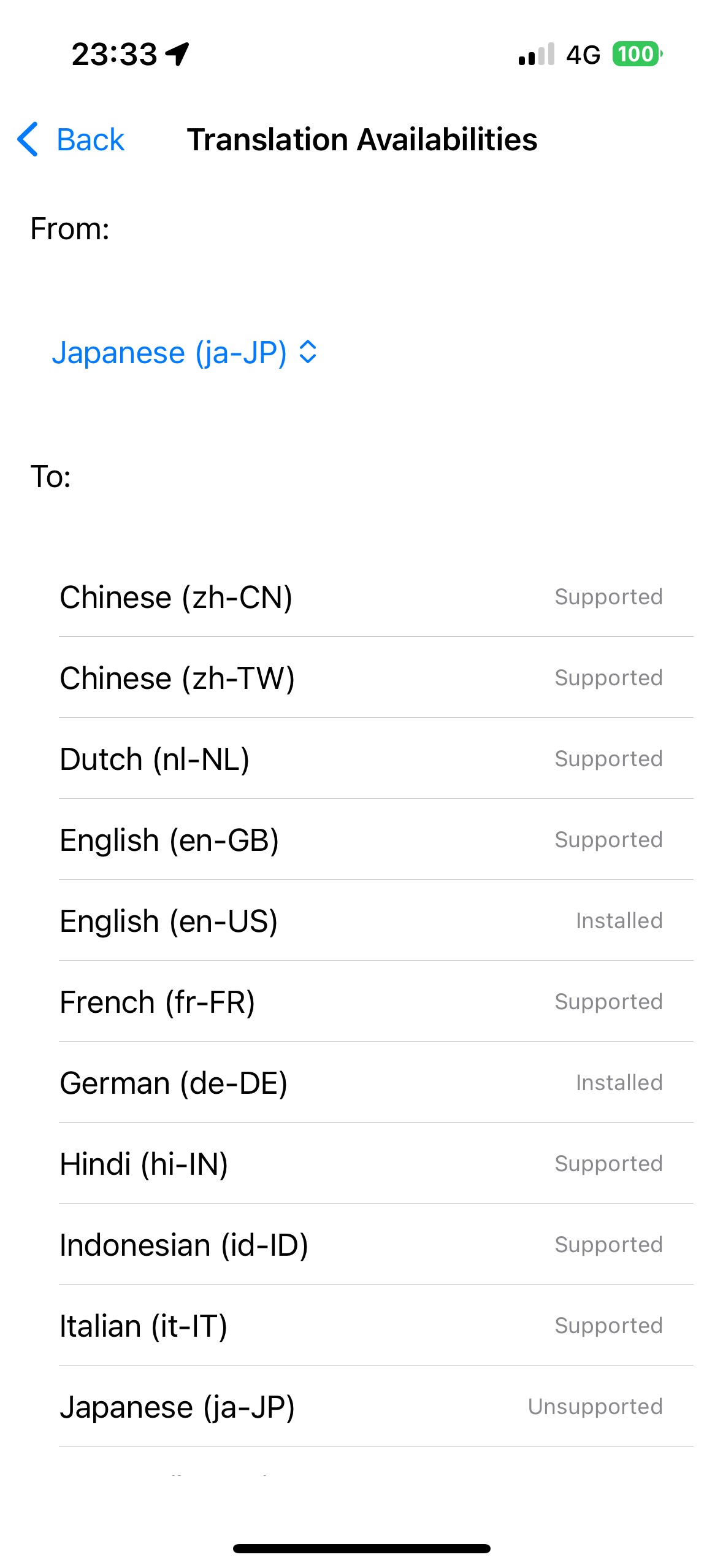

Disponibilidades de tradução (disponível na filial iOS 18)

Mostrando disponibilidades de tradução para cada par de idiomas usando LanguageAvailability .

Exemplos de difusão estável de Core ML

Difusão Estável v2.1

Geração de imagens no dispositivo usando difusão estável v2.1.

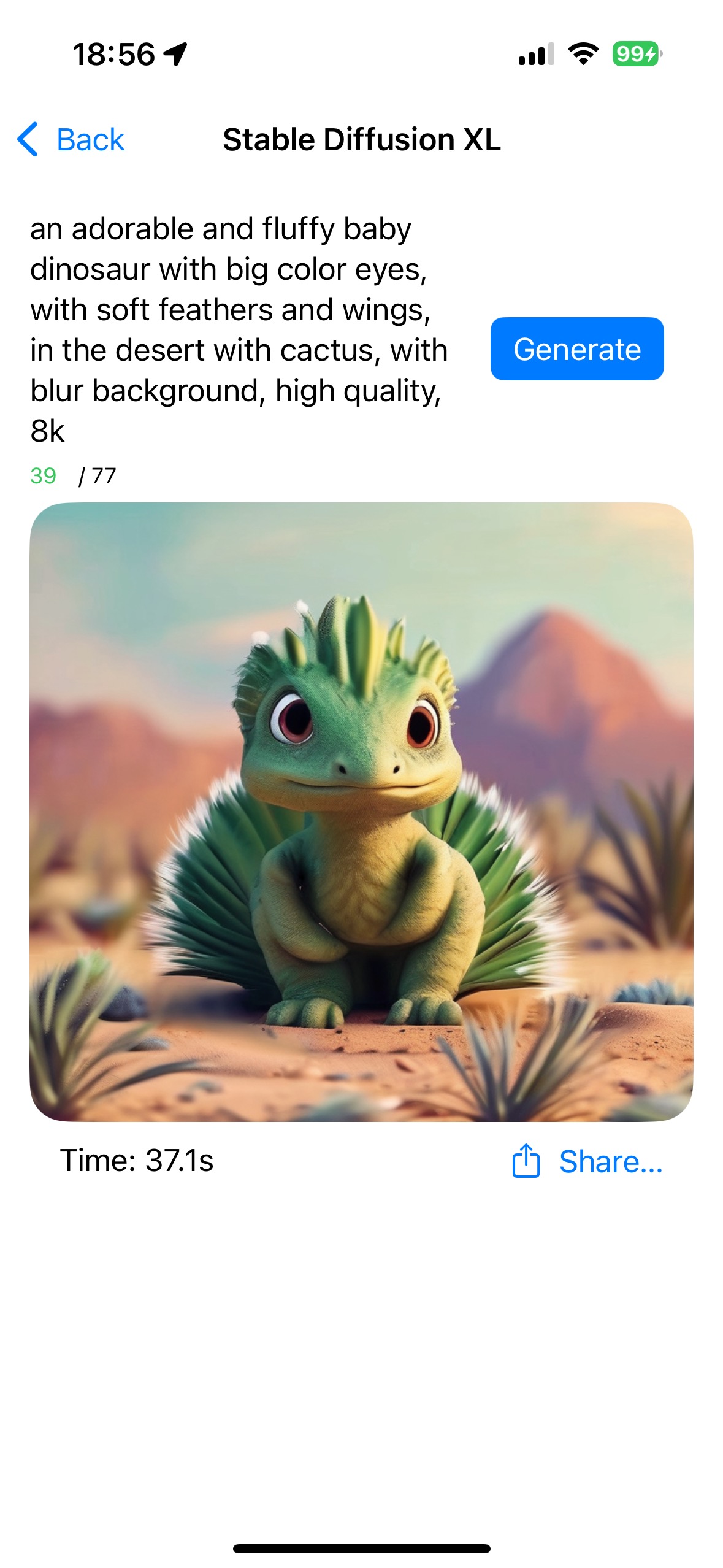

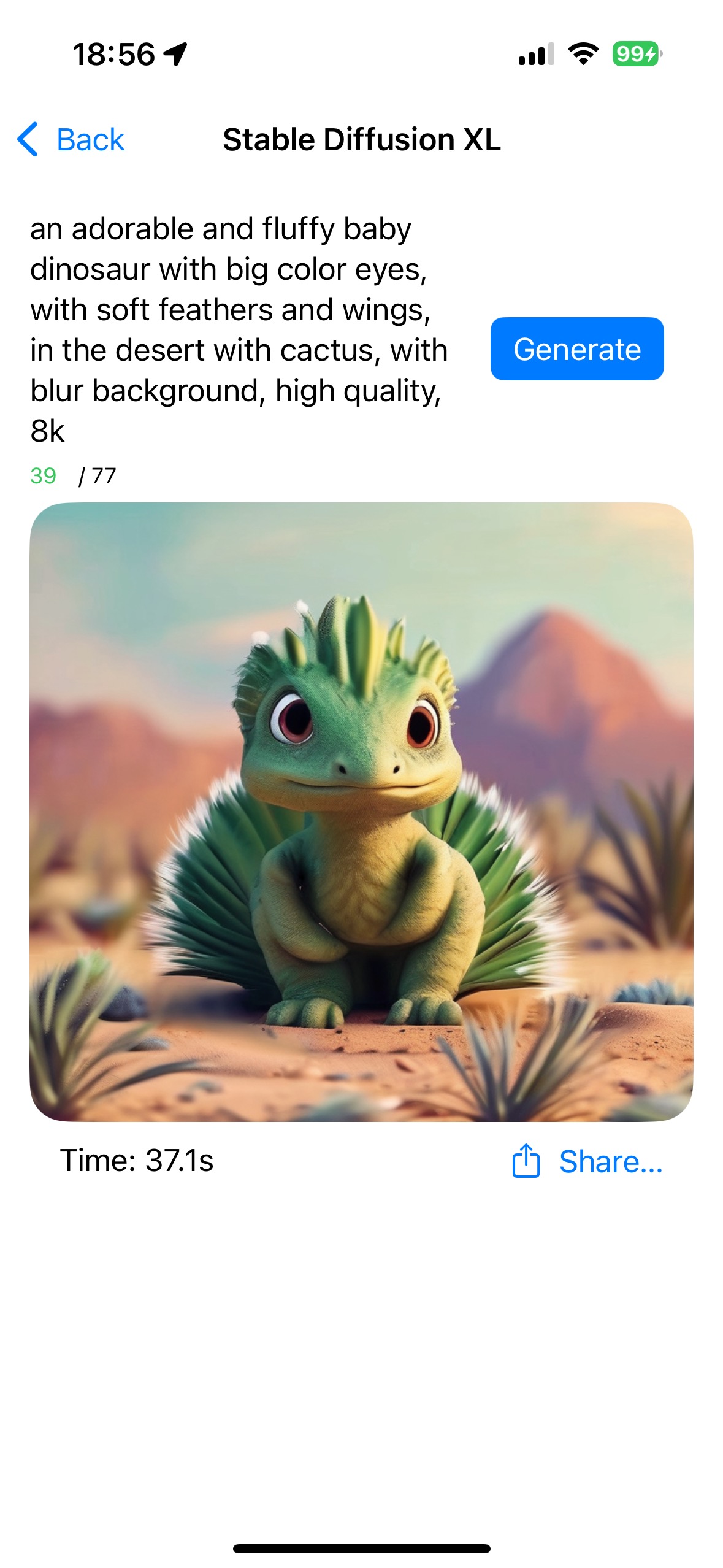

Difusão Estável XL

Geração de imagens no dispositivo usando Stable Diffusion XL.

Exemplos de sussurros

Kit Sussurro

Reconhecimento de fala no dispositivo usando WhisperKit.

### Próximos recursos

- Outras APIs OpenAI (por exemplo, incorporações, imagens, áudio, etc.)

- LLMs locais

- Outros modelos Whisper

- Google Gemini (SDK para iOS)

- Outros modelos de difusão estável

- iOS 18 / Inteligência Apple

- Genmoji

- Ferramentas de escrita

- Parque de imagens