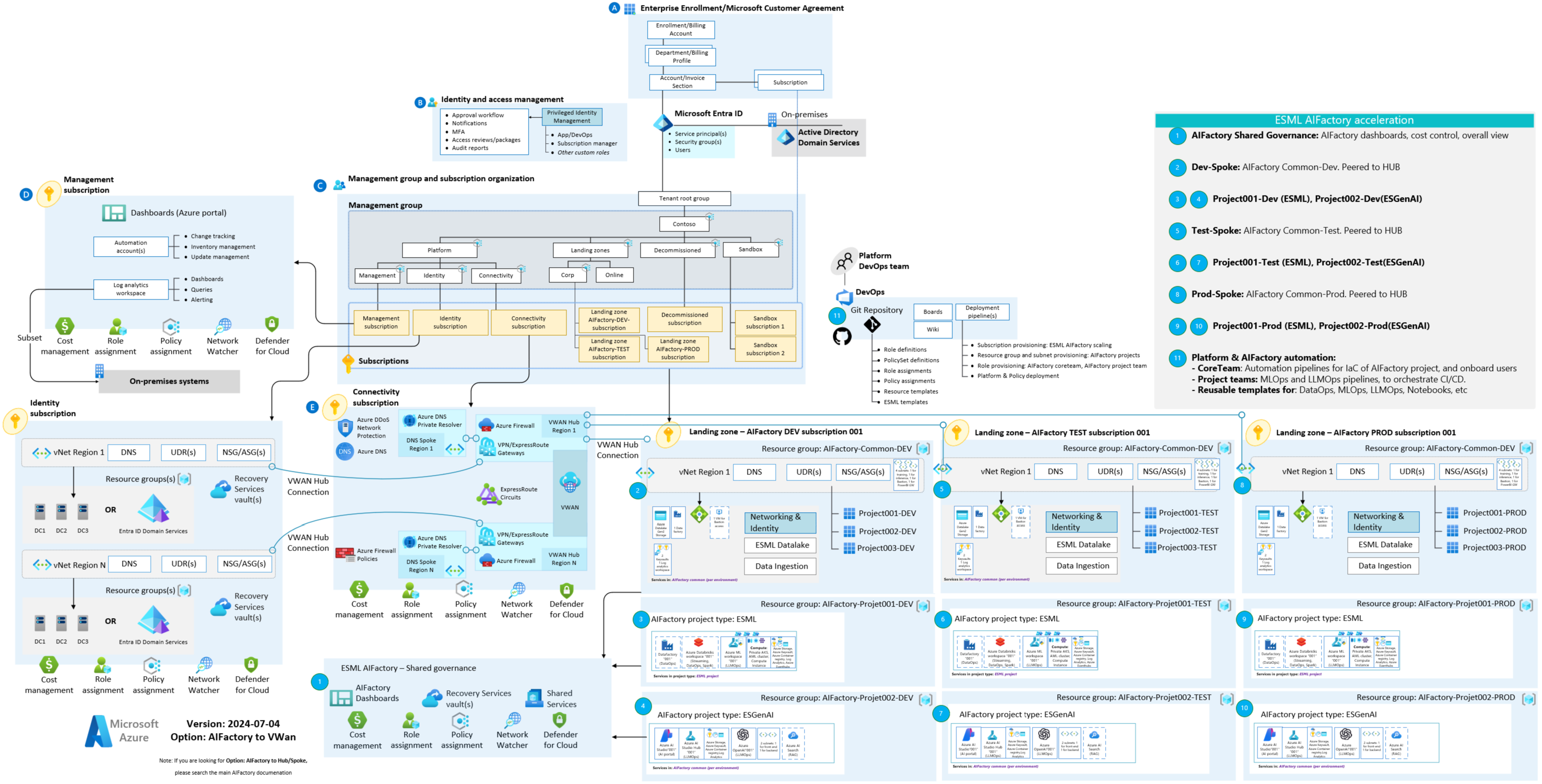

O Enterprise Scale AI Factory é uma solução plug and play que automatiza o provisionamento, a implantação e o gerenciamento de projetos de IA no Azure com um modelo de trabalho.

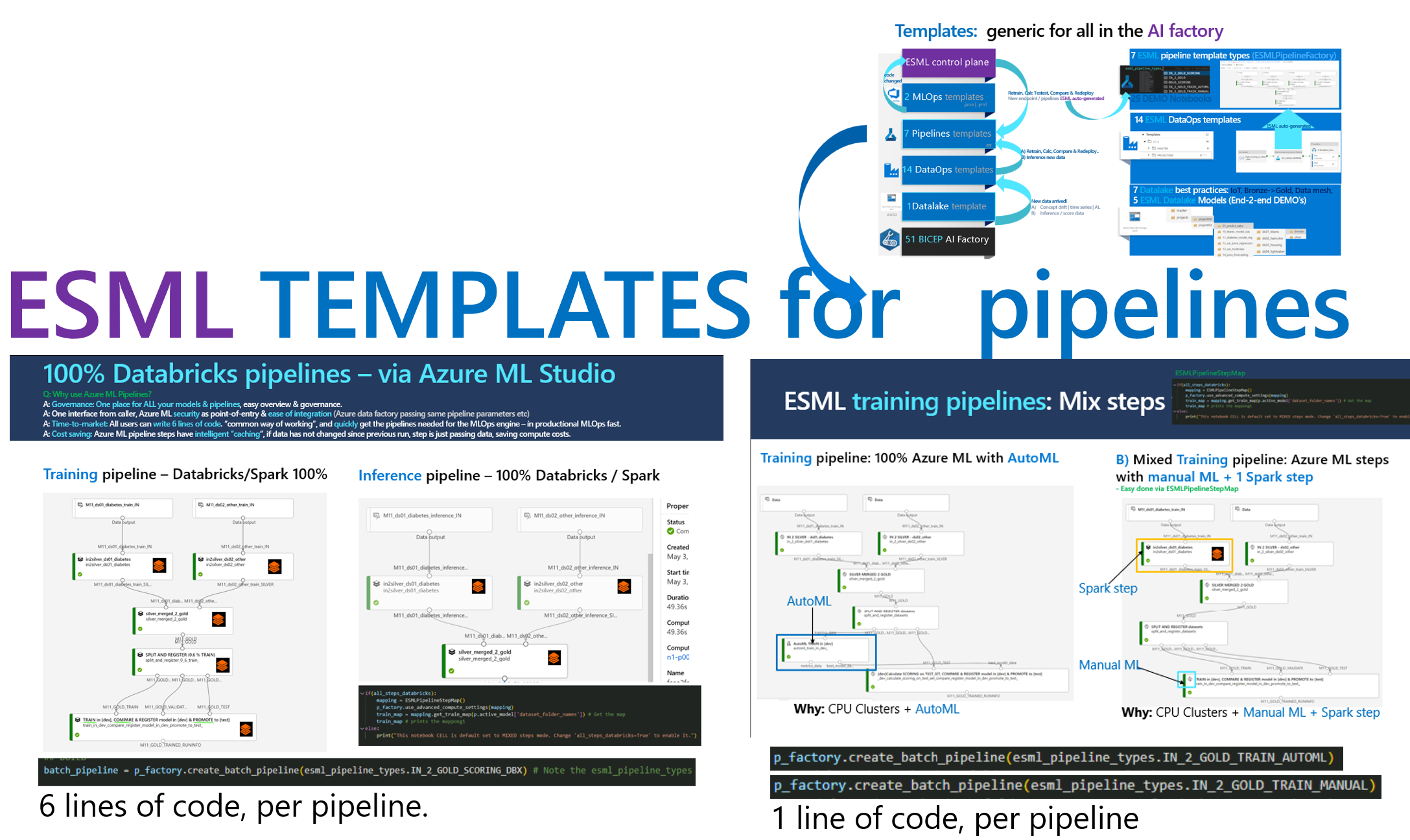

Marry multiple best practices & accelerators: ele reutiliza vários aceleradores/arquitetura de zona de destino existentes da Microsoft e práticas recomendadas, como CAF e WAF, e fornece uma experiência ponta a ponta, incluindo ambientes de desenvolvimento, teste e produção.PRIVATE : pontos finais privados para todos os serviços, como Azure Machine Learning, cluster AKS privado, registo de contentores privados, armazenamento, fábrica de dados Azure, monitorização, etc.Plug-and-play : crie infra-recursos dinamicamente por equipe, incluindo rede dinamicamente e RBAC dinamicamenteTemplate way of working & Project way of working: O AI Factory é project based (controle de custos, privacidade, escalabilidade por projeto) e fornece vários modelos além do modelo de infraestrutura: DataLake template, DataOps templates, MLOps templates , com tipos de projeto selecionáveis.Same MLOps - os cientistas de dados meteorológicos escolhem trabalhar no Azure Databricks ou no Azure Machine Learning` - o mesmo modelo de MLOps é usado.Common way of working, common toolbox, a flexible one : Uma caixa de ferramentas com arquitetura LAMBDA com ferramentas como: Azure Datafactory, Azure Databricks, Azure Machine Learning, Eventhubs, AKSEnterprise scale & security & battle tested : Usado por clientes e parceiros com MLOps desde 2019 (consulte LINKS) para acelerar o desenvolvimento e a entrega de soluções de IA, com ferramentas comuns e combinando várias práticas recomendadas. Rede privada (endpoints privados), como padrão. AI factory - setup in 60h (Company: Epiroc) - Pipelines End-2-End para caso de uso: Como fazer

AI factory - BLOG Técnico

Microsoft: AI Factory (CAF/MLOps) : Operações de aprendizado de máquina - Estrutura de adoção de nuvem | Microsoft Aprenda

Microsoft: AI Factory (Well-architected framework) : Carga de trabalho WAF AI - Estrutura bem arquitetada | Microsoft Aprenda

Os 2 tipos de projeto residem dentro das zonas de pouso do AIFactory.

A documentação é organizada em torno de ROLES via série Doc.

| Série de documentos | Papel | Foco | Detalhes |

|---|---|---|---|

| 10-19 | CoreTeam | Governance | Configuração da fábrica de IA. Governança. Infraestrutura, redes. Permissões |

| 20-29 | CoreTeam | Usage | Integração do usuário e uso do AI Factory. DataOps para a equipe de ingestão de dados do CoreTeam |

| 30-39 | ProjectTeam | Usage | Dashboard, ferramentas e serviços disponíveis, DataOps, MLOps, opções de acesso ao AIFactory privado |

| 40-49 | All | FAQ | Várias perguntas frequentes. Por favor, veja aqui antes de entrar em contato com um mentor do ESML AIFactory. |

Também é organizado através dos quatro componentes da ESML AIFactory:

| Componente | Papel | Série de documentos |

|---|---|---|

| 1) Infra:AIFábrica | Equipe principal | 10-19 |

| 2) Modelo Datalake | Todos | 20-29,30-39 |

| 3) Modelos para: DataOps, MLOps, *GenAIOps | Todos | 20-29, 30-39 |

| 4) Aceleradores: ESML SDK (Python, PySpark), RAG Chatbot, etc. | Equipe do Projeto | 30-39 |

LINK para a documentação

CAF/AI Factory : https://docs.microsoft.com/en-us/azure/cloud-adoption-framework/ready/azure-best-practices/ai-machine-learning-mlops#mlops-at- fábricas de IA em escala organizacionalMicrosoft Intelligent Data Platform : https://techcommunity.microsoft.com/t5/azure-data-blog/microsoft-and-databricks-deepen-partnership-for-modern-cloud/ba-p/3640280Modern data architecture with Azure Databricks and Azure Machine Learning : https://docs.microsoft.com/en-us/azure/architecture/solution-ideas/articles/azure-databricks-modern-analytics-architectureDatalake design : https://docs.microsoft.com/en-us/azure/storage/blobs/data-lake-storage-best-practicesDatamesh : https://martinfowler.com/articles/data-mesh-principles.htmlESML AI Factory .Enterprise "cockpit" para TODOS os seus projetos e modelos.state um projeto está (estados de desenvolvimento, teste e produção) com cost dashboard por projeto/ambiente| Data | Categoria | O que | Link |

|---|---|---|---|

| 2024-03 | Automação | Adicionar membro da equipe principal | 26-add-esml-coreteam-member.ps1 |

| 2024-03 | Automação | Adicionar membro do projeto | 26-add-esml-project-member.ps1 |

| 2024-03 | Tutorial | Tutorial da equipe principal | 10-AIFactory-infra-subscription-resourceproviders.md |

| 2024-03 | Tutorial | Tutorial para usuário final | 01-jumphost-vm-bastion-access.md |

| 2024-03 | Tutorial | Tutorial para usuário final | 03-use_cases-where_to_start.md |

| 2024-02 | Tutorial | Instalação do usuário final Instância de computação | R01-install-azureml-sdk-v1+v2.m |

| 2024-02 | Datalake - Integração | Auto-ACL na pasta PROJECT em lakel | - |

| 2023-03 | Rede | Sem IP público: nuvem privada virtual – regras de rede atualizadas | https://learn.microsoft.com/en-us/azure/machine-learning/v1/how-to-secure-workspace-vnet?view=azureml-api-1&preserve-view=true&tabs=required%2Cpe%2Ccli |

| 2023-02 | Modelos de pipeline ESML | Azure Databricks: modelos de pipeline de treinamento e lote. Suporte 100% igual aos modelos de pipeline AML (MLOps de loop interno/externo) | - |

| 2022-08 | Infraestrutura ESML (IaC) | Bicep agora também oferece suporte a yaml | - |

| 2022-10 | MLOps ESML | Modo avançado ESML MLOps v3, suporte para etapas Spark (databricks notebooks/DatabrickStep) | - |

ESML significa: Enterprise Scale ML.

Este acelerador nasceu em 2019 devido à necessidade de acelerar DataOps e MLOps.

O acelerador era então chamado de ESML. Agora chamamos essa aceleração apenas de ESML, ou tipo de projeto = ESML, na escala Entperise AIFActory

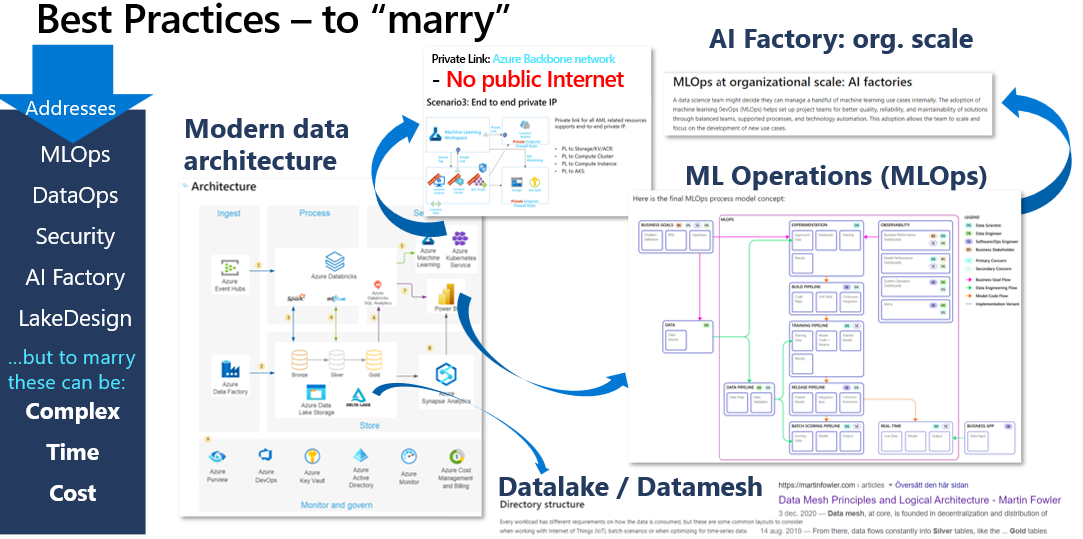

Inovando com IA e aprendizado de máquina, várias vozes expressaram a necessidade de ter uma Enterprise Scale AI & Machine Learning Platform com DataOps e MLOps end-2-end . Outros requisitos eram ter um enterprise datalake design , capaz de share refined data across the organization e high security e robustez: apenas tecnologia geral disponível, suporte vNet para pipelines e dados com terminais privados. Uma plataforma segura, com abordagem de fábrica para construção de modelos.

Even if best practices exists, it can be time consuming and complex configurar uma AI Factory solution e, ao projetar uma solução analítica, muitas vezes é desejada uma solução privada sem Internet pública, uma vez que trabalhar com dados de produção desde o primeiro dia é comum, por exemplo, já em a fase de P&D. A segurança cibernética em torno disso é importante.

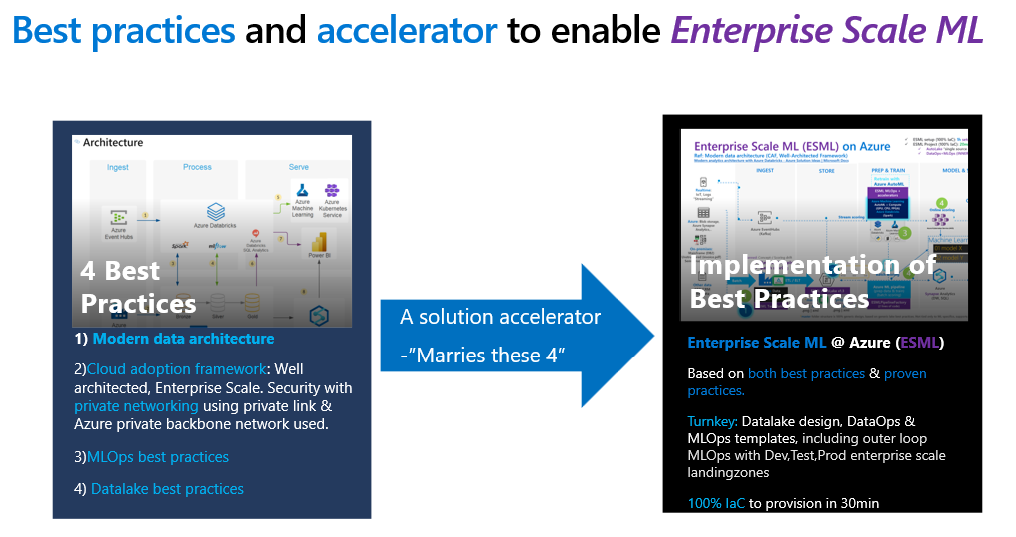

Challenge 1: Casar com vários, 4, melhores práticasChallenge 2: Desenvolvimento, Teste, Produção de ambientes Azure/assinaturas AzureChallenge 3: Turnkey: Datalake, DataOps, INNER & OUTER LOOP MLOps Além disso, a solução completa deve ser capaz de ser provisionada 100% por meio de infrastructure-as-code , ser recriada e dimensionada em várias assinaturas do Azure e project-based para escalar até 250 projetos, todos com seu próprio conjunto de serviços, como seu próprio espaço de trabalho de aprendizado de máquina do Azure e clusters de computação.

Para atender aos requisitos e desafios, várias práticas recomendadas precisaram ser combinadas e implementadas, como: CAF/WAF, MLOps, Datalake design, AI Factory, Microsoft Intelligent Data Platform / Modern Data Architecture. Uma iniciativa de código aberto poderia ajudar de uma só vez, este acelerador de código aberto Enterprise Scale ML (ESML) -

Uma iniciativa de código aberto poderia ajudar de uma só vez, este acelerador de código aberto Enterprise Scale ML (ESML) - to get an AI Factory on Azure

ESML fornece uma AI Factory mais rápida (dentro de 4 a 40 horas), com 1 a 250 ESMLProjects, um Projeto ESML é um conjunto de serviços do Azure colados com segurança.

Challenge 1 solved: Casar com vários, 4, melhores práticasChallenge 2 solved: Desenvolvimento, Teste, Produção de ambientes Azure/assinaturas AzureChallenge 3 solved: Turnkey: Datalake, DataOps, INNER & OUTER LOOP MLOps ESML marries multiple best practices em um solution accelerator , com 100% de infraestrutura como códigoVeja abaixo como era quando o ESML automatizou tanto a infraestrutura quanto a geração de pipelines de aprendizado de máquina do Azure, com 3 linhas de código.

Tipos de modelos de pipeline de TREINAMENTO E INFERÊNCIA em ESML AIFactory que aceleram para o usuário final.

Este repositório é um espelho somente push. Contate Joakim Åström para contribuições/ideias.

Como o design é "somente espelho", solicitações pull não são possíveis, exceto para administradores ESML. Consulte o arquivo LICENSE (código aberto, licença MIT). Falando em código aberto, contribuidores:

Kim Berg e Ben Kooijman pela contribuição! (parabéns à calculadora ESML IP e às adições do Bicep para o tipo de projeto esml)Christofer Högvall pela contribuição! (parabéns ao script Powershell, para habilitar provedores de recursos, se não sair)azure-enterprise-scale-mlenvironment_setupaifactorybicepesml-util26-enable-resource-providers.ps1