Por favor, marque CoDA com estrela e compartilhe-o. Obrigado

[Artigo] [Página do Projeto]

Yang Cao, Yihan Zeng, Hang Xu, Dan Xu

Universidade de Ciência e Tecnologia de Hong Kong

Laboratório Arca de Noé da Huawei

Atualizações

☑ Como o primeiro trabalho a introduzir o 3D Gaussian Splatting na detecção de objetos 3D, 3DGS-DET é lançado aqui!

☑ Nosso trabalho estendido CoDAv2 foi lançado, confira no arXiv!

☑ Os artigos e códigos mais recentes sobre percepção de vocabulário aberto são coletados aqui.

☑ Todos os códigos, dados e modelos pré-treinados foram divulgados!

☑ Os códigos de treinamento e teste foram divulgados.

☑ Os modelos pré-treinados foram lançados.

☑ Os conjuntos de dados SUN-RGBD de configuração de OV foram lançados.

☑ Os conjuntos de dados ScanNet de configuração de OV foram lançados.

☑ Os códigos LaTeX em papel estão disponíveis em https://scienhub.com/Yang/CoDA.

Nosso código é baseado em PyTorch 1.8.1, torchvision==0.9.1, CUDA 10.1 e Python 3.7. Pode funcionar com outras versões.

Instale também as seguintes dependências do Python:

matplotlib

opencv-python

plyfile

'trimesh>=2.35.39,<2.35.40'

'networkx>=2.2,<2.3'

scipy

Instale camadas pointnet2 executando

cd third_party/pointnet2 && python setup.py install

Instale uma implementação Cythonized de gIOU para um treinamento mais rápido.

conda install cython

cd utils && python cython_compile.py build_ext --inplace

Para atingir a configuração OV, reorganizamos o ScanNet e o SUN RGB-D originais e adotamos anotações de mais categorias. Baixe diretamente os conjuntos de dados de configuração ov que fornecemos aqui: OV SUN RGB-D e OV ScanNet. Você também pode baixá-los facilmente executando:

bash data_download.sh

Em seguida, execute o arquivo *.tar baixado:

bash data_preparation.sh

Baixe os modelos pré-treinados aqui. Então execute:

bash test_release_models.sh

bash scripts/coda_sunrgbd_stage1.sh

bash scripts/coda_sunrgbd_stage2.sh

bash run_samples.sh

Se CoDA for útil, cite:

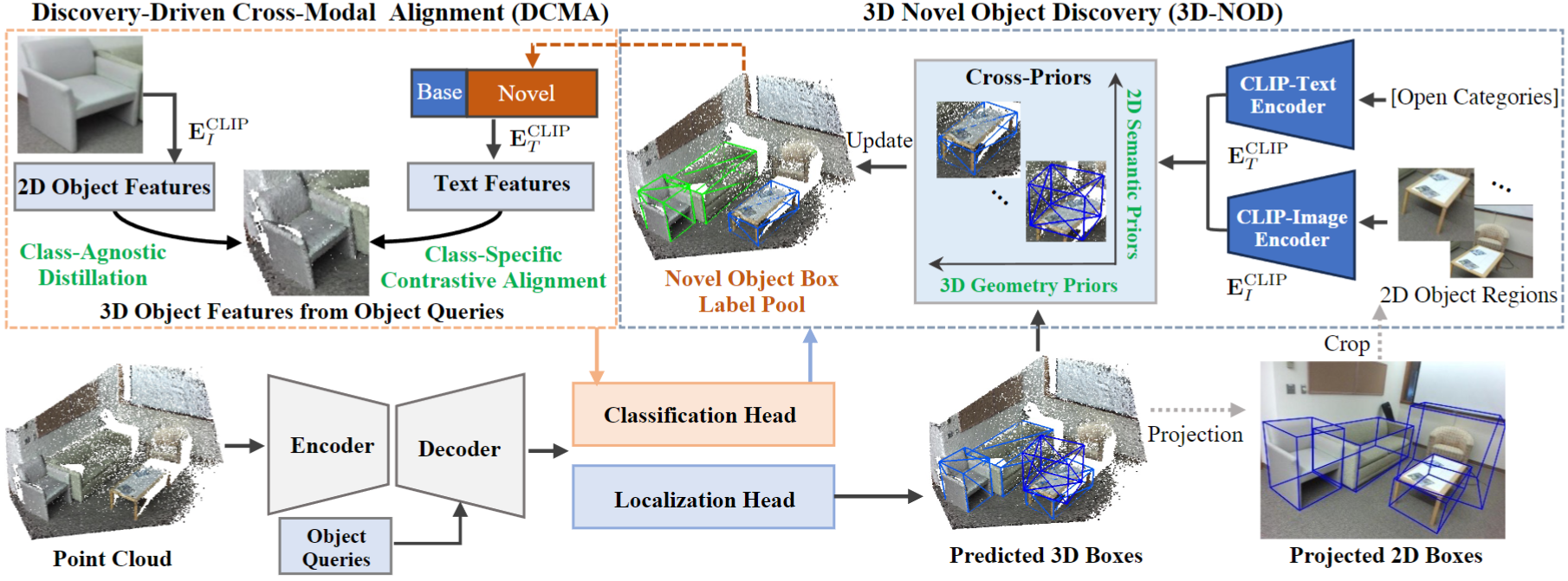

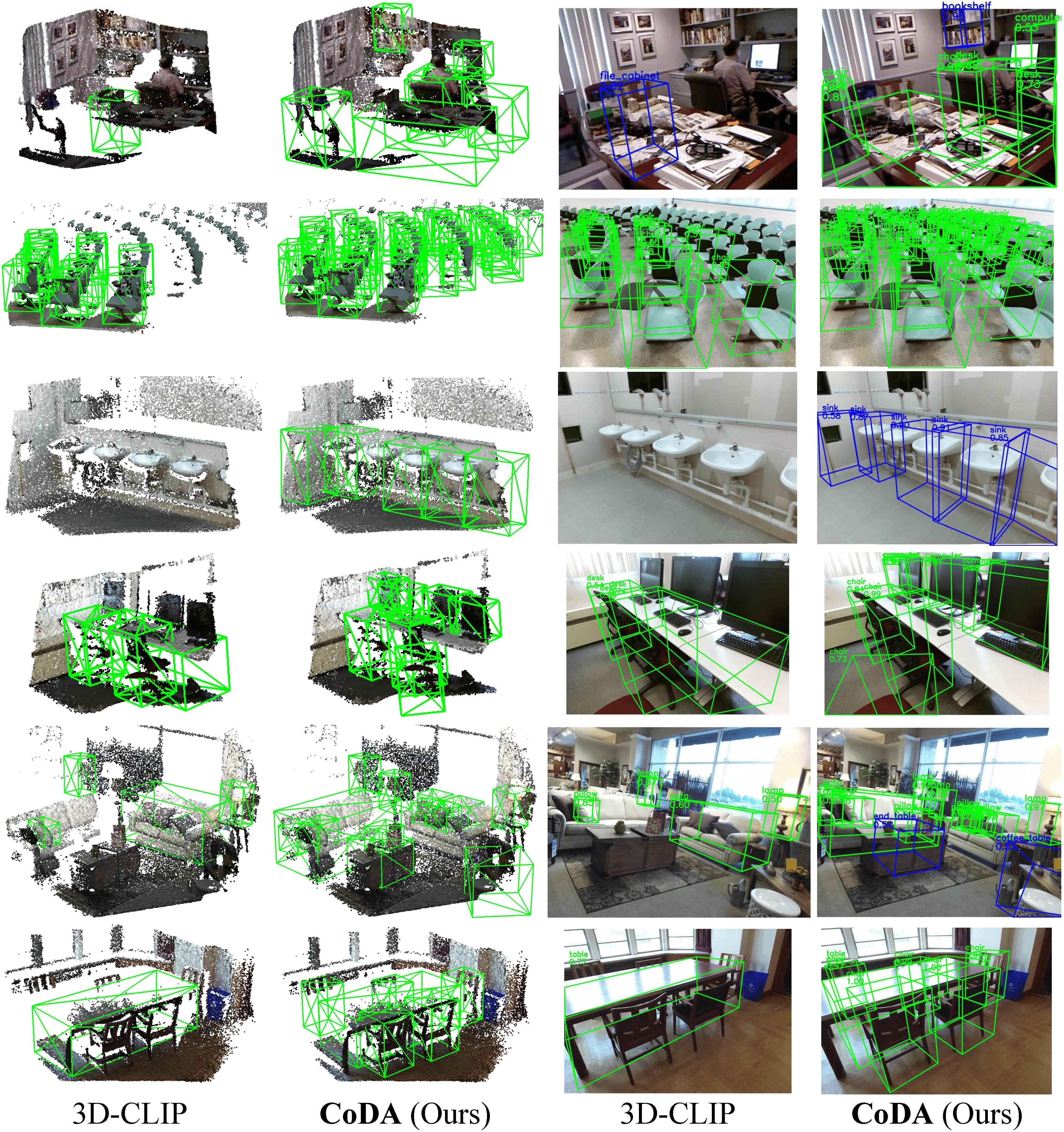

@inproceedings{cao2023coda,

title={CoDA: Collaborative Novel Box Discovery and Cross-modal Alignment for Open-vocabulary 3D Object Detection},

author={Cao, Yang and Zeng, Yihan and Xu, Hang and Xu, Dan},

booktitle={NeurIPS},

year={2023}

}

@misc{cao2024collaborative,

title={Collaborative Novel Object Discovery and Box-Guided Cross-Modal Alignment for Open-Vocabulary 3D Object Detection},

author={Yang Cao and Yihan Zeng and Hang Xu and Dan Xu},

year={2024},

eprint={2406.00830},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2406.00830},

}

Se você tiver alguma dúvida ou necessidade de colaboração (fins de pesquisa ou fins comerciais), envie um e-mail para [email protected] .

CoDA é inspirado em CLIP e 3DETR. Agradecemos seus ótimos códigos.