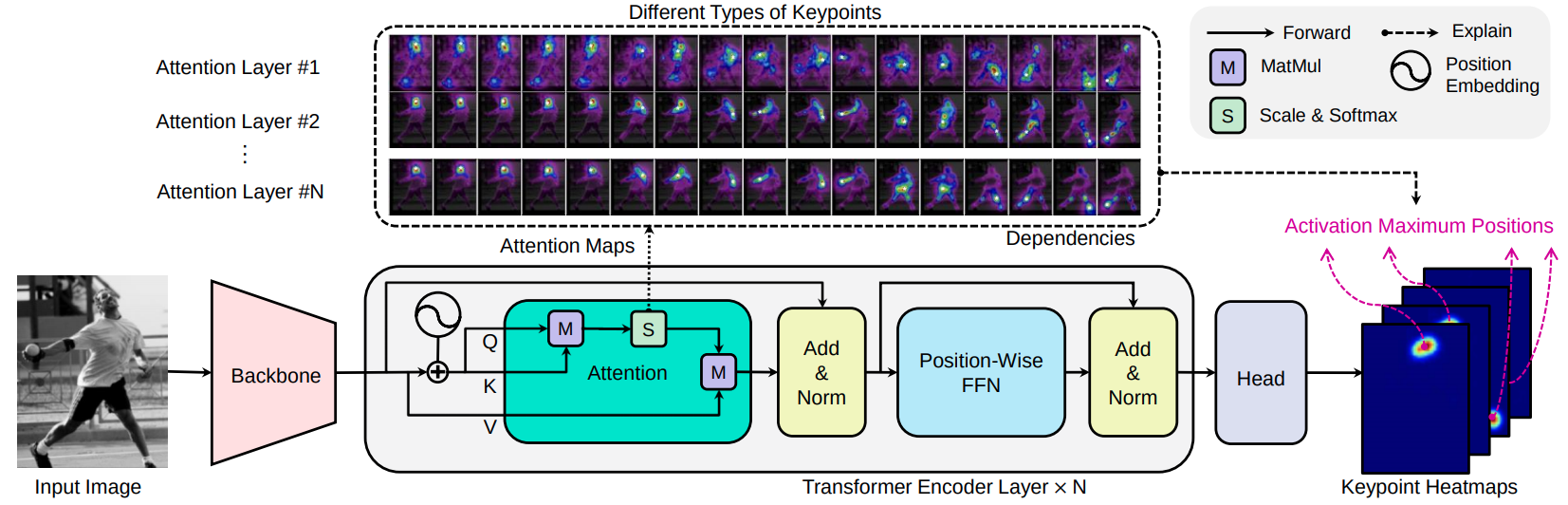

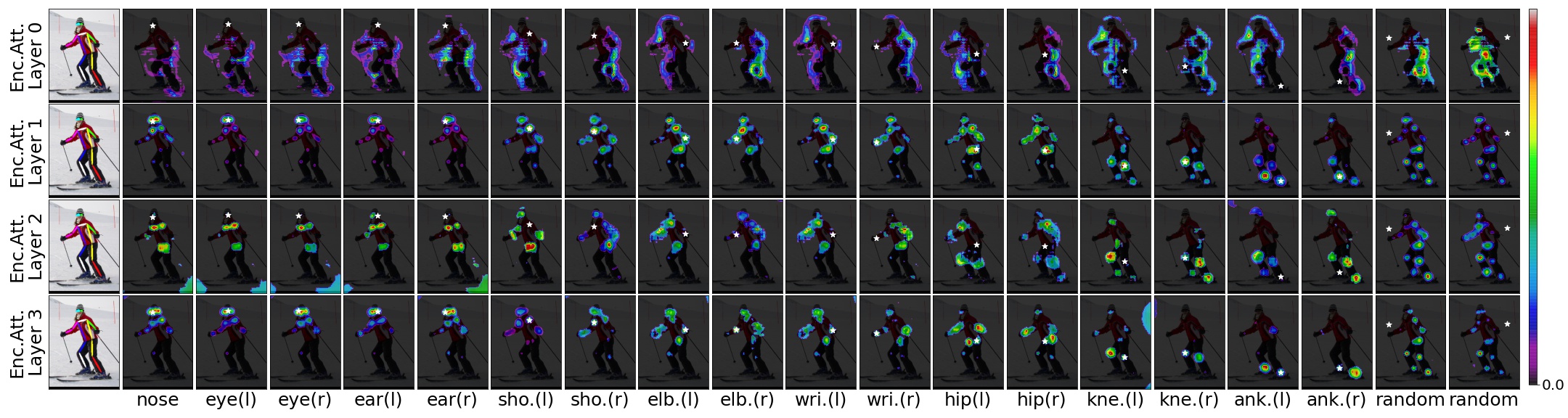

Transpost é um modelo de estimativa de pose humana baseado em um extrator de recurso CNN, um codificador de transformador e uma cabeça de previsão. Dada uma imagem, as camadas de atenção incorporadas em transformador podem capturar eficientemente as relações espaciais de longo alcance entre os pontos-chave e explicar em que dependências os locais de pontos de chave previstos dependem muito.

[Arxiv 2012.14214] [Paper] [Demo-Notebook]

Transposição: Localização do ponto -chave via Transformer, Sen Yang, Zhibin Quan, Mu Nie, Wankou Yang, ICCV 2021

Escolhemos dois tipos de CNNs como candidatos a backbone: Resnet e HRNET. Os blocos convolucionais derivados são resmatados, hrnet-small-w32 e hrnet-small-w48.

| Modelo | Espinha dorsal | #Camadas de patrimônio | d | h | #Cabeças | #Params | AP (Coco Val Gt Bbox) | Download |

|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | Resnet-S | 3 | 256 | 1024 | 8 | 5,2 MB | 73.8 | modelo |

| Transpose-R-A4 | Resnet-S | 4 | 256 | 1024 | 8 | 6,0 MB | 75.1 | modelo |

| Transposição-hs | HRNET-S-W32 | 4 | 64 | 128 | 1 | 8,0 MB | 76.1 | modelo |

| Transpose-H-A4 | HRNET-S-W48 | 4 | 96 | 192 | 1 | 17,3 MB | 77.5 | modelo |

| Transpose-H-A6 | HRNET-S-W48 | 6 | 96 | 192 | 1 | 17,5 MB | 78.1 | modelo |

Experimente a demonstração da web:

Você pode carregar diretamente os modelos transpostos-r-a4 ou transpostos-h-A4 com pesos pré-terenciados no conjunto de dados Coco Train2017 do Torch Hub, simplesmente por:

import torch

tpr = torch . hub . load ( 'yangsenius/TransPose:main' , 'tpr_a4_256x192' , pretrained = True )

tph = torch . hub . load ( 'yangsenius/TransPose:main' , 'tph_a4_256x192' , pretrained = True )| Modelo | Tamanho de entrada | FPS* | GFLOPS | AP | AP .5 | AP .75 | AP (M) | AP (L) | Ar | Ar .5 | AR .75 | BRAÇO) | AR (L) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transpose-R-A3 | 256x192 | 141 | 8.0 | 0,717 | 0,889 | 0,788 | 0,680 | 0,786 | 0,771 | 0,930 | 0,836 | 0,727 | 0,835 |

| Transpose-R-A4 | 256x192 | 138 | 8.9 | 0,726 | 0,891 | 0,799 | 0,688 | 0,798 | 0,780 | 0,931 | 0,845 | 0,735 | 0,844 |

| Transposição-hs | 256x192 | 45 | 10.2 | 0,742 | 0,896 | 0,808 | 0,706 | 0,810 | 0,795 | 0,935 | 0,855 | 0,752 | 0,856 |

| Transpose-H-A4 | 256x192 | 41 | 17.5 | 0,753 | 0,900 | 0,818 | 0,717 | 0,821 | 0,803 | 0,939 | 0,861 | 0,761 | 0,865 |

| Transpose-H-A6 | 256x192 | 38 | 21.8 | 0,758 | 0,901 | 0,821 | 0,719 | 0,828 | 0,808 | 0,939 | 0,864 | 0,764 | 0,872 |

Observação:

| Modelo | Tamanho de entrada | #Params | GFLOPS | AP | AP .5 | AP .75 | AP (M) | AP (L) | Ar | Ar .5 | AR .75 | BRAÇO) | AR (L) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transposição-hs | 256x192 | 8,0m | 10.2 | 0,734 | 0,916 | 0,811 | 0,701 | 0,793 | 0,786 | 0,950 | 0,856 | 0,745 | 0,843 |

| Transpose-H-A4 | 256x192 | 17,3m | 17.5 | 0,747 | 0,919 | 0,822 | 0,714 | 0,807 | 0,799 | 0,953 | 0,866 | 0,758 | 0,854 |

| Transpose-H-A6 | 256x192 | 17,5m | 21.8 | 0,750 | 0,922 | 0,823 | 0,713 | 0,811 | 0,801 | 0,954 | 0,867 | 0,759 | 0,859 |

Demobook Jupyter

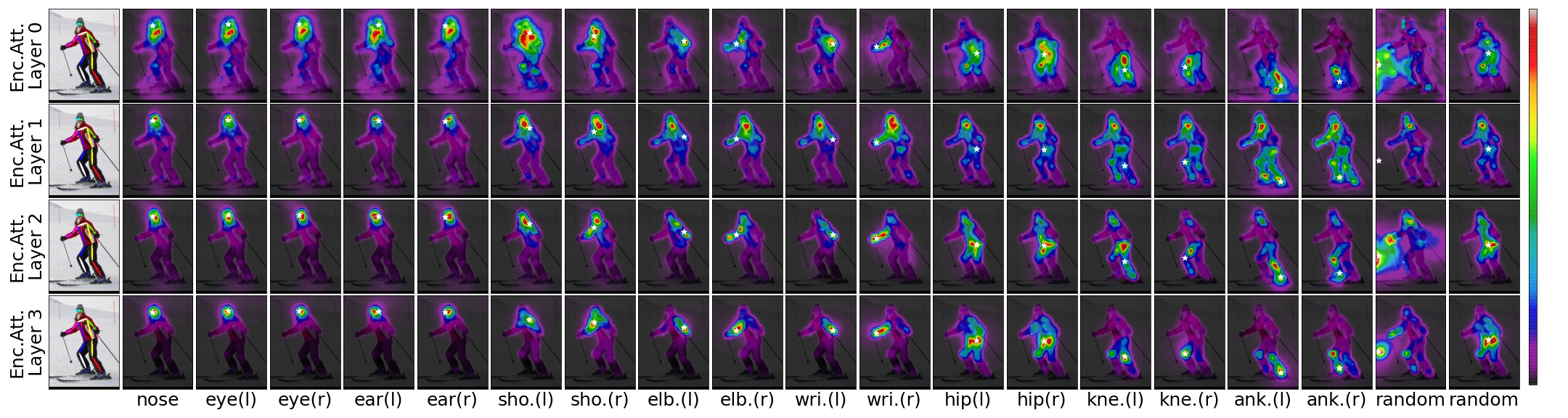

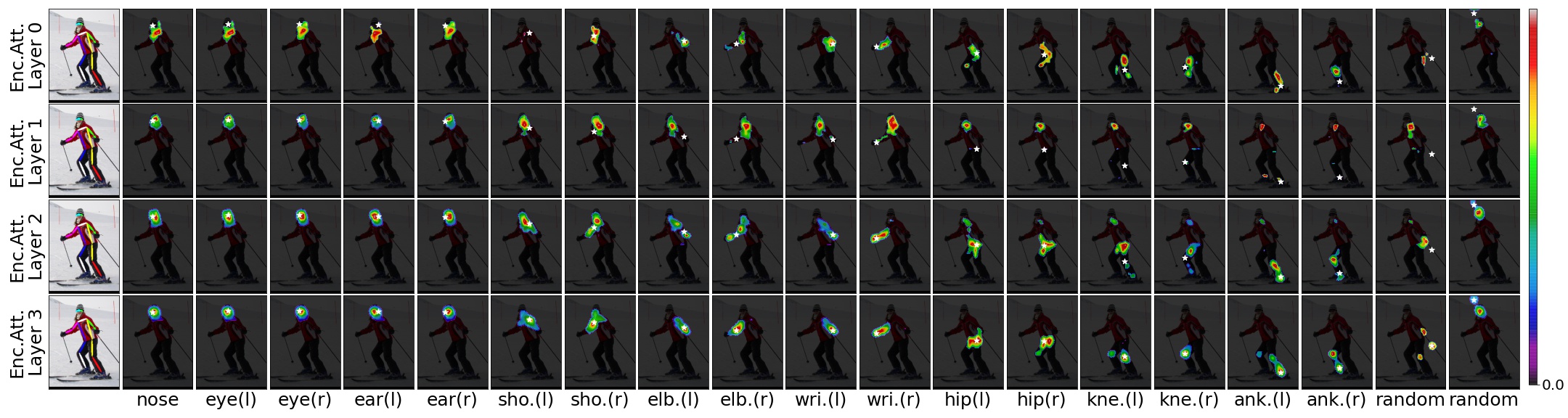

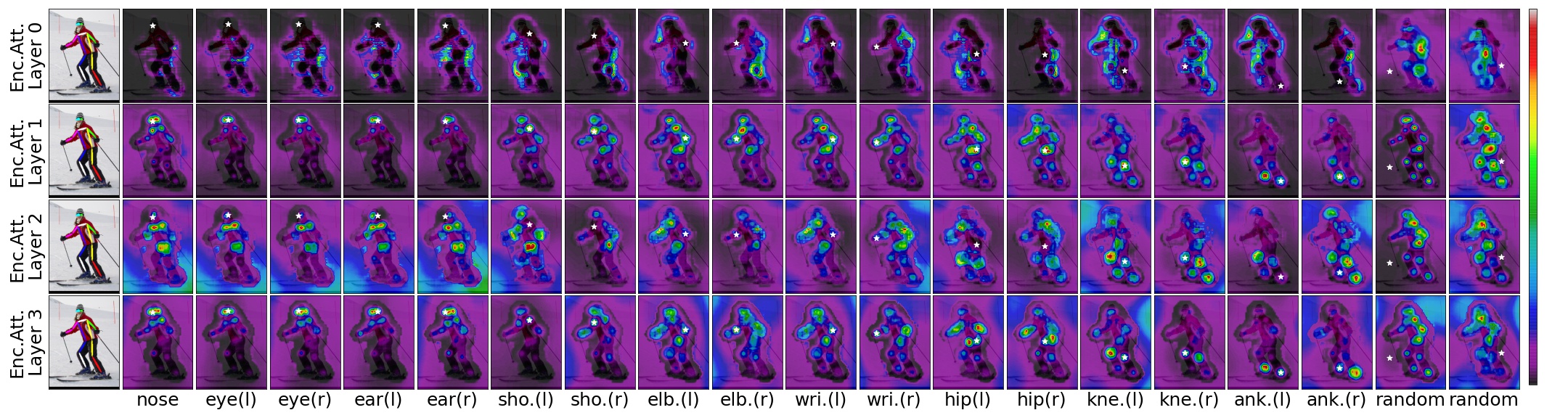

Dada uma imagem de entrada, um modelo de transposição pré -terenciosa e os locais previstos, podemos visualizar as dependências espaciais dos locais previstos com limiar para as pontuações de atenção.

TransPose-R-A4 com threshold=0.00

TransPose-R-A4 com threshold=0.01

TransPose-H-A4 com threshold=0.00

TransPose-H-A4 com threshold=0.00075

Clone este repositório e chamaremos o diretório que você clonou como $ {Pose_root}

git clone https://github.com/yangsenius/TransPose.gitInstale Pytorch> = 1.6 e Torchvision> = 0.7 do site oficial da Pytorch

Instale dependências do pacote. Verifique se o ambiente python> = 3.7

pip install -r requirements.txtFaça diretórios de saída (modelos de treinamento e arquivos) e log (log de tensorboard) sob $ {Pose_root} e faça libs

mkdir output log

cd ${POSE_ROOT} /lib

makeFaça o download de modelos pré -ridados dos lançamentos deste repositório para o diretório especificado

$ {POSE_ROOT}

`-- models

`-- pytorch

|-- imagenet

| |-- hrnet_w32-36af842e.pth

| |-- hrnet_w48-8ef0771d.pth

| |-- resnet50-19c8e357.pth

|-- transpose_coco

| |-- tp_r_256x192_enc3_d256_h1024_mh8.pth

| |-- tp_r_256x192_enc4_d256_h1024_mh8.pth

| |-- tp_h_32_256x192_enc4_d64_h128_mh1.pth

| |-- tp_h_48_256x192_enc4_d96_h192_mh1.pth

| |-- tp_h_48_256x192_enc6_d96_h192_mh1.pth Seguimos as etapas do HRNET para preparar o conjunto de dados do Coco Train/Val/Test e as anotações. Os resultados da pessoa detectada são baixados do OneDrive ou Googledrive. Faça o download ou vincule -os a $ {pose_root}/dados/coco/e faça com que eles se pareçam com o seguinte:

$ {POSE_ROOT}/data/coco/

| -- annotations

| |-- person_keypoints_train2017.json

| `-- person_keypoints_val2017.json

| -- person_detection_results

| |-- COCO_val2017_detections_AP_H_56_person.json

| `-- COCO_test-dev2017_detections_AP_H_609_person.json

`-- images

|-- train2017

| |-- 000000000009.jpg

| |-- ...

`-- val2017

|-- 000000000139.jpg

|-- ... python tools/test.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yaml TEST.USE_GT_BBOX Truepython tools/train.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yamlMuito obrigado por esses documentos e seus códigos de código aberto: hrnet, detrr, darkpose

Este repositório é liberado sob a licença do MIT.

Se você achar esse repositório útil, por favor, dê uma estrela? Ou considere citar nosso trabalho:

@inproceedings{yang2021transpose,

title={TransPose: Keypoint Localization via Transformer},

author={Yang, Sen and Quan, Zhibin and Nie, Mu and Yang, Wankou},

booktitle={IEEE/CVF International Conference on Computer Vision (ICCV)},

year={2021}

}