O campo da IA de código aberto cresceu muito nos últimos anos, mas ainda há uma lacuna em comparação com as grandes empresas de tecnologia. O poder computacional é apenas um aspecto, e o aspecto mais crítico é a falta de soluções pós-treinamento. O mais recente avanço do AI2 (antigo Allen Artificial Intelligence Institute) - programa de pós-treinamento Tülu3, fornece uma arma poderosa para preencher essa lacuna. O editor de Downcodes lhe dará uma compreensão profunda de como essa tecnologia capacita a IA de código aberto e torna grandes modelos de linguagem que originalmente eram difíceis de controlar, fáceis de usar e personalizar.

No campo da IA de código aberto, a lacuna com as grandes empresas de tecnologia não se reflete apenas no poder computacional. AI2 (anteriormente Allen Artificial Intelligence Institute) está preenchendo essa lacuna por meio de uma série de iniciativas inovadoras. Seu recém-lançado programa de pós-treinamento Tülu3 torna possível converter modelos originais de linguagem grande em sistemas práticos de IA.

Ao contrário da cognição comum, os modelos básicos de linguagem não podem ser utilizados diretamente após o pré-treinamento. Na verdade, o processo pós-treinamento é o elo fundamental que determina o valor final do modelo. É nesta fase que o modelo se transforma de uma rede omnisciente sem julgamento para uma ferramenta prática com uma orientação funcional específica.

Durante muito tempo, as grandes empresas mantiveram segredo sobre os programas pós-treinamento. Embora qualquer pessoa possa construir um modelo usando a tecnologia mais recente, são necessárias técnicas pós-treinamento exclusivas para tornar um modelo útil em campos específicos, como aconselhamento psicológico ou análise de pesquisa. Mesmo para projetos como o Llama da Meta, que é anunciado como código aberto, a fonte de seu modelo original e os métodos de treinamento comuns ainda são estritamente confidenciais.

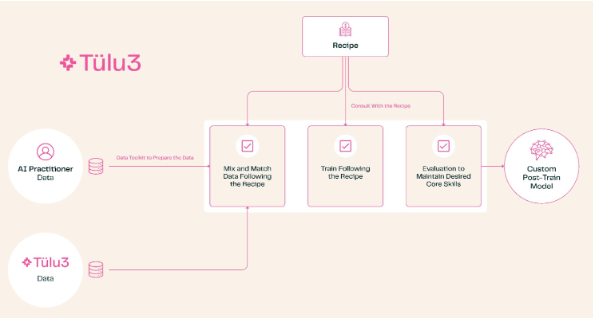

O surgimento do Tülu3 altera esta situação. Este conjunto completo de soluções pós-treinamento abrange uma gama completa de processos, desde a seleção de tópicos até o gerenciamento de dados, desde o aprendizado por reforço até o ajuste fino. Os usuários podem ajustar as capacidades do modelo de acordo com suas necessidades, como fortalecer as capacidades matemáticas e de programação ou reduzir a prioridade do processamento multilíngue.

O teste do AI2 mostra que o desempenho do modelo treinado por Tülu3 atingiu o nível dos principais modelos de código aberto. Este avanço é significativo: proporciona às empresas uma escolha totalmente autónoma e controlável. Especialmente para instituições que lidam com dados confidenciais, como pesquisas médicas, elas não precisam mais depender de APIs de terceiros ou de serviços personalizados. Elas podem concluir todo o processo de treinamento localmente, economizando custos e protegendo a privacidade.

A AI2 não só lançou esta solução, mas também assumiu a liderança na sua aplicação nos seus próprios produtos. Embora os resultados dos testes atuais sejam baseados no modelo Llama, eles têm planos de lançar um novo modelo baseado em seu próprio OLMo e treinado por Tülu3, que será uma solução verdadeiramente totalmente aberta do início ao fim.

Esta tecnologia de código aberto não só demonstra a determinação da AI2 em promover a democratização da IA, mas também injeta um impulso em toda a comunidade de IA de código aberto. Isso nos aproxima um passo de um ecossistema de IA verdadeiramente aberto e transparente.

O código aberto do Tülu3 marca um grande passo em frente no campo da IA de código aberto. Reduz o limiar para aplicações de IA, promove a justiça e a partilha de tecnologia de IA e traz possibilidades ilimitadas para o desenvolvimento futuro da IA. Esperamos ansiosamente o surgimento de mais projetos de código aberto semelhantes para construir conjuntamente um ecossistema de IA mais próspero.