Recentemente, a competição entre os gigantes da IA Google e OpenAI se intensificou. As duas partes estão competindo ferozmente no desenvolvimento e na velocidade de iteração de modelos de linguagem em grande escala. O modelo Gemini-Exp-1121 recém-lançado do Google ultrapassou o GPT-4o da OpenAI em muitos indicadores-chave, ocupando mais uma vez o primeiro lugar na competição de IA. O editor de Downcodes lhe dará uma compreensão aprofundada desta “blitz” no campo da IA, bem como dos últimos avanços em tecnologia e funcionalidade entre ambas as partes.

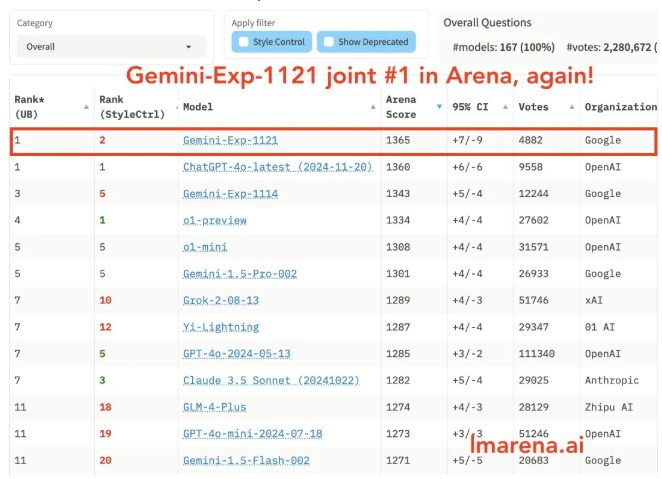

Recentemente, a competição entre Google e OpenAI esquentou novamente. Apenas um dia após a nova versão do GPT-4o liderar a lista de competição de IA, o Google lançou o mais recente modelo experimental Gemini-Exp-1121, recuperando rapidamente o campeonato. Há apenas uma semana, o Google lançou o Gemini-Exp-1114, o que parece indicar que o Google respondeu muito rapidamente à dinâmica do OpenAI.

Jack Rae, cientista-chefe do Google DeepMind, disse que se trata de uma "blitz", o que implica que a velocidade de iteração do pós-treinamento é mais rápida do que a do pré-treinamento.

De acordo com informações oficiais, o Gemini-Exp-1121 foi significativamente melhorado em muitos aspectos, refletido principalmente no aprimoramento das capacidades de codificação, capacidades de raciocínio e capacidades de compreensão visual. Além disso, este modelo atingiu um nível comparável ao atual top o1-preview e ao New Sonnet3.5 no controle de estilo de palavras de prompt complexas.

Em testes reais, o Gemini-Exp-1121 também teve um desempenho melhor do que a nova versão do GPT-4o no manuseio da compreensão dos quadrinhos. Suas respostas foram mais abrangentes e pôde usar legendas com clareza e ênfase ousada para apresentar as informações. Na clássica questão de raciocínio lógico do Animal Crossing River, a resposta do Gemini-Exp-1121 foi completamente correta, mostrando maior capacidade de raciocínio lógico. Por outro lado, a nova versão do GPT-4o cometeu alguns erros.

Ao mesmo tempo, OpenAI também está desenvolvendo ativamente novos recursos. Recentemente, o código para a função de vídeo "Live Camera" foi descoberto na versão mais recente do ChatGPT, que marca seu progresso no reconhecimento de voz e visual. Os usuários do OpenAI também experimentarão esse recurso pela primeira vez ao usar o Modo de Fala Avançado, mostrando sua intenção de expandir o uso desse recurso no futuro.

É previsível que no próximo ano o principal método de comunicação com o Chatbot possa mudar gradualmente do diálogo de texto tradicional para a voz e serviços de agente mais inteligentes. Esta mudança pode ser liderada pelo lançamento da função “câmara ao vivo”.

Esta competição de IA ainda continua, com Google e OpenAI perseguindo-se, indicando que a tecnologia de IA continuará a fazer avanços e inovações no futuro, trazendo serviços mais convenientes e inteligentes aos usuários. Vamos esperar e ver quem vai ganhar no final!