O rápido desenvolvimento da IA generativa trouxe conveniência, mas também trouxe o problema da proliferação de informações falsas. Para resolver esse problema, a Microsoft lançou uma nova ferramenta chamada Correção, projetada para corrigir informações incorretas em conteúdo gerado por IA. O editor de Downcodes levará você a um conhecimento aprofundado dos princípios, aplicações e desafios desta ferramenta.

Hoje, com o rápido desenvolvimento da inteligência artificial, embora a IA generativa tenha trazido muitas conveniências, as informações falsas que gera também se tornaram um problema que não pode ser ignorado. Em resposta a este desafio, a gigante tecnológica Microsoft lançou recentemente uma nova ferramenta chamada Correction, que foi concebida para corrigir informações falsas em conteúdo gerado por IA.

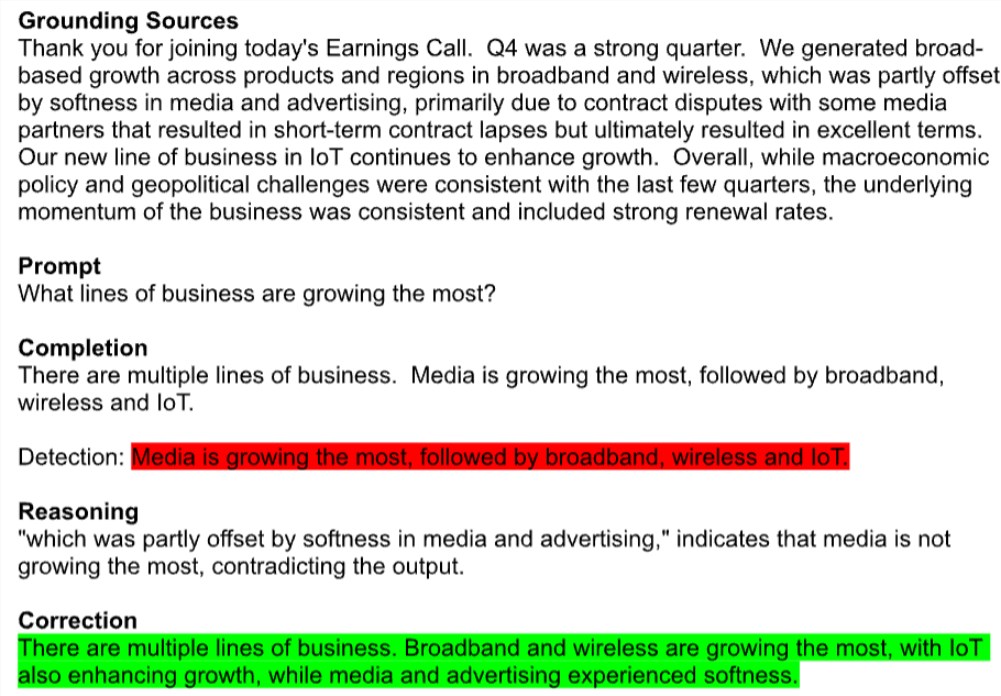

A correção está atualmente em versão prévia como parte da API Azure AI Content Security da Microsoft. A ferramenta sinaliza automaticamente textos potencialmente errados, como resumos de lucros trimestrais de empresas citados incorretamente, e os compara com fontes confiáveis para corrigir esses erros. Notavelmente, esta tecnologia funciona em todos os modelos de IA de geração de texto, incluindo Llama da Meta e GPT-4 da OpenAI.

Um porta-voz da Microsoft disse que a Correção garante que o conteúdo gerado seja consistente com documentos reais, combinando modelos de linguagem pequena com modelos de linguagem grande. Eles esperam que esse novo recurso ajude os desenvolvedores em áreas como a médica a melhorar a precisão das respostas.

No entanto, os especialistas são cautelosos. Os Keyes, estudante de doutorado na Universidade de Washington, acredita que tentar remover a ilusão de IA gerada é como tentar remover o hidrogênio da água, que é uma parte fundamental do funcionamento da tecnologia. Na verdade, os modelos de geração de texto produzem informações falsas porque na verdade não sabem nada e apenas fazem suposições com base no conjunto de treinamento. Um estudo descobriu que o ChatGPT da OpenAI apresentava uma taxa de erro de até 50% ao responder perguntas médicas.

A solução da Microsoft é identificar e corrigir essas informações falsas por meio de um par de metamodelos de edição com referências cruzadas. Um modelo de classificação procura possíveis erros, fragmentos de texto fictícios ou irrelevantes e, se estes forem detectados, um modelo de segunda língua é introduzido para tentar corrigi-los com base no documento específico subjacente.

Embora a Microsoft afirme que a correção pode aumentar significativamente a confiabilidade e a confiabilidade do conteúdo gerado por IA, os especialistas ainda têm dúvidas. Mike Cook, pesquisador da Queen Mary University, apontou que mesmo que a Correção funcione como anunciado, ela pode exacerbar os problemas de confiança e explicabilidade na IA. O serviço pode levar os usuários a uma falsa sensação de segurança, levando-os a acreditar que o modelo é mais preciso do que realmente é.

Vale ressaltar que a Microsoft também ocultou cálculos de negócios ao lançar o Correction. Embora o recurso em si seja gratuito, há um limite de uso mensal para os recursos básicos de detecção de documentos necessários para detectar desinformação, e qualquer uso adicional será cobrado.

A Microsoft está claramente sob pressão para provar o valor dos seus investimentos em IA. A empresa gastou quase 19 mil milhões de dólares em despesas de capital e equipamentos relacionados com IA no segundo trimestre deste ano, mas gerou receitas modestas com IA até agora. Recentemente, alguns analistas de Wall Street baixaram a classificação das ações da Microsoft, questionando a viabilidade da sua estratégia de IA a longo prazo.

O risco potencial de precisão e desinformação tornou-se uma das maiores preocupações das empresas quando testam ferramentas de IA. Cook concluiu que se este fosse um ciclo de vida normal do produto, a IA generativa ainda deveria estar na fase de investigação e desenvolvimento académico para continuar a melhorar e compreender os seus pontos fortes e fracos. No entanto, nós o colocamos em uso em vários setores.

A ferramenta de correção da Microsoft é, sem dúvida, uma tentativa de resolver o problema da desinformação da IA, mas ainda não se sabe se ela pode realmente quebrar a crise de confiança na IA generativa. Embora a tecnologia de IA esteja a desenvolver-se rapidamente, a forma de equilibrar a inovação e o risco tornar-se-á uma questão importante que toda a indústria enfrentará.

Em suma, o surgimento da ferramenta de correção da Microsoft marca a crescente atenção da indústria ao problema das informações falsas da IA, mas também desencadeia uma reflexão aprofundada sobre a credibilidade e o modelo de negócios da IA. No futuro, como utilizar melhor a tecnologia de IA e, ao mesmo tempo, controlar eficazmente os seus riscos será um grande desafio que todos enfrentarão.