Recentemente, o editor do Downcodes soube que, para lidar com o crescente desafio do conteúdo gerado por IA e melhorar a capacidade dos usuários de identificar a autenticidade do conteúdo, o Google anunciou que irá adicionar um novo recurso aos resultados de pesquisa. Este recurso foi projetado para ajudar os usuários a entender melhor onde as imagens são criadas e editadas, reduzindo assim o impacto negativo da desinformação e das imagens falsas. O lançamento deste recurso é um passo importante depois que o Google aderiu à Content Provenance and Authenticity Alliance (C2PA), cujos membros também incluem gigantes da tecnologia como Amazon, Adobe e Microsoft.

Recentemente, o Google anunciou que lançaria um novo recurso em seus resultados de pesquisa, projetado para ajudar os usuários a entender melhor como o conteúdo é criado e modificado. A mudança ocorre depois que o Google aderiu à Content Provenance and Authenticity Alliance (C2PA), que inclui grandes marcas, incluindo Amazon, Adobe e Microsoft, e se dedica a combater a desinformação online.

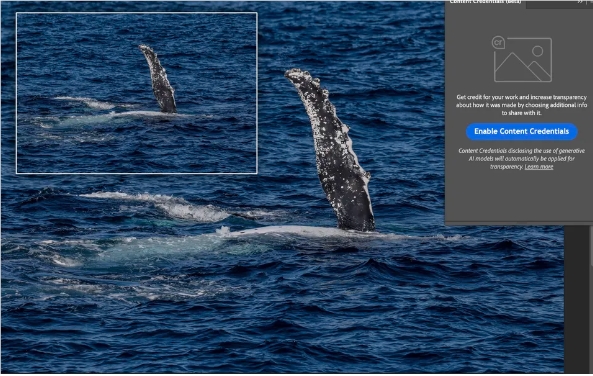

O Google disse que o novo recurso, que será lançado gradualmente nos próximos meses, aproveita o padrão atual de credenciais de conteúdo (ou seja, os metadados da imagem) para marcar imagens geradas ou editadas por IA em busca de aumentar a transparência para os usuários.

Os usuários poderão ver se ela foi gerada por IA clicando nos três pontos acima da imagem e selecionando “Sobre esta imagem”. Este recurso também estará disponível para usuários por meio do Google Lens e do recurso “Circle to Search” do Android. No entanto, é importante notar que esta tag não é muito visível, exigindo que os usuários tomem medidas extras para confirmar a origem de uma imagem.

Nos últimos anos, com o desenvolvimento da tecnologia de IA, os problemas da tecnologia de vídeo deep fake e das imagens geradas por IA tornaram-se cada vez mais sérios. Por exemplo, Trump certa vez postou uma imagem fictícia de Taylor Swift apoiando sua campanha, causando muitos mal-entendidos e controvérsias. Além disso, Taylor Swift também encontrou imagens maliciosas geradas por IA, o que levantou dúvidas sobre a autenticidade das imagens de IA.

Embora a implementação desse recurso pelo Google seja um bom começo, permanecem preocupações sobre se esse rótulo oculto é eficaz o suficiente. Muitos usuários podem não estar cientes da existência do recurso Sobre esta imagem e podem não conseguir aproveitar ao máximo esta nova ferramenta. Além disso, atualmente apenas alguns modelos de câmeras e alguns softwares implementam a função de voucher de conteúdo, o que também limita a eficácia do sistema.

De acordo com um estudo da Universidade de Waterloo, apenas 61% das pessoas conseguem distinguir entre uma imagem gerada por IA e uma imagem real, o que significa que se o sistema de marcação do Google não puder ser usado de forma eficaz, será difícil fornecer uma verdadeira transparência aos usuários.

Destaque:

O Google lançará um novo recurso para rotular imagens geradas e editadas por IA para aumentar a transparência do usuário.

Os usuários podem verificar se a imagem foi gerada pela IA por meio da função “Sobre esta imagem”, mas o rótulo não é visível.

?A pesquisa mostra que apenas 61% das pessoas conseguem distinguir imagens de IA de imagens reais, e o Google precisa aumentar a visibilidade dos rótulos.

Em suma, embora a medida da Google seja um passo importante no combate à desinformação, a sua eficácia ainda está por ver. Aumentar a visibilidade das tags e popularizar a tecnologia de vouchers de conteúdo serão orientações importantes para melhorias futuras. O editor do Downcodes continuará atento ao posterior desenvolvimento desta função e trazendo informações mais relevantes aos leitores.