O editor do Downcodes soube que um progresso significativo foi feito na área de geração de vídeo! A Genmo abriu o código-fonte de seu mais recente modelo de geração de vídeo, Mochi1, que possui 10 bilhões de parâmetros e é o maior modelo de geração de vídeo lançado publicamente atualmente. Mochi1 adota a arquitetura inovadora AsymmDiT (AsymmDiT), que é simples e fácil de modificar, proporcionando grande comodidade aos desenvolvedores da comunidade de código aberto e pode gerar vídeos de alta qualidade com até 5,4 segundos de duração e com uma taxa de quadros de até 30 quadros/segundo.

Um grande avanço ocorreu no campo da geração de vídeo! A Genmo abriu o código-fonte de seu mais recente modelo de geração de vídeo, Mochi1, estabelecendo uma nova referência no campo da geração de vídeo. Mochi1 usa a arquitetura inovadora do Transformador de Difusão Assimétrica (AsymmDiT) e possui até 10 bilhões de parâmetros, tornando-o o maior modelo de geração de vídeo lançado publicamente até o momento.

Mais importante ainda, ele é treinado totalmente do zero e possui uma arquitetura simples e modificável, o que proporciona grande comodidade aos desenvolvedores da comunidade de código aberto.

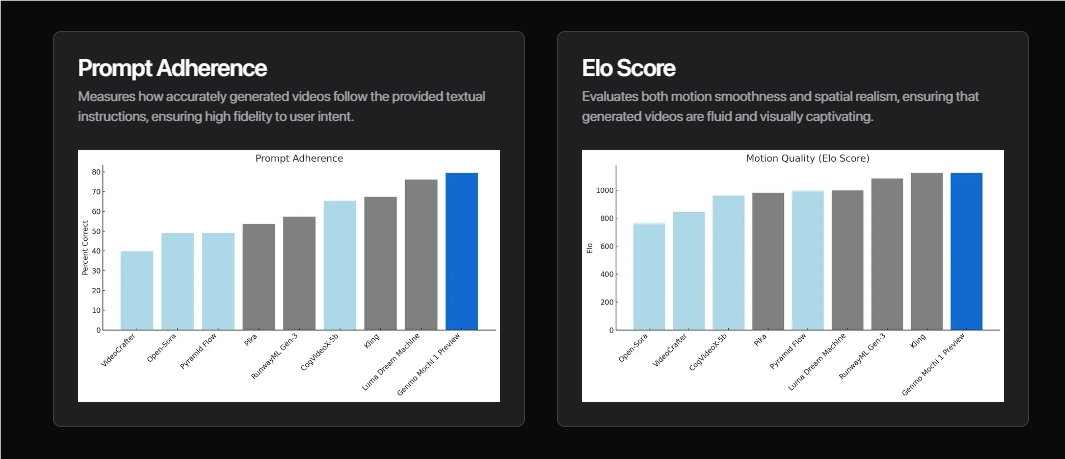

O maior destaque do Mochi1 é sua excelente qualidade de movimento e conformidade precisa com instruções de texto. É capaz de gerar vídeos suaves de até 5,4 segundos de duração com uma taxa de quadros de até 30 quadros/segundo, com coerência temporal impressionante e dinâmica de movimento realista.

Mochi1 também pode simular diversos fenômenos físicos, como dinâmica de fluidos, simulação de cabelo, etc. Os personagens que ele gera possuem movimentos naturais e suaves, quase comparáveis às performances da vida real.

Para facilitar o uso dos desenvolvedores, a Genmo também abriu o código-fonte de seu vídeo VAE, que pode compactar o vídeo para 1/128 do tamanho original, reduzindo efetivamente a quantidade de cálculo e os requisitos de memória do modelo.

A arquitetura AsymmDiT lida com eficiência com prompts do usuário e tags de vídeo compactadas por meio de um mecanismo multimodal de autoatenção e aprende camadas MLP separadas para cada modalidade, melhorando ainda mais a eficiência e o desempenho do modelo.

O lançamento do Mochi1 marca um passo importante no campo da geração de vídeo de código aberto. A empresa Genmo disse que lançará a versão completa do Mochi1 antes do final do ano, incluindo o Mochi1HD que suporta geração de vídeo 720p, altura em que a fidelidade e suavidade do vídeo serão melhoradas ainda mais.

Para permitir que mais pessoas experimentem as funções poderosas do Mochi1, a Genmo também lançou um playground hospedado gratuitamente, que os usuários podem experimentar em genmo.ai/play. Os pesos e a arquitetura do Mochi1 também foram divulgados na plataforma HuggingFace para que os desenvolvedores baixem e usem.

Genmo é composto por membros principais de projetos como DDPM, DreamFusion e Emu Video, e sua equipe de consultoria inclui Ion Stoica, presidente executivo e cofundador da Databricks e Anyscale, cofundador da Covariant e membro inicial da equipe da OpenAI; ; e líderes da indústria de sistemas de modelos de linguagem, como Joey Gonzalez, pioneiro e cofundador da Turi.

A missão do Genmo é desbloquear o lado direito do cérebro da inteligência artificial geral, e o Mochi1 é o primeiro passo na construção de um simulador mundial que pode imaginar qualquer coisa, possível ou impossível.

A Genmo concluiu recentemente uma ronda de financiamento da Série A liderada pela NEA, totalizando 28,4 milhões de dólares, que fornecerá apoio financeiro suficiente para a sua futura investigação e desenvolvimento.

Embora o Mochi1 tenha alcançado resultados impressionantes, ainda tem algumas limitações. Por exemplo, a versão inicial atualmente só pode produzir vídeo 480p, com leve distorção e distorção em alguns casos extremos de movimento extremo. Além disso, o Mochi1 está atualmente otimizado para um estilo fotorrealista e seu desempenho em conteúdo de animação precisa ser melhorado.

A Genmo afirma que continuará a melhorar o Mochi1 e incentiva a comunidade a ajustar o modelo para atender às diferentes preferências estéticas. Ao mesmo tempo, também implementaram protocolos rigorosos de auditoria de segurança nos seus parques infantis para garantir que toda a geração de vídeos é ética.

Download do modelo: https://huggingface.co/genmo/mochi-1-preview

Experiência online: https://www.genmo.ai/play

Introdução oficial: https://www.genmo.ai/blog

O código aberto do Mochi1 traz novas possibilidades para o campo da geração de vídeo, e vale a pena esperar por suas funções poderosas e uso conveniente. Os esforços contínuos da Genmo e a participação ativa da comunidade promoverão ainda mais o avanço da tecnologia de geração de vídeo. Ansioso pela chegada do Mochi1HD e pelo surgimento de conquistas mais inovadoras.