O Google anunciou recentemente que, a partir da próxima semana, o aplicativo Google Fotos adicionará logotipos de edição de IA às fotos editadas com recursos de IA, como Magic Editor, Magic Eraser e Zoom Enhance. A atualização pretendia aumentar a transparência, mas gerou polêmica. Como o logotipo é exibido apenas nos detalhes da foto, e não na foto em si, é difícil para os usuários identificarem intuitivamente os traços de edição da IA no uso diário. O editor do Downcodes interpretará isso em detalhes, analisará seus prós e contras e discutirá seu impacto no desenvolvimento futuro da tecnologia de imagem de IA.

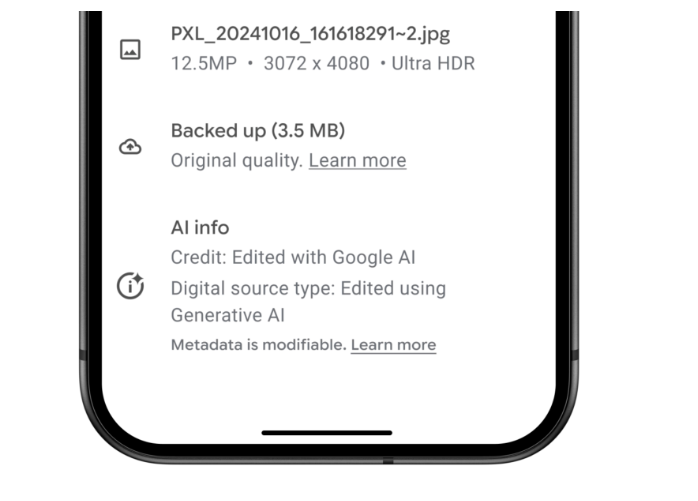

Num momento em que a tecnologia de imagem de inteligência artificial está se tornando cada vez mais popular, o Google anunciou que introduzirá uma nova função de edição de logotipo de IA no aplicativo Google Fotos a partir da próxima semana. Todas as fotos editadas usando recursos de IA, como Magic Editor, Magic Eraser e Zoom Enhance, terão anotações editadas usando Google AI exibidas na parte inferior da seção Detalhes do aplicativo.

Esta atualização ocorre mais de dois meses depois que o Google lançou o telefone Pixel 9 equipado com vários recursos de edição de fotos com IA. No entanto, este método de rotulagem causou alguma controvérsia. Embora o Google afirme que esta medida visa melhorar ainda mais a transparência, o efeito real é questionável: a foto em si não adiciona nenhuma marca d'água visual, o que significa que os usuários não podem identificá-la intuitivamente ao navegar pelas fotos nas redes sociais, mensagens instantâneas ou diariamente. essas fotos foram processadas pela IA.

Para recursos de edição de fotos como Best Take e Add Me que não usam IA generativa, o Google Fotos também anotará as informações de edição nos metadados, mas não serão exibidas na guia de detalhes. Essas funções são usadas principalmente para combinar várias fotos em uma imagem completa.

Michael Marconi, gerente de comunicações do Google Fotos, disse ao TechCrunch: O trabalho ainda não terminou. Continuaremos a coletar feedback, fortalecer e melhorar as salvaguardas de segurança e avaliar outras soluções para aumentar a transparência da edição generativa de IA. Embora a empresa não tenha deixado claro se adicionará uma marca d’água visual no futuro, ela não descartou completamente a possibilidade.

Vale ressaltar que todas as fotos atualmente editadas pela IA do Google já contêm informações de edição da IA nos metadados. O novo recurso simplesmente move essas informações para a guia Detalhes, que é mais fácil de encontrar. No entanto, o efeito real desta abordagem é preocupante, porque a maioria dos utilizadores não procura especificamente metadados ou informações detalhadas quando navegam em imagens na Internet.

É claro que adicionar uma marca d’água visível em uma moldura também não é uma solução perfeita. Essas marcas d'água podem ser facilmente cortadas ou editadas, e o problema permanece. À medida que as ferramentas de imagem de IA do Google ganham popularidade, é provável que o conteúdo sintético prolifere na Internet, tornando cada vez mais difícil para os usuários distinguir o conteúdo real do falso.

O método de marca d’água de metadados atualmente adotado pelo Google depende muito de cada plataforma para identificar conteúdo gerado por IA para os usuários. A Meta implementou essa prática no Facebook e no Instagram, e o Google planeja identificar imagens de IA nos resultados de pesquisa ainda este ano. No entanto, as medidas relevantes noutras plataformas progrediram mais lentamente.

Esta controvérsia destaca uma questão importante no desenvolvimento da tecnologia de IA: como garantir a autenticidade do conteúdo e o direito de saber dos utilizadores, ao mesmo tempo que promove a inovação tecnológica. Embora a Google tenha dado o primeiro passo para melhorar a transparência, é evidente que são necessários mais esforços e melhorias para evitar que conteúdos sintéticos enganem os utilizadores.

Embora a medida do Google pretenda aumentar a transparência, o seu efeito ainda está por ver. Como encontrar um equilíbrio entre o desenvolvimento da tecnologia de IA e a autenticidade do conteúdo é um problema difícil que todas as empresas de tecnologia enfrentam. No futuro, métodos mais eficazes de identificação de conteúdos gerados por IA são imperativos para proteger melhor os direitos e interesses dos utilizadores.