Com a explosão de conteúdos gerados por inteligência artificial, as plataformas de redes sociais enfrentam um desafio sem precedentes: como garantir que os utilizadores conseguem distinguir entre informações verdadeiras e falsas? O chefe do Instagram, Adam Mosseri, publicou recentemente uma série de postagens no Threads expressando suas preocupações sobre o conteúdo gerado por IA e apresentando as estratégias do Instagram e do Meta para lidar com esse desafio. Ele enfatizou que os usuários precisam estar mais vigilantes e aprender a identificar conteúdos gerados por IA, e apelou às plataformas para fortalecerem a supervisão dos conteúdos e melhorarem a transparência e credibilidade da informação.

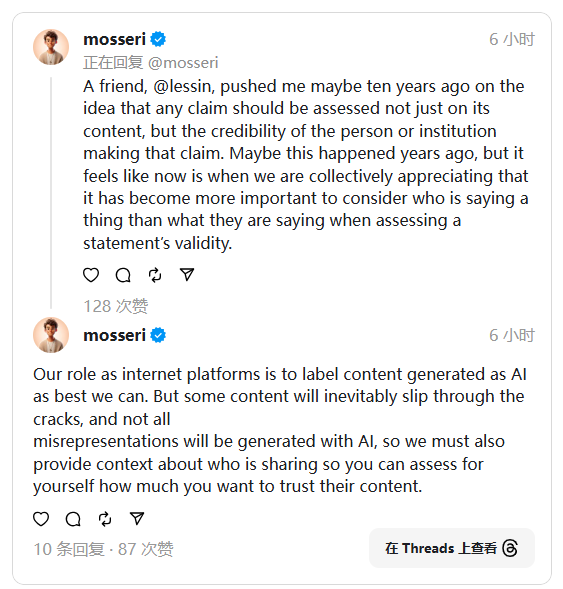

Em uma série recente de postagens no Threads, o chefe do Instagram, Adam Mosseri, enfatizou a necessidade de os usuários das redes sociais estarem mais vigilantes diante das quantidades crescentes de conteúdo gerado por IA.

Ele ressaltou que as imagens e informações que os usuários veem online podem não ser reais, porque a tecnologia de IA já pode gerar conteúdos muito semelhantes à realidade. Para ajudar os utilizadores a avaliar melhor a autenticidade das informações, Mosseri mencionou que os utilizadores devem considerar a fonte do conteúdo, e as plataformas sociais também têm a responsabilidade de apoiar isto.

Mosseri disse que o papel das plataformas de mídia social é rotular o conteúdo gerado pela IA, tanto quanto possível, para ajudar os usuários a identificá-lo. No entanto, ele também admitiu que alguns conteúdos podem ficar perdidos e não podem ser marcados a tempo. Para tanto, ele enfatizou que as plataformas também precisam fornecer informações básicas aos usuários sobre o conteúdo compartilhado, para que os usuários possam decidir melhor até que ponto confiam no conteúdo. As suas opiniões refletem profundas preocupações sobre a credibilidade das mensagens nas redes sociais.

Nesta fase, a Meta (empresa controladora do Instagram) não forneceu informações contextuais suficientes para ajudar os usuários a julgar a autenticidade do conteúdo. Ainda assim, a empresa deu a entender recentemente que pode estar a fazer alterações significativas nas suas regras de conteúdo. Espera-se que esta mudança aumente a confiança dos utilizadores na informação e os ajude a lidar melhor com os desafios colocados pela tecnologia de IA.

Mosseri mencionou que os usuários devem confirmar se as informações fornecidas pelo chatbot são confiáveis antes de confiar em um mecanismo de busca baseado em IA. Isso é semelhante a verificar a origem de uma declaração ou imagem de postagem, apenas as informações provenientes de contas confiáveis são mais confiáveis.

A abordagem de moderação de conteúdo que Mosseri descreve está mais próxima dos sistemas de moderação orientados ao usuário, como notas da comunidade no Twitter e filtros de conteúdo do YouTube. Embora não esteja claro se o Meta introduzirá recursos semelhantes, dada a experiência passada da empresa em emprestar de outras plataformas, vale a pena ficar de olho nas futuras políticas de moderação de conteúdo.

Em suma, face aos desafios trazidos pelo conteúdo gerado por IA, Instagram e Meta estão a explorar ativamente soluções, o que não só requer os esforços da própria plataforma, mas também exige que os utilizadores melhorem as suas próprias capacidades de discernimento e mantenham conjuntamente o credibilidade e segurança das informações on-line. A evolução do futuro modelo de supervisão de conteúdos merece a nossa atenção contínua.