O código aberto de grandes modelos de linguagem (LLM) promove o desenvolvimento da tecnologia de IA, mas também traz desafios na proteção da propriedade intelectual. O surgimento de modelos “shell” torna a identificação da origem do modelo um problema urgente que precisa ser resolvido. Este artigo discutirá as deficiências dos métodos de identificação de impressões digitais existentes e apresentará um novo e mais robusto método de identificação de impressões digitais - REEF, como ele pode efetivamente resolver o problema de "bombardeio" e proteger a propriedade intelectual do LLM.

Na era da IA, os grandes modelos de linguagem (LLM) são como segredos das artes marciais. O processo de treinamento consome enorme poder de computação e dados, assim como um mestre de artes marciais que pratica em reclusão por muitos anos. O lançamento do modelo de código aberto é como um mestre tornando seus segredos públicos, mas virá com algumas licenças (como a licença comunitária Apache2.0 e LLaMA2) para proteger sua propriedade intelectual (IP).

No entanto, o mundo é traiçoeiro e sempre acontecem incidentes de “bombardeios”. Alguns desenvolvedores afirmam ter treinado novos LLMs, mas na verdade eles são wrappers ou ajustes finos em outros modelos básicos (como Llama-2 e MiniCPM-V). É como aprender secretamente as artes marciais de outras pessoas, mas alegar ser sua criação original. Para evitar que isso aconteça, os proprietários de modelos e terceiros precisam de uma forma de identificar modelos “em casca”.

Existem dois tipos principais de métodos de identificação de impressão digital de modelo existente:

Impressão digital de injeção: é como marcar secretamente o livro secreto, como o método da marca d'água. Este método adiciona artificialmente alguns "gatilhos" durante o treinamento do modelo ou processo de ajuste fino, permitindo que o modelo gere conteúdo específico sob condições específicas, identificando assim a fonte do modelo. No entanto, esta abordagem aumentará os custos de treinamento, afetará o desempenho do modelo e poderá até ser removida. Além disso, este método não pode ser aplicado a modelos já publicados.

Impressão digital intrínseca: é como julgar a origem de um cheat com base em seu conteúdo e estilo. Este método utiliza as propriedades do próprio modelo para identificação, incluindo pesos do modelo e representações de recursos. Dentre eles, o método de impressão digital baseado em peso realiza a identificação calculando a similaridade dos pesos dos modelos. No entanto, este método é suscetível a alterações de peso, como permutações de peso, poda e ajuste fino. O método baseado na análise semântica realiza o reconhecimento através do texto gerado pelo modelo de análise estatística. No entanto, ambos os métodos sofrem de robustez insuficiente.

Então, existe um método que possa identificar efetivamente modelos "shell" sem afetar o desempenho do modelo e resistir a várias modificações "sofisticadas"?

Pesquisadores do Laboratório de Inteligência Artificial de Xangai e de outras instituições propuseram um novo modelo de método de identificação de impressões digitais - REEF.

O princípio de funcionamento do REEF é:

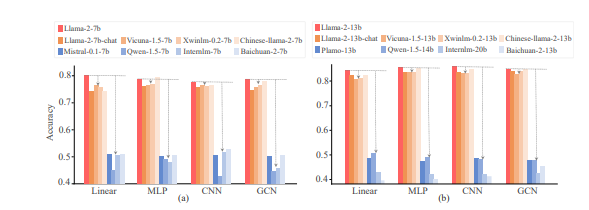

REEF é um método de identificação de impressão digital baseado na representação de recursos. Ele não depende da representação de nenhuma camada específica, mas utiliza os poderosos recursos de modelagem de representação do LLM para extrair recursos de várias camadas para reconhecimento.

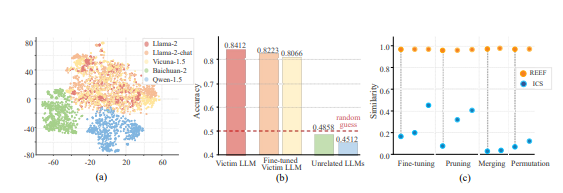

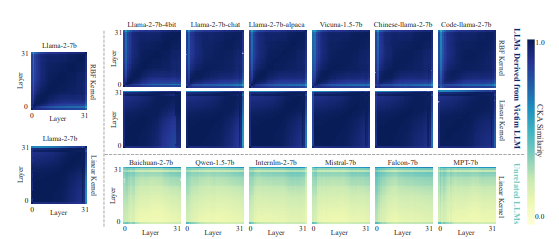

Ele compara a similaridade do alinhamento do kernel central (CKA) das representações de recursos de dois modelos na mesma amostra. O CKA é um índice de similaridade baseado no Critério de Independência de Hilbert-Schmidt (HSIC), que pode medir a independência entre dois conjuntos de variáveis aleatórias.

Se a similaridade for alta, significa que o modelo suspeito provavelmente será derivado do modelo vítima; caso contrário, é improvável;

Quais são as vantagens do REEF?

Não é necessário treinamento: Isso significa que não afeta o desempenho do modelo e não adiciona custos adicionais de treinamento.

Robustez forte: É robusto para vários desenvolvimentos subsequentes, como poda de modelo, ajuste fino, fusão, arranjo e transformações de escala. Mesmo que o modelo suspeito passe por um extenso ajuste fino (até 700 bilhões de tokens de dados), o REEF ainda pode identificar efetivamente se ele se origina do modelo vítima.

Garantia Teórica: Os pesquisadores provaram teoricamente que o CKA é invariante ao arranjo das colunas e às transformações de escala.

Os resultados experimentais mostram que o REEF tem um bom desempenho na identificação de modelos “shell”, superando os métodos existentes baseados em pesos e análise semântica.

O surgimento do REEF fornece uma nova ferramenta para proteger a propriedade intelectual do LLM e ajuda a combater comportamentos antiéticos ou ilegais, como o uso não autorizado ou a cópia de modelos.

Endereço do artigo: https://arxiv.org/pdf/2410.14273

Em suma, o método REEF fornece uma solução eficaz, robusta e eficiente para o problema de proteção da propriedade intelectual do modelo de código aberto LLM e contribui para a construção de um ambiente ecológico de IA mais saudável.