MiniMax lançou uma nova série de modelos de código aberto MiniMax-01 em 15 de janeiro de 2025, incluindo o modelo de texto grande MiniMax-Text-01 e o modelo visual multimodal grande MiniMax-VL-01. Esta série de parâmetros do modelo chega a 456 bilhões, com uma única ativação de 45,9 bilhões. Ele inova ousadamente na arquitetura e aplica pela primeira vez o mecanismo de atenção linear em larga escala, rompendo as limitações do Transformer tradicional e capaz. de processamento eficiente de contextos de até 4 milhões de tokens, significativamente à frente dos modelos existentes. A série MiniMax-01 está no mesmo nível dos principais modelos internacionais em termos de desempenho e apresenta vantagens significativas no processamento de textos longos. Suas capacidades de processamento eficientes e seu baixo preço o tornam extremamente competitivo em aplicações comerciais.

MiniMax anunciou o código aberto de sua nova série de modelos MiniMax-01 em 15 de janeiro de 2025. A série inclui o modelo grande de linguagem básica MiniMax-Text-01 e o modelo grande multimodal visual MiniMax-VL-01. A série MiniMax-01 fez inovações ousadas na arquitetura, implementando pela primeira vez um mecanismo de atenção linear em grande escala, quebrando as limitações da arquitetura tradicional do Transformer. Seu volume de parâmetros chega a 456 bilhões e uma única ativação é de 45,9 bilhões. Seu desempenho abrangente é comparável aos principais modelos estrangeiros e pode lidar com eficiência com contextos de até 4 milhões de tokens. Esse comprimento é 32 vezes maior que o do GPT-4o. e Claude-3.5-Soneto 20 vezes.

MiniMax acredita que 2025 será um ano crítico para o rápido desenvolvimento de Agentes. Quer se trate de um sistema de agente único ou de um sistema multiagente, é necessário um contexto mais longo para suportar memória contínua e grandes quantidades de comunicação. O lançamento da série de modelos MiniMax-01 é justamente para atender essa demanda e dar o primeiro passo no estabelecimento das capacidades básicas de Agentes complexos.

Graças à inovação arquitetônica, otimização de eficiência e treinamento de cluster integrado e design push, o MiniMax pode fornecer serviços de API de compreensão multimodal e de texto na faixa de preço mais baixa do setor. O preço padrão é token de entrada 1 yuan/milhão de tokens e token de saída 8. yuan/cem. 10.000 fichas. A plataforma aberta MiniMax e a versão internacional foram lançadas para os desenvolvedores experimentarem.

Os modelos da série MiniMax-01 foram de código aberto no GitHub e serão atualizados continuamente. Nas principais avaliações de texto e compreensão multimodal da indústria, a série MiniMax-01 empatou com os modelos avançados internacionalmente reconhecidos GPT-4o-1120 e Claude-3.5-Sonnet-1022 na maioria das tarefas. Especialmente para tarefas de texto longo, em comparação com o modelo Gemini do Google, o MiniMax-Text-01 apresenta a degradação de desempenho mais lenta à medida que o comprimento da entrada aumenta, o que é significativamente melhor que o Gemini.

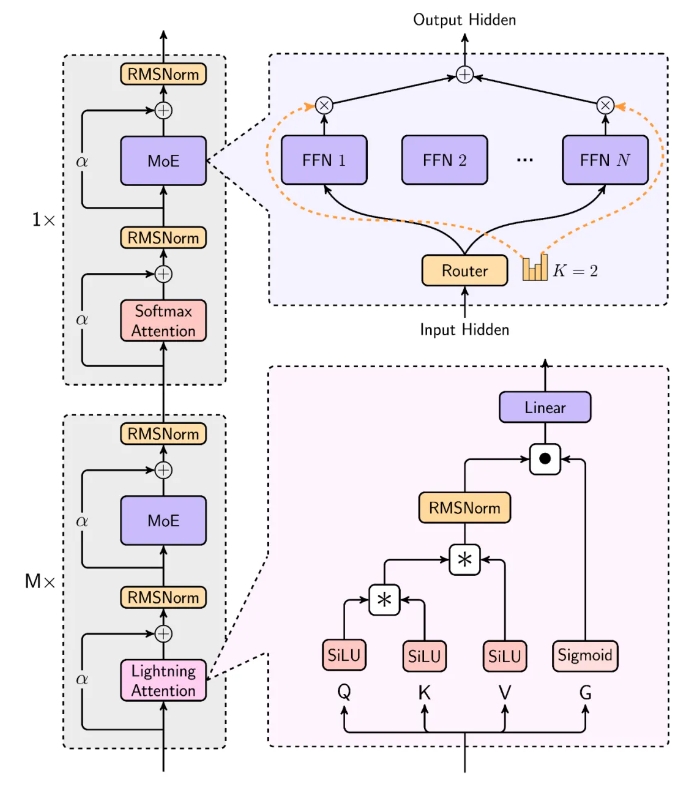

O modelo do MiniMax é extremamente eficiente no processamento de entradas longas, aproximando-se da complexidade linear. Em seu design estrutural, 7 em cada 8 camadas usam atenção linear baseada em Lightning Attention e 1 camada usa atenção SoftMax tradicional. Esta é a primeira vez na indústria que o mecanismo de atenção linear foi estendido ao nível do modelo comercial. MiniMax considerou abrangentemente a Lei de Escala, combinação com MoE, projeto estrutural, otimização de treinamento e otimização de inferência, e reconstruiu o sistema de treinamento e inferência. incluindo otimização de comunicação completa MoE mais eficiente, otimização de sequência mais longa e implementação eficiente de Kernel de atenção linear no nível de inferência.

Na maioria dos testes acadêmicos, a série MiniMax-01 obteve resultados comparáveis aos da primeira linha no exterior. Ele está significativamente à frente no longo conjunto de avaliação de contexto, como seu excelente desempenho na tarefa de recuperação de 4 milhões de agulhas no palheiro. Além dos conjuntos de dados acadêmicos, o MiniMax também construiu um conjunto de teste de cenário assistente baseado em dados reais, e o MiniMax-Text-01 teve um desempenho excelente neste cenário. No conjunto de testes de compreensão multimodal, o MiniMax-VL-01 também está à frente.

Endereço de código aberto: https://github.com/MiniMax-AI

O código aberto dos modelos da série MiniMax-01 injetou uma nova vitalidade no desenvolvimento do campo de IA. Seus avanços no processamento de textos longos e na compreensão multimodal promoverão o rápido desenvolvimento da tecnologia de Agentes e aplicações relacionadas. Esperamos mais inovações e avanços do MiniMax no futuro.