Com o crescimento explosivo do volume de dados de vídeo, como usar efetivamente as informações de vídeo para recuperação de conhecimento e resposta a perguntas tornou-se um ponto importante de pesquisa. Os sistemas tradicionais de geração aumentada de recuperação (RAG) dependem principalmente de informações de texto e são difíceis de explorar totalmente as ricas informações multimodais contidas nos vídeos. Este artigo apresenta uma nova estrutura chamada VideoRAG que é capaz de recuperar dinamicamente vídeos relevantes para uma consulta e integrar efetivamente informações visuais e textuais para gerar respostas mais precisas e informativas. A estrutura utiliza Large Video Language Models (LVLMs) para obter integração perfeita de dados multimodais e processa vídeos não legendados por meio de tecnologia de reconhecimento automático de fala, melhorando significativamente a eficiência de recuperação e geração.

Com o rápido desenvolvimento da tecnologia de vídeo, o vídeo tornou-se uma ferramenta importante para recuperação de informações e compreensão de conceitos complexos. O vídeo combina dados visuais, temporais e contextuais para fornecer representação multimodal além de imagens estáticas e texto. Hoje, com a proliferação de plataformas de compartilhamento de vídeos e a proliferação de vídeos educacionais e informativos, aproveitar o vídeo como fonte de conhecimento oferece oportunidades sem precedentes para resolver dúvidas que exigem contexto detalhado, compreensão espacial e demonstração de processos.

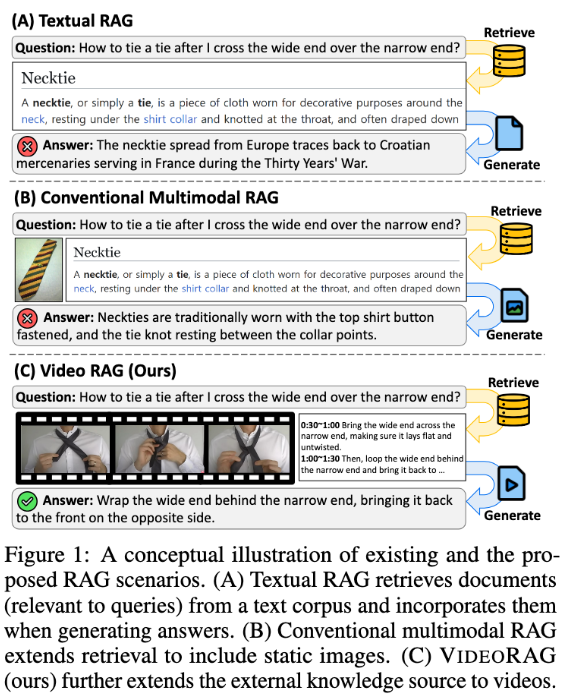

No entanto, os sistemas existentes de geração aumentada de recuperação (RAG) muitas vezes ignoram todo o potencial dos dados de vídeo. Esses sistemas geralmente dependem de informações textuais e ocasionalmente usam imagens estáticas para dar suporte a respostas a consultas, mas não conseguem capturar a dinâmica visual e as dicas multimodais contidas no vídeo, que são críticas para tarefas complexas. As abordagens tradicionais pré-definem vídeos relacionados à consulta sem recuperação ou convertem os vídeos em formato de texto, perdendo assim contexto visual importante e dinâmica temporal, limitando a capacidade de fornecer respostas precisas e informativas.

Para resolver esses problemas, a equipe de pesquisa do Instituto Avançado de Ciência e Tecnologia da Coreia (KaIST) e DeepAuto.ai propuseram uma nova estrutura-VideoRAG. A estrutura é capaz de recuperar dinamicamente vídeos relevantes para uma consulta e integrar informações visuais e textuais no processo de geração. VideoRAG aproveita modelos avançados de linguagem de vídeo em grande escala (LVLMs) para obter integração perfeita de dados multimodais, garantindo que os vídeos recuperados sejam contextualmente consistentes com as consultas do usuário e mantendo a riqueza temporal do conteúdo de vídeo.

O fluxo de trabalho do VideoRAG é dividido em duas etapas principais: recuperação e geração. Durante a fase de recuperação, o framework identifica vídeos semelhantes em suas características visuais e textuais por meio da consulta.

Na fase de geração, a tecnologia de reconhecimento automático de fala é utilizada para gerar dados de texto auxiliares para vídeos sem legendas, garantindo assim que a geração de respostas para todos os vídeos possa efetivamente contribuir com informações. Os vídeos relevantes recuperados são inseridos no módulo de geração, que integra dados multimodais, como quadros de vídeo, legendas e texto de consulta, e os processa com a ajuda de LVLMs para gerar respostas longas, ricas, precisas e contextualmente apropriadas.

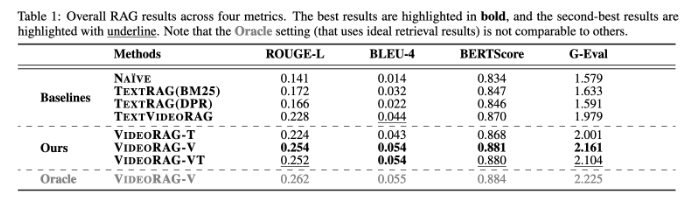

VideoRAG conduz experimentos extensos em conjuntos de dados como WikiHowQA e HowTo100M, e os resultados mostram que sua qualidade de resposta é significativamente melhor do que os métodos tradicionais. Esta nova estrutura não apenas melhora as capacidades dos sistemas de geração de aprimoramento de recuperação, mas também estabelece novos padrões para futuros sistemas de recuperação multimodais.

Artigo: https://arxiv.org/abs/2501.05874

Destaque:

**Nova estrutura**: VideoRAG recupera vídeos relevantes de forma dinâmica e combina informações visuais e textuais para melhorar o efeito de geração.

**Verificação experimental**: testado em vários conjuntos de dados, mostrando qualidade de resposta significativamente melhor do que o método RAG tradicional.

**Inovação técnica**: Usando modelos de linguagem de vídeo em grande escala, o VideoRAG abre um novo capítulo na integração de dados multimodais.

Em suma, a estrutura VideoRAG fornece uma nova solução para tarefas de aprimoramento de recuperação baseadas em vídeo. Seus avanços na integração multimodal de dados e recuperação de informações fornecem informações importantes para futuros sistemas de recuperação de informações mais inteligentes e precisos. Espera-se que os resultados da pesquisa sejam amplamente utilizados na educação, na medicina e em outras áreas.