A Anthropic lançou a nova API de contagem de token de modelo de linguagem Claude, com o objetivo de ajudar os desenvolvedores a gerenciar o uso de tokens de maneira mais eficaz, melhorando assim a eficiência e o controle da interação com o modelo Claude. O controle preciso dos tokens é crucial porque afeta diretamente o custo, a qualidade e a experiência do usuário. Esta API fornece uma visão mais profunda do uso do token, permitindo que os desenvolvedores estimassem o número de tokens antes de chamar o modelo Claude, otimizando assim o conteúdo imediato e reduzindo os custos. Isso é especialmente importante para desenvolvedores e projetos que precisam controlar granularmente os custos.

No campo atual da inteligência artificial, desenvolvedores e cientistas de dados se tornaram cruciais para o controle preciso dos modelos de linguagem. O modelo de linguagem Claude do Anthropic oferece muitas possibilidades para os usuários, mas gerenciar efetivamente o uso de tokens continua sendo um desafio. Para resolver esse problema, a Anthropic lançou uma nova API de contagem de token projetada para fornecer informações mais profundas sobre o uso de token, melhorando assim os recursos de eficiência de interação e controle com modelos de idiomas.

Os tokens desempenham um papel fundamental nos modelos de idiomas, podem ser cartas, marcas de pontuação ou palavras necessárias para gerar uma resposta. O uso de tokens gerenciados afeta diretamente vários aspectos, incluindo eficiência de custos, controle de qualidade e experiência do usuário. Ao gerenciar racionalmente tokens, os desenvolvedores podem não apenas reduzir o custo das chamadas da API, mas também garantir que a resposta gerada seja mais completa e melhorar a experiência interativa entre usuários e chatbots.

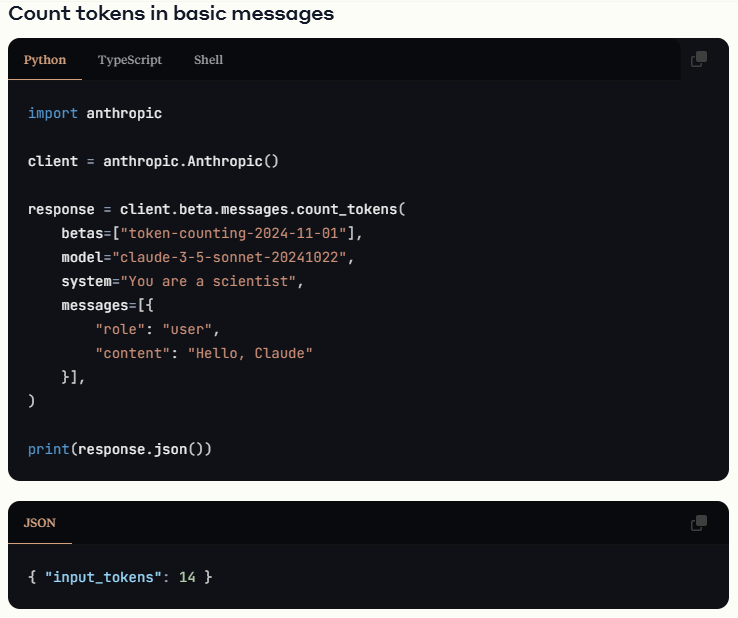

A API de contagem de token do Anthropic permite que os desenvolvedores contem tokens sem chamar diretamente o modelo Claude. Esta API pode medir o número de tokens de instruções e respostas e é mais eficiente no consumo de recursos. Essa função de pré-estimação permite que os desenvolvedores ajustem o conteúdo rápido antes de iniciar chamadas reais da API para otimizar o processo de desenvolvimento.

Atualmente, a API de contagem de token suporta uma variedade de modelos Claude, incluindo Claude3.5Sonnet, Claude3.5Haiku, Claude3haiku e Claude3opus. Os desenvolvedores podem obter o número de tokens através de chamadas de código conciso para a API, que podem ser facilmente alcançadas, seja usando o Python ou o TypeScript.

Vários recursos e vantagens principais desta API incluem: estimativa precisa da contagem de token para ajudar os desenvolvedores otimizar os insumos dentro dos limites do token; Controle melhor o custo das chamadas de API, especialmente para startups e projetos sensíveis a custos.

A API de contagem de token pode ajudar a criar chatbots de suporte ao cliente mais eficientes, resumo preciso do documento e melhores ferramentas de aprendizado interativo em aplicativos do mundo real. Ao fornecer informações precisas sobre o uso do token, o antropia aprimora ainda mais o controle dos desenvolvedores sobre o modelo, permitindo que ele ajuste melhor o conteúdo imediato, reduza os custos de desenvolvimento e melhore a experiência do usuário.

A API de contagem de token fornecerá aos desenvolvedores melhores ferramentas para ajudá -los a otimizar projetos e economizar tempo e recursos na área de modelos de linguagem em rápida evolução.

Detalhes oficiais Portal: https://docs.anthropic.com/en/docs/build-with-claude/token-cinging

Pontos -chave:

A API de contagem de token ajuda os desenvolvedores a entender com precisão o uso de tokens e melhorar a eficiência do desenvolvimento.

Compreender o uso de tokens pode controlar efetivamente os custos de chamadas da API e é adequado para projetos sensíveis ao custo.

Suporta vários modelos Claude, que são convenientes para os desenvolvedores usarem flexibilidade em diferentes cenários de aplicativos.

Em suma, a API de contagem de token da Anthropic fornece aos desenvolvedores recursos mais refinados de controle de modelos de Claude, melhora a eficiência do desenvolvimento e reduz os custos e é uma ferramenta importante para criar aplicativos de IA eficientes.