Os sensores úteis para startups dos EUA lançaram um modelo de reconhecimento de voz de código aberto chamado Moonshine, com o objetivo de melhorar a eficiência do processamento de dados de áudio. Comparado com o Whisper da OpenAI, o Moonshine é mais econômico nos recursos de computação e aumentou a velocidade de processamento em cinco vezes, especialmente para hardware com restrição de recursos e aplicativos em tempo real. Sua arquitetura flexível e ajuste dinâmico do tempo de processamento, de acordo com o comprimento do áudio, tornam -o excelente ao processar clipes de áudio curtos e reduzir efetivamente a sobrecarga do processamento. O Moonshine fornece duas versões, minúsculo e base, com parâmetros de 27,1 milhões e 61,5 milhões, respectivamente, ambos melhores que o desempenho de modelos semelhantes na utilização de recursos.

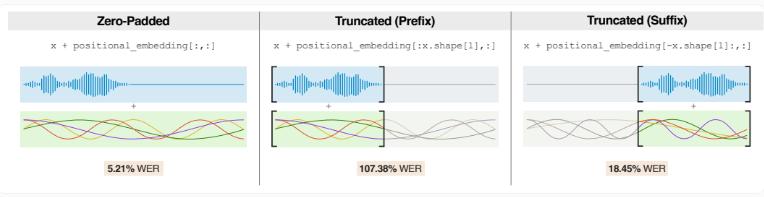

Ao contrário do sussurro que divide o áudio em clipes fixos de 30 segundos, o luar ajusta o tempo de processamento de acordo com o comprimento real do áudio. Isso faz com que ele tenha um bom desempenho ao lidar com clipes de áudio mais curtos, reduzindo a sobrecarga de processamento devido ao preenchimento zero.

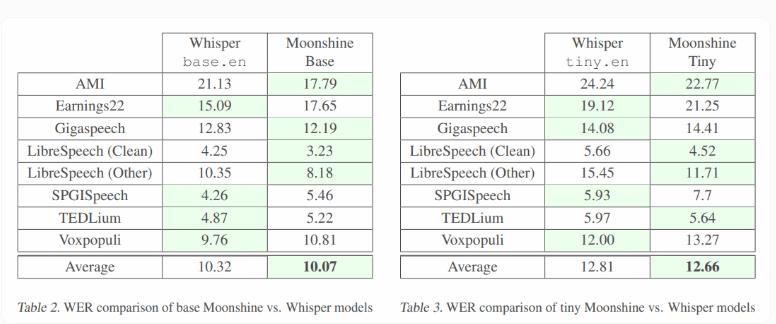

Moonshine tem duas versões: a pequena versão minúscula possui um volume de parâmetro de 27,1 milhões, e a versão básica grande possui um volume de parâmetros de 61,5 milhões. Por outro lado, os parâmetros de modelo similares da OpenAI são maiores, com sussurro minúsculo. Sendo 37,8 milhões e base.

Os resultados dos testes mostram que o minúsculo modelo de Moonshine é comparável ao sussurro em termos de precisão e consome menos recursos de computação. Ambas as versões do luar são inferiores ao sussurro na taxa de erro de palavras (WER) para vários níveis de áudio e ruído de fundo, mostrando um forte desempenho.

A equipe de pesquisa apontou que o luar ainda tem espaço para melhorias ao processar chips de áudio extremamente curtos (menos de um segundo). Esses áudios curtos representam uma pequena proporção de dados de treinamento e o aumento do treinamento desses clipes de áudio pode melhorar o desempenho do modelo.

Além disso, os recursos offline da Moonshine abrem novos cenários de aplicativos e aplicativos que antes não estavam disponíveis devido a limitações de hardware agora são viáveis. Ao contrário do Whisper, que requer maior consumo de energia, o luar é adequado para executar smartphones e pequenos dispositivos, como o Raspberry Pi. Sensores úteis estão usando o Moonshine para desenvolver sua tradutora em inglês Torre.

O código do luar foi lançado no Github, e os usuários precisam observar que os sistemas de transcrição de IA como o Whisper podem experimentar erros. Alguns estudos mostraram que o Whisper tem 1,4% de chance de informações falsas ao gerar conteúdo, especialmente para pessoas com barreiras linguísticas, com taxas de erro mais altas.

Entrada do projeto: https://github.com/usefulsensors/moonesshine

Pontos -chave:

Moonshine é um modelo de reconhecimento de voz de código aberto que processa cinco vezes mais rápido que o Whisper do Openai.

Esse modelo pode ajustar o tempo de processamento de acordo com o comprimento do áudio, especialmente adequado para clipes de áudio curtos.

A Moonshine suporta operação offline e é adequada para uso com recursos limitados.

Em resumo, a Moonshine traz novas possibilidades para a tecnologia de reconhecimento de voz com sua velocidade de processamento eficiente, arquitetura flexível e baixa demanda por recursos, especialmente em dispositivos com restrição de recursos e cenários de aplicação em tempo real. Seus recursos de código aberto também facilitam os desenvolvedores para melhorar e aplicar, e vale a pena prestar atenção e ansiosos.