O Rakuten Group lançou seu primeiro modelo japonês de grande idioma (LLM) Rakuten AI2.0 e o modelo de idioma pequeno (SLM) Rakuten AI2.0Mini, com o objetivo de promover o desenvolvimento da inteligência artificial no Japão. A Rakuten AI2.0 adota uma arquitetura de especialista em híbridos (MOE) e possui oito modelos especializados com 7 bilhões de parâmetros. O Rakuten AI2.0Mini é um modelo compacto com 1,5 bilhão de parâmetros, projetado para implantação de dispositivos de borda, levando em consideração a relação custo-benefício e facilidade de aplicação. Ambos os modelos são de código aberto e fornecem versões de ajuste fino e otimizado para preferências para suportar várias tarefas de geração de texto.

O Rakuten Group anunciou o lançamento de seu primeiro modelo de idioma grande japonês (LLM) e Modelo de Língua pequena (SLM), denominada Rakuten AI2.0 e Rakuten AI2.0 Mini.

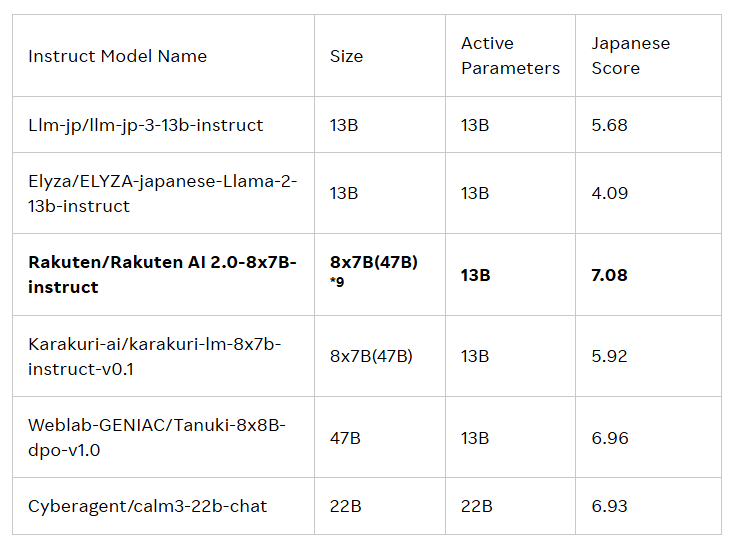

O lançamento desses dois modelos visa impulsionar o desenvolvimento da inteligência artificial (AI) no Japão. O Rakuten AI2.0 é baseado na arquitetura Hybrid Expert (MOE) e é um modelo de 8x7b que consiste em oito modelos com 7 bilhões de parâmetros, cada um servindo como especialista. Sempre que o token de entrada for processado, o sistema o enviará para os dois especialistas mais relevantes e o roteador é responsável por selecioná -lo. Esses especialistas e roteadores estão constantemente treinando juntos através de uma grande quantidade de dados bilíngues japoneses e ingleses de alta qualidade.

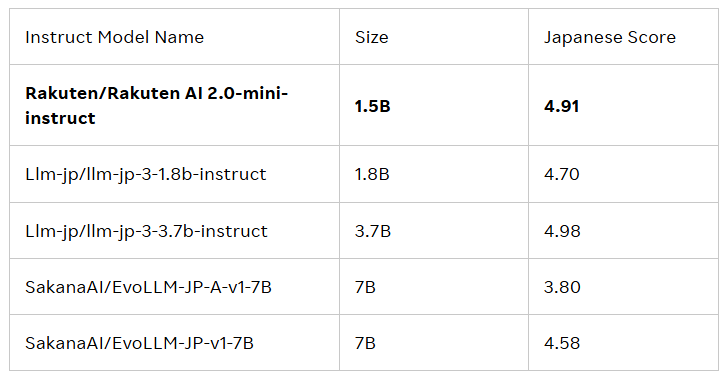

O Rakuten AI2.0Mini é um novo modelo denso com um volume de parâmetro de 1,5 bilhão, projetado para implantação de dispositivos de borda econômica e adequado para cenários de aplicação específicos. Também é treinado em dados mistos no Japão e no Reino Unido, com o objetivo de fornecer uma solução conveniente. Ambos os modelos foram ajustados e preferidos e lançaram modelos básicos e modelos de instrução para apoiar empresas e profissionais no desenvolvimento de aplicativos de IA.

Todos os modelos estão sob o contrato de licença Apache2.0, que os usuários podem obter na biblioteca oficial de abraçar o Face of Rakuten Group. Além disso, esses modelos também podem servir de base para outros modelos, que facilitam o desenvolvimento e a aplicação adicionais.

Cai Ting, chefe de IA e oficial de dados do Rakuten Group, disse: “Estou extremamente orgulhoso de como nossa equipe combina dados, engenharia e ciência para lançar a Rakuten AI2.0. As empresas tomam decisões inteligentes, aceleram a realização de valor e abrem novas possibilidades. . "

Blog oficial: https://global.rakuten.com/corp/news/press/2025/0212_02.html

Pontos -chave:

O Rakuten Group lança seu primeiro modelo de idioma grande japonês (LLM) e Modelo de Língua pequena (SLM), chamada Rakuten AI2.0 e Rakuten AI2.0 Mini.

O Rakuten AI2.0 é baseado em uma arquitetura de especialistas híbridos e possui oito modelos especializados com 7 bilhões de parâmetros, comprometidos com o processamento de dados bilíngues em japonês e inglês.

Todos os modelos estão disponíveis na Biblioteca Face Rakuten Official, adequada para uma variedade de tarefas de geração de texto e servem de base para outros modelos.

Em suma, o lançamento do Rakuten AI2.0 e Rakuten AI2.0Mini marca outro progresso importante no Japão no campo de grandes modelos de idiomas. à sua aplicação e impacto futuro.