Foundationa LLM : платформа для развертывания, масштабирования, обеспечения безопасности и управления генеративным искусственным интеллектом на предприятиях.

Foundationa LLM предоставляет платформу для развертывания, масштабирования, обеспечения безопасности и управления генеративным искусственным интеллектом на предприятии. С Foundationa LLM вы можете:

- Создавайте агенты ИИ, основанные на данных вашего предприятия, будь то текстовые, полуструктурированные или структурированные данные.

- Сделайте агенты ИИ доступными для ваших пользователей через фирменный интерфейс чата или интегрируйте REST API с агентом ИИ в свое приложение для работы в качестве второго пилота или интегрируйте API агента в автоматизированный межмашинный процесс.

- Агенты создания экспериментов, которые могут использовать различные большие языковые модели, включая OpenAI GPT-4, Mistral и Llama 2, а также любые модели, взятые из каталога моделей Hugging Face, которые предоставляют конечную точку завершения REST.

- Централизованно управляйте, настраивайте и защищайте своих агентов ИИ И их базовые активы, включая подсказки, источники данных, конвейеры данных векторизации, векторные базы данных и большие языковые модели, с помощью портала управления.

- Предоставьте каждому сотруднику вашего предприятия возможность создавать собственные агенты искусственного интеллекта. Ваши пользователи, не являющиеся разработчиками, могут создавать и развертывать своих собственных агентов в режиме самообслуживания с портала управления, но мы не мешаем вашим продвинутым разработчикам ИИ, которые могут развертывать свои собственные оркестровки, встроенные в LangChain, Semantic Kernel, Prompt Flow или любая оркестровка, которая предоставляет конечную точку завершения.

- Развертывайте и управляйте масштабируемыми конвейерами данных векторизации, которые могут принимать миллионы документов для предоставления знаний в вашу модель.

- Предоставьте своим пользователям столько специализированных ИИ-агентов, сколько пожелаете.

- Управляйте доступом к агентам ИИ и ресурсам, к которым они получают доступ, с помощью управления доступом на основе ролей (RBAC).

- Используйте быстро развивающиеся возможности Azure AI и Azure OpenAI в одном интегрированном стеке.

Примечание

Foundationa LLM не является большой языковой моделью. Он позволяет вам использовать большие языковые модели по вашему выбору (например, OpenAI GPT-4, Mistral, LLama 2 и т. д.).

Foundationa LLM развертывает безопасную, комплексную и легко настраиваемую платформу второго пилота в вашей облачной среде Azure:

- Упрощает интеграцию с корпоративными источниками данных, используемыми агентом для контекстного обучения (например, включение RAG, CoT, ReAct и шаблонов внутреннего монолога).

- Обеспечивает глубокую защиту с детальным контролем безопасности данных, используемых агентом, а также фильтрами до и после завершения, которые защищают от атак.

- Укрепленное решение с самого начала атаковано красной командой LLM.

- Масштабируемое решение балансирует нагрузку между несколькими конечными точками LLM.

- Распространяется на новые источники данных, новые оркестраторы LLM и LLM.

Зачем нужен Foundationa LLM ?

Проще говоря, мы видели, как многие люди заново изобретали велосипед только для того, чтобы получить настроенного второго пилота или агента искусственного интеллекта, который был бы обоснован и основывал свои ответы на собственных данных, а не на обученных параметрических знаниях модели. Многие из решений, которые мы видели, были созданы для отличных демонстраций, но по сути были игрушками для обработки вызовов к конечным точкам OpenAI — они не были предназначены или готовы к внедрению в производство в масштабе предприятия. Мы создали Foundationa LLM , чтобы обеспечить непрерывный путь, который можно было бы начать быстро, чтобы люди могли быстро экспериментировать с LLM, но не свалиться после этого с решением, которое было бы небезопасным, нелицензионным, негибким и недостаточно полнофункциональным, чтобы превратиться из прототипа в промышленное решение без необходимости начинать все сначала.

Основные проблемы, связанные с предоставлением корпоративных вторых пилотов или агентов ИИ, заключаются в следующем:

- Вторые пилоты корпоративного уровня или агенты искусственного интеллекта сложны и имеют множество движущихся частей (не говоря уже об инфраструктуре).

- В отрасли наблюдается дефицит навыков, когда дело доходит до заполнения должностей, необходимых для предоставления этих сложных решений второго пилота.

- Основные риски ИИ (неточность, кибербезопасность, соответствие требованиям, объяснимость, конфиденциальность) не смягчаются отдельными инструментами.

- Разработка решения второго пилота или агента искусственного интеллекта занимает много времени, стоит дорого и утомительно, если начинать с нуля.

Заблуждение против реальности

Заблуждение

Существует заблуждение, что создание приложений LLM и агентов искусственного интеллекта — это быстрое проектирование, это так же просто, как:

Это может быть верно для демонстрационных и игрушечных сценариев, но для агентов ИИ на предприятии существует гораздо больше требований, например, как вы:

- масштабировать и пакетно загружать от тысяч до миллионов документов в качестве знаний для модели? использовать другие LLM (Llama 2, Mistral) вместе с моделями ChatGPT?

- сохранять конфиденциальные источники знаний конфиденциальными для авторизованных пользователей?

- не допускать отправки конфиденциальных данных (PII, коммерческой тайны) в LLM?

- управлять несколькими агентами ИИ?

- управлять использованием токенов и управлять возвратами платежей за приложения?

Реальность

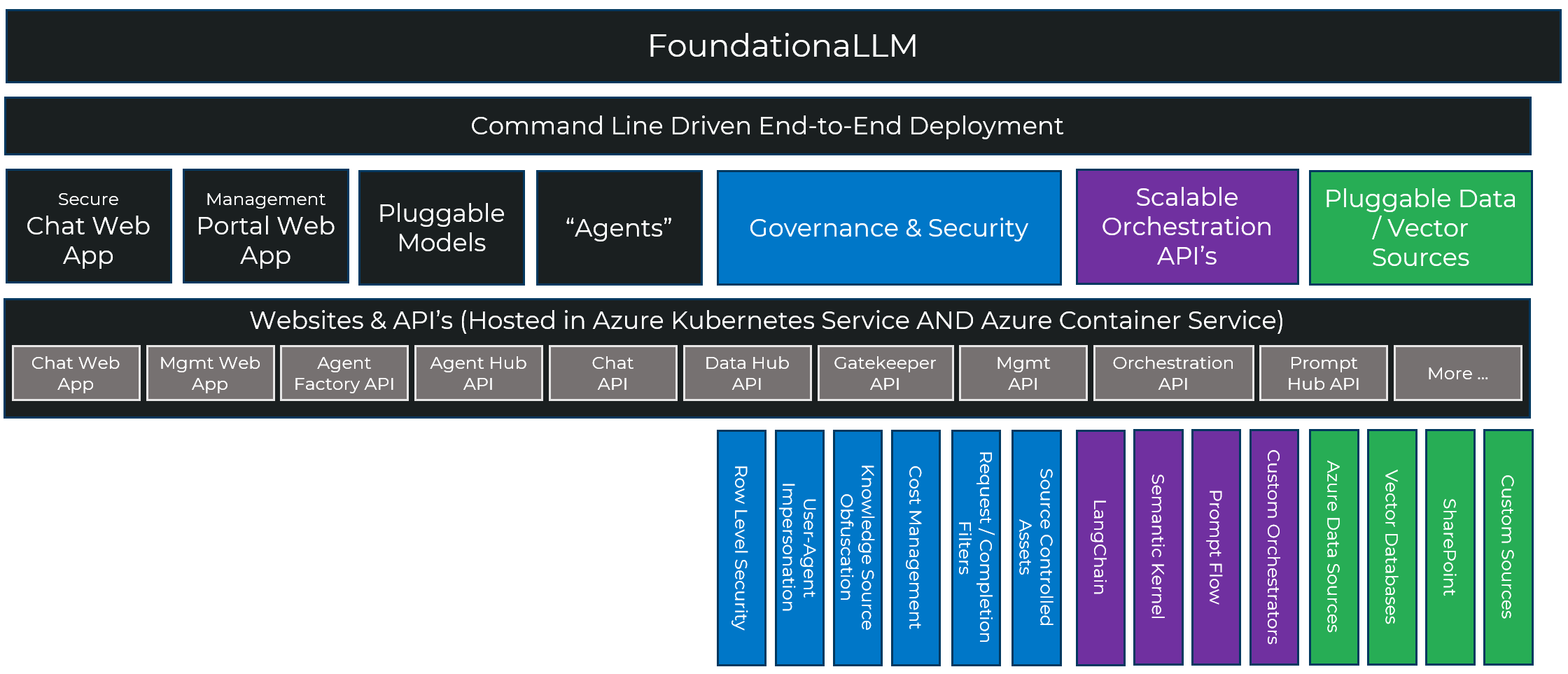

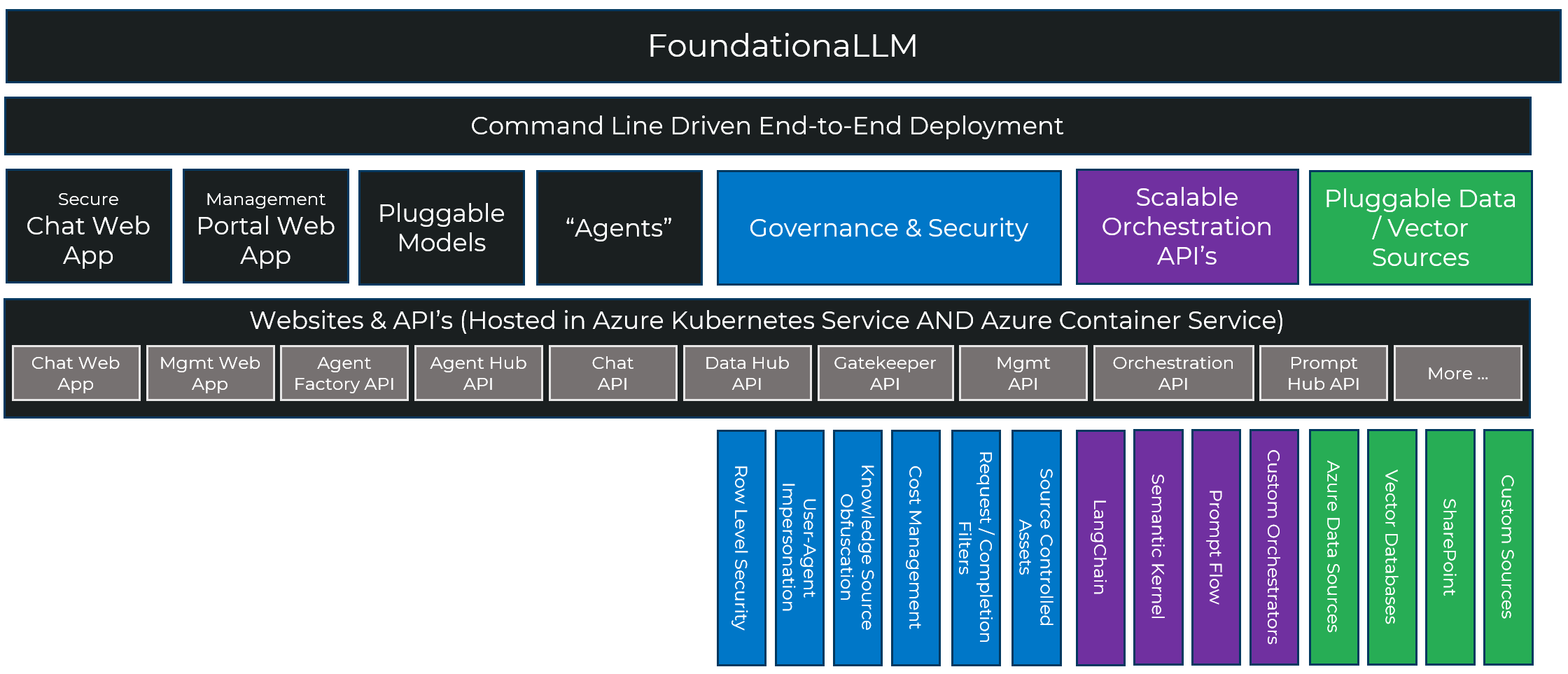

Существует множество компонентов, необходимых для создания безопасного, хорошо управляемого, масштабируемого и расширяемого ИИ-агента, и Foundationa LLM предоставляет комплексный набор, позволяющий сделать этот процесс более быстрым, повторяемым и надежным:

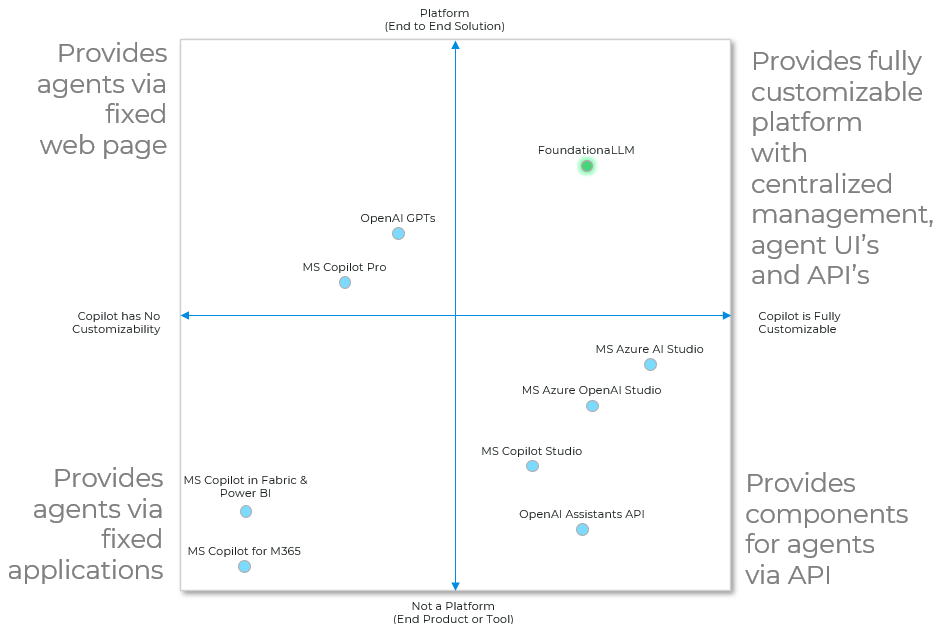

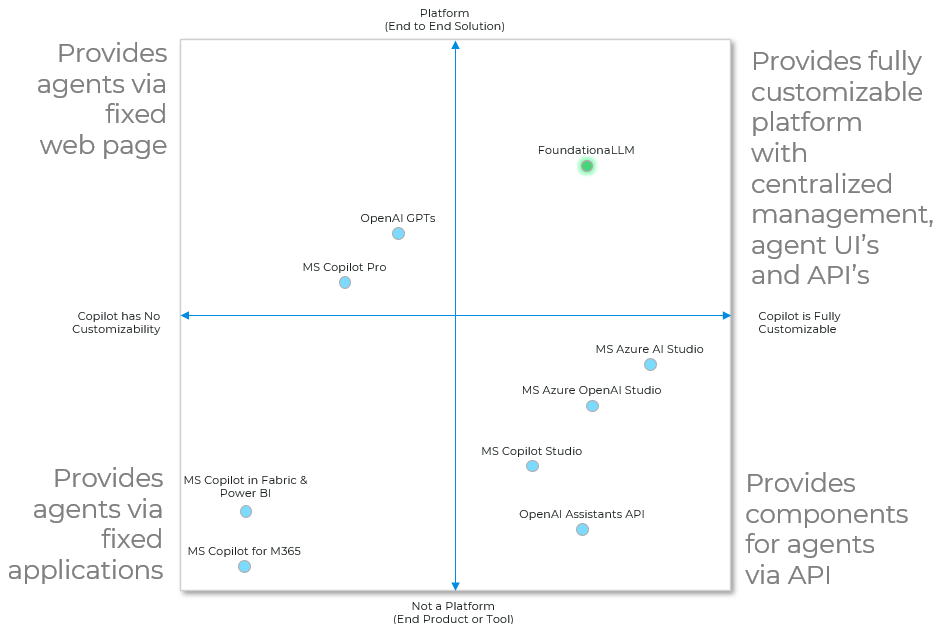

Какое место занимает Foundationa LLM по сравнению с другими решениями?

В экосистеме есть множество отличных инструментов, которые помогают в создании второго пилота или агента ИИ. Только Foundationa LLM объединяет их, чтобы предоставить комплексную платформу для создания полностью настраиваемых агентов ИИ с централизованным управлением, пользовательскими интерфейсами агентов и API.

По сути, второй пилот или агент ИИ использует предоставленные предприятием знания и генеративные модели ИИ для создания текста, написания кода или рендеринга изображений, часто рассуждая над подсказками, предоставленными человеком. Во всех этих случаях ИИ используется для непосредственной помощи человеку в выполнении конкретной задачи.

Эта базовая способность проявляется в двух архетипах, оба из которых Foundationa LLM поддерживает изначально:

- Управление знаниями: помогите пользователям быстро найти нужную информацию и предоставить ее на нужном уровне и в нужном формате. Примеры включают обобщение, перефразирование или перенацеливание на конкретную личность (например, объясните, как будто мне пять лет), анализ настроений и рекомендации.

- Аналитика: помогите пользователям быстро получить необходимую информацию на основе данных. Примеры включают рекомендации, прогнозы, обнаружение аномалий, статистический анализ, а также запрос данных и отчетность.

Foundationa LLM упрощает и оптимизирует создание агентов управления знаниями (например, агентов вопросов/ответов) и аналитики (например, самообслуживания бизнес-аналитики) на основе источников данных, присутствующих на вашем предприятии.

Документация

Ознакомьтесь с Foundationa LLM, прочитав документацию. Сюда входят инструкции по развертыванию, краткие руководства, ссылки на архитектуру и API.

Начиная

Foundationa LLM предоставляет простой подход к запуску и запуску вашего первого развертывания на основе командной строки. По сути, это две команды. После этого вы можете настроить решение, запустить его локально на своем компьютере и обновить развертывание с учетом ваших настроек.

Следуйте инструкциям по быстрому развертыванию, чтобы развернуть Foundationa LLM в вашей подписке Azure.

Сообщение о проблемах и поддержка

Если у вас возникнут какие-либо проблемы с Foundationa LLM , откройте проблему на GitHub. Мы ответим на ваш вопрос как можно скорее. Используйте ярлыки ( bug , documentation , general question , release xxx ), чтобы классифицировать вашу проблему и предоставить как можно больше подробностей, чтобы помочь нам понять и решить проблему.

Вклад в Foundationa LLM

Мы рады принять вклад в проект FoundationaLLM в виде отзывов, отчетов об ошибках и запросов на включение. Инструкции см. в разделе «Вклад в FoundationaLLM».