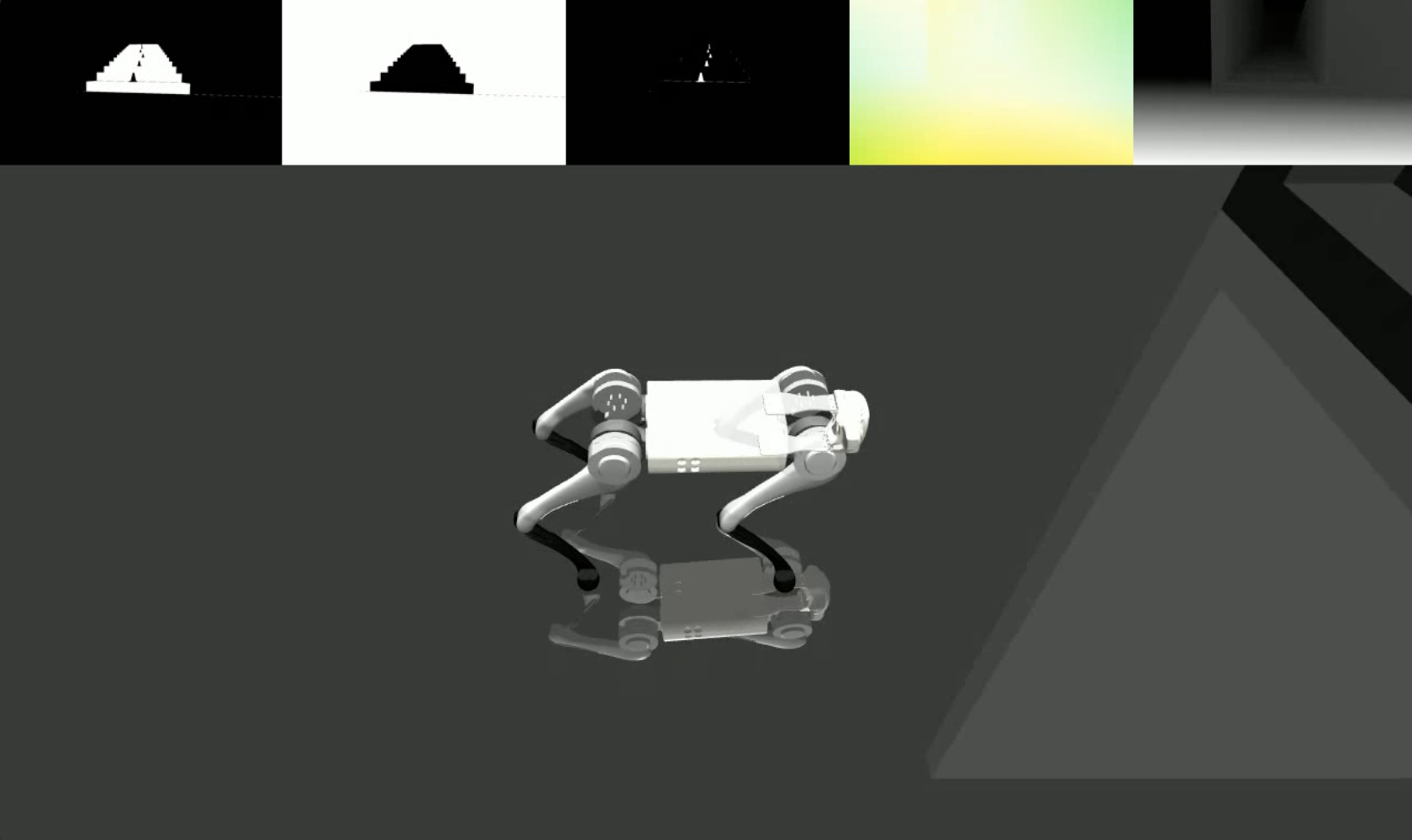

Мы передаем реалистичные и разнообразные визуальные данные, от генеративных моделей до классических физических симуляторов, позволяя роботам осваивать высокодинамичные задачи, такие как паркур, без необходимости глубины.

lucidsim содержит моделируемую среду, созданную с использованием MuJoCo. Мы предоставляем среду и инструменты для запуска конвейера рендеринга LucidSim для четвероногого паркура. Код обучения еще не включен.

Если вы ищете код генеративного расширения (необходимый для запуска полного конвейера рендеринга), посетите репозиторий Weaver!

Алан Ю *1 , Ге Ян *1,2 , Ран Чой 1 , Яджван Раван 1 , Джон Леонард 1 , Филипп Исола 1

1 MIT CSAIL, 2 Институт искусственного интеллекта и фундаментальных взаимодействий (IAIFI)

* Обозначает равный вклад

КОРЛ 2024

|  |

Оглавление

Если вы следовали инструкциям по установке от weaver , смело устанавливайте поверх этой среды.

conda create -n lucidsim python=3.10

conda activate lucidsim # Choose the CUDA version that your GPU supports. We will use CUDA 12.1

pip install torch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 --extra-index-url https://download.pytorch.org/whl/cu121

# Install lucidsim with more dependencies

git clone https://github.com/lucidsim/lucidsim

cd lucidsim

pip install -e . Для установки последних нескольких зависимостей требуется более ранняя версия setuptools и wheel . Чтобы установить, пожалуйста, понизьте версию и вернитесь позже.

pip install setuptools==65.5.0 wheel==0.38.4 pip==23

pip install gym==0.21.0

pip install gym-dmc==0.2.9

pip install -U setuptools wheel pip Примечание. В Linux обязательно установите переменную среды MUJOCO_GL=egl .

LucidSim генерирует фотореалистичные изображения, используя генеративную модель для улучшения рендеринга симулятора, используя кондиционирующие изображения для сохранения контроля над геометрией сцены.

Мы предоставили контрольную точку экспертной политики в разделе checkpoints/expert.pt . Эта политика была заимствована из политики экстремального паркура. Вы можете использовать эту политику для выборки среды и визуализации изображений кондиционирования с помощью:

# env-name: one of ['parkour', 'hurdle', 'gaps', 'stairs_v1', 'stairs_v2']

python play.py --save-path [--env-name] [--num-steps] [--seed] где save_path — куда сохранить полученное видео.

Чтобы запустить полный конвейер генеративного расширения, вам необходимо установить пакет weaver отсюда. Когда закончите, убедитесь, что переменные среды по-прежнему установлены правильно:

COMFYUI_CONFIG_PATH=/path/to/extra_model_paths.yaml

PYTHONPATH=/path/to/ComfyUI: $PYTHONPATHЗатем вы можете запустить весь конвейер с помощью:

python play_three_mask_workflow.py --save-path --prompt-collection [--env-name] [--num-steps] [--seed] где save_path и env_name такие же, как и раньше. prompt_collection должен быть путем к файлу .jsonl с правильно отформатированными подсказками, как в папке weaver/examples .

Мы благодарим авторов Extreme Parkour за их кодовую базу с открытым исходным кодом, которую мы использовали в качестве отправной точки для нашей экспертной политики ( lucidsim.model ).

Если наша работа окажется для вас полезной, пожалуйста, цитируйте:

@inproceedings{yu2024learning,

title={Learning Visual Parkour from Generated Images},

author={Alan Yu and Ge Yang and Ran Choi and Yajvan Ravan and John Leonard and Phillip Isola},

booktitle={8th Annual Conference on Robot Learning},

year={2024},

}