Создано Уэйном Ву, Юньсюань Чжан и Жэнь Ли.

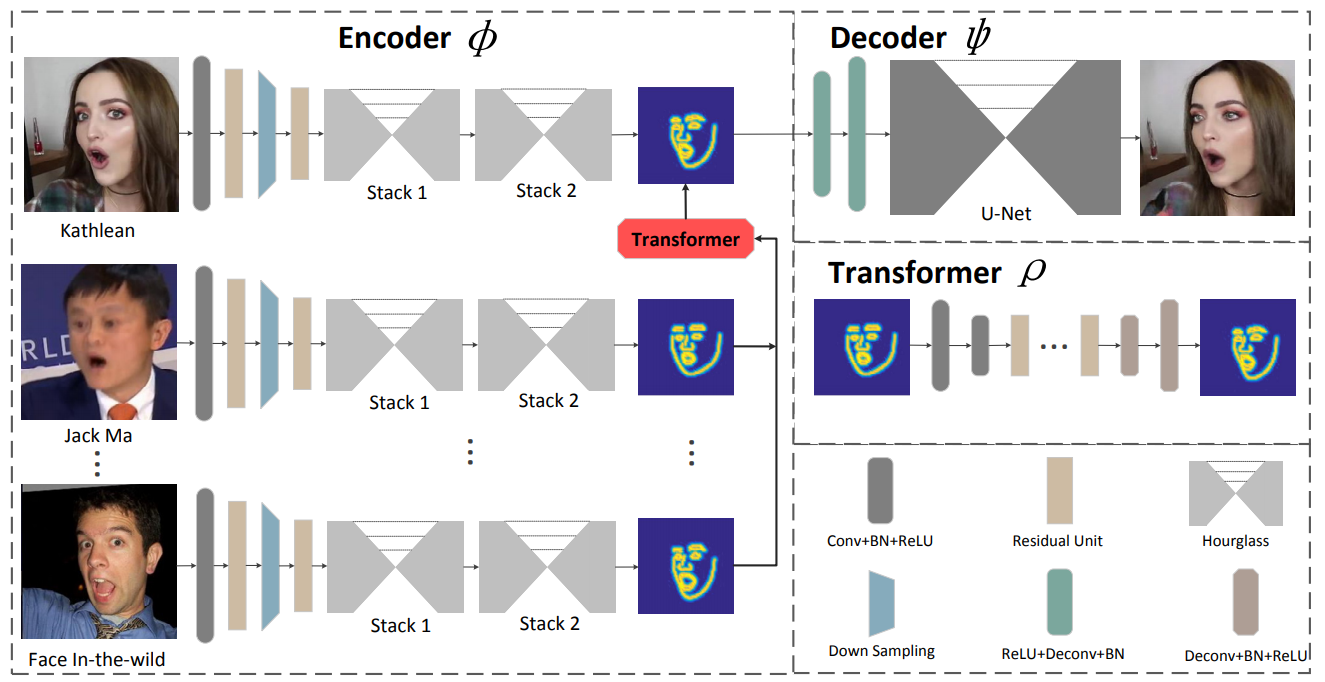

Мы представляем новую основанную на обучении основу для реконструкции лица. Предлагаемый метод, известный как ReenactGAN, способен передавать движения и выражения лица с монокулярного видеовхода произвольного человека на видео целевого человека. Вместо прямого переноса в пиксельное пространство, что может привести к структурным артефактам, мы сначала сопоставляем исходную грань с граничным скрытым пространством. Впоследствии используется преобразователь для адаптации границы исходной грани к границе целевой. Наконец, для генерации воспроизведенного целевого лица используется целевой декодер. Благодаря эффективному и надежному переносу на основе границ наш метод может выполнять фотореалистичную реконструкцию лица. Кроме того, ReenactGAN привлекателен тем, что весь процесс реконструкции является чисто упреждающим, и, таким образом, процесс реконструкции может выполняться в реальном времени.

Клонируйте этот репозиторий:

git clone ...

cd ReenactGANГраничный кодер обучен на наборе данных WFLW и Helen, а граничный преобразователь и декодер обучены на наборе данных CelebV. Обучение кодировщика требует огромного количества времени, поэтому вы можете получить предварительно обученный кодировщик по адресу ./pretrained_models/v8_net_boundary_detection.pth .

Чтобы обучить граничный преобразователь, запустите

sh script/train_Transformer.shВам нужно позаботиться об аргументах --root_dir и --what_target . --root_dir относится к каталогу набора данных, а -- Which_target указывает на то, какой человек будет целью.

0: Emmanuel_Macron

1: Kathleen

2: Jack_Ma

3: Theresa_May

4: Donald_TrumpЧтобы обучить декодер, запустите

sh script/train_Decoder.shКроме того, вам необходимо позаботиться о значении --root_dir , которое относится к каталогу целевого человека.

Чтобы протестировать модель, запустите

sh script/move_models.sh ./checkpoints/Transformer_2019-xx-xx_xx-xx-xx/G_BA_xx.pth ./checkpoints/Decoder_2019-xx-xx_xx-xx-xx/xx_net_G.pth trump

sh script/test.shИзображения, использованные для тестирования, находятся по адресу ./test_imgs/samples/image, а текстовый файл ./test_imgs/samples/images_list.txt содержит список этих изображений. После тестирования вы получите флодер с именем results , который содержит изображения реальных и воспроизведенных лиц, границы и трансформированные границы реальных лиц. Вот некоторые результаты.

Вы можете получить наши обученные модели от Decoder и Transformer.

Если вы считаете, что ReenactGAN полезен для вашего исследования, укажите:

inproceedings{wayne2018reenactgan,

author = {Wu, Wayne and Zhang, Yunxuan and Li, Cheng and Qian, Chen and Loy, Chen Change},

title = {ReenactGAN: Learning to Reenact Faces via Boundary Transfer},

booktitle = {ECCV},

month = September,

year = {2018}

} Пожалуйста, свяжитесь с [email protected].