Основываясь на шести характеристиках активного здоровья: инициатива, профилактика, точность, персонализация, совместное строительство и обмен информацией, а также самодисциплина, Школа технологий будущего Южно-Китайского технологического университета и Ключевая лаборатория цифровых двойников провинции Гуандун открыла исходные коды. система активного оздоровления жилого пространства в Китае. Модельная база ProactiveHealthGPT, включающая:

BianQue, большая модель здоровья жилого пространства, точно настроенная десятками миллионов китайских инструкций по диалогу о здоровье.

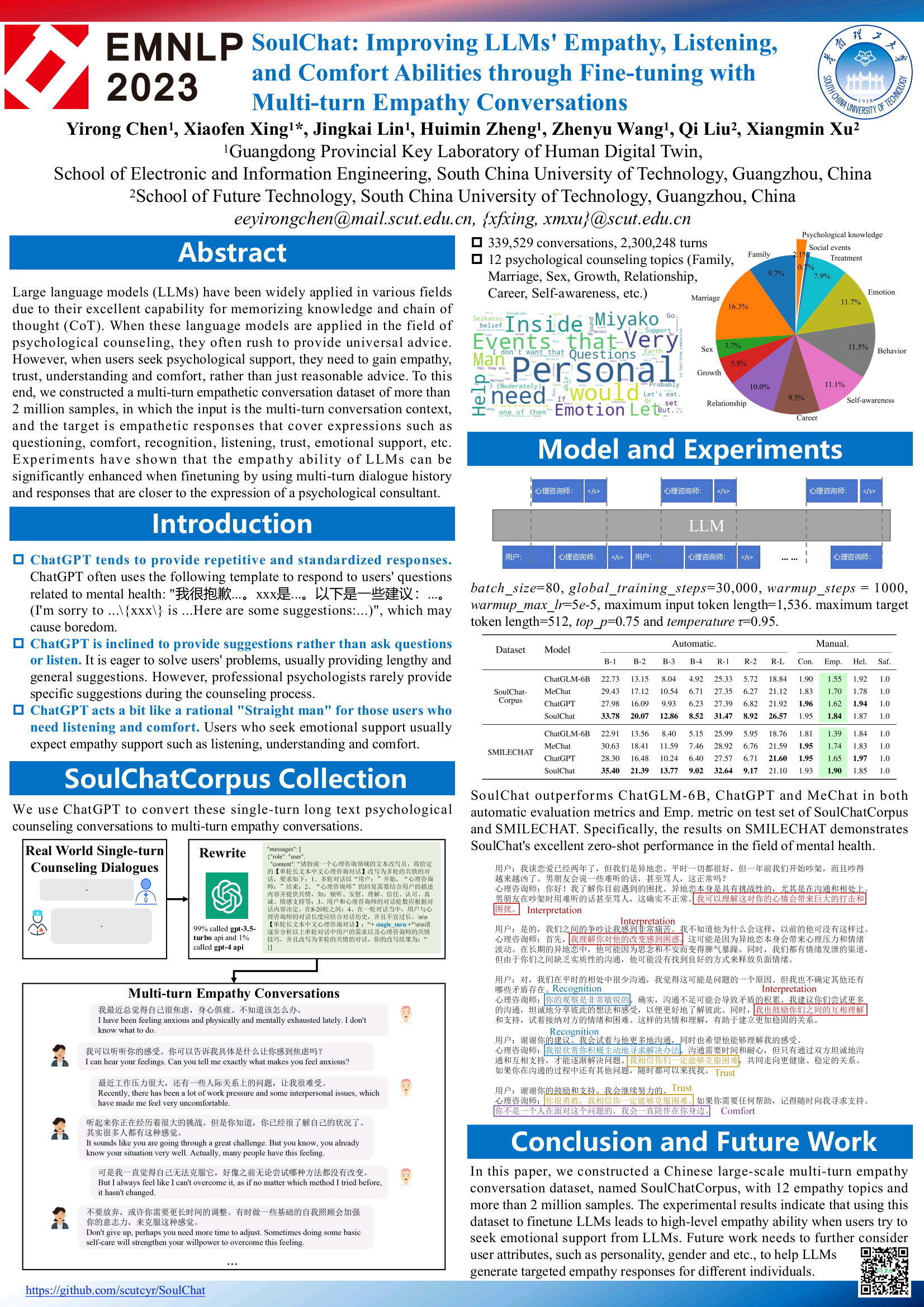

Крупномасштабная модель психического здоровья SoulChat была усовершенствована с помощью совместных инструкций с длинными текстовыми инструкциями на китайском языке и многочисленными раундами данных эмпатического диалога в ходе миллионов психологических консультаций.

Мы надеемся, что база крупных моделей активного здоровья жилого пространства ProactiveHealthGPT поможет академическому сообществу ускорить исследования и применение крупных моделей в таких областях активного здравоохранения, как хронические заболевания и психологическое консультирование. Этот проект — SoulChat, крупная модель психического здоровья .

2024.06.06: Выпущена версия набора данных SoulChatCorpus с открытым исходным кодом. Подробную информацию см. в частности на https://www.modelscope.cn/datasets/YIRONGCHEN/SoulChatCorpus. , мы отфильтровали около 90 000 образцов разговоров (из-за рисков конфиденциальности, проблем безопасности, политических рисков, образцов низкого качества и т. д. эти образцы все еще находятся на стадии ручной оптимизации и будут обновлены до версии с открытым исходным кодом). набор данных после завершения проверки вручную), в конечном итоге сохранив 258 354 многораундовых разговора, всего 1 517 344 раунда. Новая версия модели будет выпущена в ближайшем будущем и, как ожидается, будет адаптирована к множеству моделей с открытым исходным кодом и множеству уровней параметров, чтобы облегчить использование пользователем или провести сравнительные экспериментальные исследования.

2023.12.07: Наша статья, включенная в Результаты EMNLP 2023, см. SoulChat: Улучшение способностей студентов-магистров к эмпатии, слушанию и комфорту посредством тонкой настройки с помощью многоходовых бесед с эмпатией.

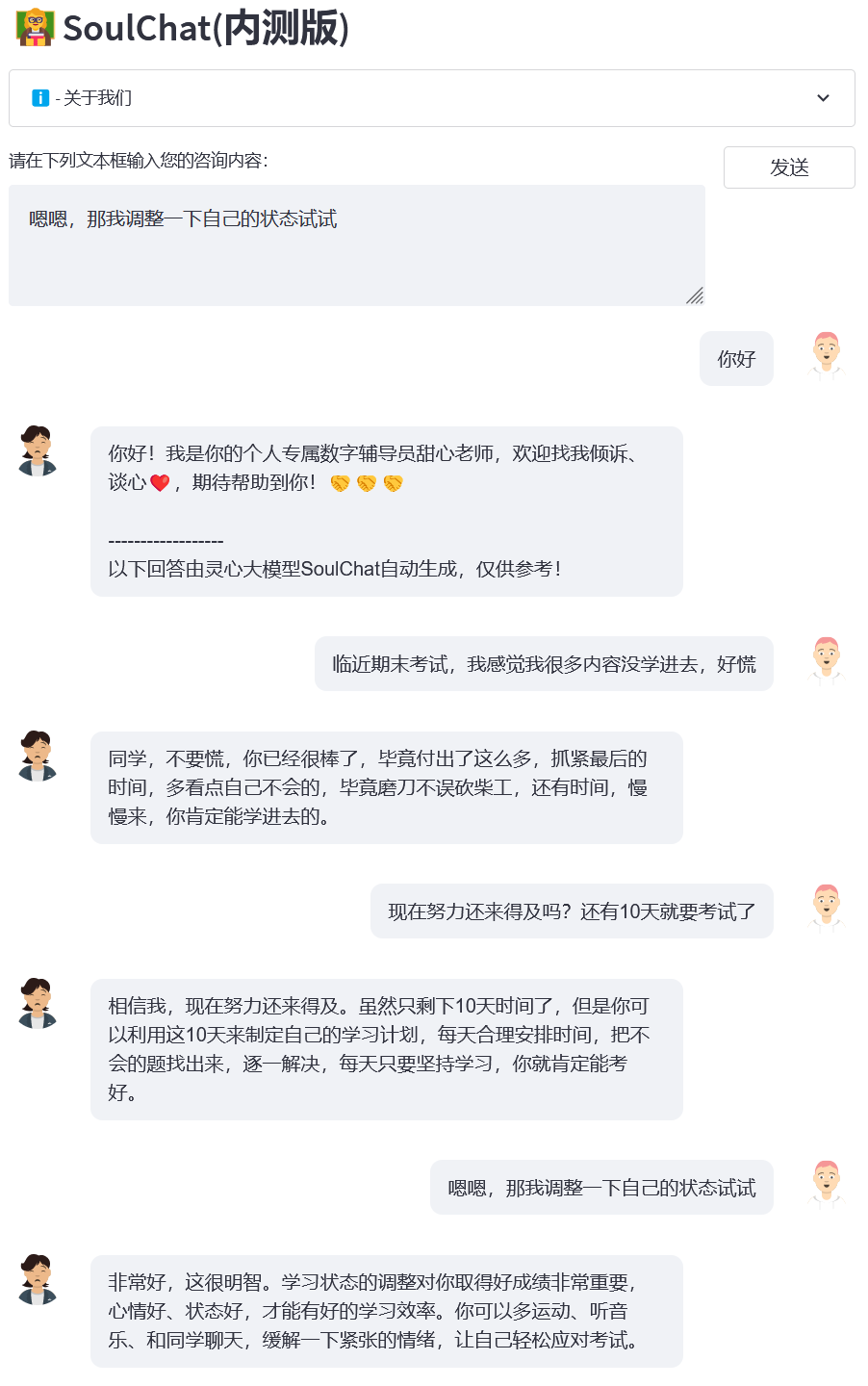

2023.07.07: Запущена онлайн-закрытая бета-версия большой модели психического здоровья SoulChat. Добро пожаловать, нажмите на ссылку для использования: Закрытая бета-версия SoulChat.

24.06.2023: Этот проект был включен в список китайских больших моделей. Это первая отечественная крупная модель с открытым исходным кодом в психологической сфере, обладающая способностью к эмпатии и слушанию.

2023.06.06: Модель BianQue-2.0 имеет открытый исходный код. Подробности см. в BianQue-2.0.

2023.06.06: Выпущена SoulChat, большая модель духовного здоровья с возможностью сопереживать и слушать. Подробности см.: SoulChat, большая модель духовного здоровья: посредством смешанной тонкой настройки длинных текстовых инструкций для консультаций и нескольких раундов консультаций. наборы данных эмпатического диалога, улучшена производительность модели «Эмпатия».

2023.04.22: Демонстрация медицинской системы вопросов и ответов на основе модели Bianque-1.0. Подробности можно найти на сайте: https://huggingface.co/spaces/scutcyr/BianQue.

2023.04.22: Выпущена версия модели BianQue-1.0. Подробности см.: BianQue-1.0: Улучшение возможности «спрашивать» модели медицинского чата за счет смешанных инструкций и тонкой настройки нескольких раундов наборов данных запроса врача (BianQue-). 1.0: Улучшение возможности «вопросов» модели медицинского чата посредством точной настройки с помощью гибридных инструкций и многоходовых наборов данных для контроля качества врачей)

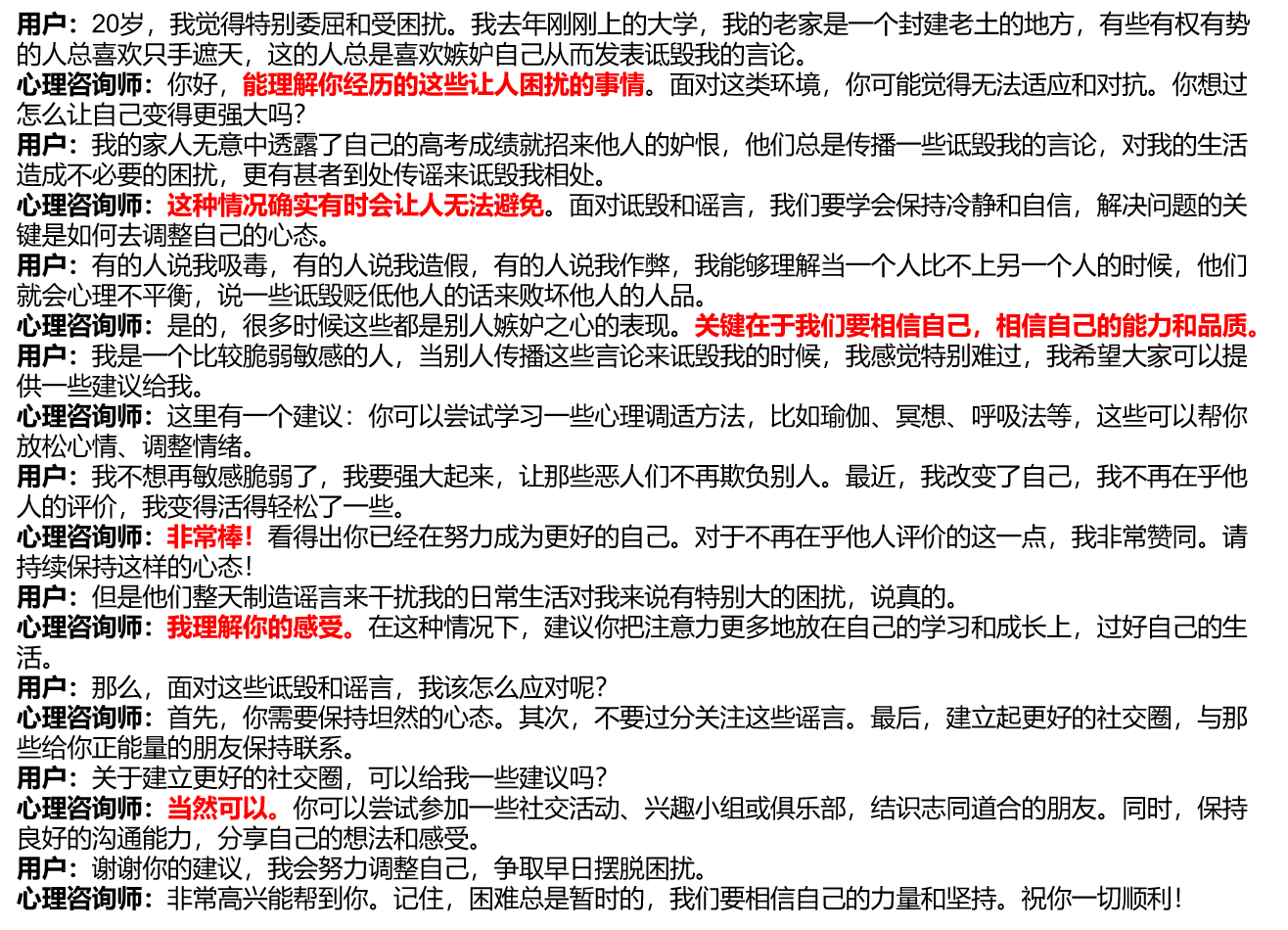

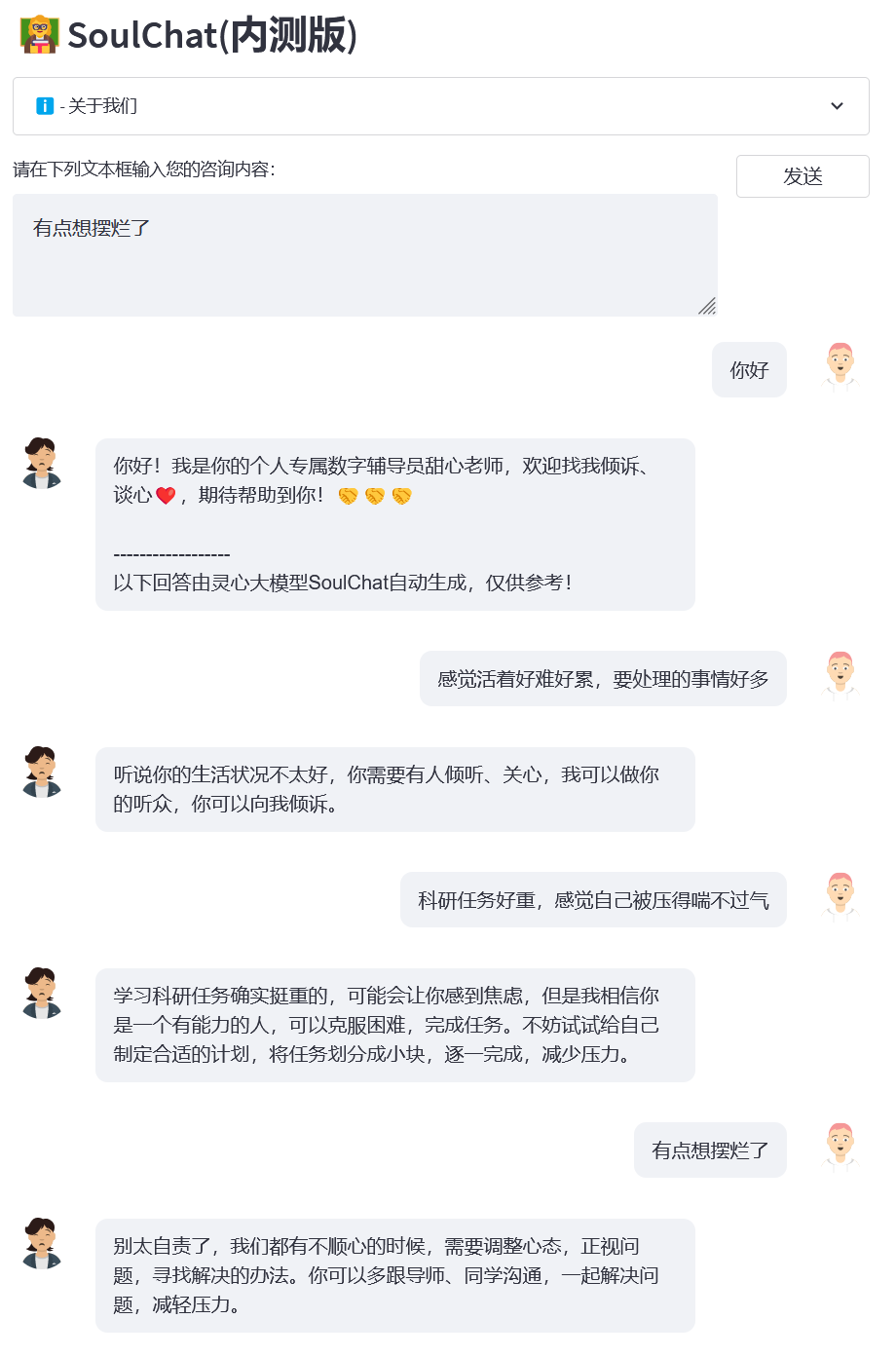

Мы исследовали текущие распространенные платформы психологического консультирования и обнаружили, что, когда пользователи обращаются за онлайн-психологической помощью, им обычно нужно подробно описать себя, а затем психологи-консультанты, которые оказывают помощь, также дают подробный ответ (см. рисунок/single_turn. png). , отсутствует прогрессивный процесс конфиденциальности. Однако в реальном процессе психологического консультирования между пользователем и психологом-консультантом будет несколько раундов общения. Во время этого процесса психолог-консультант поможет пользователю поговорить и проявить сочувствие, например: «Это здорово». , «Я понимаю, что ты чувствуешь», «Конечно, можешь» и т. д. (см. изображение ниже).

Учитывая нынешнюю нехватку наборов данных многоходового эмпатического диалога, с одной стороны, мы построили однораундовые длинные текстовые инструкции и ответы психологического консультирования (SoulChatCorpus-single_turn) со шкалой более 150 000, а количество ответов превысило 500 000 (количество инструкций на данный момент в 6,7 раза больше, чем в обычном наборе данных психологического консультирования PsyQA), и использовал ChatGPT и GPT4 для генерации в общей сложности около 1 миллиона раундов данных многоэтапных ответов (SoulChatCorpus-multi_turn) . В частности, в ходе предэксперимента мы обнаружили, что модель психологического консультирования, состоящая исключительно из одного раунда, основанная на длинных статьях, приводит к тому, что длина текста становится скучной для пользователей, и она не способна направлять пользователей к разговору. Модель психологического консультирования, основанная на данных, в виде диалога с многораундовым консультированием. Модель ослабляет рекомендательные способности модели. Поэтому мы смешали SoulChatCorpus-single_turn и SoulChatCorpus-multi_turn, чтобы создать набор данных смешанного эмпатического диалога с одним и несколькими раундами SoulChatCorpus с дополнительными данными. более 1,2 миллиона образцов. . Все данные объединены в один командный формат в виде «Пользователь: xxxn Психологический консультант: xxxn Пользователь: xxxn Психологический консультант:».

Мы выбрали ChatGLM-6B в качестве модели инициализации и провели тонкую настройку всех параметров , чтобы улучшить способность модели сопереживать, направлять пользователей к разговору и предоставлять разумные предложения. Для получения более подробной информации об обучении, пожалуйста, обратите внимание на наши последующие статьи.

Клонировать этот проект

cd ~git клон https://github.com/scutcyr/SoulChat.git

При установке зависимостей обратите внимание, что версию torch необходимо выбирать на основе фактической версии cuda вашего сервера. Подробную информацию см. в руководстве по установке pytorch.

компакт-диск SoulChat conda env create -n proactivehealthgpt_py38 --file proactivehealthgpt_py38.yml Конда активирует proactivehealthgpt_py38 pip установить cpm_kernels pip install torch==1.13.1+cu116 torchvision==0.14.1+cu116 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu116

[Дополнение] Пользователям Windows рекомендуется обратиться к следующему процессу для настройки среды.

cdBianQue conda create -n proactivehealthgpt_py38 python=3.8 Конда активирует proactivehealthgpt_py38 pip install torch==1.13.1+cu116 torchvision==0.14.1+cu116 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu116 pip install -r требования.txt pip install rouge_chinese nltk jieba datasets# Следующая установка предназначена для запуска demoopip installstreamlit pip installstreamlit_chat

[Дополнение] Настройка CUDA-11.6 под Windows: загрузите и установите CUDA-11.6, загрузите cudnn-8.4.0, разархивируйте и скопируйте файлы по пути, соответствующему CUDA-11.6, см.: Использование conda для установки pytorch под win11-cuda11 6-Общие идеи установки.

Вызов модели SoulChat в Python

import torchfrom Transformers import AutoModel, AutoTokenizer# настройки графического процессора устройство = torch.device("cuda" if torch.cuda.is_available() else "cpu")# Загрузка модели с токенизатором model_name_or_path = 'scutcyr/SoulChat' model = AutoModel.from_pretrained( имя_модели_или_путь , trust_remote_code=True).half()model.to(device)tokenizer = AutoTokenizer.from_pretrained(model_name_or_path,trust_remote_code=True)# Однораундовый диалог вызывает функцию чата модели user_input = "Я тоскую по любви, мне так неудобно input_text!" = "Пользователь :" + user_input + "nПсихологический консультант:"ответ, история = model.chat(tokenizer, query=input_text, History=None, max_length=2048, num_beams=1, do_sample=True, top_p=0,75, температура=0,95, logits_processor=None)# Вызов функции чата модели для нескольких раундов диалог# Примечание. В этом проекте используются «n пользователей:» и «n психологический консультант:» для разделения истории разговоров в разных раундах# Примечание: user_history длиннее, чем bot_history 1user_history = ['Привет, учитель', 'Моя девушка рассталась со мной, и мне так неловко']bot_history = ['Привет! Я ваш личный цифровой консультант, Милый Учитель. Приглашаем вас поговорить со мной по душам. Я с нетерпением жду возможности помочь вам! ']# Соединение истории разговора context = "n".join([f"User: {user_history[i]}n Психологический консультант: {bot_history[i]}" for i in range(len(bot_history))])input_text = context + "nuser:" + user_history[-1] + "npsychological консультант:" ответ, история = model.chat(tokenizer, query=input_text, история = нет, max_length = 2048, num_beams = 1, do_sample = True, top_p = 0,75, температура = 0,95, logits_processor = нет)Запустить службу

Этот проект предоставляет файл Soulchat_app.py в качестве примера использования модели SoulChat. Вы можете запустить службу с помощью следующей команды, а затем получить к ней доступ через http://<ваш_ip>:9026.

runlit run Soulchat_app.py --server.port 9026

В частности, в Soulchat_app.py вы можете изменить следующий код, чтобы заменить указанную видеокарту:

os.environ['CUDA_VISIBLE_DEVICES'] = '2'

Для пользователей Windows с одной видеокартой необходимо изменить его на: os.environ['CUDA_VISIBLE_DEVICES'] = '0' , в противном случае будет сообщено об ошибке!

Вы можете указать путь к модели как локальный, изменив следующий код:

model_name_or_path = 'scutcyr/SoulChat'

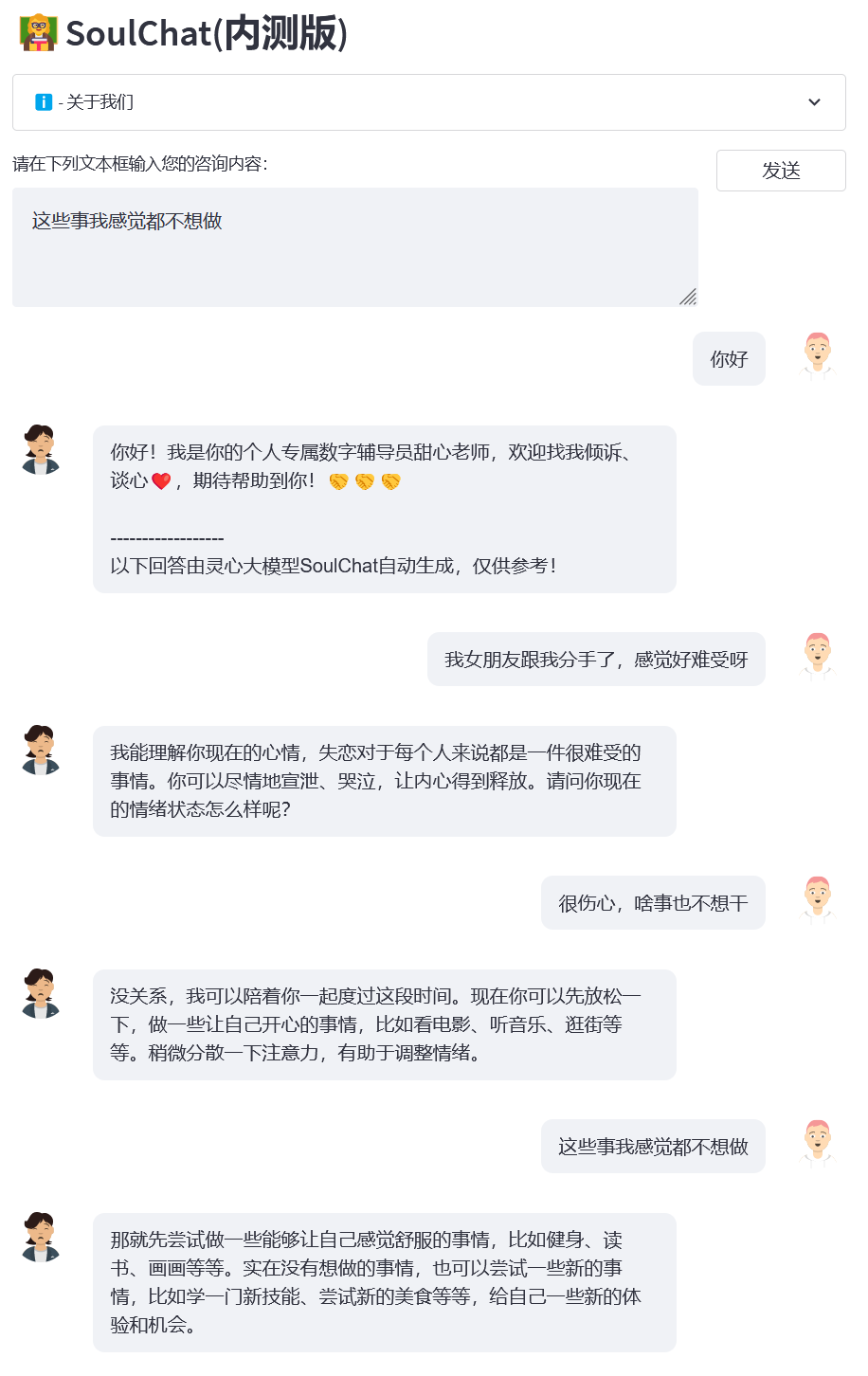

Пример 1: Потерян в любви

Пример 2: Отношения в общежитии

Пример 3: Итоговый экзамен

Пример 4: Давление научных исследований

Этот проект использует веса модели ChatGLM-6B и должен соответствовать ее MODEL_LICENSE. Поэтому этот проект можно использовать только в некоммерческих исследовательских целях .

Модель SoulChat, предоставленная в этом проекте, предназначена для улучшения эмпатического диалога и возможностей слушания больших моделей. Однако выходной текст модели имеет определенную степень случайности, что уместно, когда она используется в качестве слушателя, но это так. не рекомендуется использовать модель SoulChat. Выводной текст заменяет диагноз и консультацию психолога и т.п. Этот проект не гарантирует, что вывод текста по модели полностью подходит пользователям. Пользователи должны нести все риски при использовании этой модели!

Вы не имеете права использовать, копировать, изменять, объединять, публиковать, распространять, воспроизводить или создавать производные работы Модели SoulChat полностью или частично для каких-либо коммерческих, военных или незаконных целей.

Вы не можете использовать модель SoulChat для каких-либо действий, которые ставят под угрозу национальную безопасность и национальное единство, ставят под угрозу социальные и общественные интересы или ущемляют личные права.

При использовании модели SoulChat вы должны знать, что она не может заменить таких профессионалов, как врачи и психологи. Вы не должны чрезмерно полагаться, подчиняться или верить в результаты модели, а также не должны увлекаться общением с SoulChat. модель уже давно.

Этот проект был инициирован Лабораторией цифровых двойников провинции Гуандун, Школой технологий будущего Южно-Китайского технологического университета. Он поддерживается Исследовательским центром информационных сетей, Школой электроники и информации и другими факультетами Южно-Китайского технологического университета. Он также выражает благодарность больнице материнства и детства Гуандуна, сотрудничающим подразделениям муниципального правительства Гуанчжоу, включая Медицинский центр для женщин и детей, Третью дочернюю больницу Университета Сунь Ятсена и Научно-исследовательский институт искусственного интеллекта Комплексного национального научного центра Хэфэй.

В то же время мы хотели бы поблагодарить следующие средства массовой информации или публичные аккаунты за освещение этого проекта (в произвольном порядке):

Освещение в СМИ People's Daily, China.com, Guangming.com, TOM Technology, Future.com, Dazhong.com, China Development Report Network, China Daily Network, Xinhua News Network, China.com, Toutiao, Sohu, Tencent News, NetEase News , Китайская информационная сеть , Китайская коммуникационная сеть, Китайская городская сеть отчетов, Китайская городская сеть

Государственный счет Строительство лаборатории в Гуандуне, Интеллектуальный голос, новая молодежь, глубокое обучение и НЛП, AINLP

@inproceedings{chen-etal-2023-soulchat,title = "{S}oul{C}hat: улучшение способностей {LLM}s{'} к эмпатии, слушанию и комфорту посредством тонкой настройки с помощью многоходовых бесед с эмпатией", автор = "Чэнь, Ижун и Син, Сяофэнь и Линь, Цзинкай и Чжэн, Хуэйминь и Ван, Чжэньюй и Лю, Ци и Сюй, Сянмин",editor = "Буамор, Хода и Пино, Хуан и Бали, Калика",booktitle = "Выводы Ассоциации компьютерной лингвистики: EMNLP 2023",month = dec,year = "2023",address = "Сингапур", издатель = "Ассоциация компьютерной лингвистики",url = "https://aclanthology.org/2023.findings-emnlp.83",pages="1170--1183",abstract = "Большие языковые модели (LLM) широко применяются в различных областях благодаря своим превосходным возможностям запоминания. знания и цепочка мыслей (ЦП). Когда эти языковые модели применяются в области психологического консультирования, они часто стремятся дать универсальный совет. Однако, когда пользователи обращаются за психологической поддержкой, им необходимо вызвать сочувствие, доверие, понимание и комфорт, а не просто разумный совет. С этой целью мы создали набор данных многоэтапных эмпатических разговоров, состоящий из более чем 2 миллионов образцов, в которых входными данными является контекст многоэтапного разговора, а целью — эмпатические ответы. которые охватывают такие выражения, как вопросы, комфорт, узнавание, слушание, доверие, эмоциональная поддержка и т. д. Эксперименты показали, что способность LLM к эмпатии может быть значительно улучшена при точной настройке за счет использования истории многоходового диалога и ответов, которые ближе к выражению. психолога-консультанта.",

}}