Обнаружение выбросов Python (PyOD)

Развертывание, документация, статистика и лицензия

Прочитай меня первым

Добро пожаловать в PyOD, комплексную, но простую в использовании библиотеку Python для обнаружения аномалий в многомерных данных. Независимо от того, занимаетесь ли вы небольшим проектом или большими наборами данных, PyOD предлагает ряд алгоритмов, отвечающих вашим потребностям.

- Для обнаружения выбросов во временных рядах используйте TODS.

- Для обнаружения выбросов на графике используйте PyGOD.

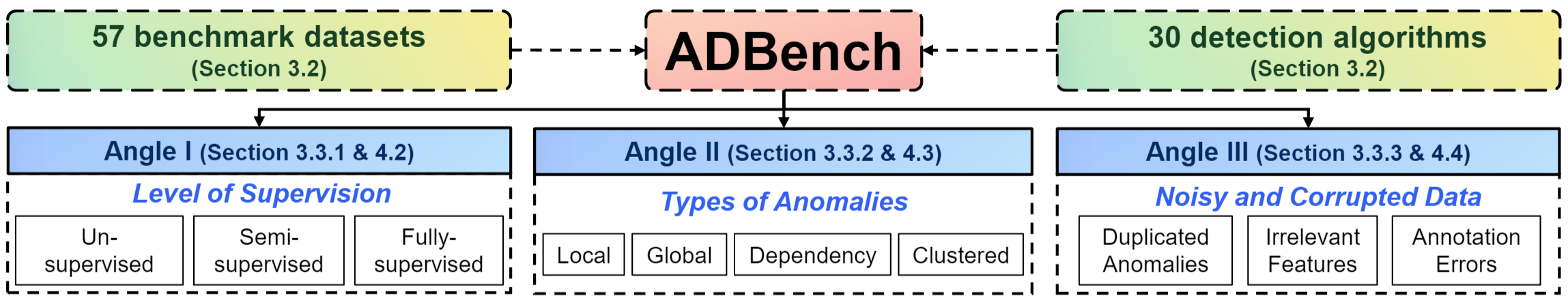

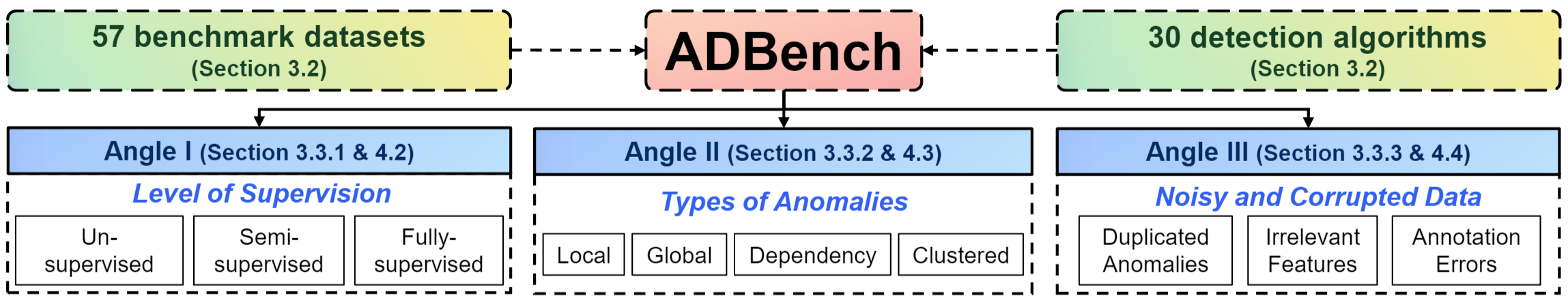

- Сравнение производительности и наборы данных : у нас есть 45-страничный подробный эталонный документ по обнаружению аномалий. ADBench с полностью открытым исходным кодом сравнивает 30 алгоритмов обнаружения аномалий на 57 наборах эталонных данных.

- Узнайте больше об обнаружении аномалий на Ресурсах по обнаружению аномалий.

- PyOD в распределенных системах : вы также можете запускать PyOD на блоках данных.

О ПиОД

PyOD, созданная в 2017 году, стала популярной библиотекой Python для обнаружения аномальных/удаленных объектов в многомерных данных. Эту захватывающую, но сложную область обычно называют обнаружением выбросов или обнаружением аномалий.

PyOD включает более 50 алгоритмов обнаружения: от классического LOF (SIGMOD 2000) до новейших ECOD и DIF (TKDE 2022 и 2023). С 2017 года PyOD успешно используется в многочисленных академических исследовательских проектах и коммерческих продуктах, скачанных более 22 миллионов раз. Сообщество машинного обучения также высоко оценило его благодаря различным специальным публикациям и руководствам, включая Analytics Vidhya, KDnuggets и Towards Data Science.

PyOD представлен для :

- Единый, удобный интерфейс для различных алгоритмов.

- Широкий выбор моделей : от классических методов до новейших методов глубокого обучения в PyTorch .

- Высокая производительность и эффективность , использование numba и joblib для JIT-компиляции и параллельной обработки.

- Быстрое обучение и прогнозирование , достигаемое с помощью структуры SUOD [50].

Обнаружение выбросов с помощью 5 строк кода :

# Example: Training an ECOD detector

from pyod . models . ecod import ECOD

clf = ECOD ()

clf . fit ( X_train )

y_train_scores = clf . decision_scores_ # Outlier scores for training data

y_test_scores = clf . decision_function ( X_test ) # Outlier scores for test data

Выбор правильного алгоритма: не знаете, с чего начать? Рассмотрим эти надежные и интерпретируемые варианты:

- ECOD: пример использования ECOD для обнаружения выбросов

- Изоляционный лес: пример использования изоляционного леса для обнаружения выбросов

Альтернативно, изучите MetaOD для подхода, основанного на данных.

Цитируя PyOD :

Статья PyOD опубликована в журнале Journal of Machine Learning Research (JMLR) (трек MLOSS). Если вы используете PyOD в научной публикации, мы будем признательны за ссылки на следующую статью:

@article{zhao2019pyod,

автор = {Чжао, Юэ и Насрулла, Зайн и Ли, Чжэн},

title = {PyOD: набор инструментов Python для масштабируемого обнаружения выбросов},

журнал = {Журнал исследований машинного обучения},

год = {2019},

объем = {20},

число = {96},

страницы = {1-7},

URL = {http://jmlr.org/papers/v20/19-011.html}

}

или:

Чжао Ю., Насрулла З. и Ли З., 2019. PyOD: набор инструментов Python для масштабируемого обнаружения выбросов. Журнал исследований машинного обучения (JMLR), 20 (96), стр. 1–7.

Более широкий взгляд на обнаружение аномалий см. в наших документах NeurIPS: ADBench: Тестовый документ по обнаружению аномалий и ADGym: Выбор дизайна для глубокого обнаружения аномалий:

@article{han2022adbench,

title={Adbench: тест обнаружения аномалий},

автор={Хань, Сунцяо и Ху, Сиян и Хуан, Хайлян и Цзян, Минци и Чжао, Юэ},

журнал={Достижения в области нейронных систем обработки информации},

объем={35},

страницы={32142--32159},

год={2022}

}

@article{jiang2023adgym,

title={ADGym: варианты дизайна для глубокого обнаружения аномалий},

автор={Цзян, Минци и Хоу, Чаочуань и Чжэн, Ао и Хань, Сунцяо и Хуан, Хайлян и Вэнь, Цинсун и Ху, Сиян и Чжао, Юэ},

журнал={Достижения в области нейронных систем обработки информации},

объем = {36},

год={2023}

}

Оглавление :

- Установка

- Памятка и справочник по API

- Тест ADBench и наборы данных

- Сохранить и загрузить модель

- Скорый поезд с СУОД

- Пороговые значения выбросов

- Реализованные алгоритмы

- Быстрый старт для обнаружения выбросов

- Как внести свой вклад

- Критерии включения

Установка

PyOD разработан для простой установки с использованием pip или conda . Мы рекомендуем использовать последнюю версию PyOD из-за частых обновлений и улучшений:

pip install pyod # normal install

pip install --upgrade pyod # or update if needed

conda install -c conda-forge pyod

Альтернативно вы можете клонировать и запустить файл setup.py:

git clone https://github.com/yzhao062/pyod.git

cd pyod

pip install .

Необходимые зависимости :

- Питон 3.8 или выше

- библиотека заданий

- matplotlib

- число >= 1,19

- число>=0,51

- scipy>= 1.5.1

- scikit_learn>=0.22.0

Дополнительные зависимости (см. подробности ниже) :

- комбо (необязательно, требуется для models/combination.py и FeatureBaging)

- pytorch (необязательно, требуется для AutoEncoder и других моделей глубокого обучения)

- suod (необязательно, требуется для запуска модели SUOD)

- xgboost (необязательно, требуется для XGBOD)

- pythresh (необязательно, требуется для определения порога)

Памятка и справочник по API

Полный справочник по API доступен в документации PyOD. Ниже приведена краткая шпаргалка для всех детекторов:

- fit(X) : Установите детектор. Параметр y игнорируется в неконтролируемых методах.

- Decision_function(X) : Прогнозирует необработанные оценки аномалий для X с помощью встроенного детектора.

- Predict(X) : Определите, является ли образец выбросом или нет, в виде двоичных меток, используя установленный детектор.

- предик_проба(X) : Оцените вероятность того, что образец окажется выбросом, используя подобранный детектор.

- предиктор_конфиденци(Х) : оценка достоверности модели для каждой выборки (применимо в прогнозировании и прогнозировании_проба) [35].

Основные характеристики готовой модели :

- Decision_scores_ : Выбросы оценок обучающих данных. Более высокие баллы обычно указывают на более ненормальное поведение. Выбросы обычно имеют более высокие баллы.

- labels_ : двоичные метки обучающих данных, где 0 указывает на выбросы, а 1 указывает на выбросы/аномалии.

Тест ADBench и наборы данных

Мы только что выпустили 45-страничный наиболее полный тест ADBench: Anomaly Detection Benchmark [15]. ADBench с полностью открытым исходным кодом сравнивает 30 алгоритмов обнаружения аномалий на 57 наборах эталонных данных.

Организация ADBench представлена ниже:

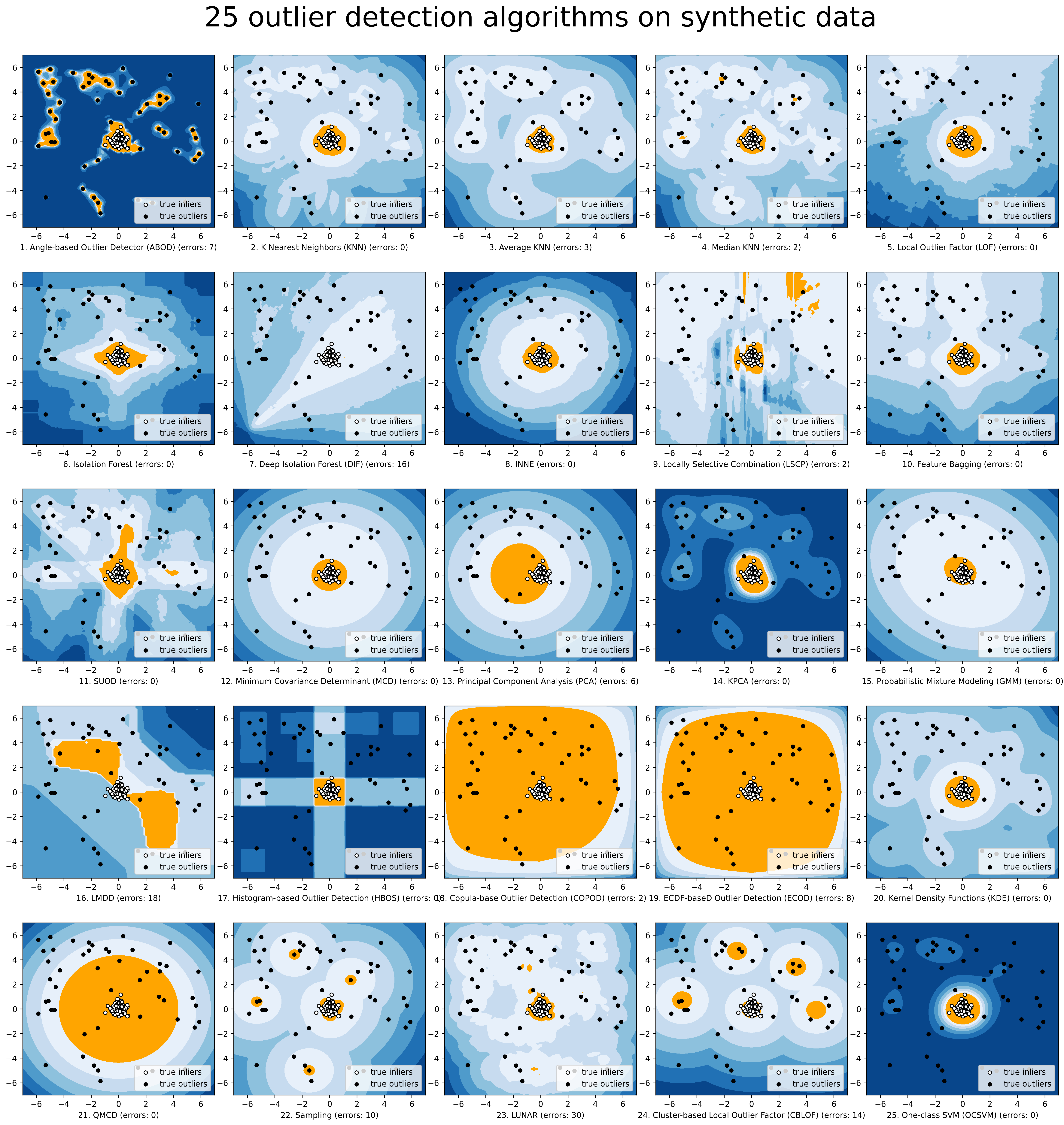

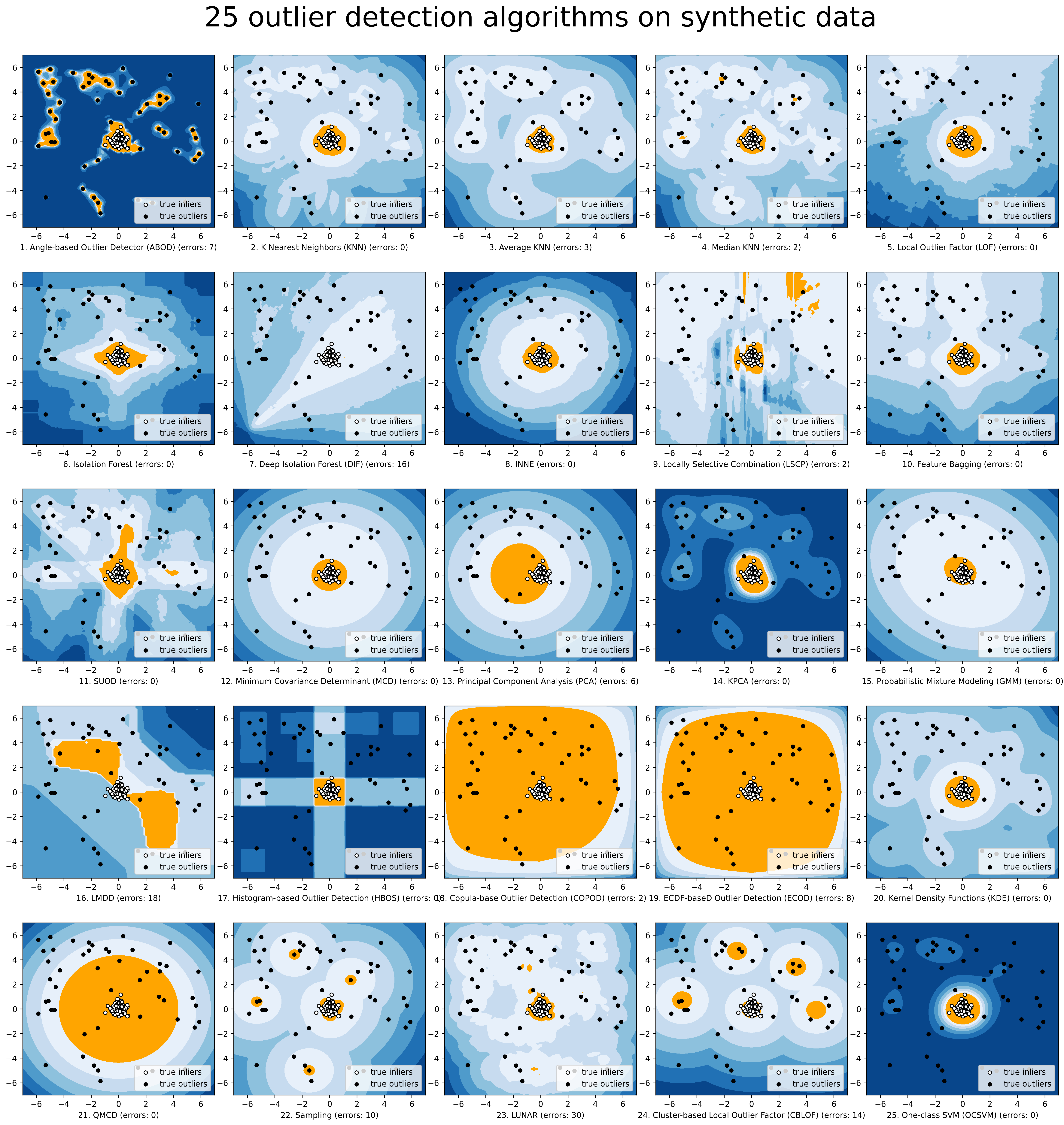

Для более простой визуализации мы проводим сравнение выбранных моделей через Compare_all_models.py.

Сохранить и загрузить модель

PyOD использует аналогичный подход sklearn в отношении сохранения модели. См. постоянство модели для пояснения.

Короче говоря, мы рекомендуем использовать joblib или Pickle для сохранения и загрузки моделей PyOD. Пример см. в «examples/save_load_model_example.py». Короче говоря, это просто, как показано ниже:

from joblib import dump , load

# save the model

dump ( clf , 'clf.joblib' )

# load the model

clf = load ( 'clf.joblib' )

Известно, что существуют проблемы с сохранением нейросетевых моделей. Проверьте № 328 и № 88 для временного решения.

Скорый поезд с СУОД

Быстрое обучение и прогнозирование : в PyOD можно обучать и прогнозировать с помощью большого количества моделей обнаружения, используя структуру SUOD [50]. См. документ SUOD и пример SUOD.

from pyod . models . suod import SUOD

# initialized a group of outlier detectors for acceleration

detector_list = [ LOF ( n_neighbors = 15 ), LOF ( n_neighbors = 20 ),

LOF ( n_neighbors = 25 ), LOF ( n_neighbors = 35 ),

COPOD (), IForest ( n_estimators = 100 ),

IForest ( n_estimators = 200 )]

# decide the number of parallel process, and the combination method

# then clf can be used as any outlier detection model

clf = SUOD ( base_estimators = detector_list , n_jobs = 2 , combination = 'average' ,

verbose = False )

Пороговые значения выбросов

При установлении уровня загрязнения можно использовать более основанный на данных подход. Используя метод определения порога, угадывание произвольного значения можно заменить проверенными методами разделения выбросов и выбросов. Обратитесь к PyThresh для более подробного изучения порогового значения.

from pyod . models . knn import KNN

from pyod . models . thresholds import FILTER

# Set the outlier detection and thresholding methods

clf = KNN ( contamination = FILTER ())

См. поддерживаемые методы определения порогов в разделе «Пороговые значения».

Реализованные алгоритмы

Инструментарий PyOD состоит из четырех основных функциональных групп:

(i) Индивидуальные алгоритмы обнаружения :

| Тип | Сокр. | Алгоритм | Год | Ссылка |

|---|

| Вероятностный | ЭКОД | Неконтролируемое обнаружение выбросов с использованием эмпирических кумулятивных функций распределения | 2022 год | [28] |

| Вероятностный | АВОД | Обнаружение выбросов по углу | 2008 год | [22] |

| Вероятностный | ФастАБОД | Быстрое обнаружение выбросов на основе угла с использованием аппроксимации | 2008 год | [22] |

| Вероятностный | ХОПОД | COPOD: обнаружение выбросов на основе копулы | 2020 год | [27] |

| Вероятностный | БЕЗУМНЫЙ | Медианное абсолютное отклонение (MAD) | 1993 год | [19] |

| Вероятностный | SOS | Выбор стохастического выброса | 2012 год | [20] |

| Вероятностный | КМКД | Обнаружение выбросов квази-Монте-Карло | 2001 г. | [11] |

| Вероятностный | КДЕ | Обнаружение выбросов с помощью функций плотности ядра | 2007 год | [24] |

| Вероятностный | Выборка | Быстрое обнаружение выбросов на основе расстояния посредством выборки | 2013 год | [42] |

| Вероятностный | ГММ | Вероятностное моделирование смесей для анализа выбросов | | [1] [Гл.2] |

| Линейная модель | СПС | Анализ главных компонентов (сумма взвешенных проекций расстояний до гиперплоскостей собственных векторов) | 2003 г. | [41] |

| Линейная модель | КПКА | Анализ главных компонентов ядра | 2007 год | [18] |

| Линейная модель | МЦД | Определитель минимальной ковариации (используйте расстояния Махаланобиса в качестве оценок выбросов) | 1999 год | [16] [37] |

| Линейная модель | компакт-диск | Используйте расстояние Кука для обнаружения выбросов | 1977 год | [10] |

| Линейная модель | ОКСВМ | Одноклассовые машины опорных векторов | 2001 г. | [40] |

| Линейная модель | ЛМДД | Обнаружение выбросов на основе отклонений (LMDD) | 1996 год | [6] |

| На основе близости | ЛОФ | Локальный фактор выбросов | 2000 г. | [8] |

| На основе близости | КОФ | Коэффициент выбросов, основанный на связности | 2002 г. | [43] |

| На основе близости | (Дополнительно) COF | Фактор выбросов на основе эффективного подключения к памяти (медленнее, но снижает сложность хранения) | 2002 г. | [43] |

| На основе близости | ЦБЛОФ | Фактор локального выброса на основе кластеризации | 2003 г. | [17] |

| На основе близости | LOCI | LOCI: быстрое обнаружение выбросов с использованием интеграла локальной корреляции. | 2003 г. | [33] |

| На основе близости | ГБОС | Оценка выбросов на основе гистограммы | 2012 год | [12] |

| На основе близости | кНН | k Ближайшие соседи (используйте расстояние до k-го ближайшего соседа в качестве оценки выброса) | 2000 г. | [36] |

| На основе близости | AvgKNN | Среднее значение kNN (в качестве оценки выброса используйте среднее расстояние до k ближайших соседей) | 2002 г. | [5] |

| На основе близости | МедКНН | Медианный kNN (используйте медианное расстояние до k ближайших соседей в качестве оценки выброса) | 2002 г. | [5] |

| На основе близости | ДЕРН | Обнаружение выбросов в подпространстве | 2009 год | [23] |

| На основе близости | СТЕРЖЕНЬ | Обнаружение выбросов на основе вращения | 2020 год | [4] |

| Выбросы ансамблей | IForest | Изоляционный лес | 2008 год | [29] |

| Выбросы ансамблей | ИННЕ | Обнаружение аномалий на основе изоляции с использованием ансамблей ближайших соседей | 2018 год | [7] |

| Выбросы ансамблей | ДИФ | Глубокий изолированный лес для обнаружения аномалий | 2023 год | [45] |

| Выбросы ансамблей | ФБ | Упаковка функций | 2005 г. | [25] |

| Выбросы ансамблей | ЛСКП | LSCP: локально избирательная комбинация параллельных ансамблей выбросов | 2019 год | [49] |

| Выбросы ансамблей | XGBOD | Обнаружение выбросов на основе экстремального повышения (контролируемое) | 2018 год | [48] |

| Выбросы ансамблей | ЛОДА | Легкий онлайн-детектор аномалий | 2016 год | [34] |

| Выбросы ансамблей | СУОД | SUOD: Ускорение крупномасштабного неконтролируемого обнаружения гетерогенных выбросов (ускорение) | 2021 год | [50] |

| Нейронные сети | Автоэнкодер | Полностью подключенный автоэнкодер (используйте ошибку реконструкции в качестве оценки выброса) | | [1] [Гл.3] |

| Нейронные сети | ВАЭ | Вариационный автоэнкодер (используйте ошибку реконструкции в качестве оценки выброса) | 2013 год | [21] |

| Нейронные сети | Бета-ВАЭ | Вариационный автоэнкодер (все настраиваемые параметры потерь за счет изменения гаммы и емкости) | 2018 год | [9] |

| Нейронные сети | SO_GAAL | Одноцелевое генеративно-состязательное активное обучение | 2019 год | [30] |

| Нейронные сети | МО_ГААЛ | Многоцелевое генеративно-состязательное активное обучение | 2019 год | [30] |

| Нейронные сети | ДипСВДД | Глубокая одноклассовая классификация | 2018 год | [38] |

| Нейронные сети | АноГАН | Обнаружение аномалий с помощью генеративно-состязательных сетей | 2017 год | [39] |

| Нейронные сети | АЛАД | Обнаружение аномалий с использованием состязательного обучения | 2018 год | [47] |

| Нейронные сети | АЕ1СВМ | Одноклассовая машина опорных векторов на основе автоэнкодера | 2019 год | [31] |

| Нейронные сети | DevNet | Обнаружение глубоких аномалий с помощью сетей отклонений | 2019 год | [32] |

| на основе графа | R-график | Обнаружение выбросов с помощью R-графика | 2017 год | [46] |

| на основе графа | ЛУННЫЙ | LUNAR: унификация методов обнаружения локальных выбросов с помощью графовых нейронных сетей | 2022 год | [13] |

(ii) Ансамбли выбросов и комбинированные системы детекторов выбросов :

| Тип | Сокр. | Алгоритм | Год | Ссылка |

|---|

| Выбросы ансамблей | ФБ | Упаковка функций | 2005 г. | [25] |

| Выбросы ансамблей | ЛСКП | LSCP: локально избирательная комбинация параллельных ансамблей выбросов | 2019 год | [49] |

| Выбросы ансамблей | XGBOD | Обнаружение выбросов на основе экстремального повышения (контролируемое) | 2018 год | [48] |

| Выбросы ансамблей | ЛОДА | Легкий онлайн-детектор аномалий | 2016 год | [34] |

| Выбросы ансамблей | СУОД | SUOD: Ускорение крупномасштабного неконтролируемого обнаружения гетерогенных выбросов (ускорение) | 2021 год | [50] |

| Выбросы ансамблей | ИННЕ | Обнаружение аномалий на основе изоляции с использованием ансамблей ближайших соседей | 2018 год | [7] |

| Комбинация | Средний | Простая комбинация путем усреднения баллов | 2015 год | [2] |

| Комбинация | Средневзвешенное значение | Простая комбинация путем усреднения оценок с весами детектора | 2015 год | [2] |

| Комбинация | Максимизация | Простая комбинация, набирающая максимальное количество очков | 2015 год | [2] |

| Комбинация | АОМ | Среднее от максимума | 2015 год | [2] |

| Комбинация | МОА | Максимизация среднего | 2015 год | [2] |

| Комбинация | медиана | Простая комбинация с использованием медианы оценок | 2015 год | [2] |

| Комбинация | большинство голосов | Простая комбинация путем получения большинства голосов от меток (можно использовать веса) | 2015 год | [2] |

(iii) Функции полезности :

| Тип | Имя | Функция | Документация |

|---|

| Данные | генерировать_данные | Генерация синтезированных данных; нормальные данные генерируются многомерным гауссианом, а выбросы генерируются равномерным распределением. | генерировать_данные |

| Данные | генерировать_данные_кластеры | Генерация синтезированных данных в кластерах; более сложные шаблоны данных можно создавать с помощью нескольких кластеров | генерировать_данные_кластеры |

| Стат | wpearsonr | Рассчитайте взвешенную корреляцию Пирсона двух выборок. | wpearsonr |

| Утилита | get_label_n | Превратите необработанные оценки выбросов в двоичные метки, присвоив 1 первым n баллам выбросов. | get_label_n |

| Утилита | Precision_n_scores | вычислить точность @ ранг n | Precision_n_scores |

Быстрый старт для обнаружения выбросов

PyOD получил высокую оценку сообщества машинного обучения благодаря нескольким опубликованным публикациям и руководствам.

Analytics Vidhya : потрясающее руководство по обнаружению выбросов в Python с использованием библиотеки PyOD

KDnuggets : Интуитивная визуализация методов обнаружения выбросов, обзор методов обнаружения выбросов от PyOD

На пути к науке о данных : обнаружение аномалий для чайников

«examples/knn_example.py» демонстрирует базовый API использования детектора kNN. Следует отметить, что API всех остальных алгоритмов являются единообразными/похожими .

Более подробные инструкции по запуску примеров можно найти в каталоге примеров.

Инициализируйте детектор kNN, подгоните модель и сделайте прогноз.

from pyod . models . knn import KNN # kNN detector

# train kNN detector

clf_name = 'KNN'

clf = KNN ()

clf . fit ( X_train )

# get the prediction label and outlier scores of the training data

y_train_pred = clf . labels_ # binary labels (0: inliers, 1: outliers)

y_train_scores = clf . decision_scores_ # raw outlier scores

# get the prediction on the test data

y_test_pred = clf . predict ( X_test ) # outlier labels (0 or 1)

y_test_scores = clf . decision_function ( X_test ) # outlier scores

# it is possible to get the prediction confidence as well

y_test_pred , y_test_pred_confidence = clf . predict ( X_test , return_confidence = True ) # outlier labels (0 or 1) and confidence in the range of [0,1]

Оцените прогноз ROC и Precision @ Rank n (p@n).

from pyod . utils . data import evaluate_print

# evaluate and print the results

print ( " n On Training Data:" )

evaluate_print ( clf_name , y_train , y_train_scores )

print ( " n On Test Data:" )

evaluate_print ( clf_name , y_test , y_test_scores )

См. пример вывода и визуализации.

On Training Data :

KNN ROC : 1.0 , precision @ rank n : 1.0

On Test Data :

KNN ROC : 0.9989 , precision @ rank n : 0.9

visualize ( clf_name , X_train , y_train , X_test , y_test , y_train_pred ,

y_test_pred , show_figure = True , save_figure = False )

Визуализация (knn_figure):

Ссылка

| [1] | (1, 2) Аггарвал, К.С., 2015. Анализ выбросов. В интеллектуальном анализе данных (стр. 237–263). Спрингер, Чам. |

| [2] | (1, 2, 3, 4, 5, 6, 7) Аггарвал, К.С. и Сате, С., 2015. Теоретические основы и алгоритмы для ансамблей выбросов. Информационный бюллетень ACM SIGKDD Explorations , 17(1), стр.24-47. |

| [3] | Аггарвал, К.С. и Сате, С., 2017. Ансамбли выбросов: введение. Спрингер. |

| [4] | Алмардени Ю., Бужна Н. и Клири Ф., 2020. Новый метод обнаружения выбросов для многомерных данных. Транзакции IEEE по знаниям и инженерии данных . |

| [5] | (1, 2) Ангиулли Ф. и Пиццути К., август 2002 г. Быстрое обнаружение выбросов в пространствах большой размерности. На Европейской конференции по принципам интеллектуального анализа данных и обнаружения знаний, стр. 15-27. |

| [6] | Арнинг А., Агравал Р. и Рагхаван П., август 1996 г. Линейный метод обнаружения отклонений в больших базах данных. В КДД (т. 1141, № 50, стр. 972-981). |

| [7] | (1, 2) Бандарагода Т.Р., Тинг К.М., Альбрехт Д., Лю Ф.Т., Чжу Ю. и Уэллс Дж.Р., 2018 г. Обнаружение аномалий на основе изоляции с использованием ансамблей ближайших соседей. Вычислительный интеллект , 34(4), стр. 968-998. |

| [8] | Брюниг, М.М., Кригель, Х.П., Нг, РТ и Сандер, Дж., 2000, май. LOF: выявление локальных выбросов на основе плотности. ACM Sigmod Record , 29 (2), стр. 93–104. |

| [9] | Берджесс, Кристофер П. и др. «Понимание распутывания в бета-VAE». Препринт arXiv arXiv:1804.03599 (2018). |

| [10] | Кук, Р.Д., 1977. Обнаружение влиятельных наблюдений в линейной регрессии. Технометрика, 19(1), стр.15-18. |

| [11] | Фанг, К.Т. и Ма, CX, 2001. Обход L2-несоответствия случайной выборки, латинского гиперкуба и однородных планов. Журнал сложности, 17 (4), стр. 608-624. |

| [12] | Гольдштейн М. и Денгел А., 2012. Оценка выбросов на основе гистограммы (hbos): быстрый алгоритм обнаружения аномалий без присмотра. В КИ-2012: Афиша и демо-трек , стр.59-63. |

| [13] | Гудж А., Хои Б., Нг, С.К. и Нг, В.С., июнь 2022 г. Лунный: унификация методов обнаружения локальных выбросов с помощью графовых нейронных сетей. В материалах конференции AAAI по искусственному интеллекту. |

| [14] | Гопалан П., Шаран В. и Видер У., 2019. PIDForest: обнаружение аномалий посредством частичной идентификации. В книге «Достижения в области нейронных систем обработки информации», стр. 15783-15793. |

| [15] | Хан С., Ху Х., Хуан Х., Цзян М. и Чжао Ю., 2022. ADBench: Тест обнаружения аномалий. Препринт arXiv arXiv:2206.09426. |

| [16] | Хардин Дж. и Рок Д.М., 2004. Обнаружение выбросов в условиях множественного кластера с использованием средства оценки детерминанта минимальной ковариации. Вычислительная статистика и анализ данных , 44(4), стр.625-638. |

| [17] | Хэ З., Сюй Х. и Дэн С., 2003. Обнаружение локальных выбросов на основе кластеров. Письма о распознавании образов , 24 (9–10), стр. 1641–1650. |

| [18] | Хоффманн, Х., 2007. Kernel PCA для обнаружения новинок. Распознавание образов, 40(3), стр.863-874. |

| [19] | Иглевич Б. и Хоглин Округ Колумбия, 1993. Как обнаружить выбросы и справиться с ними (том 16). Аск Пресс. |

| [20] | Янссенс, Дж. Х. М., Хусар, Ф., Постма, Э. О. и ван ден Херик, Х. Дж., 2012. Выбор стохастических выбросов. Технический отчет TiCC TR 2012-001, Тилбургский университет, Тилбургский центр познания и коммуникации, Тилбург, Нидерланды. |

| [21] | Кингма, Д.П. и Веллинг, М., 2013. Вариационное байесовское кодирование. Препринт arXiv arXiv:1312.6114. |

| [22] | (1, 2) Кригель, Х.П. и Зимек, А., август 2008 г. Обнаружение выбросов на основе угла в многомерных данных. В KDD '08 , стр. 444–452. АКМ. |

| [23] | Кригель Х.П., Крегер П., Шуберт Э. и Зимек А., апрель 2009 г. Обнаружение выбросов в подпространствах, параллельных осям, данных большой размерности. На Тихоокеанско-Азиатской конференции по обнаружению знаний и интеллектуальному анализу данных , стр. 831-838. Шпрингер, Берлин, Гейдельберг. |

| [24] | Латецкий Л.Дж., Лазаревич А. и Покраяц Д., июль 2007 г. Обнаружение выбросов с помощью функций плотности ядра. На международном семинаре по машинному обучению и интеллектуальному анализу данных в распознавании образов (стр. 61-75). Шпрингер, Берлин, Гейдельберг. |

| [25] | (1, 2) Лазаревич А. и Кумар В., август 2005 г. Объединение функций для обнаружения выбросов. В КДД '05 . 2005. |

| [26] | Ли Д., Чен Д., Джин Б., Ши Л., Го Дж. и Нг, СК, 2019 г., сентябрь. MAD-GAN: многомерное обнаружение аномалий для данных временных рядов с помощью генеративно-состязательных сетей. На Международной конференции по искусственным нейронным сетям (стр. 703-716). Спрингер, Чам. |

| [27] | Ли З., Чжао Ю., Ботта Н., Ионеску К. и Ху Х. COPOD: обнаружение выбросов на основе копул. Международная конференция IEEE по интеллектуальному анализу данных (ICDM) , 2020 г. |

| [28] | Ли З., Чжао Ю., Ху Х., Ботта Н., Ионеску К. и Чен Х. Г. ECOD: неконтролируемое обнаружение выбросов с использованием эмпирических кумулятивных функций распределения. IEEE Transactions on Knowledge and Data Engineering (TKDE) , 2022. |

| [29] | Лю, Ф.Т., Тинг, К.М. и Чжоу, Ж., 2008 г., декабрь. Изоляционный лес. На Международной конференции по интеллектуальному анализу данных , стр. 413-422. IEEE. |

| [30] | (1, 2) Лю, Ю., Ли, З., Чжоу, К., Цзян, Ю., Сунь, Дж., Ван, М. и Хэ, Х., 2019. Генеративно-состязательное активное обучение для обнаружения выбросов без присмотра . Транзакции IEEE по знаниям и инженерии данных . |

| [31] | Нгуен, Миннесота и Вьен, Северная Каролина, 2019. Масштабируемые и интерпретируемые одноклассовые SVM с глубоким обучением и случайными функциями Фурье. Машинное обучение и обнаружение знаний в базах данных: Европейская конференция , ECML PKDD, 2018. |

| [32] | Пан, Гуаньсун, Чуньхуа Шен и Антон Ван Ден Хенгель. «Глубокое обнаружение аномалий с помощью сетей отклонений». В КДД , стр. 353-362. 2019. |

| [33] | Пападимитриу С., Китагава Х., Гиббонс П.Б. и Фалуцос К., 2003 г., март. LOCI: быстрое обнаружение выбросов с использованием интеграла локальной корреляции. В ICDE '03 , стр. 315–326. IEEE. |

| [34] | (1, 2) Певны Т., 2016. Лода: Легкий онлайн-детектор аномалий. Машинное обучение , 102(2), стр.275-304. |

| [35] | Перини Л., Веркруйссен В., Дэвис Дж. Количественная оценка достоверности детекторов аномалий в их предсказаниях на примерах. На совместной европейской конференции по машинному обучению и обнаружению знаний в базах данных (ECML-PKDD) , 2020 г. |

| [36] | Рамасвами С., Растоги Р. и Шим К., май 2000 г. Эффективные алгоритмы обнаружения выбросов из больших наборов данных. ACM Sigmod Record , 29 (2), стр. 427–438. |

| [37] | Руссеу, П.Дж. и Дриссен, К.В., 1999. Быстрый алгоритм для оценки детерминанта минимальной ковариации. Технометрика , 41(3), стр.212-223. |

| [38] | Рафф Л., Вандермейлен Р., Герниц Н., Дикке Л., Сиддики С.А., Биндер А., Мюллер Э. и Клофт М., 2018 г., июль. Глубокая одноклассовая классификация. На Международной конференции по машинному обучению (стр. 4393-4402). ПМЛР. |

| [39] | Шлегль Т., Зеебёк П., Вальдштейн С.М., Шмидт-Эрфурт У. и Лангс Г., 2017, июнь. Неконтролируемое обнаружение аномалий с помощью генеративно-состязательных сетей для управления обнаружением маркеров. На Международной конференции по обработке информации в медицинской визуализации (стр. 146-157). Спрингер, Чам. |

| [40] | Шолкопф Б., Платт Дж. К., Шоу-Тейлор Дж., Смола А. Дж. и Уильямсон Р. К., 2001. Оценка поддержки многомерного распределения. Нейронные вычисления , 13(7), стр.1443-1471. |

| [41] | Шью М.Л., Чен С.С., Сариннапакорн К. и Чанг Л., 2003. Новая схема обнаружения аномалий, основанная на классификаторе главных компонентов. MIAMI UNIV CORAL GABLES FL ОТДЕЛ ЭЛЕКТРОТЕХНИКИ И КОМПЬЮТЕРНОЙ ТЕХНИКИ . |

| [42] | Сугияма М. и Боргвардт К., 2013. Быстрое обнаружение выбросов на основе расстояния посредством выборки. Достижения в области нейронных систем обработки информации, 26. |

| [43] | (1, 2) Тан Дж., Чен З., Фу, AWC и Чунг, Д.В., 2002 г., май. Повышение эффективности обнаружения выбросов для шаблонов с низкой плотностью. На Тихоокеанско-Азиатской конференции по обнаружению знаний и интеллектуальному анализу данных , стр. 535-548. Шпрингер, Берлин, Гейдельберг. |

| [44] | Ван X., Ду Ю., Линь С., Цуй П., Шен Ю. и Ян Ю., 2019. adVAE: самопротивный вариационный автокодировщик с предварительным знанием гауссовских аномалий для обнаружения аномалий. Системы, основанные на знаниях . |

| [45] | Сюй Х., Панг Г., Ван Ю., Ван Ю., 2023. Глубокий изолирующий лес для обнаружения аномалий. Транзакции IEEE по знаниям и инженерии данных . |

| [46] | Ю, К., Робинсон, Д.П. и Видал, Р., 2017. Доказуемое обнаружение выбросов на основе самопредставления в объединении подпространств. В материалах конференции IEEE по компьютерному зрению и распознаванию образов. |

| [47] | Зенати Х., Ромен М., Фу К.С., Лекуат Б. и Чандрасекхар В., 2018 г., ноябрь. Состязательное обнаружение аномалий. В 2018 году прошла Международная конференция IEEE по интеллектуальному анализу данных (ICDM) (стр. 727-736). IEEE. |

| [48] | (1, 2) Чжао Ю. и Хриневицки, М.К. XGBOD: Улучшение контролируемого обнаружения выбросов с помощью неконтролируемого обучения представлению. Международная совместная конференция IEEE по нейронным сетям , 2018. |

| [49] | (1, 2) Чжао Ю., Насрулла З., Гриневицкий М.К. и Ли З., 2019 г., май. LSCP: Локально селективная комбинация в параллельных ансамблях выбросов. В материалах Международной конференции SIAM по интеллектуальному анализу данных (SDM) 2019 г. , стр. 585-593. Общество промышленной и прикладной математики. |

| [50] | (1, 2, 3, 4) Чжао, Ю., Ху, С., Ченг, К., Ван, К., Ван, К., Ван, В., Ян, Дж., Бай, Х., Ли , З., Сяо К., Ван Ю., Цяо З., Сунь Дж. и Акоглу Л. (2021). SUOD: Ускорение крупномасштабного неконтролируемого обнаружения гетерогенных выбросов. Конференция по машинному обучению и системам (MLSys) . |