Этот репозиторий содержит код, использованный в нашей статье «Обоснование больших языковых моделей с помощью онлайн-обучения с подкреплением».

Более подробную информацию вы можете найти на нашем сайте.

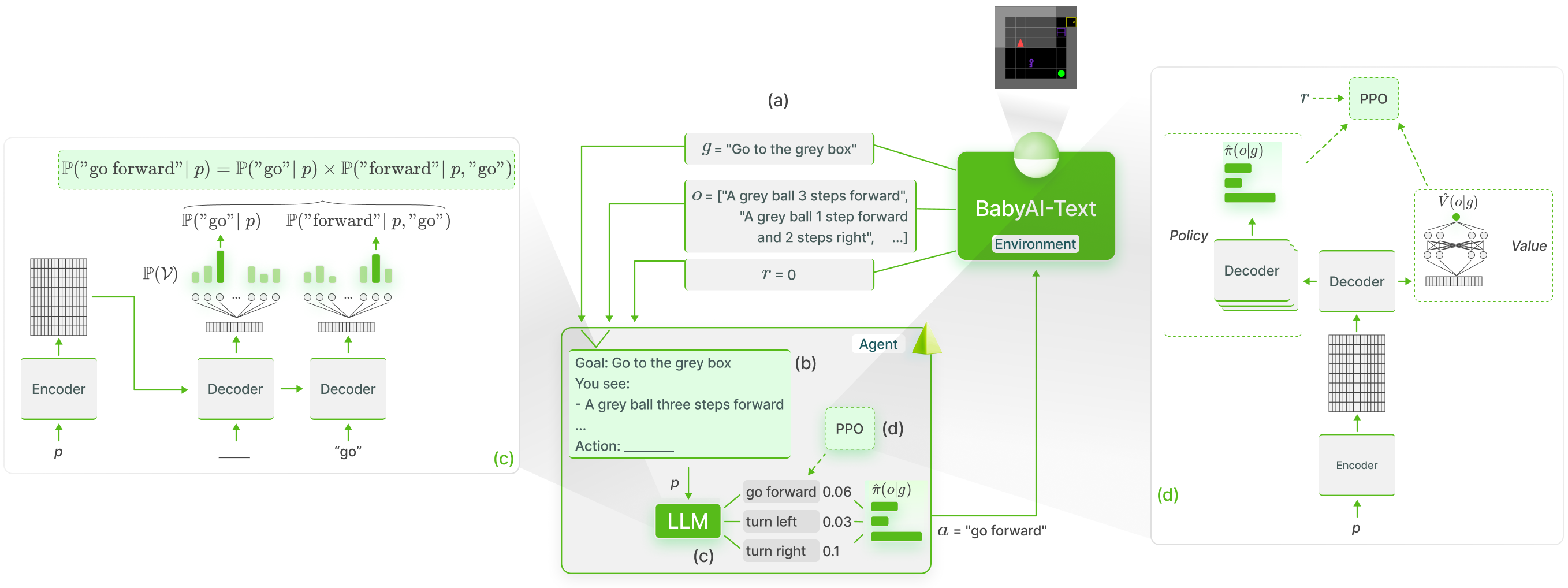

Мы выполняем функциональное обоснование знаний LLM в BabyAI-Text методом GLAM :

Мы выпускаем нашу среду BabyAI-Text вместе с кодом для проведения наших экспериментов (как для обучения агентов, так и для оценки их производительности). При использовании LLM мы полагаемся на библиотеку Lamorel.

Наш репозиторий структурирован следующим образом:

? Grounding_LLMs_with_online_RL

┣ babyai-text — наша среда BabyAI-Text.

┣ experiments -- код для наших экспериментов

┃ ┣ agents -- реализация всех наших агентов

┃ ┃ ┣ bot — бот-агент, использующий бота BabyAI.

┃ ┃ ┣ random_agent — агент, играющий равномерно случайным образом

┃ ┃ ┣ drrn -- агент DRRN отсюда

┃ ┃ ┣ ppo -- агенты, использующие PPO

┃ ┃ ┃ symbolic_ppo_agent.py — SymbolicPPO, адаптированный из PPO BabyAI

┃ ┃ ┃ ┗ llm_ppo_agent.py — наш агент LLM, основанный на PPO.

┃ ┣ configs -- конфиги Lamorel для наших экспериментов

┃ ┣ slurm — использует сценарии для запуска наших экспериментов в кластере SLURM.

┃ ┣ campaign – сценарии SLURM, используемые для запуска наших экспериментов.

┃ ┣ train_language_agent.py — обучает агентов с использованием BabyAI-Text (LLM и DRRN) -> содержит нашу реализацию потери PPO для LLM, а также дополнительные головы поверх LLM.

┃ ┣ train_symbolic_ppo.py — обучить SymbolicPPO на BabyAI (с задачами BabyAI-Text)

┃ ┣ post-training_tests.py — обобщающие тесты обученных агентов

┃ ┣ test_results.py — утилиты для форматирования результатов

┃ ┗ clm_behavioral-cloning.py — код для выполнения поведенческого клонирования на LLM с использованием траекторий.

conda create -n dlp python=3.10.8; conda activate dlp

conda install pytorch==1.12.1 torchvision==0.13.1 torchaudio==0.12.1 cudatoolkit=11.3 -c pytorch

pip install -r requirements.txt

Установите BabyAI-Text : подробности установки см. в пакете babyai-text

Установить Ламорель

git clone https://github.com/flowersteam/lamorel.git; cd lamorel/lamorel; pip install -e .; cd ../..

Пожалуйста, используйте Lamorel вместе с нашими конфигурациями. Примеры наших обучающих сценариев вы можете найти в кампании.

Чтобы обучить языковую модель в среде BabyAI-Text, необходимо использовать файл train_language_agent.py . Этот сценарий (запущенный с помощью Lamorel) использует следующие записи конфигурации:

rl_script_args :

seed : 1

number_envs : 2 # Number of parallel envs to launch (steps will be synchronized, i.e. a step call will return number_envs observations)

num_steps : 1000 # Total number of training steps

max_episode_steps : 3 # Maximum number of steps in a single episode

frames_per_proc : 40 # The number of collected transitions to perform a PPO update will be frames_per_proc*number_envs

discount : 0.99 # Discount factor used in PPO

lr : 1e-6 # Learning rate used to finetune the LLM

beta1 : 0.9 # PPO's hyperparameter

beta2 : 0.999 # PPO's hyperparameter

gae_lambda : 0.99 # PPO's hyperparameter

entropy_coef : 0.01 # PPO's hyperparameter

value_loss_coef : 0.5 # PPO's hyperparameter

max_grad_norm : 0.5 # Maximum grad norm when updating the LLM's parameters

adam_eps : 1e-5 # Adam's hyperparameter

clip_eps : 0.2 # Epsilon used in PPO's losses clipping

epochs : 4 # Number of PPO epochs performed on each set of collected trajectories

batch_size : 16 # Minibatch size

action_space : ["turn_left","turn_right","go_forward","pick_up","drop","toggle"] # Possible actions for the agent

saving_path_logs : ??? # Where to store logs

name_experiment : ' llm_mtrl ' # Useful for logging

name_model : ' T5small ' # Useful for logging

saving_path_model : ??? # Where to store the finetuned model

name_environment : ' BabyAI-MixedTestLocal-v0 ' # BabiAI-Text's environment

load_embedding : true # Whether trained embedding layers should be loaded (useful when lm_args.pretrained=False). Setting both this and use_action_heads to True (lm_args.pretrained=False) creates our NPAE agent.

use_action_heads : false # Whether action heads should be used instead of scoring. Setting both this and use_action_heads to True (lm_args.pretrained=False) creates our NPAE agent.

template_test : 1 # Which prompt template to use to log evolution of action's probability (Section C of our paper). Choices or [1, 2].

nbr_obs : 3 # Number of past observation used in the promptЗаписи конфигурации, относящиеся к самой языковой модели, см. в Lamorel.

Чтобы оценить производительность агента (например, обученного LLM, бота BabyAI...) при выполнении тестовых задач, используйте post-training_tests.py и установите следующие записи конфигурации:

rl_script_args :

seed : 1

number_envs : 2 # Number of parallel envs to launch (steps will be synchronized, i.e. a step call will return number_envs observations)

max_episode_steps : 3 # Maximum number of steps in a single episode

action_space : ["turn_left","turn_right","go_forward","pick_up","drop","toggle"] # Possible actions for the agent

saving_path_logs : ??? # Where to store logs

name_experiment : ' llm_mtrl ' # Useful for logging

name_model : ' T5small ' # Useful for logging

saving_path_model : ??? # Where to store the finetuned model

name_environment : ' BabyAI-MixedTestLocal-v0 ' # BabiAI-Text's environment

load_embedding : true # Whether trained embedding layers should be loaded (useful when lm_args.pretrained=False). Setting both this and use_action_heads to True (lm_args.pretrained=False) creates our NPAE agent.

use_action_heads : false # Whether action heads should be used instead of scoring. Setting both this and use_action_heads to True (lm_args.pretrained=False) creates our NPAE agent.

nbr_obs : 3 # Number of past observation used in the prompt

number_episodes : 10 # Number of test episodes

language : ' english ' # Useful to perform the French experiment (Section H4)

zero_shot : true # Whether the zero-shot LLM (i.e. without finetuning should be used)

modified_action_space : false # Whether a modified action space (e.g. different from the one seen during training) should be used

new_action_space : # ["rotate_left","rotate_right","move_ahead","take","release","switch"] # Modified action space

im_learning : false # Whether a LLM produced with Behavioral Cloning should be used

im_path : " " # Path to the LLM learned with Behavioral Cloning

bot : false # Whether the BabyAI's bot agent should be used