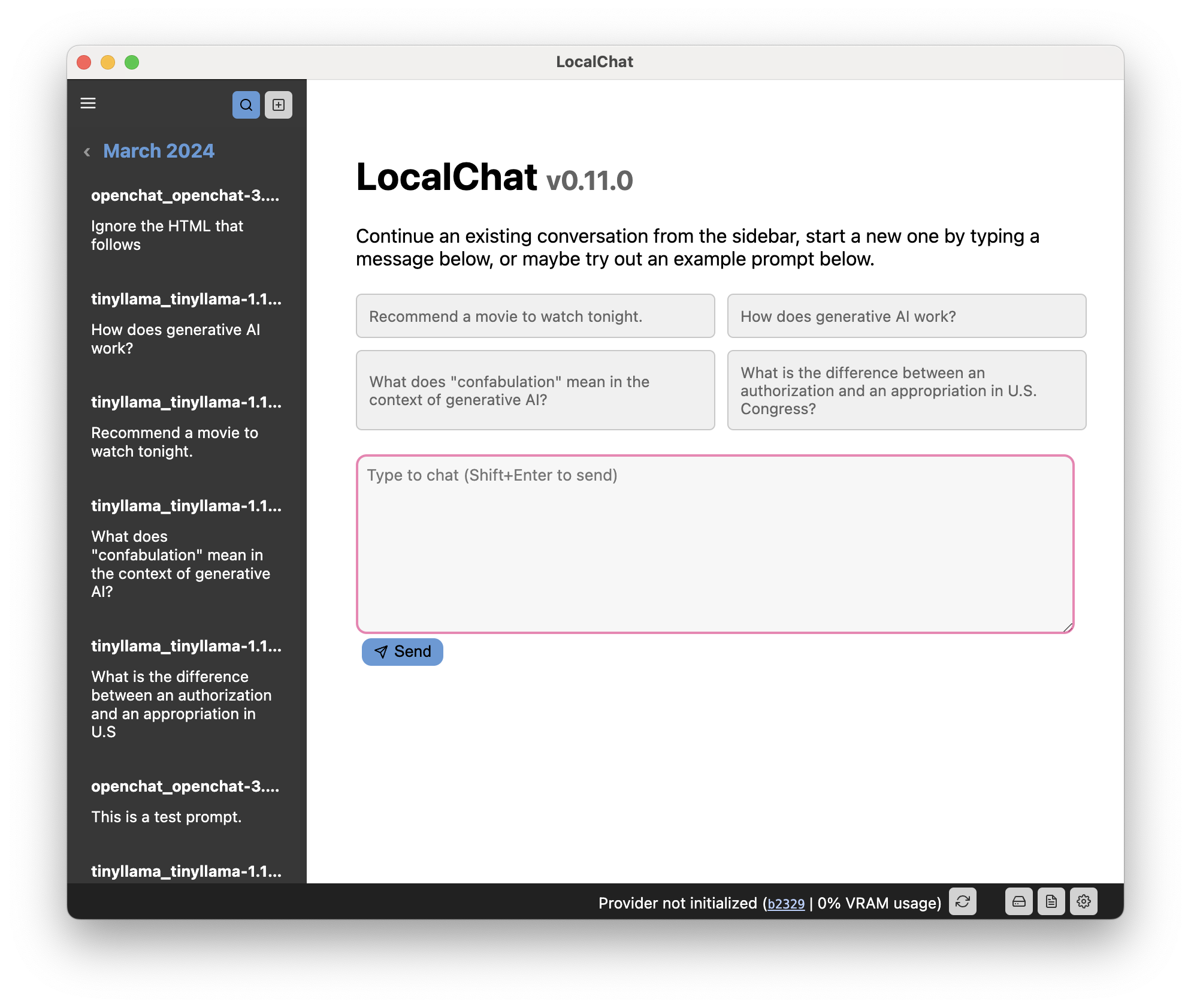

Общайтесь с моделями генеративного языка локально на своем компьютере без каких-либо настроек. LocalChat — это простой и легкий в настройке локальный чат AI с открытым исходным кодом, созданный на основе llama.cpp. Он не требует технических знаний и позволяет пользователям испытать поведение, подобное ChatGPT, на своих машинах — полностью соответствует GDPR и не опасаясь случайной утечки информации. Загрузите LocalChat для macOS, Windows или Linux здесь.

Оглавление

Обзор | Обоснование | Системные требования | Быстрый старт | Документация

LocalChat предоставляет похожий на чат интерфейс для взаимодействия с генеративными моделями большого языка (LLM) . Это выглядит и ощущается как обычный разговор в чате, но происходит локально на вашем компьютере. Никакие данные никогда не передаются на какой-либо облачный сервер.

Уже существует несколько чрезвычайно эффективных моделей генеративного языка, которые выглядят и работают почти как ChatGPT. Основное отличие состоит в том, что эти модели работают локально и имеют открытый вес.

Важный

Как вы, наверное, уже знаете, общение с LLM может показаться очень естественным, но модели остаются вероятностными: они будут генерировать следующее вероятное слово на основе того, что еще есть в подсказке. У LLM нет чувства времени, причинности, контекста и того, что лингвисты называют прагматикой. Таким образом, они склонны выдумывать события, которых никогда не было, смешивать факты из совершенно разных событий или откровенно лгать (так называемая «галлюцинация»). То же самое относится к коду или расчетам, которые могут выводить эти модели. Это, как говорится:

Будьте осторожны и используйте эту модель на свой страх и риск. Имейте в виду, что это игрушка, а не что-то надежное.

Когда ChatGPT был запущен в ноябре 2022 года, я был очень взволнован, но в то же время осторожен. Хотя возможности GPT-3 меня очень впечатлили, я с болью осознавал тот факт, что модель является проприетарной и, даже если бы это было не так, ее невозможно было бы запустить локально. Как европейскому гражданину, заботящемуся о конфиденциальности, мне не нравится мысль о том, что я могу зависеть от многомиллиардной корпорации, которая может перекрыть доступ в любой момент.

Из-за этого я не мог особо экспериментировать с GPT и решил дождаться неизбежного: разработки более мелких и лучших инструментов. На данный момент существует несколько моделей, которые соответствуют всем требованиям: они работают локально и напоминают ChatGPT. Благодаря квантованию (которое в основном снижает разрешение с некоторой потерей качества) их можно запускать даже на старом оборудовании.

Однако, если у вас нет опыта работы с LLM, управлять ими будет сложно.

Причина существования этого приложения заключается в том, что (а) я хотел реализовать его сам, чтобы увидеть, как оно работает эргономично, и (б) я хотел предоставить очень простой уровень для взаимодействия с этими вещами, не беспокоясь о настройке PyTorch и Трансформаторы локально.

Вы только устанавливаете приложение, загружаете модель и вперед.

Для запуска этого приложения требуется сравнительно новый компьютер. Однако это приложение зависит от LLM, которые, как известно, очень энергоемки. Таким образом, аппаратное обеспечение вашего компьютера будет определять, какие модели вы можете использовать.

Для моделей «обычного» размера, вероятно, потребуется выделенная видеокарта с объемом видеопамяти от 6 до 18 ГБ, если только вы не готовы ждать каждое слово более секунды.

Многие модели в настоящее время выпускаются в квантовой форме, что делает более крупные модели доступными для более старого или менее мощного оборудования. Квантование иногда значительно снижает системные требования даже для слишком больших моделей без слишком больших потерь в качестве (но ваш опыт может варьироваться от модели к модели).

Важный

Поскольку это большая языковая модель, генерация ответов займет немного времени. Поэтому, особенно если на вашем компьютере нет выделенного графического процессора, наберитесь терпения или попробуйте модель меньшего размера.

Кончик

Полную документацию вы можете найти на сайте приложения.

Пользовательский интерфейс разделен на три основных компонента:

Этот код лицензируется GNU GPL 3.0. Подробнее читайте в файле ЛИЦЕНЗИИ.