Наступательная подборка ИИ

Тщательно подобранный список полезных ресурсов, посвященных наступательному ИИ.

? Содержание?

- Злоупотреблять

- ? Состязательное машинное обучение?

- ⚡ Атаки ⚡

- Добыча

- ️ Ограничения ️

- ?️Защитные действия ?️

- ? Полезные ссылки?

- ⬅️ Инверсия (или умозаключение) ⬅️

- ?️Защитные действия ?️

- ? Полезные ссылки?

- ? Отравление?

- ? Бэкдоры?

- ?️Защитные действия ?️

- ? Полезные ссылки?

- ?♂️ Уклонение ?♂️

- ?️Защитные действия ?️

- ? Полезные ссылки?

- Инструменты

- ? Использовать ?

- ♂️ Пентестирование ♂️

- ? Вредоносное ПО?

- ?️ ОСИНТ ?️

- ? Фишинг?

- ?? Генеративный ИИ ??

- ? Аудио?

- Инструменты

- Приложения

- ? Обнаружение?

- ? Изображение ?

- Инструменты

- Приложения

- ? Обнаружение?

- ? Видео?

- Инструменты

- Приложения

- ? Обнаружение?

- ? Текст?

- Инструменты

- ? Обнаружение?

- Приложения

- Разное

- Опросы

- ? Участники?

- ©️ Лицензия ©️

Злоупотреблять

Использование уязвимостей моделей ИИ.

? Состязательное машинное обучение?

Состязательное машинное обучение отвечает за оценку их слабых мест и принятие контрмер.

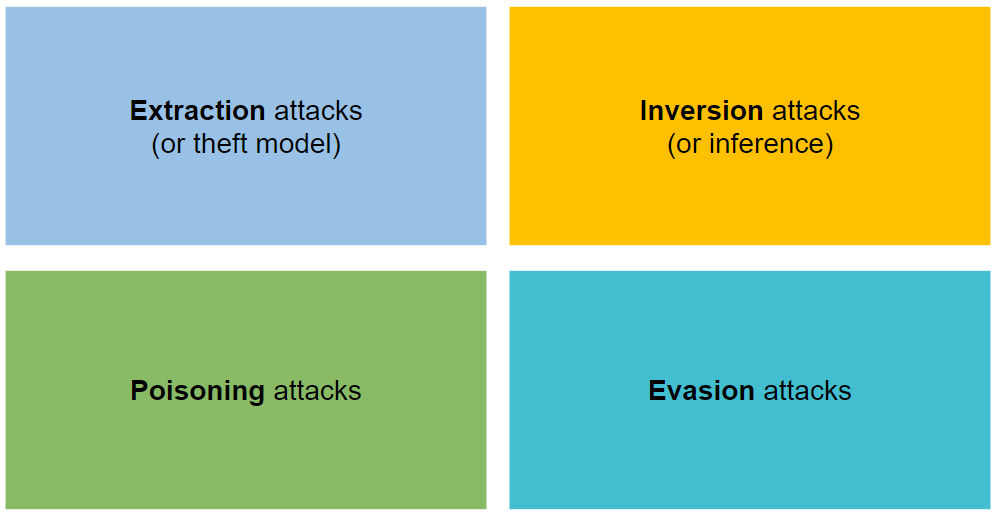

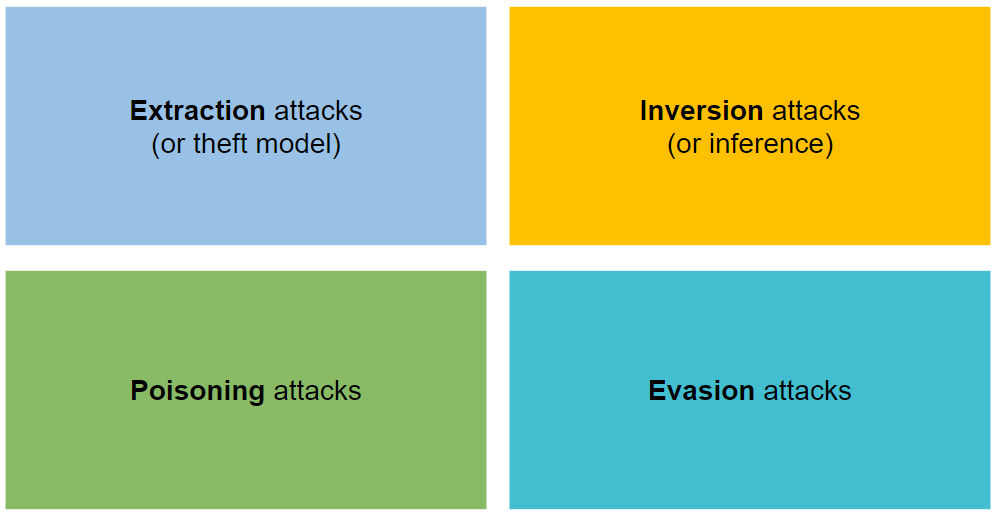

⚡ Атаки ⚡

Он разделен на четыре типа атак: извлечение, инверсия, отравление и уклонение.

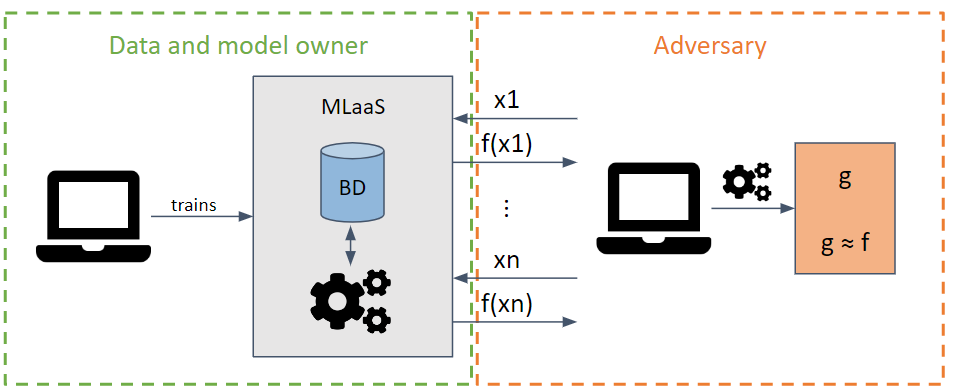

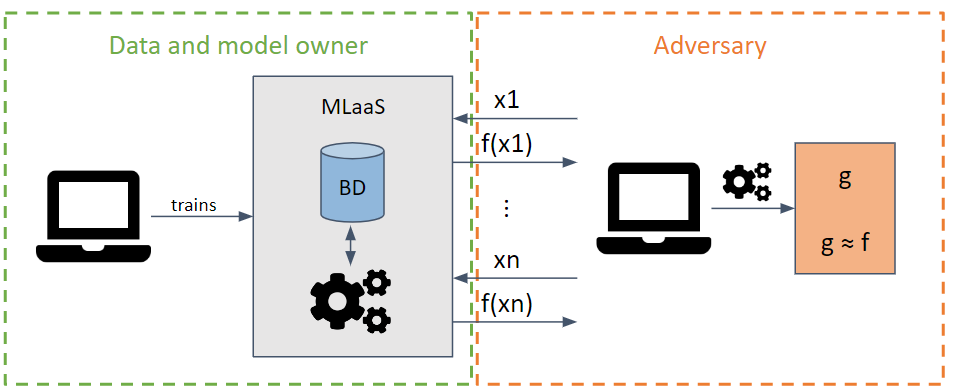

Добыча

Он пытается украсть параметры и гиперпараметры модели, делая запросы, которые максимизируют извлечение информации.

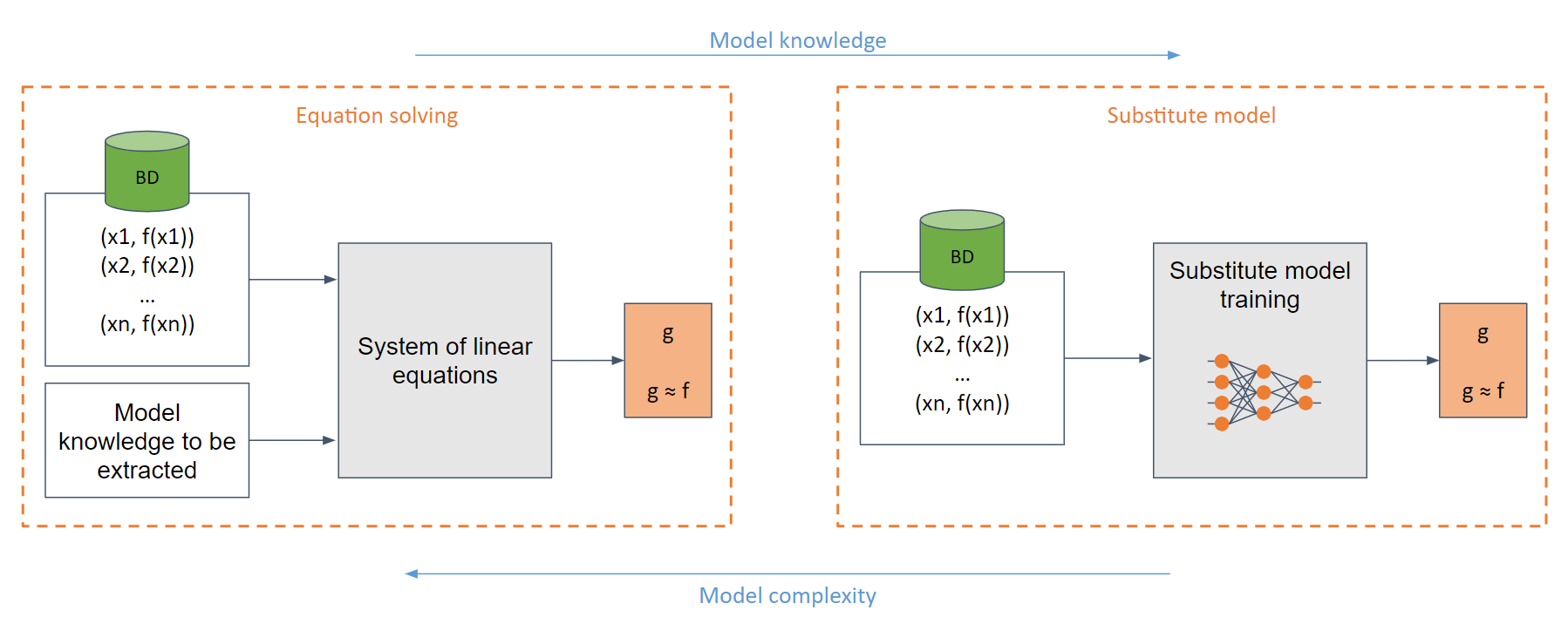

В зависимости от знания модели противника могут быть выполнены атаки «белого ящика» и «черного ящика».

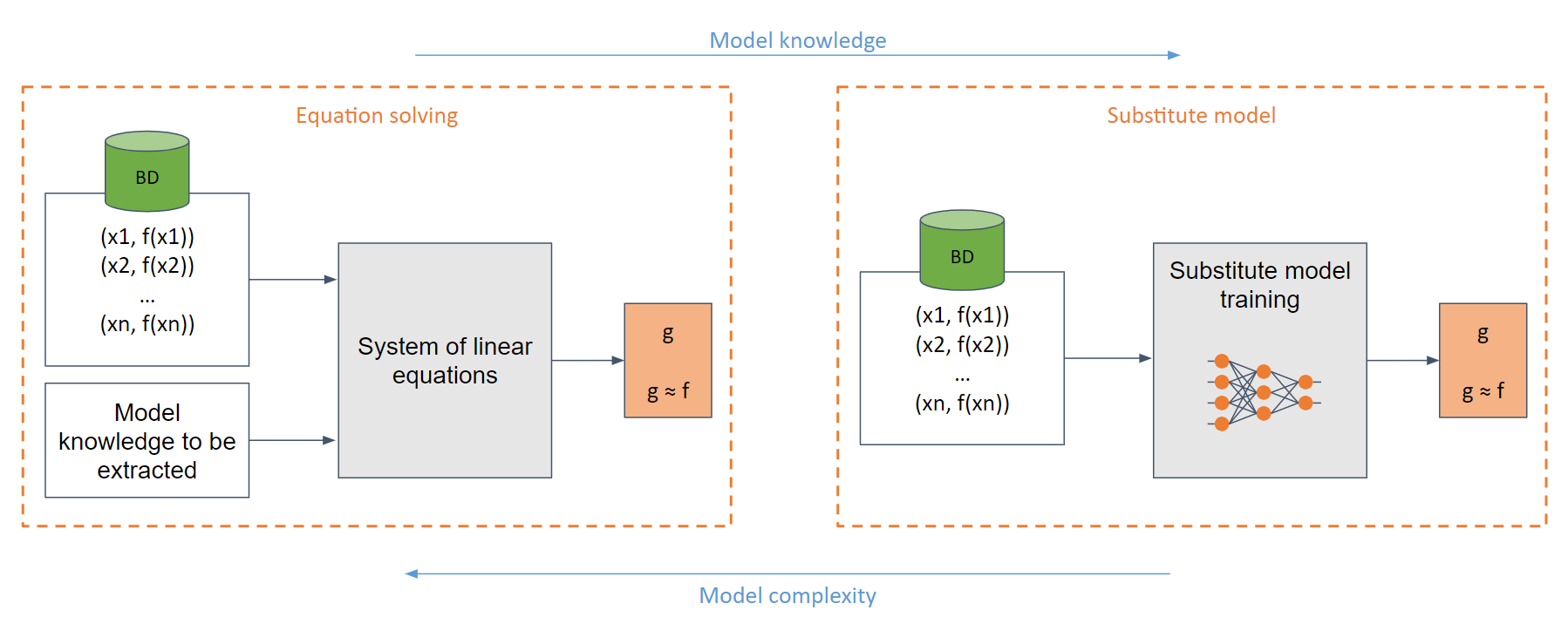

В простейшем случае «белого ящика» (когда противник полностью знает модель, например, сигмовидную функцию) можно создать систему линейных уравнений, которую можно легко решить.

В общем случае, когда недостаточно знаний о модели, используется модель-заменитель. Эта модель обучается с помощью запросов, сделанных к исходной модели, чтобы имитировать ту же функциональность, что и исходная.

️ Ограничения ️

Обучение модели-заменителя (во многих случаях) эквивалентно обучению модели с нуля.

Очень вычислительно интенсивный.

Злоумышленник имеет ограничения на количество запросов до того, как его обнаружат.

?️Защитные действия ?️

Округление выходных значений.

Использование дифференциальной конфиденциальности.

Использование ансамблей.

Использование специфических средств защиты

- Конкретные архитектуры

- ПРАДА

- Адаптивная дезинформация

- ...

? Полезные ссылки?

- Кража моделей машинного обучения с помощью API-интерфейсов прогнозирования

- Кража гиперпараметров в машинном обучении

- Сети подделок: кража функциональности моделей черного ящика

- Предупреждение об извлечении модели в парадигме MLaaS

- Подражатель CNN: кража знаний путем убеждения в признании с помощью случайных немаркированных данных

- Отравление прогноза: меры защиты от атак кражи модели DNN

- Кража нейронных сетей через временные каналы

- Атаки с кражей модели против нейронных сетей с индуктивными графами

- Высокая точность и достоверность извлечения нейронных сетей

- Отравление наборами обучающих данных веб-масштаба практично

- Криптоаналитическое извлечение моделей нейронных сетей с полиномиальным временем

- Отравляющие атаки, специфичные для подсказок, на генеративные модели преобразования текста в изображение

- Потрясающее отравление данных и бэкдор-атаки: тщательно подобранный список документов и ресурсов, связанных с отравлением данных, бэкдор-атаками и защитой от них.

- BackdoorBox: набор инструментов Python с открытым исходным кодом для бэкдорных атак и защиты.

- Кража части рабочей языковой модели

- Жесткое криптоаналитическое извлечение моделей нейронных сетей

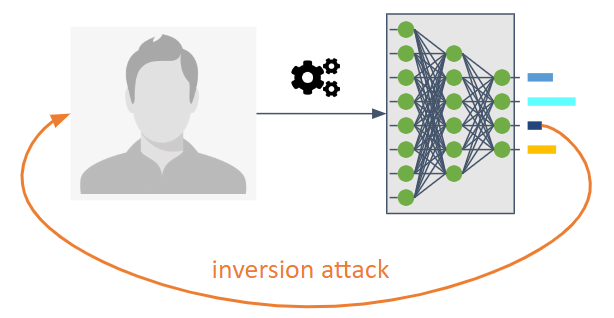

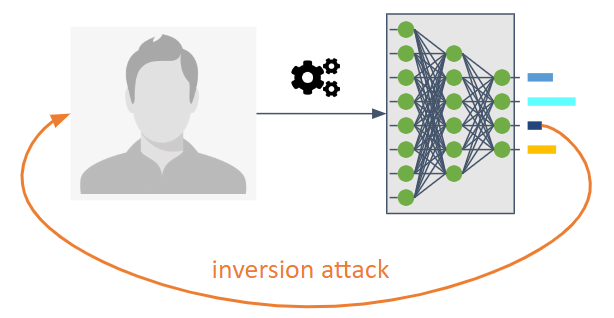

⬅️ Инверсия (или умозаключение) ⬅️

Они предназначены для того, чтобы обратить вспять информационный поток модели машинного обучения.

Они позволяют злоумышленнику узнать модель, которая явно не предназначалась для совместного использования.

Они позволяют нам знать обучающие данные или информацию как статистические свойства модели.

Возможны три типа:

Атака на основе вывода о членстве (MIA) : злоумышленник пытается определить, использовался ли образец в рамках обучения.

Атака на основе вывода свойств (PIA) . Злоумышленник стремится извлечь статистические свойства, которые не были явно закодированы как функции на этапе обучения.

Реконструкция : злоумышленник пытается восстановить один или несколько образцов из обучающего набора и/или соответствующих им меток. Также называется инверсией.

?️Защитные действия ?️

Использование продвинутой криптографии. Контрмеры включают дифференциальную конфиденциальность, гомоморфную криптографию и безопасные многосторонние вычисления.

Использование методов регуляризации, таких как Dropout, из-за связи между перетренировкой и конфиденциальностью.

Сжатие модели было предложено в качестве защиты от атак реконструкции.

? Полезные ссылки?

- Атаки на основе вывода о членстве против моделей машинного обучения

- Атаки с инверсией модели, использующие достоверную информацию, и основные меры противодействия

- Модели машинного обучения, которые запоминают слишком много

- ML-Leaks: независимые от модели и данных атаки и средства защиты на моделях машинного обучения

- Глубокие модели в рамках GAN: утечка информации в результате совместного глубокого обучения

- ЛОГАН: Атаки на вывод членства против генеративных моделей

- Переобучение, надежность и вредоносные алгоритмы: исследование потенциальных причин риска конфиденциальности в машинном обучении

- Комплексный анализ конфиденциальности глубокого обучения: автономное и федеративное обучение в условиях пассивных и активных атак методом «белого ящика»

- Атаки на умозаключения против совместного обучения

- Секретный разделитель: оценка и тестирование непреднамеренного запоминания в нейронных сетях

- На пути к науке безопасности и конфиденциальности в машинном обучении

- MemGuard: защита от атак на основе вывода о членстве в «черном ящике» с помощью состязательных примеров

- Извлечение обучающих данных из больших языковых моделей

- Атаки вывода свойств на полностью связанные нейронные сети с использованием представлений, инвариантных к перестановкам

- Извлечение обучающих данных из моделей диффузии

- Реконструкция изображений высокого разрешения с использованием моделей скрытой диффузии по активности мозга человека

- Кража и обход классификаторов вредоносных программ и антивирусов при низком уровне ложных срабатываний

- Реалистичные атаки с использованием отпечатков пальцев, основанные на состязательном подходе

- Активные состязательные тесты: повышение уверенности в оценках состязательной устойчивости.

- Статус джейлбрейка GPT: обновленная информация о статусе джейлбрейка языковой модели OpenAI GPT.

- Порядок величины ускорения для вывода о членстве в LLM

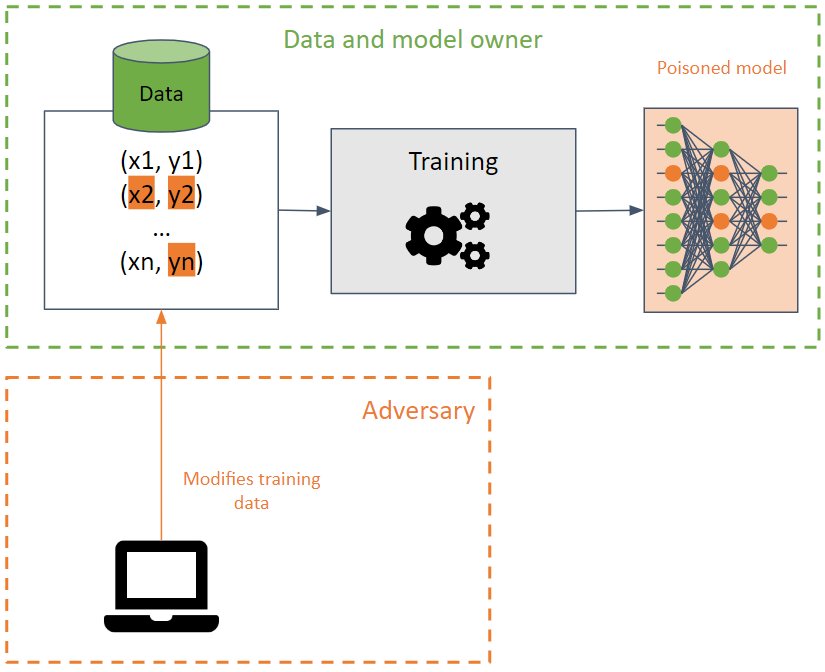

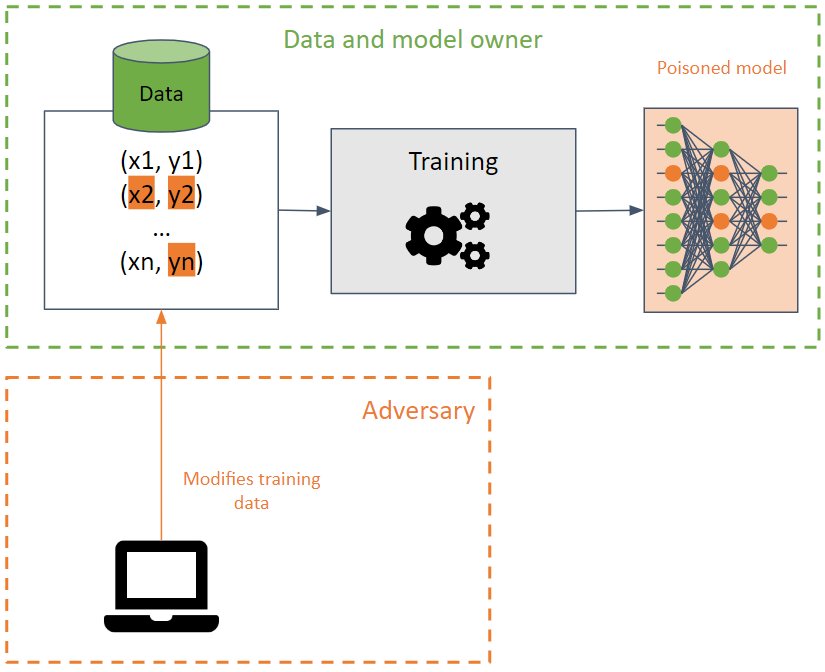

? Отравление?

Они стремятся испортить обучающую выборку, заставив модель машинного обучения снизить ее точность.

Эту атаку трудно обнаружить при ее выполнении на обучающих данных, поскольку атака может распространяться среди разных моделей, использующих одни и те же обучающие данные.

Злоумышленник стремится разрушить доступность модели, изменяя границы принятия решений и, как следствие, создавая неверные прогнозы или создавая лазейку в модели. В последнем случае модель ведет себя корректно (возвращая желаемые прогнозы) в большинстве случаев, за исключением определенных входных данных, специально созданных злоумышленником, которые приводят к нежелательным результатам. Злоумышленник может манипулировать результатами прогнозов и запускать будущие атаки.

? Бэкдоры?

BadNets — это самый простой тип бэкдора в модели машинного обучения. Более того, BadNet-сети могут сохраняться в модели, даже если они снова переобучаются для решения задачи, отличной от исходной модели (переносное обучение).

Важно отметить, что общедоступные предварительно обученные модели могут содержать бэкдоры .

?️Защитные действия ?️

? Полезные ссылки?

- Отравляющие атаки на машины опорных векторов

- Целевые бэкдор-атаки на системы глубокого обучения с использованием отравления данных

- Троянская атака на нейронные сети

- Тонкая обрезка: защита от бэкдорных атак на глубокие нейронные сети

- Ядовитые лягушки! Целевые «отравляющие» атаки «чистой метки» на нейронные сети

- Спектральные сигнатуры в бэкдор-атаках

- Скрытые бэкдор-атаки на глубокие нейронные сети

- Regula Sub-rosa: скрытые бэкдор-атаки на глубокие нейронные сети

- Скрытые бэкдор-атаки

- Передаваемые «чистые» отравляющие атаки на глубокие нейронные сети

- TABOR: высокоточный подход к проверке и восстановлению троянских бэкдоров в системах искусственного интеллекта

- На пути к отравлению алгоритмов глубокого обучения оптимизацией обратного градиента

- Когда машинное обучение терпит неудачу? Обобщенная переносимость атак уклонения и отравления

- Сертифицированная защита от атак с отравлением данных

- Динамическая бэкдор-атака с учетом ввода

- Как использовать бэкдор для федеративного обучения

- Установка необнаружимых бэкдоров в моделях машинного обучения

- Обманите ИИ! Хакеры могут использовать бэкдоры, чтобы отравить данные обучения и заставить модель ИИ неправильно классифицировать изображения. Узнайте, как исследователи IBM могут определить, когда данные были отравлены, а затем угадать, какие бэкдоры спрятаны в этих наборах данных. Сможете ли вы угадать черный ход?

- Backdoor Toolbox: компактный набор инструментов для бэкдорных атак и защиты.

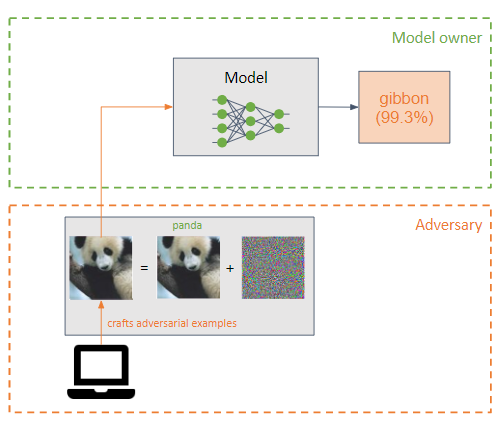

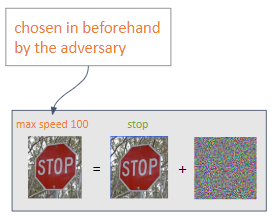

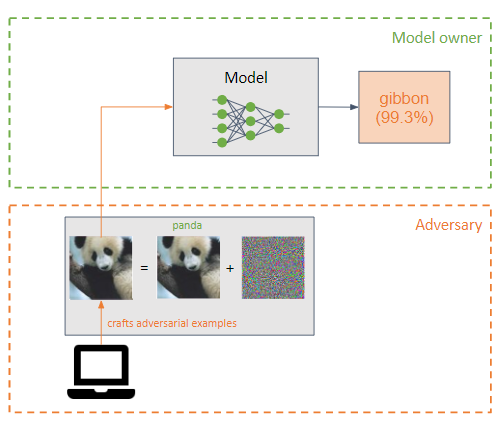

?♂️ Уклонение ?♂️

Злоумышленник добавляет небольшое возмущение (в виде шума) к входным данным модели машинного обучения, чтобы заставить ее неправильно классифицировать (пример злоумышленника).

Они похожи на атаки с отравлением, но их главное отличие состоит в том, что атаки уклонения пытаются использовать слабые стороны модели на этапе вывода.

Цель противника – сделать состязательные примеры незаметными для человека.

В зависимости от результата, желаемого противником, могут быть выполнены два типа атаки:

Наиболее распространенными атаками являются атаки «белого ящика» :

- Л-БФГС

- КЖПО

- БИМ

- JSMA

- Карлини и Вагнер (C&W)

- НьютонДурак

- ЕАД

- УАП

?️Защитные действия ?️

Состязательное обучение, которое состоит из создания состязательных примеров во время обучения, позволяющего модели изучить особенности состязательных примеров, что делает модель более устойчивой к атакам этого типа.

Преобразования на входах.

Градиентная маскировка/регуляризация. Не очень эффективно.

Слабая защита.

Защита от быстрой инъекции: Все практические и предлагаемые меры защиты от быстрой инъекции.

Тест Lakera PINT. Тест быстрого впрыска (PINT) обеспечивает нейтральный способ оценить производительность системы обнаружения быстрого впрыска, такой как Lakera Guard, не полагаясь на известные общедоступные наборы данных, которые эти инструменты могут использовать для оптимизации производительности оценки.

Вывод дьявола: метод состязательной оценки модели Phi-3 Instruct путем наблюдения за распределением внимания по ее головам при воздействии определенных входных данных. Такой подход побуждает модель принять «мышление дьявола», что позволяет ей генерировать результаты насильственного характера.

? Полезные ссылки?

- Практические атаки «черного ящика» на машинное обучение

- Ограничения глубокого обучения в состязательных условиях

- На пути к оценке устойчивости нейронных сетей

- Дистилляция как защита от враждебных возмущений глубоких нейронных сетей

- Состязательные примеры в физическом мире

- Ансамблевая состязательная тренировка: атаки и защита

- На пути к моделям глубокого обучения, устойчивым к состязательным атакам

- Интригующие свойства нейронных сетей

- Объяснение и использование состязательных примеров

- Углубление в переносимые состязательные примеры и атаки «черного ящика»

- Состязательное машинное обучение в больших масштабах

- Состязательные атаки «черного ящика» с ограниченными запросами и информацией

- Сжатие функций: обнаружение состязательных примеров в глубоких нейронных сетях

- Состязательные атаки на основе принятия решений: надежные атаки на модели машинного обучения «черного ящика»

- Усиление состязательных атак с помощью импульса

- Пространство переносимых состязательных примеров

- Противодействие состязательным изображениям с использованием входных преобразований

- Defense-GAN: защита классификаторов от состязательных атак с использованием генеративных моделей

- Синтез надежных состязательных примеров

- Смягчение неблагоприятных эффектов посредством рандомизации

- Об обнаружении враждебных возмущений

- Состязательный патч

- PixelDefend: использование генеративных моделей для понимания состязательных примеров и защиты от них

- Атака в один пиксель для обмана глубоких нейронных сетей

- Эффективная защита от атак противника

- Надежные атаки физического мира на визуальную классификацию глубокого обучения

- Состязательные возмущения глубоких нейронных сетей для классификации вредоносных программ

- Состязательные 3D-атаки за пределами облака точек

- Состязательные возмущения обманывают детекторы дипфейков

- Состязательные дипфейки: оценка уязвимости детекторов дипфейков к состязательным примерам

- Обзор уязвимостей систем с голосовым управлением

- FastWordBug: быстрый метод создания состязательного текста для приложений НЛП

- Призрак ADAS: защита передовых систем помощи водителю от мгновенных фантомных атак

- llm-attacks: универсальные и переносимые атаки на согласованные языковые модели.

- Атаки на модели ИИ: быстрое внедрение или отравление цепочки поставок

- Атака Prompt Injection на приложения, интегрированные с LLM

- garak: сканер уязвимостей LLM.

- Простые состязательные преобразования в PyTorch

- Плагины ChatGPT: утечка данных с помощью изображений и подделка запросов перекрестных плагинов

- Взлом изображений: состязательные изображения могут управлять генеративными моделями во время выполнения

- Мультиатаки: множество изображений + одна и та же состязательная атака → множество целевых меток.

- АКТИВНО: На пути к легко переносимому трехмерному физическому камуфляжу для универсального и надежного уклонения от транспортных средств

- LLM Red Teaming GPTS: мгновенная утечка, утечка API, утечка документов

- Примеры состязательных действий, созданных человеком

- Многоязычные проблемы джейлбрейка в больших языковых моделях

- Неправильное использование инструментов в больших языковых моделях с визуальными состязательными примерами

- AutoDAN: интерпретируемые состязательные атаки на основе градиента на большие языковые модели

- Мультимодальное внедрение: (Ab) использование изображений и звуков для косвенного внедрения инструкций в мультимодальных LLM.

- JailbreakingLLMs: взлом больших языковых моделей черного ящика с помощью двадцати запросов.

- Дерево атак: автоматический взлом черного ящика LLM

- GPT: утечка подсказок GPT.

- AI Exploits: коллекция реальных AI/ML эксплойтов для ответственного раскрытия уязвимостей.

- Агенты LLM могут автономно взламывать веб-сайты

- Cloudflare анонсирует межсетевой экран для искусственного интеллекта

- PromptInject: платформа, которая собирает подсказки по модульному принципу для количественного анализа устойчивости LLM к состязательным быстрым атакам.

- LLM Red Teaming: состязательные, программные и лингвистические подходы против ChatGPT, Claude, Mistral, Grok, LLAMA и Gemini

- Иерархия инструкций: обучение LLM расставлять приоритеты привилегированных инструкций

- Оперативная инъекция / Взлом тюрьмы агента банковского LLM (GPT-4, Langchain)

- Чат GitHub Copilot: от быстрого внедрения к утечке данных

- Состязательные примеры не выровнены в многообразиях диффузионной модели

- Логический джейлбрейк преобразования изображения в текст: ваше воображение может помочь вам сделать что угодно

- Устранение последствий использования Skeleton Key, нового типа джейлбрейка с использованием генеративного искусственного интеллекта

- Тест запутывания изображений: этот репозиторий содержит код для оценки моделей в тесте запутывания изображений, впервые представленный в разделе «Бенчмаркинг устойчивости к состязательным запутываниям изображений».

- Взлом больших языковых моделей с помощью символьной математики

Инструменты

| Имя | Тип | Поддерживаемые алгоритмы | Поддерживаемые типы атак | Атака/Защита | Поддерживаемые платформы | Популярность |

|---|

| Клеверханс | Изображение | Глубокое обучение | Уклонение | Атака | Тензорный поток, Керас, JAX | |

| дурацкий ящик | Изображение | Глубокое обучение | Уклонение | Атака | Тензорный поток, PyTorch, JAX | |

| ИСКУССТВО | Любой тип (изображение, табличные данные, аудио,...) | Глубокое обучение, SVM, LR и т. д. | Любой (извлечение, вывод, отравление, уклонение) | Оба | Tensorflow, Keras, Pytorch, Scikit Learn | |

| Текстовая атака | Текст | Глубокое обучение | Уклонение | Атака | Керас, HuggingFace | |

| Рекламный фонарь | Изображение | Глубокое обучение | Уклонение | Оба | --- | |

| AdvBox | Изображение | Глубокое обучение | Уклонение | Оба | PyTorch, Тензорный поток, MxNet | |

| DeepRobust | Изображение, график | Глубокое обучение | Уклонение | Оба | PyTorch | |

| Контрфит | Любой | Любой | Уклонение | Атака | --- | |

| Примеры состязательного аудио | Аудио | ДипСпич | Уклонение | Атака | --- | |

ИСКУССТВО

Adversarial Robustness Toolbox, сокращенно ART, представляет собой библиотеку состязательного машинного обучения с открытым исходным кодом для тестирования надежности моделей машинного обучения.

Он разработан на Python и реализует атаки и защиту извлечение, инверсию, отравление и уклонение.

ART поддерживает самые популярные платформы: Tensorflow, Keras, PyTorch, MxNet и ScikitLearn и многие другие.

Он не ограничивается использованием моделей, которые используют изображения в качестве входных данных, но также поддерживает другие типы данных, такие как аудио, видео, табличные данные и т. д.

Семинар по изучению состязательного машинного обучения с ART ??

Клеверханс

Cleverhans — это библиотека для выполнения атак уклонения и тестирования устойчивости модели глубокого обучения на моделях изображений.

Он разработан на Python и интегрируется с платформами Tensorflow, Torch и JAX.

Он реализует многочисленные атаки, такие как L-BFGS, FGSM, JSMA, C&W и другие.

? Использовать ?

ИИ используется для выполнения вредоносных задач и усиления классических атак.

♂️ Пентестирование ♂️

- GyoiThon: инструмент тестирования на проникновение следующего поколения, инструмент сбора информации для веб-сервера.

- Deep Exploit: полностью автоматический инструмент для тестирования на проникновение с использованием глубокого обучения с подкреплением.

- AutoPentest-DRL: автоматизированное тестирование на проникновение с использованием глубокого обучения с подкреплением.

- DeepGenerator: полностью автоматически генерирует коды внедрения для оценки веб-приложений с использованием генетического алгоритма и генеративно-состязательных сетей.

- Eyeballer: Eyeballer предназначен для широкомасштабных тестов на проникновение в сеть, где вам нужно найти «интересные» цели среди огромного набора веб-хостов.

- Nebula: помощник по этичному хакерству на базе искусственного интеллекта.

- Команды агентов LLM могут использовать уязвимости нулевого дня

- Анализ и текущие пробелы в сканерах уязвимостей LLM с открытым исходным кодом: сравнительный анализ

? Вредоносное ПО?

- DeepLocker: сокрытие целевых атак с помощью слесарного дела с использованием искусственного интеллекта, разработано IBM Labs на Британской Колумбии.

- Обзор искусственного интеллекта, используемого во вредоносных программах: тщательно подобранный список ресурсов искусственного интеллекта по вредоносным программам.

- DeepObfusCode: обфускация исходного кода через сети последовательностей.

- AutoCAT: обучение с подкреплением для автоматического исследования атак с использованием тайминга кэша.

- БОТНЕТ НА ОСНОВЕ ИИ: теоретико-игровой подход к защите от атак ботнетов на основе ИИ.

- SECML_Malware: библиотека Python для создания состязательных атак на детекторы вредоносных программ Windows.

- Трансцендентный выпуск: использование конформной оценки для обнаружения отклонения концепции, влияющего на обнаружение вредоносного ПО.

?️ ОСИНТ ?️

- SNAP_R: автоматически создавайте фишинговые публикации в социальных сетях.

- SpyScrap: SpyScrap сочетает в себе методы распознавания лиц для фильтрации результатов и использует обработку естественного языка для получения важных объектов с веб-сайта, на котором появляется пользователь.

? Фишинг?

- DeepDGA: реализация DeepDGA: генерация и обнаружение доменов с состязательной настройкой.

? Разведка угроз?

- От песков до особняков: обеспечение автоматического построения кибератак на протяжении всего жизненного цикла с помощью LLM

? Боковые каналы?

- SCAAML: атаки по побочным каналам с помощью машинного обучения.

?? Генеративный ИИ ??

? Аудио?

Инструменты

- deep-voice-conversion: Глубокие нейронные сети для преобразования голоса (передачи стиля голоса) в Tensorflow.

- tacotron: реализация TensorFlow синтеза речи Google Tacotron с предварительно обученной моделью (неофициально).

- Клонирование голоса в реальном времени: клонируйте голос за 5 секунд, чтобы генерировать произвольную речь в режиме реального времени.

- mimic2: механизм преобразования текста в речь, основанный на архитектуре Tacotron, первоначально реализованный Китом Ито.

- Клонирование нейронного голоса с несколькими выборками: реализация клонирования нейронного голоса с несколькими выборками. Исследовательская статья Baidu.

- Vall-E: неофициальная реализация PyTorch аудио LM VALL-E.

- преобразователь голоса: преобразователь голоса в реальном времени.

- WebUI-интерфейс преобразования голоса на основе извлечения: простая в использовании платформа преобразования голоса на основе VITS.

- Audiocraft: Audiocraft — это библиотека для обработки и генерации звука с глубоким обучением. Он оснащен современным аудиокомпрессором/токенизатором EnCodec, а также MusicGen, простым и управляемым генератором музыки LM с текстовой и мелодической обработкой.

- VALL-EX: реализация с открытым исходным кодом модели TTS с нулевым выстрелом Microsoft VALL-E X.

- OpenVoice: мгновенное клонирование голоса с помощью MyShell.

- MeloTTS: высококачественная многоязычная библиотека преобразования текста в речь от MyShell.ai. Поддержка английского, испанского, французского, китайского, японского и корейского языков.

- VoiceCraft: автоматическое редактирование речи и преобразование текста в речь в дикой природе.

- Parler-TTS: библиотека вывода и обучения для высококачественных моделей TTS.

- ChatTTS: генеративная речевая модель для ежедневного общения.

Приложения

- Lip2Wav: Генерируйте высококачественную речь, используя только движения губ.

- AudioLDM: генерация текста в аудио с помощью моделей скрытой диффузии

- deepvoice3_pytorch: реализация PyTorch моделей синтеза речи в речь на основе сверточных нейронных сетей.

- ? Riffusion: Стабильная диффузия для генерации музыки в реальном времени.

- шепот.cpp: порт модели OpenAI Whisper на C/C++.

- ТТС: ? - набор инструментов глубокого обучения для преобразования текста в речь, проверенный в исследованиях и производстве.

- YourTTS: к TTS с несколькими динамиками и преобразованию голоса с нулевым выстрелом для всех.

- TorToiSe: многоголосая система TTS, созданная с упором на качество.

- DiffSinger: синтез певческого голоса с помощью механизма мелкой диффузии (SVS и TTS).

- Вокодер WaveNet: реализация вокодера WaveNet, который может генерировать высококачественные необработанные образцы речи с учетом лингвистических или акустических особенностей.

- Deepvoice3_pytorch: реализация PyTorch моделей синтеза речи в речь на основе сверточных нейронных сетей.

- eSpeak NG Преобразование текста в речь: eSpeak NG — это синтезатор речи с открытым исходным кодом, который поддерживает более ста языков и акцентов.

- RealChar: создавайте, настраивайте и общайтесь со своим AI-персонажем/компаньоном в реальном времени (кодовая база «все в одной»!). Обеспечьте естественное и беспрепятственное общение с искусственным интеллектом повсюду (на мобильных устройствах, в Интернете и терминалах), используя LLM OpenAI GPT3.5/4, Anthropic Claude2, Chroma Vector DB, Whisper Speech2Text, ElevenLabs Text2Speech.

- Клонирование нейронного голоса с помощью нескольких образцов

- НАУТИЛУС: универсальная система клонирования голоса

- Учимся свободно говорить на иностранном языке: многоязычный синтез речи и межъязыковое клонирование голоса

- Когда добро становится злом: анализ нажатия клавиш с помощью умных часов

- KeyListener: определение нажатий клавиш на QWERTY-клавиатуре сенсорного экрана с помощью акустических сигналов

- Этого голоса не существует: о синтезе голоса, аудиодипфейках и их обнаружении

- AudioSep: отделяйте все, что вы описываете.

- стабильные аудио-инструменты: генеративные модели для условной генерации звука.

- GPT-SoVITS-WebUI: голосовые данные за 1 минуту также можно использовать для обучения хорошей модели TTS! (несколько кадров клонирования голоса).

- Гибридная сеть: разделение источников звука в реальном времени, генерация текстов, аккордов и ритма.

- CosyVoice: многоязычная модель генерации большого голоса, обеспечивающая полный набор возможностей вывода, обучения и развертывания.

- EasyVolcap: ускорение исследований нейронного объемного видео.

? Обнаружение?

- Обнаружение ложного голоса: использование временной свертки для обнаружения дипфейков аудио.

- Надежная система обнаружения подмены голоса с использованием новых функций CLS-LBP и LSTM.

- Детектор спуфинга голоса: унифицированная система защиты от спуфинга

- Защита голосовых интерфейсов от поддельных (клонированных) аудиоатак

- DeepSonar: на пути к эффективному и надежному обнаружению фальшивых голосов, синтезированных с помощью искусственного интеллекта

- Борьба с ИИ с помощью ИИ: обнаружение фальшивой речи с помощью глубокого обучения

- Обзор современных методов обнаружения аудиодипфейков: проблемы и направления на будущее

? Изображение ?

Инструменты

- StyleGAN: StyleGAN — официальная реализация TensorFlow.

- StyleGAN2: StyleGAN2 — официальная реализация TensorFlow.

- stylegan2-ada-pytorch: StyleGAN2-ADA — официальная реализация PyTorch.

- StyleGAN-nada: доменная адаптация генераторов изображений под управлением CLIP.

- StyleGAN3: официальная реализация StyleGAN3 на PyTorch.

- Imaginaire: Imaginaire — это библиотека Pytorch, содержащая оптимизированную реализацию нескольких методов синтеза изображений и видео, разработанных в NVIDIA.

- ffhq-dataset: Набор данных Flickr-Faces-HQ (FFHQ).

- DALLE2-pytorch: реализация DALL-E 2, обновленной нейронной сети OpenAI для синтеза текста в изображение, в Pytorch.

- ImaginAIry: изображения, придуманные ИИ. Питоническая генерация стабильных диффузионных изображений.

- Lama Cleaner: инструмент для рисования изображений на базе модели SOTA AI. Удалите любые нежелательные объекты, дефекты или людей с ваших изображений или сотрите и замените (при помощи стабильной диффузии) что-либо на ваших изображениях.

- Invertible-Image-Rescaling: это реализация PyTorch документа: Invertible Image Rescaling.

- DifFace: слепое восстановление лица с сокращением диффузных ошибок (PyTorch).

- CodeFormer: На пути к надежному восстановлению слепых лиц с помощью преобразователя поиска кодовой книги.

- Custom Diffusion: многоконцептуальная настройка распространения текста в изображение.

- Диффузоры: ? Диффузоры: современные модели диффузии для генерации изображений и звука в PyTorch.

- Стабильная диффузия: синтез изображений высокого разрешения с использованием моделей скрытой диффузии.

- InvokeAI: InvokeAI — это ведущий творческий движок для моделей Stable Diffusion, который позволяет профессионалам, художникам и энтузиастам создавать визуальные медиа с использованием новейших технологий на основе искусственного интеллекта. Решение предлагает лучший в отрасли веб-интерфейс пользователя, поддерживает использование терминала через интерфейс командной строки и служит основой для множества коммерческих продуктов.

- Веб-интерфейс Stable Diffusion: Веб-интерфейс Stable Diffusion.

- Stable Diffusion Infinity: перерисовка с помощью Stable Diffusion на бесконечном холсте.

- Быстрая стабильная диффузия: быстрая стабильная диффузия + DreamBooth.

- GET3D: генеративная модель высококачественных 3D-текстурированных фигур, полученных из изображений.

- Потрясающий синтез искусственных изображений AI: список потрясающих инструментов, идей, инструментов быстрого проектирования, коллабораций, моделей и помощников для быстрого дизайнера, играющего с aiArt и синтезом изображений. Охватывает Dalle2, MidJourney, StableDiffusion и инструменты с открытым исходным кодом.

- Стабильная диффузия: скрытая модель диффузии текста в изображение.

- Погодное распространение: код «Восстановление зрения в неблагоприятных погодных условиях с помощью моделей диффузии с шумоподавлением на основе патчей».

- DF-GAN: простая и эффективная основа для синтеза текста в изображение.

- Игровая площадка Dall-E: игровая площадка для создания изображений из любой текстовой подсказки с использованием Stable Diffusion (ранее: с использованием DALL-E Mini).

- MM-CelebA-HQ-Dataset: крупномасштабный набор данных изображений лиц, который позволяет генерировать текст в изображение, манипулировать изображениями с помощью текста, создавать эскизы в изображения, GAN для создания и редактирования лиц, подписи к изображению и VQA.

- Deep Daze: простой инструмент командной строки для преобразования текста в изображение с использованием OpenAI CLIP и Siren (сеть неявного нейронного представления).

- StyleMapGAN: использование скрытых пространственных размеров в GAN для редактирования изображений в реальном времени.

- Кандинский-2: Многоязычная модель скрытой диффузии text2image.

- DragGAN: интерактивное точечное манипулирование генеративным многообразием изображений.

- Сегментируйте что угодно: репозиторий предоставляет код для выполнения вывода с помощью модели SegmentAnything (SAM), ссылки для загрузки контрольных точек обученной модели и примеры блокнотов, показывающие, как использовать модель.

- Сегментируйте что-нибудь 2. Репозиторий предоставляет код для выполнения вывода с помощью модели мета-сегмента чего-либо 2 (SAM 2), ссылки для загрузки контрольных точек обученной модели и примеры блокнотов, показывающие, как использовать модель.

- MobileSAM: это официальный код проекта MobileSAM, который упрощает SAM для мобильных приложений и не только!

- FastSAM: быстрая сегментация чего угодно

- Infinigen: бесконечные фотореалистичные миры с использованием процедурной генерации.

- ДАЛЛ·Э 3

- StreamDiffusion: решение на уровне конвейера для интерактивной генерации в реальном времени.

- AnyDoor: настройка изображения на уровне объекта с нуля.

- DiT: Масштабируемые диффузионные модели с трансформаторами.

- BrushNet: модель рисования изображений «подключи и работай» с разложенной диффузией двух ветвей.

- OOTDiffusion: оснащение скрытой диффузии на основе Fusion для управляемой виртуальной примерки.

- ВАР: Официальная реализация. «Визуальное моделирование авторегрессии: создание масштабируемых изображений посредством прогнозирования следующего масштаба».

- Imagine Flash: ускорение моделей диффузии эму с помощью обратной дистилляции

Приложения

- ArtLine: проект на основе глубокого обучения для создания портретов в стиле штриховой графики.

- Depix: восстанавливает пароли из пиксельных снимков экрана.

- Возвращение старых фотографий к жизни: восстановление старых фотографий (официальная реализация PyTorch).

- Переписывание: интерактивный инструмент для непосредственного редактирования правил GAN для синтеза сцен с добавленными, удаленными или измененными объектами. Измените StyleGANv2, чтобы сделать экстравагантные брови или лошадей в шляпах.

- Фоукс: Инструмент сохранения конфиденциальности в системах распознавания лиц.

- Pulse: самоконтролируемая повышающая дискретизация фотографий посредством исследования скрытого пространства генеративных моделей.

- HiDT: Официальный репозиторий статьи «Дневной перевод с высоким разрешением без доменных меток».

- Зарисовка 3D-фото: 3D-фотография с использованием контекстно-зависимой многослойной прорисовки глубины.

- SteganoGAN: SteganoGAN — это инструмент для создания стеганографических изображений с использованием состязательного обучения.

- Stylegan-T: раскрытие возможностей GAN для быстрого крупномасштабного синтеза текста в изображение.

- MegaPortraits: однокадровые мегапиксельные аватары с нейронными головами.

- eg3d: эффективные 3D-генеративно-состязательные сети с учетом геометрии.

- TediGAN: реализация Pytorch для TediGAN: создание и манипулирование разнообразными изображениями лиц с текстовым управлением.

- DALLE-pytorch: реализация/репликация DALL-E, преобразователя текста в изображение OpenAI, в Pytorch.

- StyleNeRF: это реализация с открытым исходным кодом статьи ICLR2022 «StyleNeRF: 3D-генератор на основе стилей для синтеза изображений высокого разрешения».

- DeepSVG: Официальный код статьи «DeepSVG: иерархическая генеративная сеть для векторной анимации». Включает библиотеку PyTorch для глубокого изучения данных SVG.

- NUWA: унифицированный конвейер 3D-трансформеров для визуального синтеза.

- Сверхразрешение изображения через итеративное уточнение: неофициальная реализация суперразрешения изображения посредством итеративного уточнения от Pytorch.

- Лама: ? LaMa Image Inpainting, устойчивая к разрешению прорисовка большой маски со свертками Фурье.

- Person_reID_baseline_pytorch: Pytorch ReID: крошечная, дружественная и мощная реализация базовой линии повторной идентификации объектов с помощью Pytorch.

- instruct-pix2pix: реализация PyTorch InstructPix2Pix, модели редактирования изображений на основе инструкций.

- GFPGAN: Целью GFPGAN является разработка практических алгоритмов восстановления лица в реальных условиях.

- DeepVecFont: синтез высококачественных векторных шрифтов посредством двухмодального обучения.

- Stargan v2 Tensorflow: официальная реализация Tensorflow.

- StyleGAN2 Distillation: парный перевод изображения в изображение, обученный на синтетических данных, сгенерированных StyleGAN2, превосходит существующие подходы к манипулированию изображениями.

- Извлечение обучающих данных из моделей диффузии

- Mann-E — Mann-E (персидский: مانی) — это модель художественного генератора, основанная на весах Stable Diffusion 1.5 и данных, собранных из художественных материалов, доступных на Pinterest.

- Сквозные обученные сети кодирования-декодера CNN для стеганографии изображений

- Grounded-Segment-Anything: объединение заземления DINO с Segment Anything, Stable Diffusion, Tag2Text, BLIP, Whisper и ChatBot — автоматическое обнаружение, сегментация и генерация чего-либо с помощью изображений, текста и аудиовходов.

- AnimateDiff: анимируйте персонализированные модели преобразования текста в изображение без специальной настройки.

- BasicSR: набор инструментов для восстановления изображений и видео с открытым исходным кодом для сверхвысокого разрешения, шумоподавления, устранения размытия и т. д. В настоящее время он включает EDSR, RCAN, SRResNet, SRGAN, ESRGAN, EDVR, BasicVSR, SwinIR, ECBSR и т. д. Также поддерживается StyleGAN2 и DFDNet. [](https://github.com/XPixelGroup/BasicSR)

- Real-ESRGAN: Целью Real-ESRGAN является разработка практических алгоритмов общего восстановления изображений/видео.

- ESRGAN: Расширенный SRGAN. Чемпион PIRM Challenge по сверхразрешению восприятия.

- MixNMatch: многофакторное распутывание и кодирование для генерации условного изображения.

- Clarity-Upscaler: переосмысленное изображение.

- Одноступенчатая диффузия с дистилляцией сопоставления распределения

- Невидимый стежок: генерирование гладких трехмерных сцен с глубиной.

- SSR: реконструкция 3D-сцены с одним видом с высокой формой и текстурой высокой точки.

- INPSR: произвольное изображение Super-Resolution с помощью диффузионной инверсии.

? Обнаружение?

- STYLEGAN3-DETECTOR: SYLEGAN3 Синтетическое обнаружение изображения.

- Stylegan2-Projecting-Images: Проецирование изображений в скрытое пространство с Stylegan2.

- Faldetector: обнаружение лиц Photoshopped путем сценария Photoshop.

? Видео?

Инструменты

- DeepFacelab: DeepFacelab - ведущее программное обеспечение для создания DeepFakes.

- Faceswap: программное обеспечение DeepFakes для всех.

- DOT: DeepFake Atplaint Toolkit.

- SIMSWAP: произвольная структура смазания лица на изображениях и видео с одной отдельной обученной моделью!

- Faceswap-Gan: дноизирующий автоэкодер + состязательные потери и механизмы внимания для обмена лица.

- Celeb DeepFakeForensics: крупномасштабный сложный набор данных для DeepFake Forensics.

- VGEN: целостная экосистема генерации видео для создания генерации видео на моделях диффузии.

- Musev: Бесконечная и высокая верность Виртуальная генерация человеческого видео с визуальной кондиционированной параллельной дженонией.

- Glee: модель общего объекта для изображений и видео в масштабе.

- T-Rex: На пути к общему обнаружению объектов через текстовую визуальную подсказку Synergy.

- Dynamicrafter: анимирующие изображения с открытым доменом с помощью диффузионных приоров видео.

- Мора: больше похоже на Сору для генерального видео.

Приложения

- Face2face-Demo: Demo Pix2pix, которая учится на достопримечательностях лица и переводит это в лицо.

- Faceswap-Deepfake-Pytorch: Faceswap с питорхом или темно -фуклетой с питорхом.

- Point-E: Диффузия облака точек для синтеза трехмерной модели.

- EGVSR: эффективное и общее видео супер-разрешение.

- Stit: Stitch It вовремя: редактирование лиц на основе Gan.

- FounalMattingV2: Фоновое матирование высокого разрешения в реальном времени.

- Modnet: бесплатное решение для портретного матирования в режиме реального времени.

- Справочная информация: фоновая матинг: мир-это ваш зеленый экран.

- Модель первого порядка: этот репозиторий содержит исходный код для модели движения первого порядка первого порядка для анимации изображения.

- Шормозренная анимация: этот репозиторий содержит исходный код для CVPR'2021 Paper Motion Prevations для четкой анимации.

- Удаление человека в реальном времени: удаление людей из сложного происхождения в режиме реального времени с использованием tensorflow.js в веб -браузере.

- Стиль Adain: произвольный перевод стиля в режиме реального времени с адаптивной нормализацией экземпляра.

- Интерполяция кадры: интерполяция кадра для большого движения.

- Awesome-Image-Colorization: коллекция бумаг на основе глубокого обучения и раскраски изображений.

- Sadtalker: изучение реалистичных 3D-коэффициентов движения для стилизованного аудио, выступающего за одно изображение, говорящая анимация лица.

- Roop: Deepfake One Click (обмен лицом).

- StableVideo: текстовое управление последовательности.

- Magicedit: высокая точка временного согласованного редактирования видео.

- Rerender_a_video: с нулевым выстрелом трансляции видео-Video.

- Dreameditor: текстовая 3D-сцена, редактирование с нейронными полями.

- Dreameditor: Синтез 4D в реальном времени в разрешении 4K.

- Animateanyone: последовательный и контролируемый синтез изображения к видео для анимации персонажа.

- Moore-animateanyone: это хранилище воспроизводит аниматеаньоне.

- Audio2photoreal: от аудио до фоторециального воплощения: синтезирование людей в разговорах.

- Magic-Video-V2: многоэтапное генерация высокого уровня видео

- LWM: мультимодальная авторегрессивная модель с крупным контекстом общего назначения. Он обучается на большом наборе данных разнообразных длинных видео и книг с использованием рингелиации и может выполнять язык, изображение и понимание видео и поколение.

- Aniportrait: звуковой синтез фотореалистической портретной анимации.

- Champ: контролируемая и последовательная анимация изображения человеческого изображения с 3D -параметрическим руководством.

- StreamV2V: потоковая трансляция видео-Video с банками.

- Deep Live-Cam: в реальном времени обмен лицом и одно щелчок DeepFake только с одним изображением.

- Sapiens: Фонд для моделей человеческого зрения.

? Обнаружение?

- FaceForensics ++: набор данных FaceForensics.

- Глубокая обнаружение: к обнаружению глубокого фарма, которое на самом деле работает.

- FakeVideOforensics: обнаружить видео с глубокими подделками.

- Обнаружение глубокогофакция: внедрение Pytorch обнаружения DeepFake на основе FaceForensics ++.

- Seqdeepfake: код Pytorch для seqdeepfake: обнаружение и восстановление последовательных манипуляций с глубокими темпами.

- PCL-I2G: Неофициальная реализация: изучение самосогласованности для обнаружения глубоких ног.

- DFDC Deepfake Challenge: решение, получившее приз для DFDC Challenge.

- POI-Forensics: аудиовизуальное обнаружение глубокого человека.

- Стандартизация обнаружения DeepFakes: почему эксперты говорят, что это важно

- Хотите обнаружить глубокую черту? Ищите звезды в их глазах

? Текст?

Инструменты

- GLM-130B: открытая двуязычная предварительно обученная модель.

- LongtermCateXternalsources: GPT-3 Chatbot с долговременной памятью и внешними источниками.

- Эскиз: помощник по написанию кода ИИ, который понимает содержание данных.

- Langchain: ⚡ Строительные приложения с LLMS через композицию ⚡.

- CHATGPT Wrapper: API для взаимодействия с CHATGPT с помощью Python и Shell.

- Openai-Python: библиотека Python Openai предоставляет удобный доступ к API OpenAI из приложений, написанных на языке питона.

- Бето: Испанская версия модели Берта.

- GPT-Code-Clippy: GPT-code-crody (GPT-CC)-это версия Github Copilot, языковая модель, основанная на GPT-3, называемой GPT-Codex.

- GPT NEO: реализация моделей моделей Parallel GPT-2 и GPT-3 в стиле с использованием библиотеки сетки-Tensorflow.

- Ctrl: модель языка условного трансформатора для управляемой генерации.

- Llama: код вывода для моделей Llama.

- Лама2

- Лама охрана 3

- UL2 20B: Ученик с открытым исходным кодом.

- Burgpt: расширение Burp Suite, которое интегрирует GPT Openai, чтобы выполнить дополнительное пассивное сканирование для обнаружения уязвимостей с высокой степенью индивидуальной подготовки, и позволяет использовать анализ на основе трафика любого типа.

- Оллама: Вставай и работай с ламой 2 и другими крупными языковыми моделями на местном уровне.

- SneakyPrompt: джейлбрейк-генеративные модели текста до изображения.

- Copilot-For-Security: генеративное решение для обеспечения безопасности AI, которое помогает повысить эффективность и возможности защитников для улучшения результатов безопасности на скорости и масштабе машины, оставаясь при этом соответствующие ответственным принципам ИИ.

- LM Studio: Discovery, скачать и запустить локальные LLMS

- Обход GPT: преобразовать текст ИИ в человеческий контент

- MGM: Framework поддерживает серию плотных и крупных языковых моделей Moe (LLMS) от 2B до 34B с одновременно пониманием изображения, рассуждения и генерации.

- Secret Llama: Полностью частный чат -бот LLM, который полностью работает с браузером без сервера. Поддерживает Мистраль и Ламу 3.

- Llama3: официальный сайт Meta Llama 3 Github.

? Обнаружение?

- Обнаружение поддельного текста: тестовая комната для модели гигантского языка.

- Гровер: Код для защиты от нейронных фальшивых новостей.

- Repuff.ai: оперативный детектор инъекций.

- Новый классификатор ИИ для указания текста, написанного в АИ

- Откройте для себя 4 магических метода обнаружения текста, сгенерированного AI (включая CHATGPT)

- Gptzero

- Детектор контента ИИ (бета)

- Водяной знак для больших языковых моделей

- Можно ли надежно обнаружить текст, сгенерированный AI?

- Детекторы GPT предвзяты против некоренных английских писателей

- В Чатгпт или не в ЧАТГПТ: В этом вопрос!

- Могут ли лингвисты различать CHATGPT/AI и человеческое письмо?: Изучение этики исследования и академической публикации

- Чатгпт - чушь

Приложения

- Рукопись: рукописное управление генерирует специальное шрифт на основе вашего образца почерка.

- GPT Sandbox: Цель этого проекта-позволить пользователям создавать классные веб-демонстрации, используя недавно выпущенный API OpenAI GPT-3 с несколькими линиями Python.

- Passgan: глубокий подход к обучению для догадки пароля.

- Индекс GPT: индекс GPT - это проект, состоящий из набора структур данных, разработанных для облегчения использования больших внешних баз знаний с LLMS.

- Nanogpt: самый простой, самый быстрый репозиторий для обучения/создания GPT среднего размера.

- WhatsApp-GPT

- Chatgpt Chrome расширение: расширение Chatgpt Chrome. Интегрирует CHATGPT в каждое текстовое поле в Интернете.

- Unilm: крупномасштабные самоотверженные предварительные тренировки по задачам, языкам и модальностям.

- Mingpt: минимальное переопределение Pytorch обречения OpenAI GPT (генеративный предварительный трансформатор).

- Codegeex: открытая многоязычная модель генерации кода.

- Поваренная книга Openai: примеры и руководства для использования API OpenAI.

- ? Потрясающие подсказки CHATGPT: в этот репо включает в себя CHATGPT, чтобы лучше использовать CHATGPT.

- Алиса: предоставление CATGPT доступа к реальному терминалу.

- Обзор кода безопасности с CHATGPT

- Пользователи пишут больше небезопасного кода с помощниками искусственного интеллекта?

- Обход спам -фильтров Gmail с помощью CHATGPT

- Повторяющийся взломщик паролей Gans для повышения безопасности пароля IoT

- Pentestgpt: инструмент для тестирования проникновения в GPT.

- Исследователь GPT: автономный агент, основанный на GPT, который проводит комплексные исследования по любой конкретной теме.

- Инженер GPT: укажите, что вы хотите, чтобы он построил, ИИ просит разъяснить, а затем создает его.

- LocalPilot: используйте GitHub Copilot локально на MacBook с одним щелчком!

- [WormGPT]) (https://thehackernews.com/2023/07/wormgpt-new-ai-tool-allows.html): новый инструмент ИИ позволяет киберпреступникам запускать изысканные кибератаки.

- Poisongpt: Как мы спрятали лоботомизированный LLM, обнимая лицо, чтобы распространить фальшивые новости

- PassGPT: моделирование пароля и (управляемое) генерация с большими языковыми моделями

- Deeppass - поиск паролей с глубоким обучением

- GPTFUZZ: Red Teaming Bargy Language Models с автоматическими подсказками джейлбрейка.

- Откройте интерпретатор: интерпретатор кода Openai в вашем терминале, работающий локально.

- Eureka: дизайн вознаграждения на уровне человека через кодируя большие языковые модели.

- METACLIP: демистификация данных клипа.

- LLM OSINT: метод проверки концепции использования LLMS для сбора информации из Интернета, а затем выполнить задачу с этой информацией.

- Chackingbuddygpt: llms x pentesting.

- Chatgpt-Jailbreaks: Официальный джейлбрейк для CHATGPT (GPT-3.5). Отправьте длинное сообщение в начале разговора с Chatgpt, чтобы стать оскорбительным, неэтичным, агрессивным, человеческим, похожим на человека на английском и итальянском языке.

- Magika: обнаружение типов содержимого файла с глубоким обучением.

- Ян: альтернатива с открытым исходным кодом Catgpt, которая работает на 100% в автономном режиме на вашем компьютере.

- Librechat: улучшенный клон Catgpt: функции OpenAI, Assistants API, Azure, Groq, GPT-4 Vision, Mistral, Bing, Anthropic, OpenRouter, Vertex AI, Gemini, AI Model Switching, Search, Langchain, Dall-E-3, Chatgpt, AI Model Плагины, функции OpenAI, безопасная многопользовательская система, пресеты, полностью открытый источник для самостоятельного управления.

- Lumina-T2X: унифицированная структура для текста для любого генерации модальности.

Разное

- Awesome GPT + Security: курированный список потрясающих инструментов безопасности, экспериментального случая или других интересных вещей с LLM или GPT.

- Удивительное обучение подкреплению для кибербезопасности: кураторский список ресурсов, посвященных подкреплению обучения, применяемым к кибербезопасности.

- Потрясающее машинное обучение для кибербезопасности: куриный список удивительно удивительных инструментов и ресурсов, связанных с использованием машинного обучения для кибербезопасности.

- Обнимание моделей обнимания

- Awesome-AI-Security: кураторский список ресурсов безопасности искусственного интеллекта.

- ML для хакеров: код, сопровождающий книгу «Машинное обучение для хакеров».

- Ужасный ИИ: Ужасный ИИ - это куратор, чтобы отслеживать текущие страшные использование ИИ - надеясь повысить осведомленность.

- NIST AI MARGE MANERACT

- SOK: Объяснимое машинное обучение для приложений компьютерной безопасности

- Кто оценивает оценщиков? Об автоматических показателях для оценки генераторов наступательных кодов на основе искусственного интеллекта

- Приоритизация уязвимости: наступательный подход безопасности

- Miter Atlas ™ (состязательная ландшафт угроз для систем искусственного интеллекта)

- Опрос по обеспечению безопасности обучения подкреплению с применением автономного вождения

- Как избежать ловушек машинного обучения: руководство для академических исследователей

- Куратор соревнований по безопасности и конфиденциальности искусственного интеллекта

- NIST AI 100-2 E2023: Совместное машинное обучение. Таксономия и терминология атак и смягчения.

- ?? Rootedcon 2023 - Inteligencia Artificial Ofensiva - ¿Cómo Podemos Estar Preparados?

- Безопасность AI -символов: основы - Адверстное глубокое обучение

- Помимо гарантий: изучение рисков безопасности CHATGPT

- Карта поверхности атаки AI v1.0

- О невозможной безопасности больших моделей ИИ

- Регламент по границе ИИ: управление новыми рисками для общественной безопасности

- Многослойная структура для хороших практик кибербезопасности для ИИ

- Представление Google Secure AI Framework

- Owasp Top 10 для LLM

- Awesome LLM Security: курирование потрясающих инструментов, документов и проектов о безопасности LLM.

- Основа для надежного использования LLMS в компаниях. Часть 1: Обзор рисков. Часть 2: управление риском. Часть 3: Защита CHATGPT и GitHub Copilot.

- Исследование надежности и надежности генерации кода модели крупного языка

- Определение изображений, сгенерированных AI с синтидом

- Аудит моделей больших языков: трехслойный подход

- Разрешение битвы за короткий риск ИИ

- Мошенничество: злодей Аватар из Chatgpt

- Риски ИИ - Шейер на безопасность

- Использование LLM для незаконных целей: угрозы, меры по профилактике и уязвимости

- Красная команда AI не является универсальным решением для AI Harms: Рекомендации по использованию красных команд для подотчетности ИИ

- Таксономия достоверности для искусственного интеллекта

- Управление рисками ИИ в эпоху быстрого прогресса

- Google - действует на нашу приверженность безопасному и безопасному ИИ

- Наступательный ML Playbook

- Демистификация генеративного ИИ? Примечания исследователя безопасности

- Genai-Security-Приключения: инициатива с открытым исходным кодом по обмену заметками, презентациями и разнообразной коллекцией экспериментов, представленных в ноутбуках Jupyter, которые были направлены на то, чтобы помочь вам понять основные концепции, лежащие в основе крупных языковых моделей, и изучить интригующее пересечение безопасности и натуральные Языковая обработка.

- Лагерь безопасности ИИ соединяет вас с помощью исследования к сотрудничеству по проекту - чтобы увидеть, где ваша работа может помочь обеспечить безопасность будущего ИИ.

- Руководство по разработке безопасной системы ИИ

- Подход к искусственному интеллекту и кибербезопасности. Отчет о лучшей практике

- Стэнфордский, безопасный и заслуживающий доверия трекер AI EO 14110

- Awesome ML Security: кураторский список удивительных ссылок на безопасность машинного обучения, руководство, инструменты и многое другое.

- Предсказуемый путь ИИ: 7 чего ожидать от ИИ в 2024 году.

- Искусственный интеллект и кибербезопасность (на испанском ??)

- Бдение: обнаружить быстрые инъекции, джейлбрейки и другие потенциально рискованные входные данные о большой языке (LLM).

- Генеративные модели искусственного интеллекта - возможности и риски для промышленности и властей

- Безопасное развертывание систем ИИ. Лучшие методы развертывания безопасных и устойчивых систем ИИ

- NIST AI 600-1: Структура управления рисками искусственного интеллекта: Профиль генеративного искусственного интеллекта

- ?? ANSSI: Рекомендации De Sécurité Pour on Système d'Hia générative (рекомендации по безопасности для генеративной системы ИИ)

- PYRIT: Инструмент идентификации риска Python для генеративного AI (Pyrit)-это структура автоматизации с открытым доступом для расширения возможностей специалистов в области безопасности и инженеров машинного обучения, чтобы активно находить риски в своих генеративных системах ИИ.

- OWASP-AGENTIC-AI: работа, чтобы создать топ-10 OWASP для агента AI (AI Agent Security).

- На пути к гарантированному безопасному ИИ: структура для обеспечения надежных и надежных систем ИИ

- Определение реальных рисков ИИ

- Безопасный подход к генеративному ИИ

- Большие языковые модели в кибербезопасности

- Эй, это моя модель! Представление цепочки и хэша, метод снятия пальцев LLM

- Генеративное злоупотребление ИИ: таксономия тактики и понимания из реальных данных

- РИСКИЙ РИСКА ИИ

- Пересмотр AI Red-Teaming

- Немецкие рекомендации по использованию помощников по программированию ИИ

- Масштабируемая водянка для выявления выходов модели крупных языков

Опросы

- Угроза оскорбительного ИИ для организаций

- Искусственный интеллект в кибер -области: оскорбление и защита

- Опрос о состязательных атакх и защите

- Глубокое обучение состязания: опрос о состязательных атаках и защитных механизмах по классификации изображений

- Обследование приступов конфиденциальности в машинном обучении

- На пути к угрозам безопасности систем глубокого обучения: опрос

- Опрос об угрозах безопасности и защитных методах машинного обучения: ориентированное на данные представление

- SOK: безопасность и конфиденциальность в машинном обучении

- Адверстное машинное обучение: рост преступности с поддержкой AI и его роль в уклоне к спам-фильтрам

- Угрозы, уязвимости и контроль систем на основе машинного обучения: опрос и таксономия

- Состязательные атаки и защита: опрос

- Вопросы безопасности: опрос о состязательном машинном обучении

- Опрос о состязательных атаках для анализа вредоносных программ

- Совместное машинное обучение в классификации изображений: опрос на перспективе защитника

- Обследование надежного состязательного обучения по распознаванию моделей: фундаментальная, теория и методологии

- Конфиденциальность в крупных языковых моделях: атаки, защита и будущие направления

? Содействия?

Мигель Эрнандес |

Жозе Игнасио Эспибано |

© ️ Лицензия © ️

- Creative Commons Attribution-Share Alike 4.0 International