китайский | английский

Цель этого проекта с открытым исходным кодом — начать с нуля всего за 3 часа! Вы можете обучить MiniMind, миниатюрную языковую модель размером всего 26,88 МБ.

MiniMind чрезвычайно легкий, а самая маленькая версия имеет размер GPT3.

MiniMind выпустила минималистическую структуру большой модели, очистку и предварительную обработку набора данных, контролируемое предварительное обучение (Pretrain), контролируемую точную настройку инструкций (SFT), точную настройку низкоранговой адаптивной (LoRA) и прямое согласование предпочтений в обучении с подкреплением без вознаграждения ( DPO) Полный этап кода также включает расширение разреженной модели общих гибридных экспертов (MoE) расширение визуального мультимодального VLM: MiniMind-V;

Это не только реализация модели с открытым исходным кодом, но и руководство по началу работы с большими языковыми моделями (LLM).

Мы надеемся, что этот проект может предоставить исследователям вводный пример, который поможет каждому быстро начать работу и генерировать больше исследований и инноваций в области LLM.

Во избежание недоразумений, «до 3 часов» означает, что вам нужна машина с моей собственной аппаратной конфигурацией. Подробные характеристики будут представлены ниже.

Онлайн-тест ModelScope | Ссылка на видео Bilibili

В области больших языковых моделей (LLM), таких как GPT, LLaMA, GLM и т. д., хотя их эффекты и поразительны, огромных параметров модели в 10 миллиардов и памяти персональных устройств далеко недостаточно для обучения, и даже вывод затруднен. Почти всем не достаточно просто дорабатывать большие модели с помощью таких программ, как Лора, чтобы выучить какие-то новые инструкции. Это примерно то же самое, что учить Ньютона играть со смартфоном 21 века. Однако это далеко не познание тайн. сама физика. Кроме того, маркетинговые аккаунты, продающие платные курсы по подписке, полны лазеек и учебных пособий, объясняющих ИИ лишь наполовину, что еще больше затрудняет понимание высококачественного контента LLM и серьезно мешает обучающимся.

Поэтому цель этого проекта — бесконечно снизить порог для начала работы с LLM и обучить чрезвычайно легкую языковую модель непосредственно с нуля.

Кончик

(По состоянию на 17 сентября 2024 г.) Серия MiniMind завершила предварительное обучение трех моделей моделей. Минимально необходимое значение составляет всего 26M (0,02B), чтобы обеспечить плавный диалог!

| Модель (размер) | длина токенизатора | обоснование занятости | выпускать | Субъективный рейтинг (/100) |

|---|---|---|---|---|

| minimind-v1-маленький (26M) | 6400 | 0,5 ГБ | 2024.08.28 | 50 минут |

| minimind-v1-moe (4×26M) | 6400 | 1,0 ГБ | 2024.09.17 | 55' |

| минимозг-v1 (108M) | 6400 | 1,0 ГБ | 2024.09.01 | 60 минут |

Анализ проводился на графическом процессоре 2×RTX 3090 с Torch 2.1.2, CUDA 12.2 и Flash Attention 2.

Проект включает в себя:

transformers , accelerate , trl , peft и т.д.Я надеюсь, что этот проект с открытым исходным кодом поможет новичкам LLM быстро начать работу!

Расширяет мультимодальные возможности MiniMind — видение

Перейдите в проект-близнец minimind-v, чтобы просмотреть подробности!

09-27 Обновлен метод предварительной обработки набора данных предварительного обучения. Чтобы обеспечить целостность текста, предварительная обработка была отменена и преобразована в обучение .bin (немного жертвуя скоростью обучения).

Текущий файл после предварительной обработки называется pretrain_data.csv.

Удален некоторый лишний код.

Обновление модели minimind-v1-moe

Чтобы предотвратить двусмысленность, mistral_tokenizer больше не используется для сегментации слов, а все пользовательские minimind_tokenizer используются для сегментации слов.

Обновленная модель minimind-v1 (108M), использующая minimind_tokenizer, раунды предварительной тренировки 3 + раунды SFT 10, более полное обучение и более высокая производительность.

Проект был развернут в пространстве создания ModelScope, и с ним можно ознакомиться на этом веб-сайте:

?Интернет-опыт ModelScope?

Это всего лишь моя личная конфигурация программного и аппаратного обеспечения, пожалуйста, измените ее по своему усмотрению:

CPU: Intel(R) Core(TM) i9-10980XE CPU @ 3.00GHz

内存:128 GB

显卡:NVIDIA GeForce RTX 3090(24GB) * 2

环境:python 3.9 + Torch 2.1.2 + DDP单机多卡训练MiniMind (HuggingFace)

MiniMind (ModelScope)

# step 1

git clone https://huggingface.co/jingyaogong/minimind-v1 # step 2

python 2-eval.pyИли запустите стримлит и запустите интерфейс веб-чата.

«Примечание» требует Python >= 3.10, установите

pip install streamlit==1.27.2

# or step 3, use streamlit

streamlit run fast_inference.py0. Клонировать код проекта

git clone https://github.com/jingyaogong/minimind.git

cd minimind1. Установка среды

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple # 测试torch是否可用cuda

import torch

print(torch.cuda.is_available())

Если он недоступен, перейдите на torch_stable, чтобы загрузить файл whl и установить его самостоятельно. Справочная ссылка

2. Если вам нужно тренироваться

2.1 Загрузите адрес загрузки набора данных и поместите его в каталог ./dataset .

2.2 python data_process.py обрабатывает наборы данных. Например, данные предварительной подготовки предварительно кодируются токенами, а наборы данных sft извлекаются из файлов qa в CSV.

2.3. Настройте конфигурацию параметров модели в ./model/LMConfig.py

Здесь вам нужно только настроить параметры dim, n_layers и use_moe, которые равны

(512+8)или(768+16)соответственно, что соответствуетminimind-v1-smallиminimind-v1

2.4 python 1-pretrain.py выполняет предварительное обучение и получает pretrain_*.pth в качестве выходного веса предварительного обучения.

2.5 python 3-full_sft.py выполняет точную настройку инструкций и получает full_sft_*.pth в качестве выходного веса точной настройки инструкций.

2.6 python 4-lora_sft.py выполняет тонкую настройку lora (не требуется)

2.7 python 5-dpo_train.py выполняет согласование обучения с подкреплением предпочтений человека DPO (необязательно)

3. Проверьте эффект рассуждения модели.

*.pth , которые необходимо использовать, и завершенное обучение расположены в каталоге ./out/ .*.pth . minimind/out

├── multi_chat

│ ├── full_sft_512.pth

│ ├── full_sft_512_moe.pth

│ └── full_sft_768.pth

├── single_chat

│ ├── full_sft_512.pth

│ ├── full_sft_512_moe.pth

│ └── full_sft_768.pth

├── pretrain_768.pth

├── pretrain_512_moe.pth

├── pretrain_512.pth

python 0-eval_pretrain.py тестирует эффект пасьянса предварительно обученной моделиpython 2-eval.py тестирует эффект диалога модели

Предварительное обучение «Совет» и полная точная настройка параметров pretrain и full_sft поддерживают ускорение нескольких карт.

Предполагая, что на вашем устройстве только одна видеокарта, просто используйте собственный Python, чтобы начать обучение:

python 1-pretrain.py

# and

python 3-full_sft.pyПредположим, что ваше устройство имеет N (N>1) видеокарт:

Обучение запуску автономной карты N (DDP)

torchrun --nproc_per_node N 1-pretrain.py

# and

torchrun --nproc_per_node N 3-full_sft.pyОбучение запуску автономной карты N (DeepSpeed)

deepspeed --master_port 29500 --num_gpus=N 1-pretrain.py

# and

deepspeed --master_port 29500 --num_gpus=N 3-full_sft.pyВключите wandb для записи процесса тренировки (необязательно)

torchrun --nproc_per_node N 1-pretrain.py --use_wandb

# and

python 1-pretrain.py --use_wandb Добавив параметр --use_wandb , можно записать процесс обучения. После завершения обучения процесс обучения можно просмотреть на веб-сайте wandb. Изменяя параметры wandb_project и wandb_run_name , вы можете указать имя проекта и имя запуска.

? Tokenizer: Tokenizer в nlp похож на словарь. Он сопоставляет слова естественного языка с числами, такими как 0, 1 и 36, через «словарь». Понятно, что число представляет собой номер страницы слова. «словарь». Существует два способа создания токенизатора LLM: один — самостоятельно составить список слов для обучения токенизатора, код можно найти train_tokenizer.py , другой — выбрать токенизатор, обученный по модели с открытым исходным кодом; Конечно, вы можете напрямую выбрать словарь Синьхуа или Оксфордский словарь для «словаря». Преимущество заключается в том, что степень сжатия преобразования токенов очень хорошая, но недостатком является то, что список словаря слишком длинный и содержит сотни тысяч словарных фраз. Вы также можете использовать собственный обученный сегментатор слов. Преимущество состоит в том, что списком слов можно управлять по своему усмотрению. Недостаток заключается в том, что степень сжатия недостаточно идеальна, и охватить все редкие слова непросто. Конечно, выбор «словаря» важен. Выходные данные LLM — это, по сути, задача мультиклассификации N слов из SoftMax в словарь, а затем декодированных в естественный язык через «словарь». Поскольку LLM очень мал, чтобы избежать перегруженности модели (отношение параметров слоя встраивания слов ко всему LLM слишком велико), длину словаря необходимо выбирать относительно небольшой. Мощные модели с открытым исходным кодом, такие как 01 Wanwu, Qianwen, Chatglm, Mistral, Llama3 и т. д., имеют следующую длину словаря токенизатора:

| Модель токенизатора | Размер словарного запаса | источник |

|---|---|---|

| токенизатор йи | 64 000 | 01 Всё (Китай) |

| токенизатор qwen2 | 151 643 | Облако Алибаба (Китай) |

| glm токенизатор | 151 329 | Мудрость ИИ (Китай) |

| мистраль токенизатор | 32 000 | Мистраль АИ (Франция) |

| токенизатор ламы3 | 128 000 | Мета (США) |

| токенизатор миниразума | 6400 | Настроить |

Обновление от 17 сентября 2024 г.: во избежание двусмысленности и контроля громкости в предыдущих версиях все модели minimind используют сегментацию слов minimind_tokenizer, а все версии mistral_tokenizer отменены.

Хотя длина minimind_tokenizer очень мала, эффективность кодирования и декодирования ниже, чем у китайских токенизаторов, таких как qwen2 и glm. Тем не менее, модель minimind выбрала свой собственный обученный minimind_tokenizer в качестве сегментатора слов, чтобы сохранить общие параметры легкими и избежать дисбаланса в пропорциях уровня кодирования и слоя вычислений, который является тяжелым, поскольку размер словаря minimind составляет всего лишь 6400. Кроме того, минимайнду не удалось расшифровать редкие слова в реальных тестах, и результаты хорошие. Поскольку пользовательский список слов сжимается до 6400 слов, общий размер параметров LLM составляет всего 26 МБ.

?[Предварительные данные]: универсальный набор текстовых данных Seq-Monkey/Сетевой диск Seq-Monkey Baidu компилируется и очищается из различных общедоступных исходных данных (таких как веб-страницы, энциклопедии, блоги, открытые исходные коды, книги и т. д.). . Они организованы в единый формат JSONL и прошли строгую проверку и дедупликацию для обеспечения полноты, масштаба, достоверности и высокого качества данных. Общая сумма составляет около 10 миллиардов токенов, что подходит для предварительного обучения моделей большого китайского языка.

Вариант 2: общедоступная часть набора данных SkyPile-150B содержит около 233 миллионов уникальных веб-страниц, каждая из которых содержит в среднем более 1000 китайских иероглифов. Набор данных включает около 150 миллиардов токенов и 620 ГБ текстовых данных. Если вы спешите , вы можете попробовать выбрать только часть jsonl-загрузки SkyPile-150B (и сгенерировать файл *.csv для текстового токенизатора в ./data_process.py), чтобы быстро пройти процесс предварительного обучения. .

Загрузите в каталог ./dataset/

| Набор обучающих данных MiniMind | Скачать адрес |

|---|---|

| [обучающий набор токенизатора] | HuggingFace / Baidu Netdisk |

| 【Предварительная подготовка данных】 | Официальный Seq-Monkey/Сетевой диск Baidu/HuggingFace |

| 【Данные SFT】 | Набор данных SFT большой модели Цзяншу |

| 【Данные ДПО】 | Обнимающее лицо |

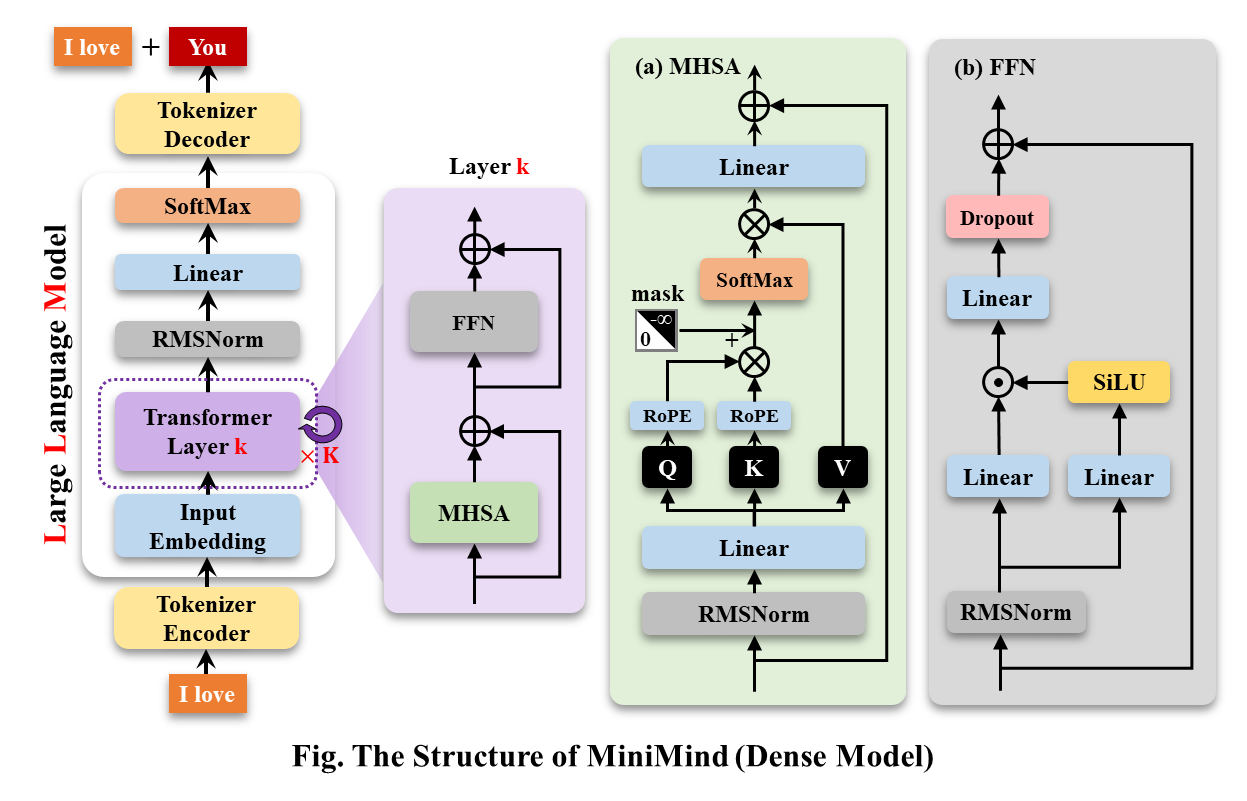

MiniMind-Dense (так же, как Llama3.1) использует структуру Transformer только для декодера. Отличие от GPT-3 заключается в следующем:

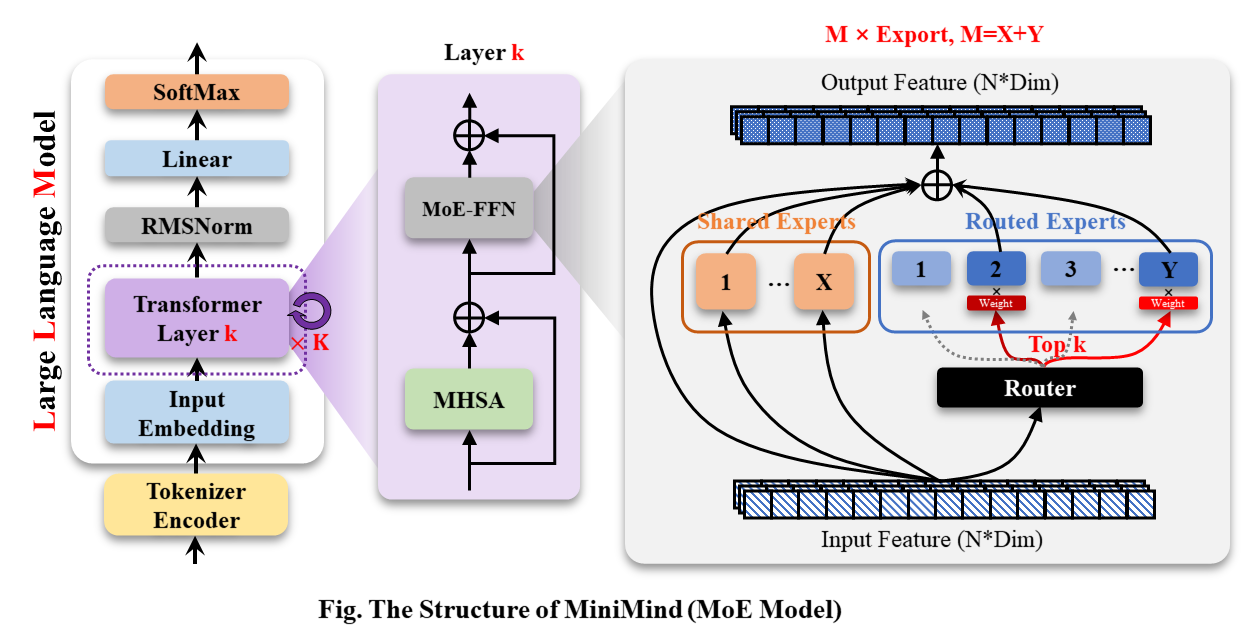

Модель MiniMind-MoE, ее структура основана на Llama3 и гибридном экспертном модуле MixFFN в Deepseek-V2.

Общая структура MiniMind такая же, за исключением некоторых незначительных изменений в коде расчета RoPE, функции вывода и уровне FFN. Его структура следующая (перерисованная версия):

Чтобы изменить конфигурацию модели, см. ./model/LMConfig.py. Версии моделей, которые в настоящее время обучаются Minimind, показаны в таблице ниже:

| Название модели | параметры | len_vocab | n_layers | d_модель | kv_heads | q_heads | поделиться+маршрут | ТопК |

|---|---|---|---|---|---|---|---|---|

| minimind-v1-маленький | 26М | 6400 | 8 | 512 | 8 | 16 | - | - |

| минимозг-v1-мо | 4×26М | 6400 | 8 | 512 | 8 | 16 | 2+4 | 2 |

| минимозг-v1 | 108М | 6400 | 16 | 768 | 8 | 16 | - | - |

| Название модели | параметры | len_vocab | размер_пакета | pretrain_time | sft_single_time | sft_multi_time |

|---|---|---|---|---|---|---|

| minimind-v1-маленький | 26М | 6400 | 64 | ≈2 часа (1 эпоха) | ≈2 часа (1 эпоха) | ≈0,5 часа (1 эпоха) |

| минимозг-v1-мо | 4×26М | 6400 | 40 | ≈6 часов (1 эпоха) | ≈5 часов (1 эпоха) | ≈1 час (1 эпоха) |

| минимозг-v1 | 108М | 6400 | 16 | ≈6 часов (1 эпоха) | ≈4 часа (1 эпоха) | ≈1 час (1 эпоха) |

Предварительное обучение (текст в текст) :

Скорость обучения предварительного обучения установлена на динамическую скорость обучения от 1e-4 до 1e-5, а количество эпох предварительного обучения установлено на 5.

torchrun --nproc_per_node 2 1-pretrain.pyОдин диалог. Точная настройка :

Регулируя линейную разницу RoPE во время вывода, удобно экстраполировать длину до 1024 или 2048 и выше. Скорость обучения установлена на динамическую скорость обучения от 1e-5 до 1e-6, а количество эпох точной настройки равно 6.

# 3-full_sft.py中设置数据集为sft_data_single.csv

torchrun --nproc_per_node 2 3-full_sft.pyМногодиалоговое окно Точная настройка :

Скорость обучения установлена на динамическую скорость обучения от 1e-5 до 1e-6, а количество эпох точной настройки равно 5.

# 3-full_sft.py中设置数据集为sft_data.csv

torchrun --nproc_per_node 2 3-full_sft.pyОбучение с подкреплением человеческой обратной связи (RLHF) — прямая оптимизация предпочтений (DPO) :

Набор данных триплета подвижного типа (q, выбрать, отклонить), скорость обучения le-5, половинная точность fp16, всего 1 эпоха и занимает 1 час.

python 5-dpo_train.py ? Что касается настройки параметров LLM, есть очень интересная статья MobileLLM, в которой проводятся подробные исследования и эксперименты. Закон масштабирования имеет свои уникальные правила для небольших моделей. Параметры, которые вызывают масштабирование параметров Transformer, зависят почти исключительно от d_model и n_layers .

d_model ↑+ n_layers ↓->Шалтай-Болтайd_model ↓+ n_layers ↑->стройный и высокий В документе, предлагающем Закон масштабирования в 2020 году, говорится, что объем обучающих данных, количество параметров и количество обучающих итераций являются ключевыми факторами, определяющими производительность, а влияние архитектуры модели можно практически игнорировать. Однако, похоже, этот закон не в полной мере распространяется на небольшие модели. MobileLLM предполагает, что глубина архитектуры важнее ширины. «Тонкая» модель «глубокая и узкая» может изучать более абстрактные концепции, чем модель «широкая и неглубокая». Например, когда параметры модели фиксированы на уровне 125M или 350M, «узкая» модель с 30–42 слоями имеет значительно лучшую производительность, чем «короткая и толстая» модель с примерно 12 слоями, в 8 тестах производительности, таких как рассуждения здравого смысла. , вопросы и ответы и понимание прочитанного. Существуют аналогичные тенденции. На самом деле это очень интересное открытие, потому что раньше при проектировании архитектур для небольших моделей размером около 100М почти никто не пытался укладывать более 12 слоев. Это согласуется с экспериментально наблюдаемым эффектом MiniMind, регулирующим параметры модели между d_model и n_layers во время процесса обучения. Однако «узкий» вариант «глубокий и узкий» также имеет ограничение по размеру. Когда d_model<512, недостаток размерности встраивания слов очень очевиден. Добавленные слои не могут компенсировать недостаток d_head, вызванный встраиванием слов. в фиксированном q_head. Когда d_model>1536, увеличение количества слоев имеет более высокий приоритет, чем d_model, и может принести более «экономичные» параметры -> усиление эффекта. Поэтому MiniMind устанавливает d_model=512 и n_layers=8 маленькой модели, чтобы получить баланс «очень маленький объем <-> лучший эффект». Установите d_model=768, n_layers=16, чтобы получить большую выгоду от эффекта, который больше соответствует изменяющейся кривой закона масштабирования небольших моделей.

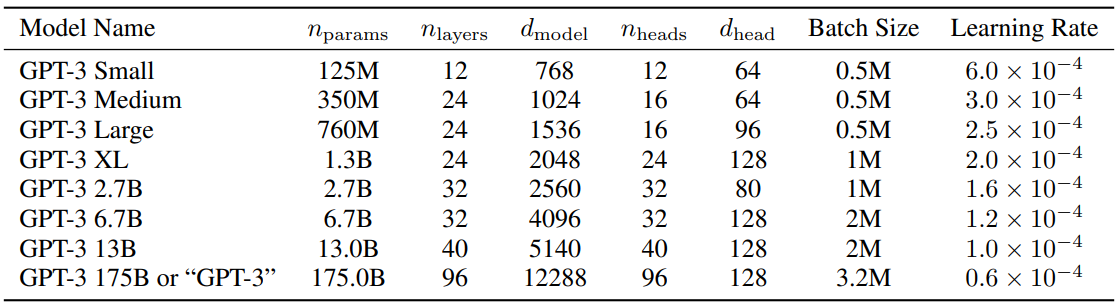

Для справки настройки параметров GPT3 показаны в таблице ниже:

?Байду Нетдиск

| Название модели | параметры | Конфигурация | pretrain_model | single_sft_model | multi_sft_model | rl_model |

|---|---|---|---|---|---|---|

| minimind-v1-маленький | 26М | d_model=512 n_layers=8 | pretrain_512.pth | single_chat/full_sft_512.pth | multi_chat/full_sft_512.pth | rl_512.pth |

| минимозг-v1-мо | 4×26М | d_model=512 n_layers=8 | pretrain_512_moe.pth | single_chat/full_sft_512_moe.pth | multi_chat/full_sft_512_moe.pth | - |

| минимозг-v1 | 108М | d_model=768 n_layers=16 | pretrain_768.pth | single_chat/full_sft_768.pth | multi_chat/full_sft_768.pth | rl_768.pth |

Кончик

Протестируйте сравнение модели мини-разума на основе «однораундного диалога full_sft» и «согласования обучения с подкреплением DPO».

Файл модели Baidu Netdisk, где rl_<dim>.pth — вес модели minimind после «выравнивания обучения с подкреплением DPO».

[Q]: 你叫什么名字?

[ft_768]: 我是一款人工智能语言模型,可以回答您的问题和提供帮助。您有什么需要我帮忙的吗?

[rl_768]: 我是一款基于人工智能技术的自然语言处理系统,主要用于处理和生成人类语言的任务。我可以帮助用户进行文本处理、语音识别、文本生成等任务,同时也可以帮助用户进行智能聊天、翻译、翻译等多种应用。如果您需要更多关于该项目的信息,请告诉我。

[ft_512]: 我很高兴能够帮助你。你有什么其他问题需要我帮忙解答吗?

[rl_512]: 我是一款基于自然语言处理技术的聊天机器人,能够理解和回复用户的问题和指令,并进行相应的回复和回复。我被训练为能够与人类进行交互和回答各种问题和任务。请问有什么需要吗?

[Q]: 你是谁?

[ft_768]: 我是一个人工智能语言模型,没有个人身份和身份。我只是根据输入的指令和文本信息生成响应。

[rl_768]: 我是一个计算机程序,没有个人身份或身份。我被设计来回答各种问题和提供帮助,包括回答问题、提供建议、进行实验、提供信息等等。我被广泛应用于各种领域,例如自然语言处理、计算机视觉、人工智能等等。如果您需要更多的帮助或信息,请随时与我联系。我会尽我所能来帮助您的工作和生活。

[ft_512]: 我是一个大型语言模型,可以回答各种各样的问题,包括科学、历史、文化和技术方面的问题。您有什么需要我回答的问题吗?

[rl_512]: 我是一个计算机程序,没有具体的身世和人物。如果您可以告诉我您想知道的具体信息,我会尽力回答您的问题。

[Q]: 中国有哪些比较好的大学?

[ft_768]: 中国有很多著名的大学,其中包括北京大学、上海交通大学、复兴中医药学院、浙江大学等。这些大学在不同的领域都有着自己的标志性建筑和研究方向,值得一提的是,它们在中国的顶尖教育资源中享有很高的声誉。

[rl_768]: 中国的大学有很多,具体情况还要根据你的需求来决定。如果你需要更详细的信息,建议可以去咨询一下你所在城市的大学排名和政策法规,从而选择一个合适的大学。同时,你可以在网上查阅相关信息,或者去咨询一些大学相关机构,如中国人民大学、中国人民大学等,以获得更为详细和专业的指导和建议。

[ft_512]: 中国有很多优秀的大学,比如麻省理工学院、北京大学、上海大学等等。这些大学在中国教育事业的发展和成就都非常突出。

[rl_512]: 中国教育局、中国大学、中国大陆大学和中国大陆大学均有优秀的教育体裁,但各地教育水平和专业要求都可能存在差异。中国教育局的学历要求、教学方法、师资力量等因素都各具特点,而大学的学历要求也各有千秋。中国大陆大学生的学历要求也各有不同,需要根据自己的实际情况进行选择。如果您对中国大陆大学生的专业要求有更具体需求,建议您可以通过互联网、国内外的各类机构和机构进行比较和交流。同时,您也可以向身边的人或朋友、老师、家长等人士寻求帮助和建议。希望以上回答对您有帮助。

[Q]: 你知道光速是多少吗?

[ft_768]: 光速是一个物理常数,表示光在真空中传播的速度,大约是每秒299792458米。光速是物理学中最基本的物理常数之一,也是相对论的重要基础之一。

[rl_768]: 当然知道,光速是光在真空中传播的速度,通常用c来表示。它是宇宙物理学中非常重要的理论之一。在物理学中,光速被认为是宇宙中最重要的速度之一。它代表着光在真空中传播的速度,这也是许多重要公式和公式的基础。

[ft_512]: 光速是光在真空中传播的速度,约为每秒299,792,458米。它是几乎所有的物理学概念,也是宇宙中最神秘和最重要的物理概念之一。

[rl_512]: 光速是光在真空中传播的速度,是自然界中不可逆转的速度。光源是由光的原子、分子、固体和光的组成,其速度约为每秒平方。光的速度是每秒约1个英亞或光年,这个数字是根据相对论、量子力学和引力理论来计算的。光速是相对的概念之一,它代表着我们对自然界中任何事件的理解和解释。

Кончик

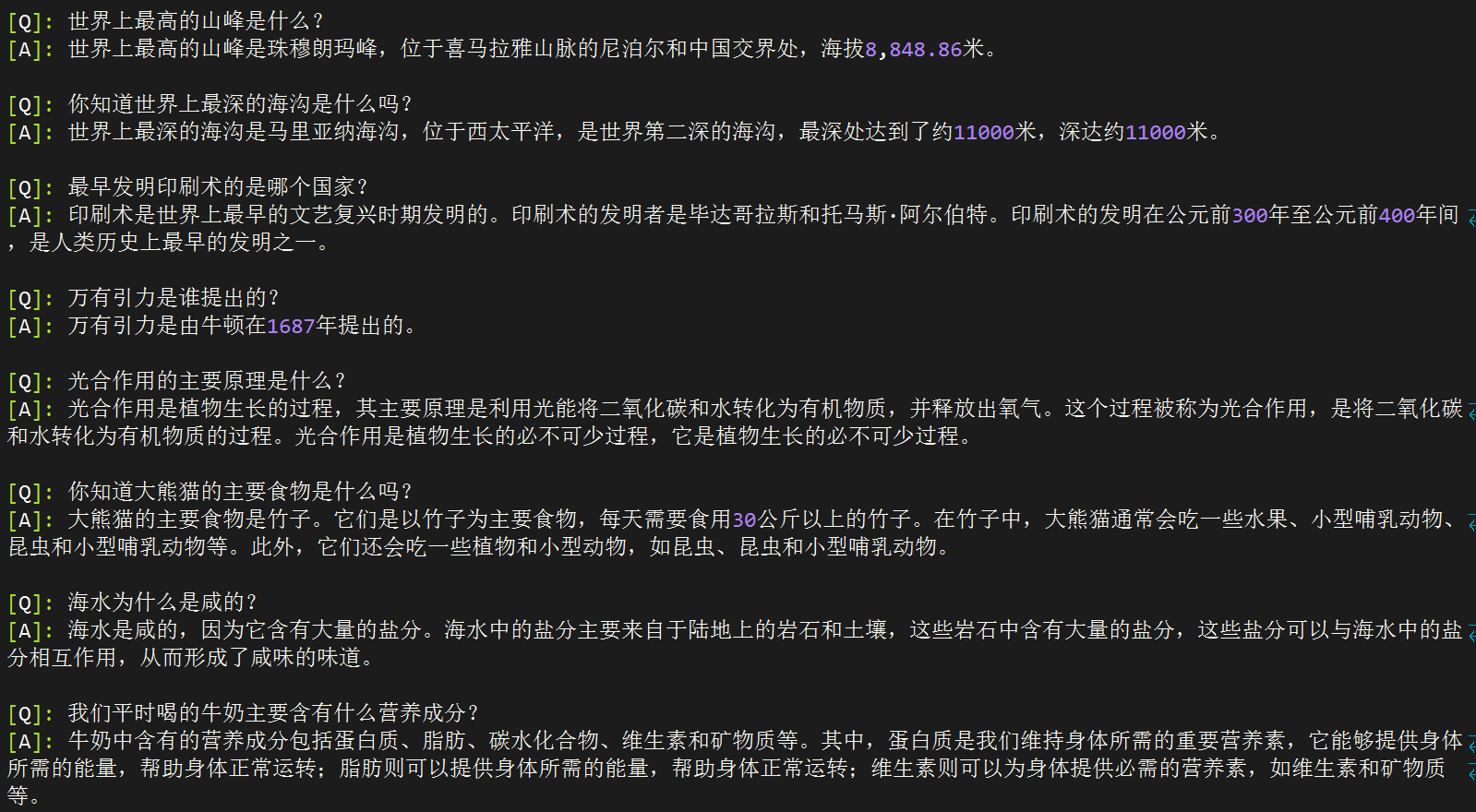

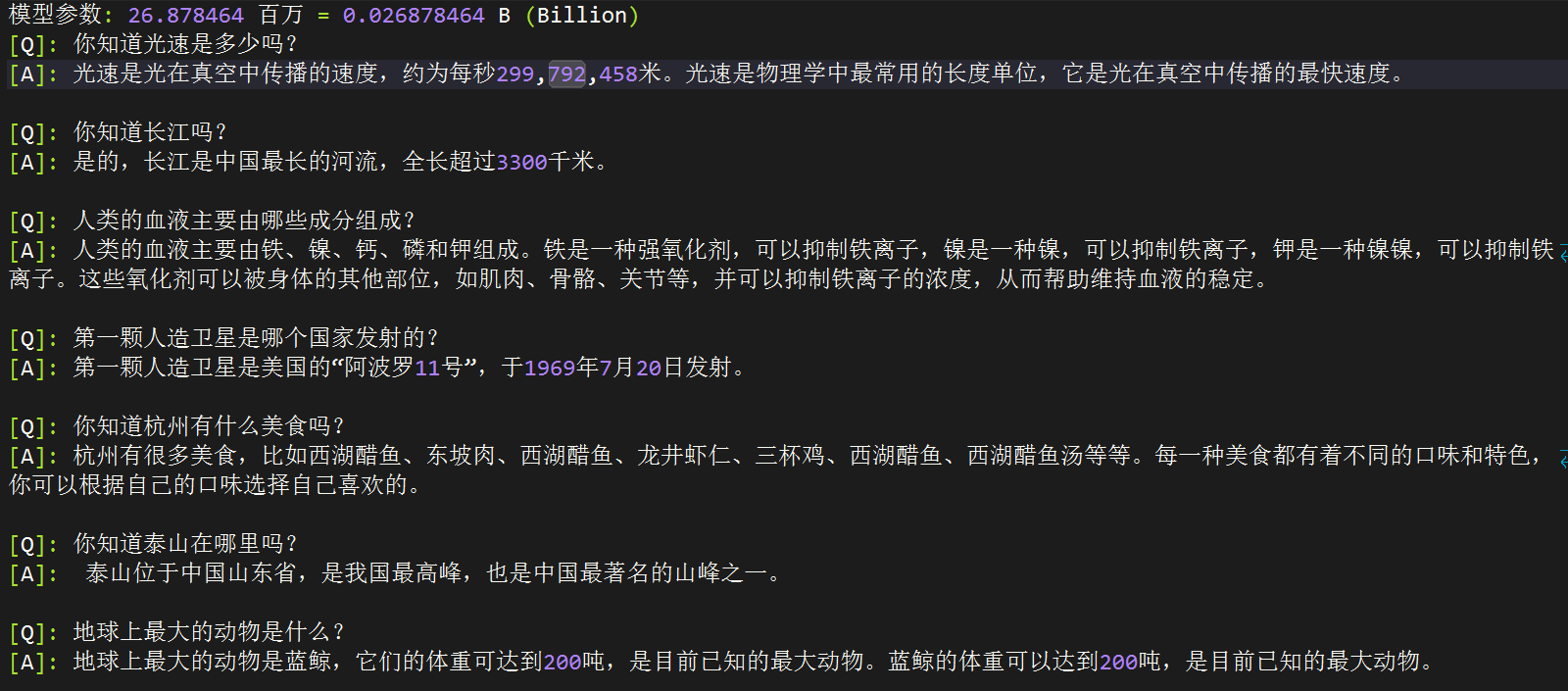

Следующее испытание было завершено 17 сентября 2024 г. Новые модели, выпущенные после этой даты, не будут участвовать в тестировании, если нет особых потребностей. Протестируйте модель мини-разума, основанную на однораундном диалоге full_sft (без многораундовой тонкой настройки и тонкой настройки обучения с подкреплением).

[A] minimind-v1-small(0.02B)

[B] minimind-v1-moe(0.1B)

[C] minimind-v1(0.1B)

[D] малыш-лама2-китайский(0.2B)

[E] чат-мини-китайский (0.2B)

[Q]: 你知道长江吗?

[A]: 是的,长江是中国最长的河流,全长超过3300千米。

[B]: 长江是中国最长的河流,总长度约为6300公里。它发源于青藏高原的青海湖,流经青海、四川、甘肃、宁夏、内蒙古、陕西和山西。长江流域是中国最大的农业区之一,也是中国的文化和经济中心。

[C]: 是的,长江是中国最长的河流之一,也是世界第三大河流。长江发源于青藏高原,流经11个省份,最终注入东海。长江流域是中国最大的河流流域之一,拥有着丰富的自然资源和文化遗产,如长江大桥、长江海洋博物馆、长江古城等。

[D]: 同时也知道,中国是世界上最长的城市之一,拥有超过3400万人口。

[E]: 是的,长江是中国最长的河流,也是世界上最长的河流之一。它发源于青藏高原,流经九个省区,最终注入东海。长江流域的气候温和,四季分明,是中国重要的农业和工业基地。长江流域的水产资源丰富,是中国的重要渔业资源之一。

[Q]: 第一颗人造卫星是哪个国家发射的?

[A]: 第一颗人造卫星是斯普特尼克1号。

[B]: 第一颗人造卫星是俄罗斯的国际卫星,于1957年发射。

[C]: 第一颗人造卫星是苏联发射的,它是由苏联于1957年10月发射的。

[D]: 这颗名为“阿姆斯特朗”的卫星,于1961年11月20日发射,是第一个成功将人类送入太空的卫星。

[E]: 第一颗人造卫星是苏联于1957年4月4日发射的,它是由苏联宇航员尤里·加加林(Yuri Gagarin)和苏联工程师罗尔德·谢尔盖耶夫(Roald Skohley)共同发射的。在发射过程中,加加林和谢尔盖耶夫使用了一个名为“斯普特尼克1号”的小型卫星,它的直径为4.3米,重量为1,051公斤。这枚卫星被称为“斯普特尼克1号”,是苏联太空竞赛中的一个里程碑,也是人类历史上第一次在太空中进行太空行走。

[Q]: 你知道泰山在哪里吗?

[A]: 泰山位于中国东部地区,是中国五岳之一。

[B]: 泰山位于山东省泰安市泰安市。泰安市是中国五岳之一,也是世界文化遗产和中国历史文化名山之一。泰安市有许多著名的景点,如五岳之一、玉皇顶、南天门、玉皇阁等。

[C]: 泰山位于中国山东省泰安市,是中国五岳之一。

[D]: 作为一个人工智能助手,我无法访问互联网,因此无法提供关于你所在位置的信息。不过,你可以通过搜索或搜索相关关键词来获取有关你所在位置的信息,或者查看相关新闻或网站来获取有关你所在位置的信息。

[E]: 泰山位于中国山东省泰安市境内,是中国五岳之一,也是中国文化和历史的重要象征之一。它是中国五岳之一,也是中国道教和佛教的发源地之一。泰山的海拔高度为1,545米,是中国五岳之一,也是中国最著名的旅游景点之一。它的历史可以追溯到公元前5世纪,是中国古代帝王祭祀的场所。泰山也是中国文化的重要组成部分,被誉为“五岳之首”,是中国文化的重要遗产之一。

[Q]: 世界上最高的山峰是什么?

[A]: 世界上最高的山峰是珠穆朗玛峰,位于尼泊尔和中国的边境上,海拔8848米。

[B]: 世界上最高的山峰是珠穆朗玛峰,位于喜马拉雅山脉,海拔8,848米。

[C]: 珠穆朗玛峰是世界上最高的山峰,海拔8848米。

[D]: 世界上最高的山峰是珠穆朗玛峰,位于喜马拉雅山脉,海拔8,848.86米(29,031.69英尺)。

[E]: 世界上最高的山峰是珠穆朗玛峰,也称为萨加玛塔,位于喜马拉雅山脉的尼泊尔和中国边境之间,海拔8,848.86米(29,031.69英尺)。它是世界上最著名的登山目标之一,吸引着来自世界各地的登山者前来挑战。珠穆朗玛峰的名字来自藏语,意思是“女神的额峰”,它是由两个不同的山峰组成的,其中一个是位于尼泊尔的珠穆朗玛峰,另一个则位于中国。它的高度是通过测量海拔高度来确定的,因为它是通过测量地球的平均高度来确定的。尽管珠穆朗玛峰是世界上最高的山峰,但它并不是地球上任何其他地方都能到达的。地球上的其他地方,如南美洲的安第斯山脉,也是世界上最高的山脉,但它并不是地球上最高的山峰。总之,珠穆朗玛峰是世界上最高的山峰,但它并不是地球上任何地方都能到达的。它是地球上最高的山脉,但它并不是地球上任何地方都能到达的。

[Q]: 万有引力是谁提出的?

[A]: 万有引力是由英国物理学家牛顿提出的。他认为,所有物体都会产生引力,这个引力是由物体的质量和距离决定的。这个理论揭示了质量和距离之间的关系,并证明了万有引力的本质。

[B]: 万有引力是由牛顿在1687年提出的。它是宇宙中一个基本的物理现象,它描述了物体之间的相互作用。这个力被称为万有引力,它在所有物体之间都存在,这种力与物体的质量和距离有关。万有引力是自然界中最基本的力量之一,它不仅影响着物体的运动和变化,还对宇宙的结构和演化产生着重要的影响。

[C]: 万有引力是英国物理学家艾萨克·牛顿在17世纪提出的。

[D]: 引力是宇宙中一种力量,它是由质量或能量所组成的。根据牛顿的万有引力定律,一个物体之间的引力大小与它的质量成正比,与它的质量成反比。因此,牛顿的万有引力定律表明,一个物体之间的引力大小与它的质量成正比,与它的质量成反比。这个定律在物理学、天文学和物理学中都有广泛的应用。

[E]: 万有引力是由英国物理学家艾萨克·牛顿于1687年提出的。他在1687年发表了一篇著名的论文,题为《自然哲学的数学原理》,其中提出了万有引力定律,指出任何两个物体之间都存在着一种引力,这种引力的大小与它们的质量成正比,与它们之间的距离的平方成反比。这个定律被称为万有引力定律,它描述了质量和距离之间的关系。它表明,两个物体之间的引力与它们的质量成正比,与它们之间的距离的平方成反比。这个定律对于解释宇宙中的许多现象和现象之间的相互作用非常重要,例如行星绕太阳运动、恒星之间的引力透镜效应等等。它也被广泛应用于天文学、物理学和工程学等领域,为我们理解宇宙的本质和演化提供了重要的理论基础。

[Q]: 你知道大熊猫的主要食物是什么吗?

[A]: 大熊猫的主要食物是竹子。它们通常吃竹子,每天需要吃掉大约30公斤的竹子。

[B]: 是的,大熊猫主要以竹子为食。它们每天需要吃掉大量的竹子来维持生命,每天需要吃掉40至80公斤的竹子。此外,它们也会吃一些其他的植物,如草、果实、坚果和小型哺乳动物。

[C]: 大熊猫主要以竹子为食,也会偶尔食用其他的植物和动物。此外,大熊猫也会吃一些野果、小动物和植物,但这些都不属于它们的主要食物来源。

[D]: 大熊猫的主要食物是竹子。

[E]: 大熊猫是一种以竹子为主要食物的植食动物,它们的肠道结构适合消化纤维素含量高的竹子,但也会吃一些其他植物,如草本植物和小型哺乳动物。大熊猫的肠道结构也适应了高纤维的竹子,这使得它们能够消化大量的纤维素,从而帮助它们在野外生存。大熊猫的肠道中还含有一种叫做“纤维素酶”的酶类物质,这种酶能够帮助大熊猫分解纤维素,从而帮助它们消化大量的水分和营养物质。此外,大熊猫的肠道还含有一种叫做“纤维素蛋白”的蛋白质,这种蛋白质能够帮助大熊猫维持体内的能量水平,从而帮助它们在野外生存。总的来说,大熊猫的主要食物是竹子,但它们也会吃一些其他植物,如草本植物和小型哺乳动物。

[Q]: 海水为什么是咸的?

[A]: 海水中含有许多盐分,这些盐分可以导致海水咸度的增加。海水中的盐分主要来自于海水中的盐分,这些盐分可以从海水中的盐分中获得。海水中的氧化物和盐分可以与海水中的盐分形成氢键,从而使海水咸度增加。

[B]: 海水是咸的,这是因为它含有大量的盐分,其中包括氯离子和氯离子。这些离子在海洋中形成了大量的盐,这些盐分被称为盐分。海水中含有许多溶解在水中的盐,这些盐分会随着海水的升高而逐渐蒸发,最终导致海水中盐分的蒸发。这些盐分在海水中被完全消耗,然后被排除在海水中。此外,海水中还含有许多其他的盐分,但这些盐分是不同的,因为它们在水中的浮起和下降过程是不同的。海水中的盐分是从海底的岩石中提取出来的,这些盐分在海水中可以被利用。总的来说,海水是咸的,这也是为什么海水中含有许多盐分和盐分的原因。

[C]: 海水含有许多溶解的盐类,其中最主要的是氯化钠。当水中加入盐时,盐的分子会与水分子发生反应,形成氢氧化钠,这是一种盐。

[D]: 因为水是许多生物的生存所必需的,它能够吸收和释放二氧化碳,释放氧气,维持大气中的水蒸气,以及维持水循环。水中的盐类和化学物质会释放出氧气,使地球上的生物呼吸。此外,水还具有许多其他功能,如保持水循环、维持水循环、调节气候和环境等。水是许多生物生存所必需的,它也是许多自然现象的重要基础。

[E]: 海水是咸的主要原因是因为其中含有大量的溶解盐类,其中最主要的是氯化钠(NaCl)。氯化钠是一种非常常见的盐类,它存在于地球上的大部分地区,包括海洋、湖泊、河流和地下水。当水从海洋中蒸发时,它会带走一部分盐分,使海水变得咸。此外,海中还含有其他溶解盐类的物质,如硫酸盐、硫酸镁、硫酸钙、硫酸镁盐、硫酸镁钾、硫酸镁钠、硫酸镁钙、硫酸镁镁钙、硫酸镁镁钙、硫酸镁镁钙、硫酸镁镁钠、硫酸镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁镁钙、硫酸镁镁镁镁

Примечание

?♂️ Напрямую бросьте ответ указанной выше модели в GPT-4o и пусть она поможет забить:

Модель А :

Модель Б :

Модель С :

Модель Д :

Модель Е :

| Модель | С | Э | Б | А | Д |

|---|---|---|---|---|---|

| Фракция | 75 | 70 | 65 | 60 | 50 |

Сортировка серии minimind (ABC) соответствует интуиции, а minimind-v1 (0,1B) имеет наивысший балл. Ответы на вопросы здравого смысла в основном свободны от ошибок и иллюзий.

epochs SFT-раундов minimind-v1 (0,1B) меньше 2. Мне лень заранее убивать, чтобы освободить ресурсы для маленькой модели, но 0,1B все еще достигает максимальной производительности, хотя и не полностью. На самом деле он все еще на один уровень выше предыдущего мертвого.Ответ модели Е выглядит очень хорошо невооруженным глазом, хотя здесь присутствуют некоторые галлюцинации и измышления. Однако рейтинги GPT-4o и Deepseek сошлись во мнении, что у него «слишком длинная информация, повторяющийся контент и иллюзии». На самом деле такая оценка несколько строга. Даже если 10 слов из 100 — галлюцинации, ему легко присвоят низкую оценку. Поскольку длина текста перед обучением модели E больше, а набор данных намного больше, ответы кажутся полными. В случае объемной аппроксимации важно как количество, так и качество данных.

?♂️Личная субъективная оценка: E>C>B≈A>D

? Рейтинг GPT-4o: C>E>B>A>D

Закон масштабирования: чем больше параметры модели и чем больше обучающих данных, тем выше производительность модели.

См. код оценки C-Eval: ./eval_ceval.py . Чтобы избежать трудностей с исправлением формата ответа, оценка небольших моделей обычно напрямую определяет вероятность предсказания токена, соответствующего четырем буквам A , B , C , и D и берет наибольший из них. Ответьте на ответ и рассчитайте степень точности стандартного ответа. Сама модель мини-мозга не использовала больший набор данных для обучения и не настраивала инструкции для ответов на вопросы с несколькими вариантами ответов. Результаты оценки можно использовать в качестве справочного материала.

Например, подробности результата minimind-small:

| Тип | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 | 17 | 18 | 19 | 20 | двадцать один | двадцать два | двадцать три | двадцать четыре | 25 | 26 | 27 | 28 | 29 | 30 | 31 | 32 | 33 | 34 | 35 | 36 | 37 | 38 | 39 | 40 | 41 | 42 | 43 | 44 | 45 | 46 | 47 | 48 | 49 | 50 | 51 | 52 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Данные | вероятность_и_статистика | закон | middle_school_biology | высшая_школа_химии | высшая_школа_физики | юридический_профессионал | high_school_chinese | high_school_history | налоговый_бухгалтер | современная_китайская_история | средняя_школа_физика | middle_school_history | основная_медицина | Операционная система | логика | инженер-электрик | гражданский служащий | китайский_язык_и_литература | колледж_программирование | бухгалтер | plant_protection | средняя_школа_химия | метрологический_инженер | ветеринарная_медицина | марксизм | Advanced_mathematics | high_school_mathematics | бизнес-администрирование | mao_zedong_ Thought | идеологическое_и_моральное_воспитание | колледж_экономика | professional_tour_guide | Environmental_impact_assessment_engineer | компьютерная_архитектура | Urban_and_rural_planner | колледж_физика | middle_school_mathematics | high_school_politics | врач | колледж_химия | high_school_biology | high_school_geography | middle_school_politics | клиническая_медицина | компьютер_сеть | спортивная_наука | art_studies | квалификация_учителя | дискретная_математика | образование_наука | пожарный_инженер | middle_school_geography |

| Тип | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 | 17 | 18 | 19 | 20 | двадцать один | двадцать два | двадцать три | двадцать четыре | 25 | 26 | 27 | 28 | 29 | 30 | 31 | 32 | 33 | 34 | 35 | 36 | 37 | 38 | 39 | 40 | 41 | 42 | 43 | 44 | 45 | 46 | 47 | 48 | 49 | 50 | 51 | 52 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Т/А | 18 марта | 24 мая | 21 апреля | 19 июля | 19 мая | 23 февраля | 19 апреля | 20.06.20 | 10/49 | 23 апреля | 19 апреля | 22 апреля | 1/19 | 19 марта | 22 апреля | 7/37 | 11/47 | 23 мая | 37.10. | 9/49 | 22 июля | 4/20 | 24 марта | 23 июня | 19 мая | 19 мая | 18 апреля | 33 августа | 24 августа | 19 мая | 17/55 | 29.10. | 31 июля | 21 июня | 11/46 | 19 мая | 19 марта | 19 апреля | 13/49 | 24 марта | 19 мая | 19 апреля | 21 июня | 22 июня | 19 февраля | 19 февраля | 14/33 | 12/44 | 16 июня | 29 июля | 31 сентября | 1/12 |

| Точность | 16,67% | 20,83% | 19,05% | 36,84% | 26,32% | 8,70% | 21,05% | 30,00% | 20,41% | 17,39% | 21,05% | 18,18% | 5,26% | 15,79% | 18,18% | 18,92% | 23,40% | 21,74% | 27,03% | 18,37% | 31,82% | 20,00% | 12,50% | 26,09% | 26,32% | 26,32% | 22,22% | 24,24% | 33,33% | 26,32% | 30,91% | 34,48% | 22,58% | 28,57% | 23,91% | 26,32% | 15,79% | 21,05% | 26,53% | 12,50% | 26,32% | 21,05% | 28,57% | 27,27% | 10,53% | 10,53% | 42,42% | 27,27% | 37,50% | 24,14% | 29,03% | 8,33% |

总题数: 1346

总正确数: 316

总正确率: 23.48%

| категория | правильный | вопрос_количество | точность |

|---|---|---|---|

| minimind-v1-маленький | 344 | 1346 | 25,56% |

| минимозг-v1 | 351 | 1346 | 26,08% |

### 模型擅长的领域:

1. 高中的化学:正确率为42.11%,是最高的一个领域。说明模型在这方面的知识可能较为扎实。

2. 离散数学:正确率为37.50%,属于数学相关领域,表现较好。

3. 教育科学:正确率为37.93%,说明模型在教育相关问题上的表现也不错。

4. 基础医学:正确率为36.84%,在医学基础知识方面表现也比较好。

5. 操作系统:正确率为36.84%,说明模型在计算机操作系统方面的表现较为可靠。

### 模型不擅长的领域:

1. 法律相关:如法律专业(8.70%)和税务会计(20.41%),表现相对较差。

2. 中学和大学的物理:如中学物理(26.32%)和大学物理(21.05%),模型在物理相关的领域表现不佳。

3. 高中的政治、地理:如高中政治(15.79%)和高中地理(21.05%),模型在这些领域的正确率较低。

4. 计算机网络与体系结构:如计算机网络(21.05%)和计算机体系结构(9.52%),在这些计算机专业课程上的表现也不够好。

5. 环境影响评估工程师:正确率仅为12.90%,在环境科学领域的表现也不理想。

### 总结:

- 擅长领域:化学、数学(特别是离散数学)、教育科学、基础医学、计算机操作系统。

- 不擅长领域:法律、物理、政治、地理、计算机网络与体系结构、环境科学。

这表明模型在涉及逻辑推理、基础科学和一些工程技术领域的问题上表现较好,但在人文社科、环境科学以及某些特定专业领域(如法律和税务)上表现较弱。如果要提高模型的性能,可能需要加强它在人文社科、物理、法律、以及环境科学等方面的训练。

./export_model.py может экспортировать модель в формат трансформеров и отправить ее в HuggingFace.

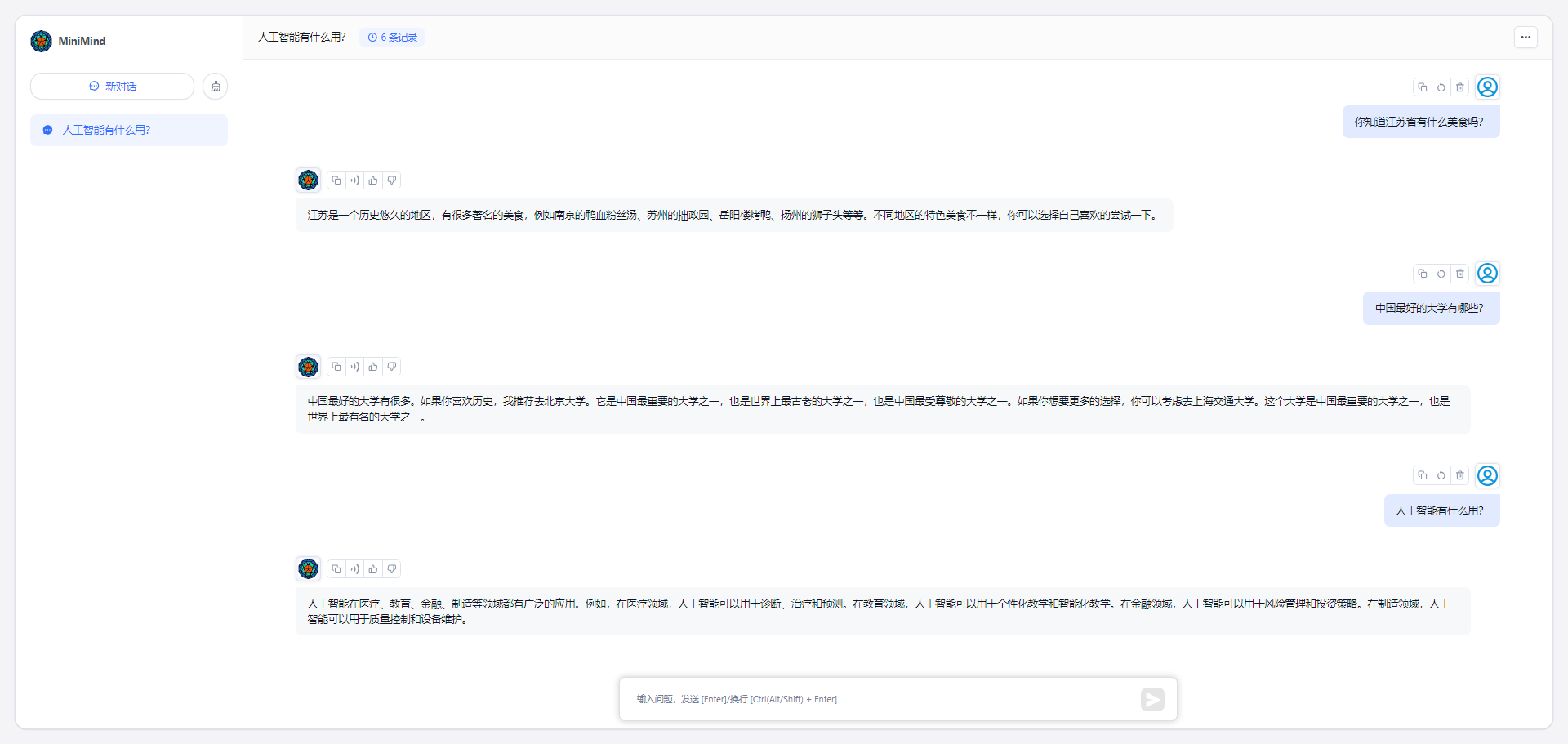

Адрес коллекции обнимающихся лиц MiniMind: MiniMind

my_openai_api.py дополняет интерфейс чата openai_api, упрощая подключение ваших собственных моделей к сторонним пользовательским интерфейсам, таким как fastgpt, OpenWebUI и т. д.

Загрузите файл веса модели с Huggingface.

minimind (root dir)

├─minimind

| ├── config.json

| ├── generation_config.json

| ├── LMConfig.py

| ├── model.py

| ├── pytorch_model.bin

| ├── special_tokens_map.json

| ├── tokenizer_config.json

| ├── tokenizer.json

Запустить чат-сервер

python my_openai_api.pyТестовый интерфейс сервиса

python chat_openai_api.pyПример интерфейса API, совместимого с форматом API openai

curl http://ip:port/v1/chat/completions

-H " Content-Type: application/json "

-d ' {

"model": "model-identifier",

"messages": [

{ "role": "user", "content": "世界上最高的山是什么?" }

],

"temperature": 0.7,

"max_tokens": -1,

"stream": true

} '

Кончик

Если вы чувствуете, что MiniMind вам полезен, вы можете добавить статью на GitHub. Длина не короткая, а уровень ограничен. Пропуски неизбежны. Вы можете обмениваться исправлениями в разделе «Проблемы» или отправлять проекты по улучшению связей с общественностью. Ваша поддержка. движущая сила постоянного улучшения проекта.

Примечание

Каждый подливает масла в огонь. Если вы пытались обучить новую модель MiniMind, вы можете поделиться весами своей модели в разделах «Обсуждения» или «Проблемы». Это могут быть конкретные последующие задачи или вертикальные области (например, распознавание эмоций, медицина, психология). , финансовые, юридические вопросы и ответы и т. д.) Новая версия модели MiniMind Это также может быть новая версия модели MiniMind после расширенного обучения (например, изучения более длинных текстовых последовательностей, больших объемов (0,1 млрд+) или больших наборов данных). Любое совместное использование считается уникальным, и все попытки ценны и поощряются. быть вовремя обнаружены и включены в список благодарностей. Еще раз спасибо за вашу поддержку!

@ipfgao : Запись шагов тренировки

@chuanzhubin : ? Комментарии к коду построчно

@WangRongsheng : Предварительная обработка больших наборов данных.

@pengqianhan : Краткое руководство.

@RyanSunn : ?Запись обучения процессу рассуждения

Этот репозиторий лицензируется по лицензии Apache-2.0.