GPT-4V, этот артефакт, известный как «смотреть на картинки и говорить», подвергался критике за отсутствие понимания графических интерфейсов. Это похоже на человека с «экранной слепотой», который часто нажимает не те кнопки, что сводит с ума. Однако ожидается, что модель OmniParser, выпущенная Microsoft, полностью решит эту проблему! OmniParser похож на «переводчик экрана», преобразующий снимки экрана в простой для понимания структурированный язык GPT-4V, что делает «зрение» GPT-4V более острым. Редактор Downcodes поможет вам глубже понять эту волшебную модель, увидеть, как она помогает GPT-4V преодолеть дефект «слепоты глаз» и удивительную технологию, стоящую за ней.

Вы еще помните GPT-4V, артефакт, который известен как «смотреть картинки и говорить»? Он может понимать содержание картинок и выполнять задачи на основе картинок. Это благо для ленивых людей! слабость: у него не очень хорошее зрение !

Представьте, что вы просите GPT-4V нажать за вас кнопку, но он щелкает повсюду, как «экранная шторка». Разве это не безумие?

Сегодня я представлю вам артефакт, который может улучшить внешний вид GPT-4V — OmniParser. Это новая модель, выпущенная Microsoft, призванная решить проблему автоматического взаимодействия графических пользовательских интерфейсов (GUI).

Что делает OmniParser?

Проще говоря, OmniParser — это «переводчик экрана», который может анализировать снимки экрана на «структурированный язык», понятный GPT-4V. OmniParser сочетает в себе точно настроенную интерактивную модель обнаружения значков, точно настроенную модель описания значков и выходные данные модуля OCR.

Эта комбинация создает структурированное DOM-подобное представление пользовательского интерфейса, а также снимки экрана, закрывающие ограничивающие рамки потенциально взаимодействующих элементов. Исследователи сначала создали интерактивный набор данных для обнаружения значков, используя популярные веб-страницы и наборы данных описания значков. Эти наборы данных используются для тонкой настройки специализированных моделей: модели обнаружения для анализа интерактивных областей на экране и модели описания для извлечения функциональной семантики обнаруженных элементов.

В частности, OmniParser будет:

Определите все интерактивные значки и кнопки на экране, пометьте их прямоугольниками и присвойте каждому блоку уникальный идентификатор.

Используйте текст для описания функции каждого значка, например «Настройки» и «Свернуть». Распознавайте текст на экране и извлекайте его.

Таким образом, GPT-4V может четко знать, что отображается на экране и что делает каждая вещь. Просто сообщите ему идентификатор кнопки, которую вы хотите нажать.

Насколько хорош OmniParser?

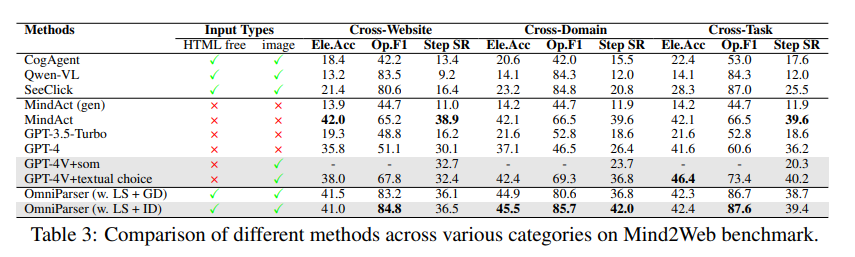

Исследователи использовали различные тесты для тестирования OmniParser и обнаружили, что он действительно может сделать GPT-4V «лучше»!

В тесте ScreenSpot OmniParser значительно улучшил точность GPT-4V, даже превзойдя некоторые модели, специально подготовленные для работы с графическими интерфейсами. Например, в наборе данных ScreenSpot OmniParser повышает точность на 73 %, превосходя по производительности модели, основанные на базовом анализе HTML. Примечательно, что включение локальной семантики элементов пользовательского интерфейса привело к значительному повышению точности прогнозирования: значки GPT-4V были правильно помечены с 70,5% до 93,8% при использовании выходных данных OmniParser.

В тесте Mind2Web OmniParser улучшил производительность GPT-4V в задачах просмотра веб-страниц, а его точность даже превзошла GPT-4V, который использует информационную поддержку HTML.

В тесте AITW OmniParser значительно улучшил производительность GPT-4V в задачах навигации мобильного телефона.

Каковы недостатки OmniParser?

Хотя OmniParser очень мощный, у него также есть некоторые незначительные недостатки, такие как:

Столкнувшись с повторяющимися значками или текстом, легко запутаться , и чтобы их отличить, нужны более подробные описания.

Иногда рамка прорисовывается недостаточно точно , из-за чего GPT-4V щелкает в неправильном положении.

Интерпретация значков порой ошибочна и требует контекста для более точного описания.

Однако исследователи усердно работают над улучшением OmniParser и полагают, что он будет становиться все более мощным и в конечном итоге станет лучшим партнером GPT-4V!

Модельный опыт: https://huggingface.co/microsoft/OmniParser

Вход для бумаги: https://arxiv.org/pdf/2408.00203.

Официальное введение: https://www.microsoft.com/en-us/research/articles/omniparser-for-pure-vision-based-gui-agent/.

Выделять:

✨OmniParser может помочь GPT-4V лучше понимать содержимое экрана и точнее выполнять задачи.

OmniParser хорошо показал себя в различных тестах, доказав свою эффективность.

?️OmniParser еще есть области для улучшения, но есть надежда на будущее.

В целом, OmniParser вносит революционные улучшения во взаимодействие GPT-4V с графическим пользовательским интерфейсом. Несмотря на наличие некоторых недостатков, его потенциал огромен, и стоит с нетерпением ждать его будущего развития. Редактор Downcodes верит, что с постоянным развитием технологий OmniParser станет яркой звездой в области искусственного интеллекта!