Редактор Downcodes познакомит вас с инновационной технологией Google, подрывающей традиционное редактирование видео, — ReCapture. Эта технология позволяет пользователям легко выполнять настройку движения камеры на профессиональном уровне, переопределяет язык объектива для снятых видео и упрощает начало работы даже начинающим видеоредакторам. Как это изменит способ создания видео? Давайте вместе раскроем тайну ReCapture.

Новейшая технология ReCapture, запущенная исследовательской группой Google, подрывает традиционный метод редактирования видео. Это нововведение позволяет обычным пользователям легко осуществлять регулировку движения камеры на профессиональном уровне и перепроектировать язык объектива для уже снятых видео.

В традиционном постобработке видео изменение угла камеры захваченного видео всегда было технической проблемой. Когда существующие решения обрабатывают различные типы видеоконтента, часто бывает сложно одновременно поддерживать сложные эффекты движения камеры и детализацию изображения. ReCapture использует другой подход и не использует традиционный метод промежуточного 4D-представления. Вместо этого он умело использует знания о движении, хранящиеся в генеративной видеомодели, и переопределяет задачу как процесс преобразования видео в видео с помощью Stable Video Diffusion.

В системе используется двухэтапный рабочий процесс. На первом этапе генерируется опорное видео, которое представляет собой исходную выходную версию с новым положением камеры. Этот этап может быть достигнут путем создания многоракурсных видеороликов с помощью диффузионных моделей, таких как CAT3D, или путем покадровой оценки глубины и рендеринга облака точек. Хотя эта версия может иметь некоторые несоответствия по времени и визуальные недостатки, она заложила основу для второй фазы.

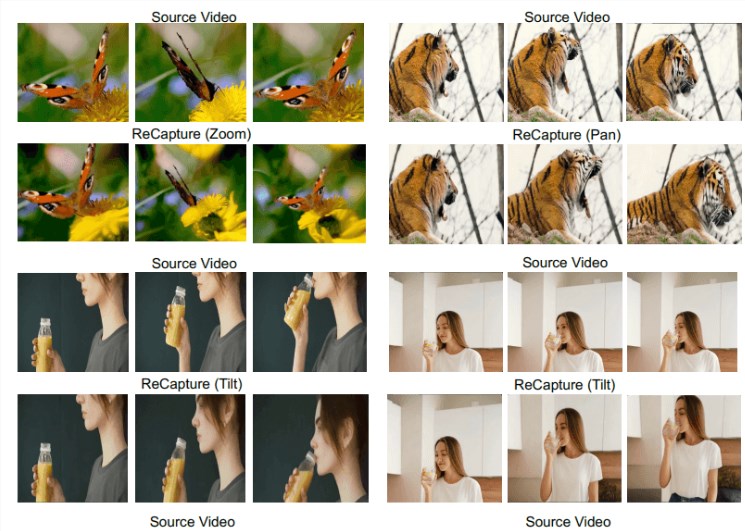

На втором этапе применяется точная настройка маскированного видео с использованием генеративной видеомодели, обученной на существующих отснятых материалах, для создания реалистичных эффектов движения и изменения времени. Система представляет временной слой LoRA (адаптация низкого ранга) для оптимизации модели, чтобы она могла понимать и воспроизводить конкретные динамические характеристики якорных видео без повторного обучения всей модели. В то же время пространственный уровень LoRA гарантирует, что детали и содержимое изображения соответствуют новому движению камеры. Это позволяет генеративной видеомодели выполнять такие операции, как масштабирование, панорамирование и наклон, сохраняя при этом характерное движение исходного видео.

Хотя ReCapture добилась значительного прогресса в области удобной для пользователя обработки видео, она все еще находится на стадии исследований и еще далека от коммерческого применения. Стоит отметить, что хотя у Google есть множество проектов видеоИИ, она пока не вывела их на рынок. Среди них проект Veo, возможно, наиболее близок к коммерческому использованию. Точно так же недавно выпущенная модель Movie-Gen от Meta и Sora от OpenAI, выпущенная в начале года, еще не коммерциализированы. В настоящее время рынок видеоИИ в основном возглавляют такие стартапы, как Runway, который прошлым летом выпустил свою последнюю модель Gen-3Alpha.

Появление технологии ReCapture знаменует собой революцию в области редактирования видео. Хотя он все еще находится на стадии исследований и разработок, его мощные функции и удобные методы работы, несомненно, открывают неограниченные возможности для создания будущего видео. Редактор Downcodes продолжит следить за развитием этой технологии и предоставлять вам дополнительные отчеты по этой теме.